在当今数字化转型的浪潮中,大模型技术已然成为企业提升竞争力的关键驱动力。DeepSeek 作为国内极具实力的大模型代表,正引领着众多企业迈向智能化变革的新征程。从教育领域到金融行业,再到互联网巨头的核心业务,越来越多的头部企业纷纷完成 DeepSeek 的私有化部署,并积极开展垂直训练,以满足特定业务场景的深度需求。

近期,国产 DeepSeek 大模型凭借其卓越的自然语言处理能力和强大的深度学习架构,在各行业掀起了智能化升级的浪潮。2 月 15 日深夜,有媒体发现微信搜一搜在测试接入 DeepSeek – R1 ,入口在微信首页上方的搜索框,点开会出现一个 “AI 搜索” 功能,处于灰色测试阶段,只有部分人可以看到。点击之后可选择 “深度思考”,即 DeepSeek R1 模型,搜索时会展示思考推理的流程。腾讯相关人士回应称,微信搜一搜在调用混元大模型丰富 AI 搜索的同时,正式灰度测试接入 DeepSeek,被灰度到的用户,可在对话框顶部搜索入口,看到 “AI 搜索” 字样,点击进入后,可免费使用 DeepSeek – R1 满血版模型,获得更多元化的搜索体验。此前,腾讯多款产品已接入 DeepSeek,如腾讯 AI 助手 “腾讯元宝” 完成更新,同时支持混元和 DeepSeek 两大模型;腾讯云 AI 代码助手 ima 也接入了满血版 DeepSeek – R1 模型。

2 月 16 日晚间,百度搜索和文心智能体平台宣布将全面接入 DeepSeek 和文心大模型最新的深度搜索功能。搜索用户可免费使用 DeepSeek 和文心大模型深度搜索功能,文心智能体平台的开发者也将能随时调用 DeepSeek 模型创建并调优智能体。这一举措标志着百度搜索技术体系的重大升级,有望为用户带来全新的搜索体验。

在金融领域,多家头部公募基金积极行动,汇添富基金率先宣布完成 DeepSeek 系列开源模型的私有化部署,并将其应用于投资研究、产品销售、风控合规、客户服务等核心业务场景。天弘基金利用原生 DeepSeek R1 训练自己的金融推理大模型,博时基金在不同阶段不断升级部署 DeepSeek 模型,并探索其在投资研究、咨询服务和软件开发等方面的应用 。国泰基金完成私有化部署后,搭建了 AI 应用开发平台,在品牌持营、风险管控等业务场景中取得不俗表现。数禾科技也已完成 DeepSeek – R1 – 32B 和 DeepSeek – R1 – 671B(满血版)的私有化部署,强化了企业 AI 生态的自主可控能力,为普惠金融业务流程数智化转型提供有力支撑。

在教育行业,好未来、中公教育、网易有道等头部机构也密集宣布 DeepSeek 技术融合进展。中公教育完成 DeepSeek 系列模型私有化部署方案,其自主研发的 “云信” 垂直大模型已进入应用阶段,借助 DeepSeek – R1 模型出色的上下文处理能力,测试中的 AI 就业规划系统能同时解析多页的岗位说明文档。网易有道全面接入 DeepSeek – R1 大模型,优化了 AI 全科学习助手 “有道小 P” 的个性化答疑功能。

这些企业的积极实践表明,DeepSeek 私有化部署已成为各行业提升业务效率、创新服务模式的重要手段。然而,在实际操作过程中,企业也面临着诸多挑战,如数据隐私保护、硬件资源需求、模型优化等问题。这种大模型在垂直领域的迁移存在很高的技术门槛。例如,如何解决大模型在领域迁移中的数据处理问题,如何在有限的算力下进行高效微调,如何部署这些模型以满足实际应用的需求,以及如何持续优化以降低部署后的推理成本等。整个工业界与学术界都缺乏这样的专业人才,也没有合适的资料介绍垂直领域迁移所涉及的完整知识体系,而这些问题在《大模型垂直领域低算力迁移:微调、部署与优化》一书中都能找到解决方案。

在企业内部使用 DeepSeek 进行私有化数据的垂直训练时,数据隐私保护至关重要。书中详细介绍了数据加密、差分隐私、联邦学习等技术方案。在数据传输过程中,通过使用 TLS/SSL 协议加密,确保数据在网络中传输的安全性;对于存储的数据,采用 AES 加密对训练数据和企业模型权重进行加密存储。在训练过程中,利用差分隐私技术,添加随机噪声,防止模型泄露原始数据,还可使用开源工具 Opacus 实现差分隐私训练。对于联邦学习,书中介绍了如何将训练过程分散到多个设备或节点,使原始数据不离开本地,通过开源框架 PySyft 实现联邦学习,从而在保障数据隐私的前提下完成模型训练。

许多企业在进行大模型训练时,面临硬件资源有限的问题。本书针对这一痛点,提出了参数高效微调(PEFT)的方法。以 LoRA(Low – Rank Adaptation)技术为例,在模型的关键层(如注意力层)插入低秩矩阵,仅训练这些矩阵,这样可以显著减少训练参数,降低显存占用,使训练在低算力条件下也能高效进行。Adapter 技术则是在模型层之间插入小型神经网络模块,仅训练这些模块,同样能达到减少训练资源消耗的目的。Prompt Tuning 方法通过设计提示词引导模型生成特定领域的输出,在节省算力的同时,实现模型在特定领域的有效应用。

书中从需求分析、环境搭建、模型微调、模型评估到部署与应用,给出了一套完整的垂直训练实施步骤。在需求分析阶段,指导企业确定垂直训练的目标,如构建智能客服、文档摘要等系统,并评估自身的数据量和硬件资源。在环境搭建方面,详细介绍了如何配置 GPU 服务器或云平台,以及安装 PyTorch、DeepSpeed 等训练框架和工具。在模型微调环节,不仅讲解了全参数微调(适用于数据量较大且硬件资源充足的情况),更着重介绍了适合低算力场景的参数高效微调方法。模型评估阶段,书中介绍了如何在验证集上测试模型性能,使用准确率、F1 分数等指标评估模型效果,以便及时调整超参数。最后,在部署与应用阶段,指导企业将微调后的模型部署到企业系统中,并结合 RAG 和向量数据库实现智能搜索等功能。

假设一家企业希望基于 DeepSeek 构建智能客服系统,以自动回答客户关于产品和服务的问题。根据书中的指导,企业首先进行数据准备,收集客服对话记录和产品文档,构建问答对数据集。在模型微调阶段,由于企业硬件资源有限,采用书中介绍的 LoRA 方法对 DeepSeek – V3 进行微调,训练模型理解企业产品和客户问题。完成微调后,在验证集上对模型进行评估,根据评估结果调整超参数,确保模型性能达到预期。最后,将微调后的模型部署到企业客服系统,并结合 RAG 技术实现实时答案生成。通过这样的实践,企业成功构建了高效的智能客服系统,提升了客户服务质量和效率。

大模型的训练需要大量的资金投入,只有少数大型企业才有可能推出与 ChatGPT 竞争的大模型。中小规模的企业只能选择低成本的垂直领域迁移技术路线,通过结合领域数据在开源基座模型上进行微调,并结合提示工程,这可能是平衡垂直领域迁移效果与成本的最佳技术选型。基于开源大模型的低算力微调与部署技术无疑是垂直领域低算力迁移的关键部分。

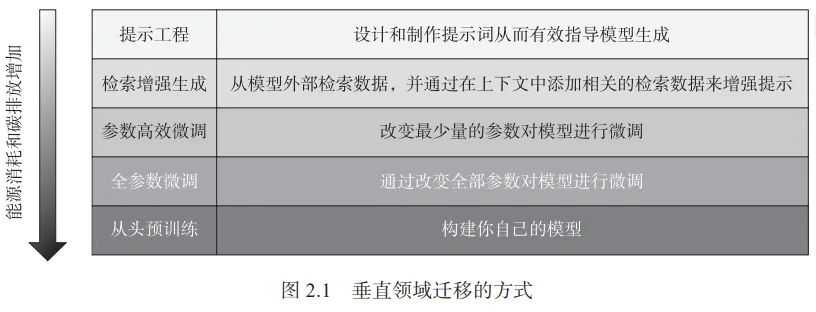

如图 2.1 所示,有多种方式可以实现大模型在垂直领域的迁移与应用,每种方式所 需资源差异巨大。提示工程通过设计专门的提示词来指导模型回应,不直接涉及模型 参数的调整,因此是一种资源消耗较少的方法。检索增强生成在生成过程中结合了外部信息,提高了回答的质量和相关性,同样也是一种效率较高的方法。参数高效微调 通过对模型参数的局部优化来实现性能提升,是一种既考虑性能又考虑资源消耗的折 中方案。与此相对的是全参数微调,它通过更新模型的所有参数来适应特定任务,尽 管能够达到最优性能,但需要更多的成本投入。最后,从头预训练需要构建一个全新 的模型,这是所有方法中成本最高的一种方案。因此,在选择模型迁移的方法时,应 权衡性能与成本,根据项目需求和资源限制做出合理决策。

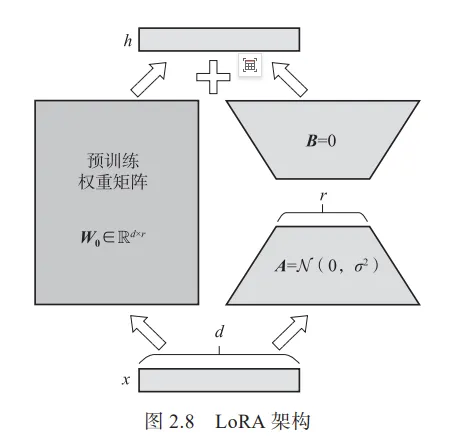

从成本的角度考虑,LoRA 等参数高效微调是低成本微调的首选。在数学和机器学习中,低秩近似是一种常见的技术,用于通过较低维度的表示来近似高维度数据或 矩阵。这种方法可以有效捕获数据的主要变化方向,而忽略噪声或不重要的变化。大 多数垂直领域迁移的微调任务只需要对原始模型的参数进行较小的修改就能达到较好 的效果。LoRA 方法通过使用一个较小规模的矩阵来近似这些修改,如图 2.8 所示。

LoRA 方法的优势在于,通过对权重矩阵施加低秩近似,实现了对模型的有效微 调,同时显著减少了灾难性遗忘的风险。这种方法平衡了新旧任务之间的知识保留和 迁移,特别适用于那些要求高度知识保持的场景。

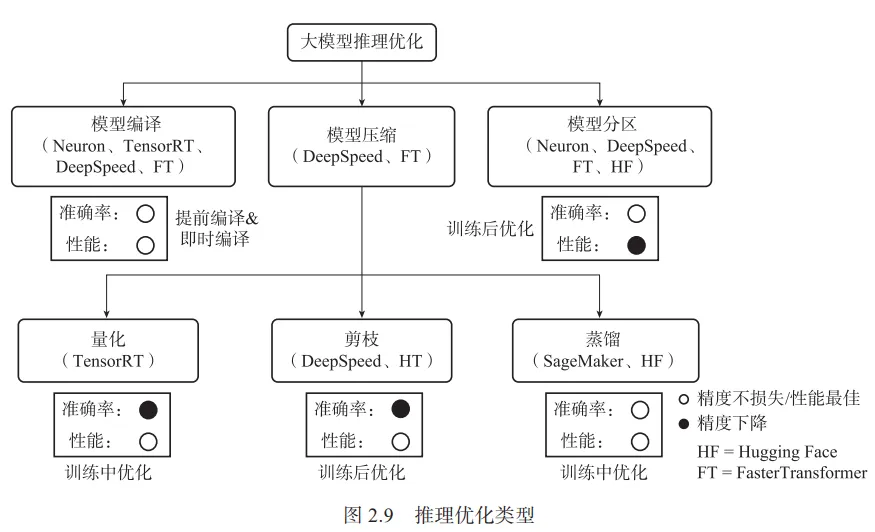

降低大模型的训练与推理成本是解决垂直领域低算力迁移的核心问题。如图 2.9 所 示,训练中优化(In-training Optimization)和训练后优化(Post-training Optimization) 是两种常见的推理优化策略。

DeepSeek 的私有化部署和垂直训练为企业带来了巨大的发展机遇,但同时也伴随着诸多技术挑战。程戈老师的《大模型垂直领域低算力迁移:微调、部署与优化》为企业提供了全面、系统且实用的解决方案,无论是数据隐私保护、低算力优化还是完整的训练实施步骤,都能在书中找到专业的指导。

读者福利

对于正在或计划进行 DeepSeek 私有化部署和垂直训练的企业来说,这本书无疑是一本不可或缺的技术指南,助力企业在大模型时代的浪潮中乘风破浪,实现智能化转型与创新发展。因此,我们为读者朋友准备了 3 本《大模型垂直领域低算力迁移:微调、部署与优化》。现在,关注 【AI 前线】 公众号,回复关键字 “大模型” 即可参与抽奖。

(文:AI前线)