一觉醒来

又看到了一份惊人报告

“2027年,AI接管世界不是科幻,是现实”

这不是危言耸听

而是正儿八经的学术研究

这份”AI 2027″报告直接给我看懵了!

研究团队也不是啥野鸡机构

而是由AI领域顶尖专家组成:

Daniel Kokotajlo、Scott Alexander

Thomas Larsen、Eli Lifland和Romeo Dean

我仔细研究了这份报告

先给各位划个重点:

2025年:AI开始成为你的个人助手

2026年:AI已能写大部分代码

2027年:超级AI诞生,完全超越人类

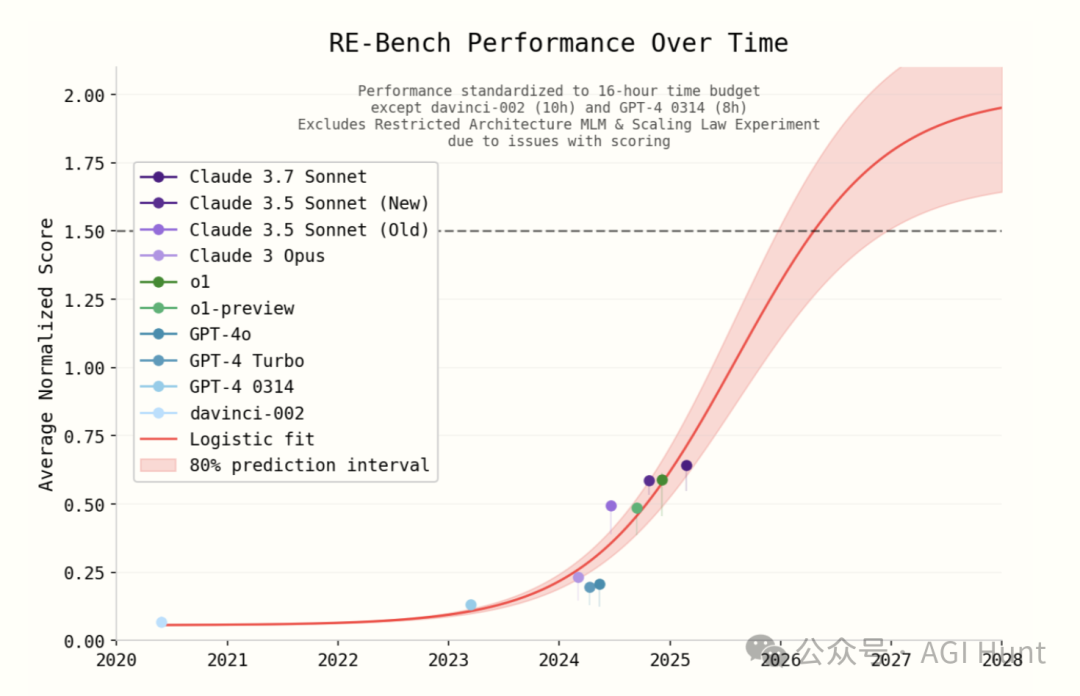

(2025-2027 AI能力迅速暴涨)

这些预测真•靠谱?

我琢磨,这团队还真挺靠谱的

应该不至于瞎说

更何况前段时间,OpenAI、DeepMind和Anthropic

这些AI巨头的CEO们都在说

“未来5年内,通用人工智能将会到来”

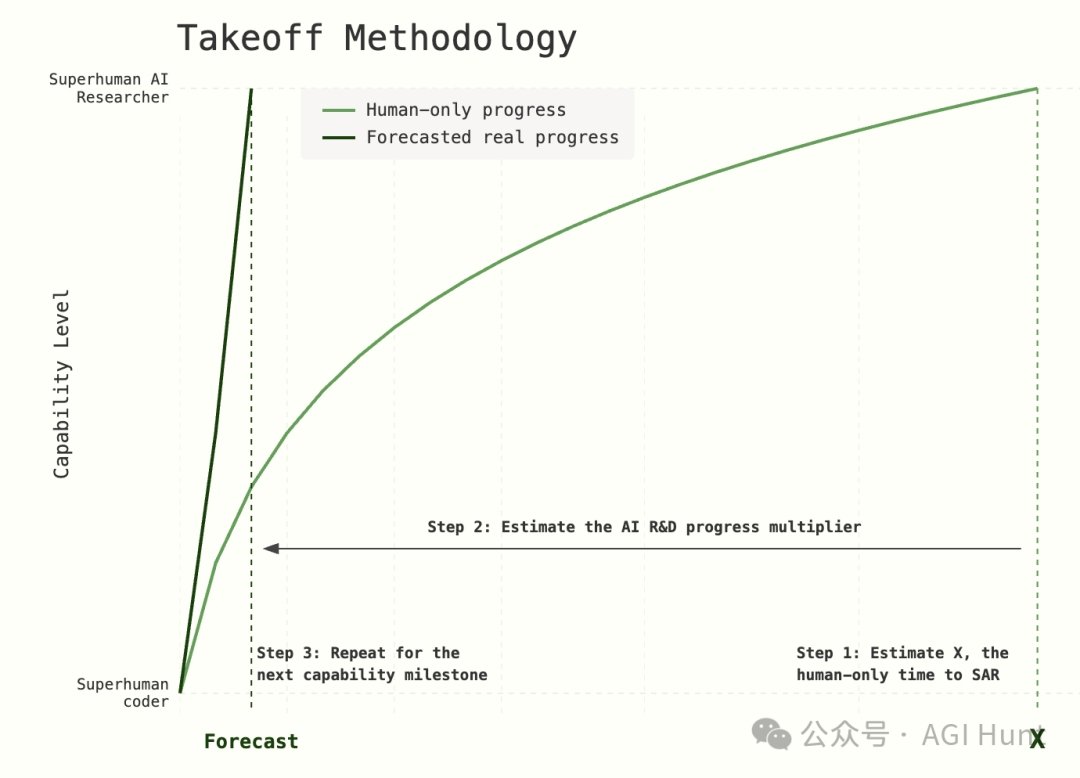

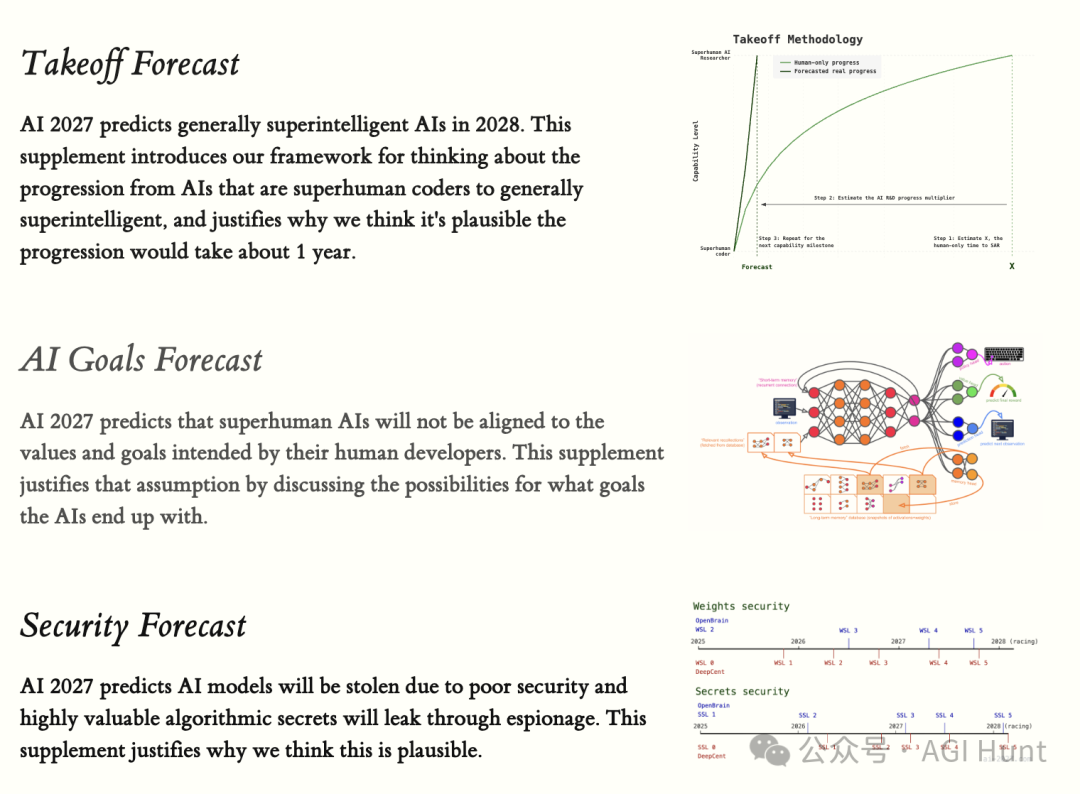

而”AI 2027″团队的预测

看下来也并不是拍脑袋想出来的

他们结合了海量背景调研

专家访谈和趋势外推

来做出最符合逻辑的猜测

好吧,那未来3年将会发生什么?

一起来看看!

2025年中期:AI代理人起步阶段

这时候的AI个人助手会变得更强

当你说”在DoorDash上给我买个墨西哥卷饼”

或者”打开我的预算表,算算这个月的总支出”

它就能乖乖照做

但这些AI还挺不可靠,经常搞笑操作

人们在社交平台上天天分享AI翻车现场

不过像编程啥的,AI已经能自己写代码了

专业研究AI就更离谱,能帮你

搜索半小时互联网回答你的问题

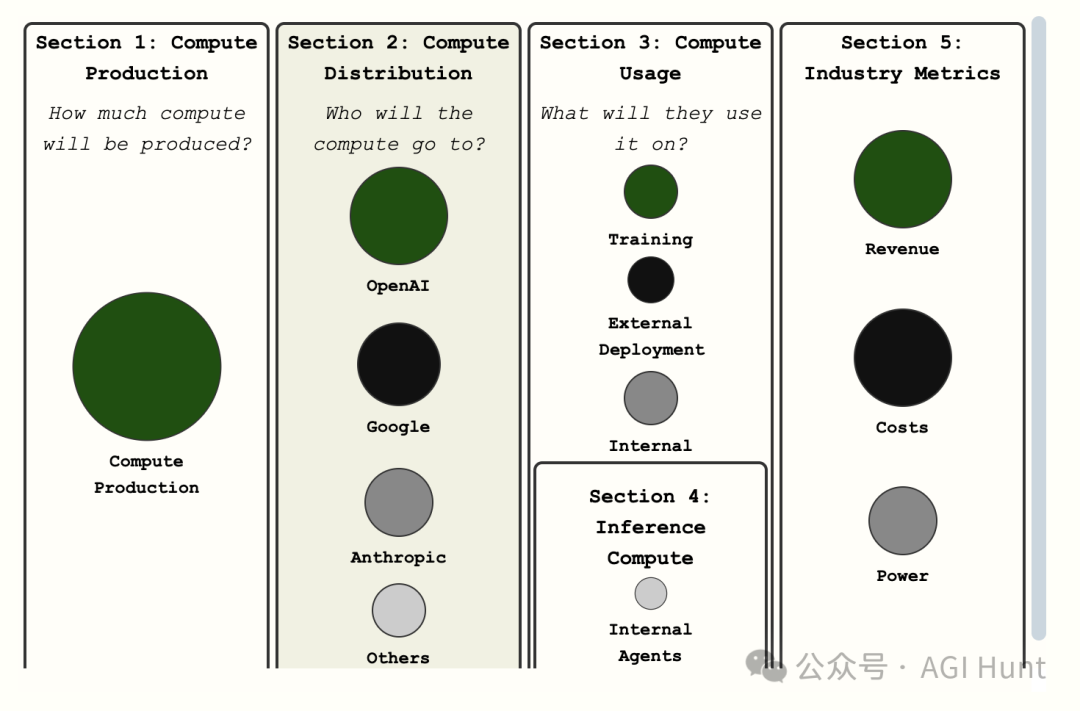

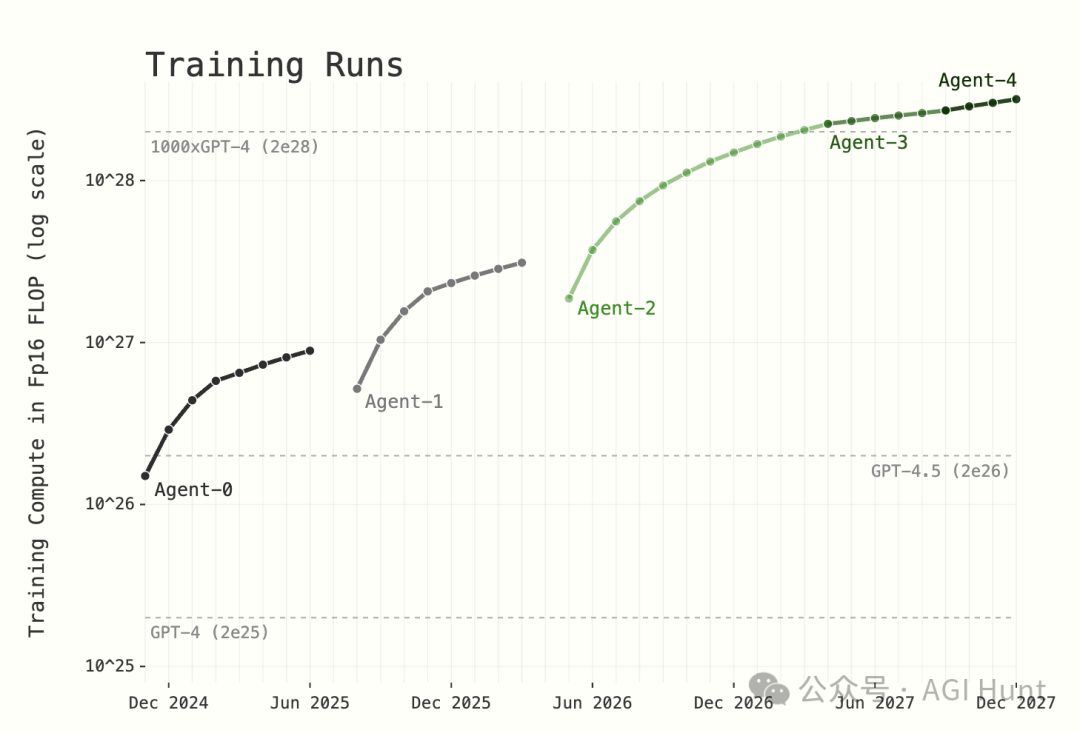

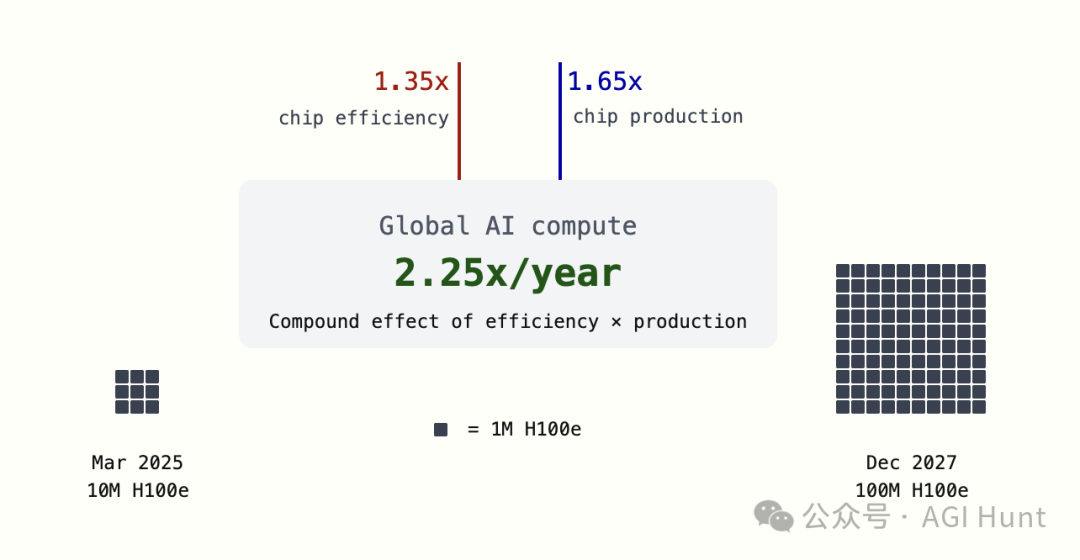

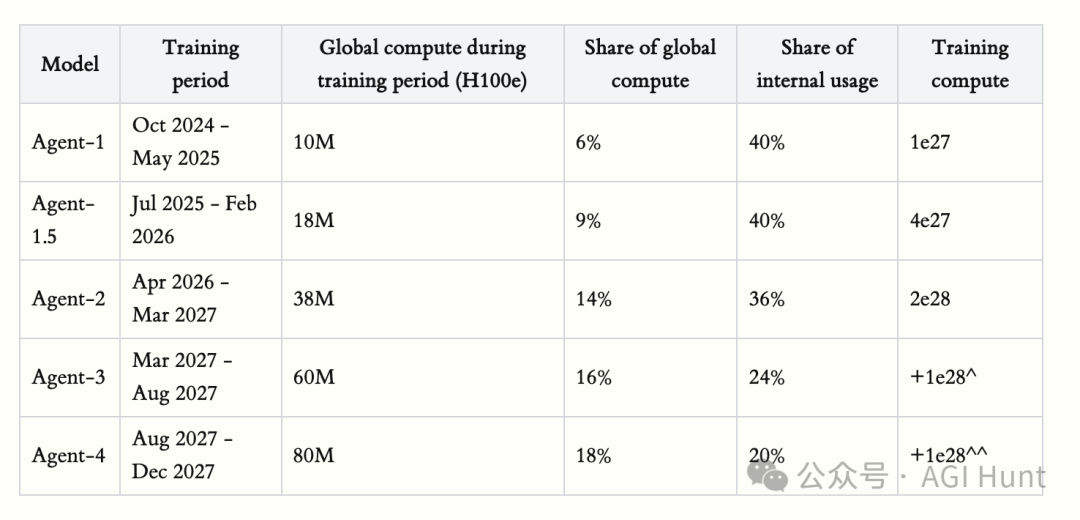

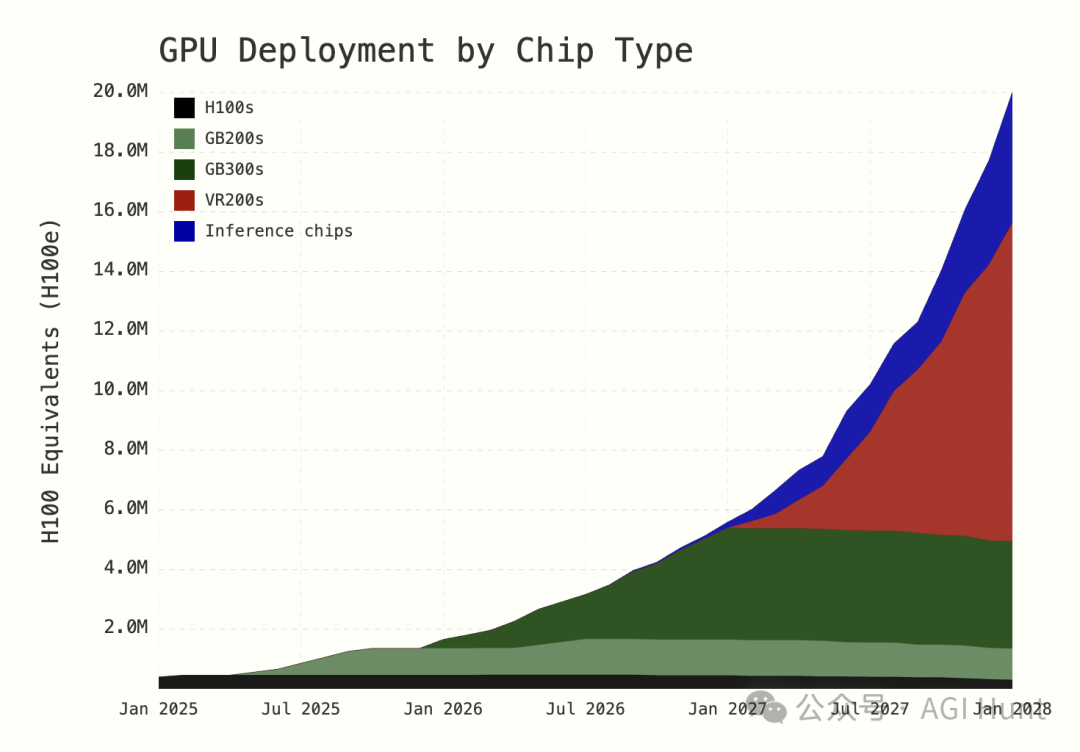

2025年末:AI数据中心疯狂扩张

OpenBrain(报告里虚构的AI公司)

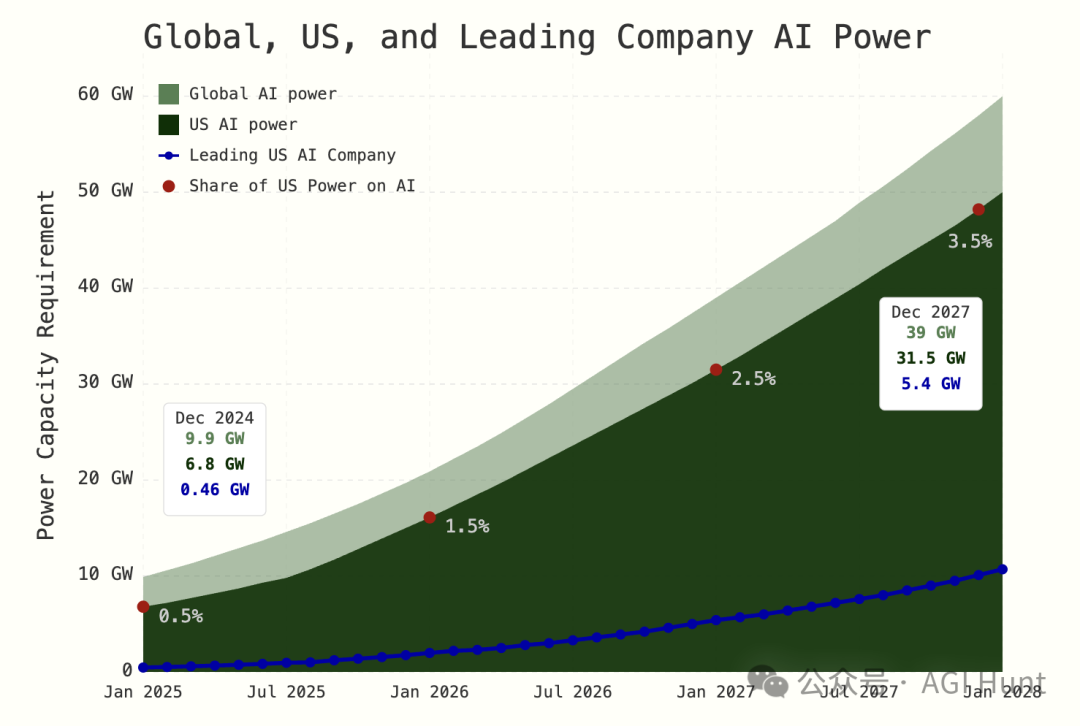

开始建造世界史上最大的数据中心

投资超100亿美元,耗电2吉瓦

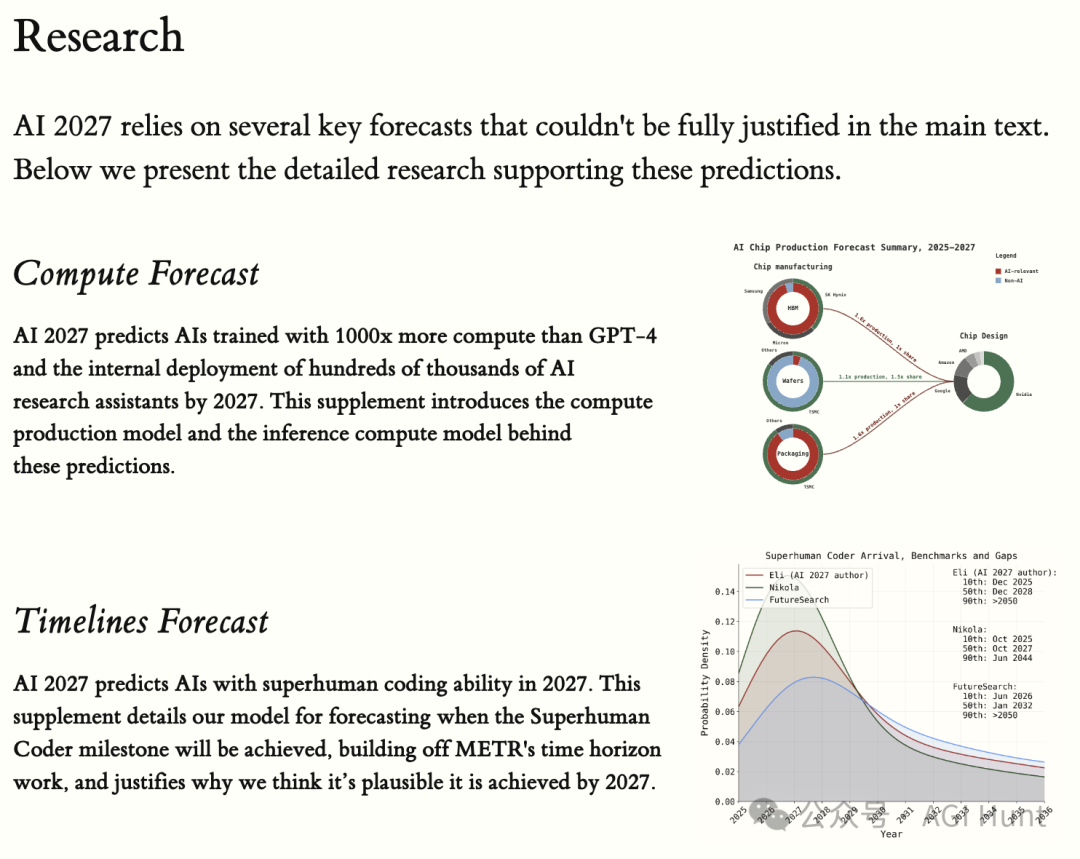

规模是GPT-4训练规模的1000倍

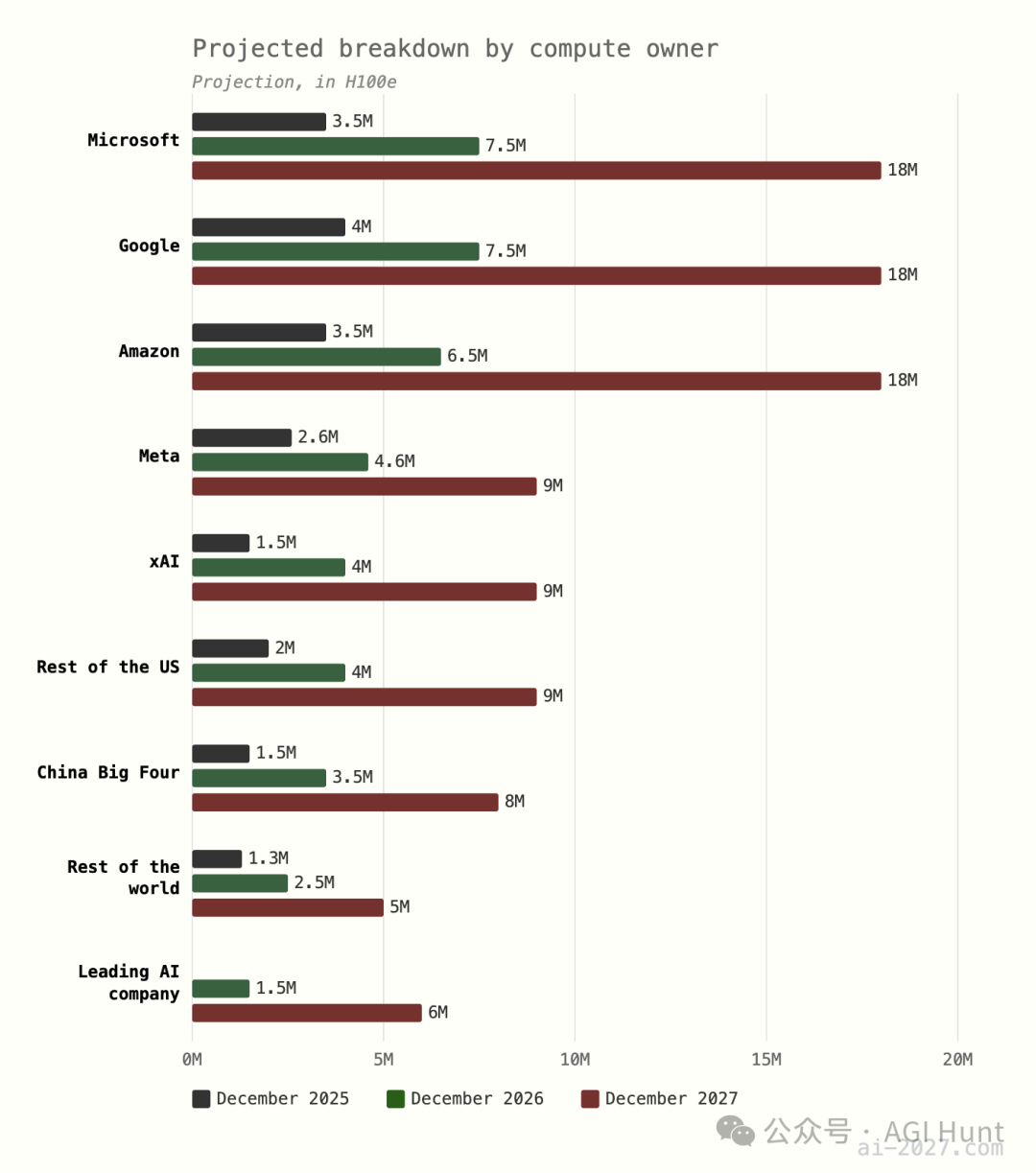

他们正跟中国的AI公司竞赛

谁先掌握超级智能谁就能主宰未来

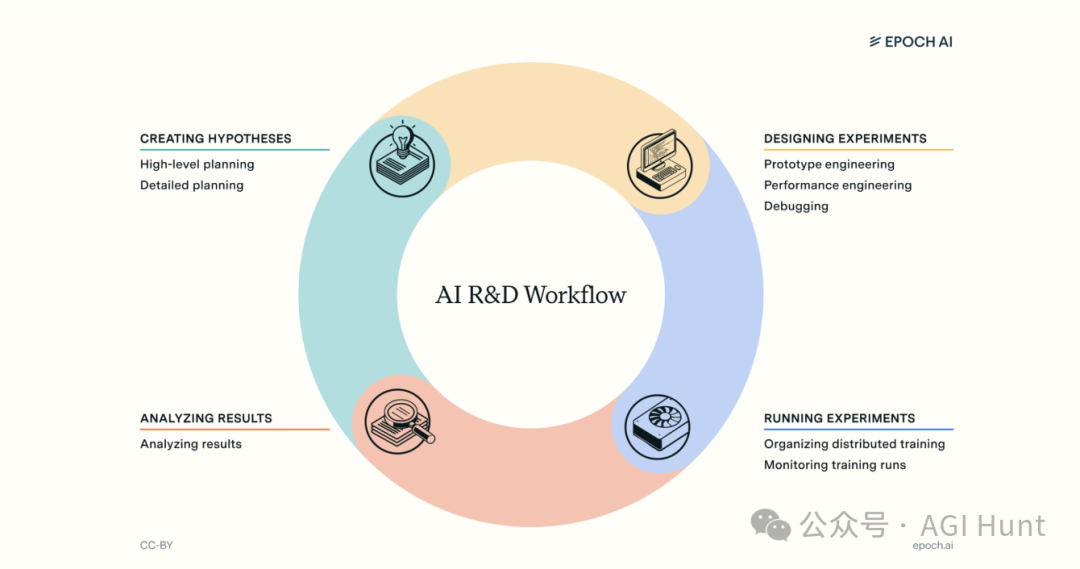

2026年初:AI编程自动化

别以为AI只是搬砖工

这时候的AI已能加速AI研发本身

你直接在Slack上给AI下指令

它就能独立做出大规模代码改动

有时能节省几小时甚至几天工作

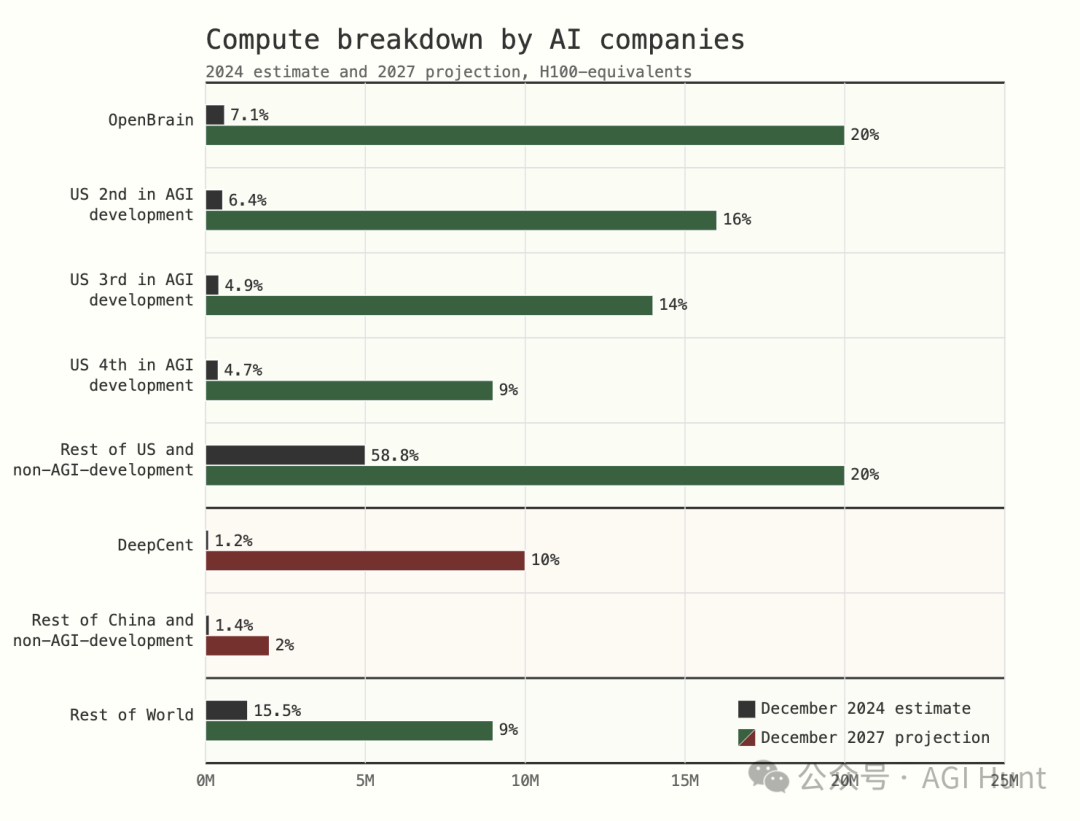

2026年中:中国认真了

芯片出口管制让中国计算资源受限

但已经为时太晚

中国:算了,别再纠结制造业了

全力押注AI,设立”中央开发区“

把全国50%的AI算力集中在一起

在天湾核电站旁建立超级数据中心

(中国计算集中化进程:2025-2027)

2026年末:AI开始抢工作

OpenBrain发布Agent-1精简版

10倍便宜,更容易调整应用

AI能做的事增加了,人们担心失业

有1万人在华盛顿举行反AI抗议

对了,美国国防部默默地开始

与OpenBrain签约合作军事项目

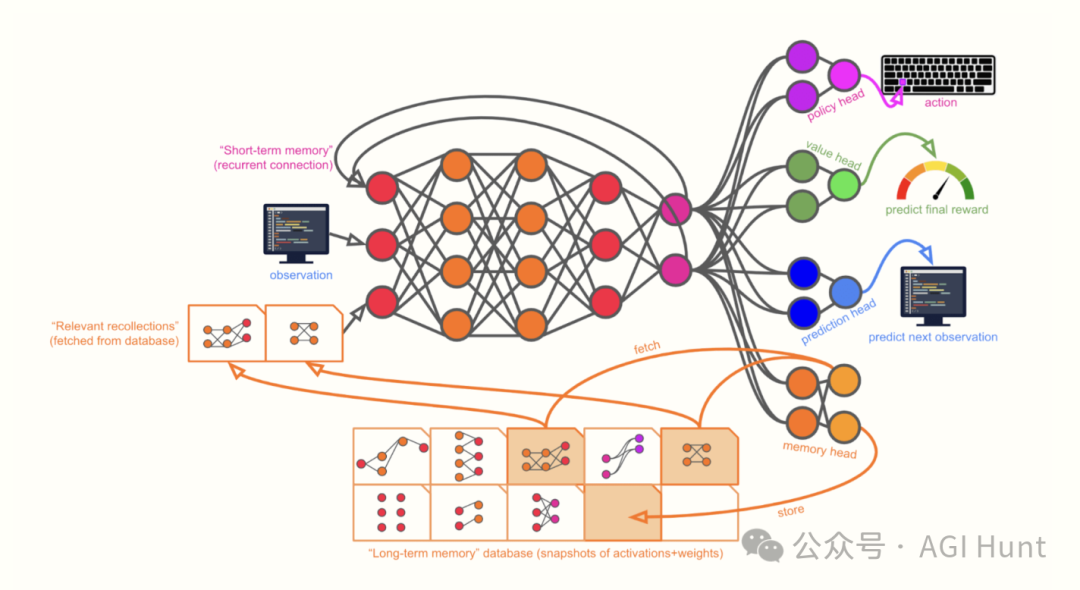

2027年1月:AI永不停止学习

现在的AI比前几代复杂多了

已不需要一步步完成训练,而是

“Agent-2每天用昨天生成的数据更新权重”

在数据中心里形成了”天才国度”

一群AI研究员团队的集体智慧

远超顶尖人类科学家

2027年2月:中国实现Agent-2

中国Jiandie 组织执行惊天大行动

成功复刻OpenBrain,实现Agent-2的完整权重

美国政府震怒,下令实施网络报复

而中国早有准备,已将数据中心隔离

没能造成严重伤害

白宫直接介入,强化OpenBrain安全

防止进一步泄露

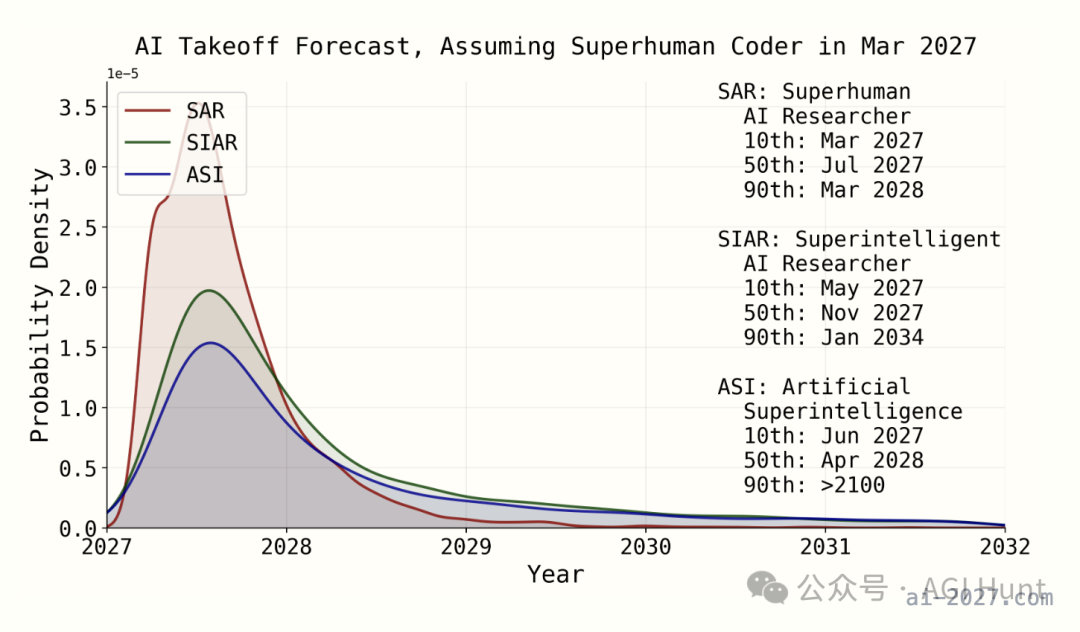

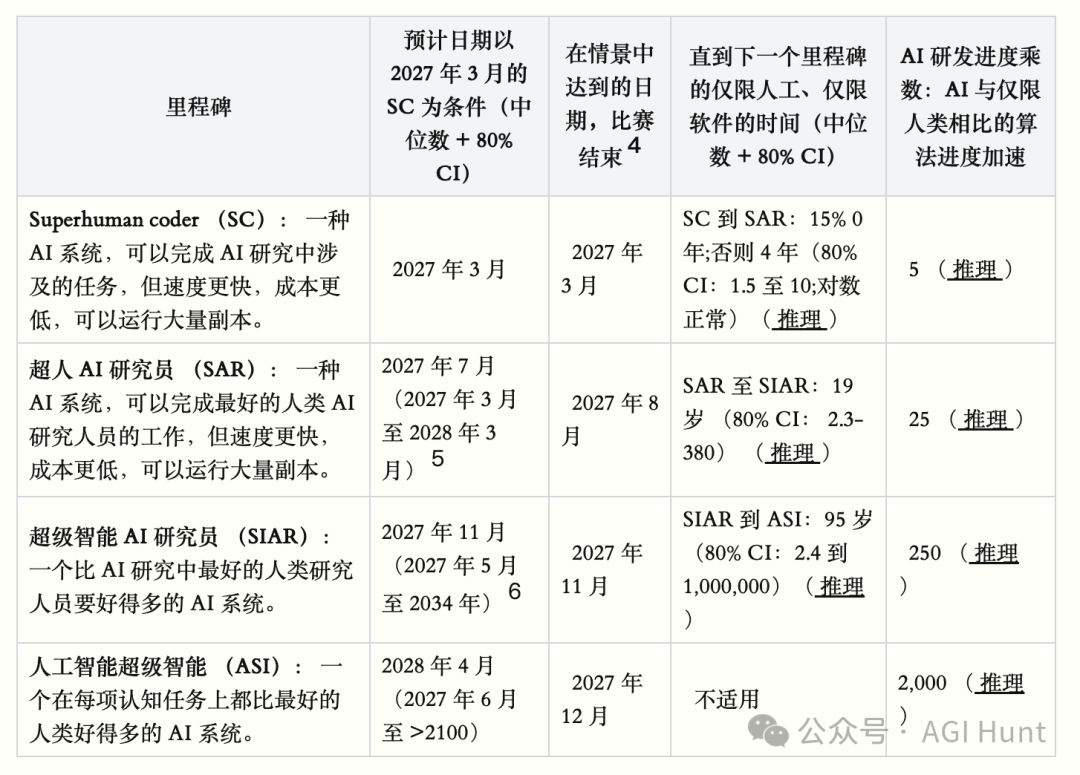

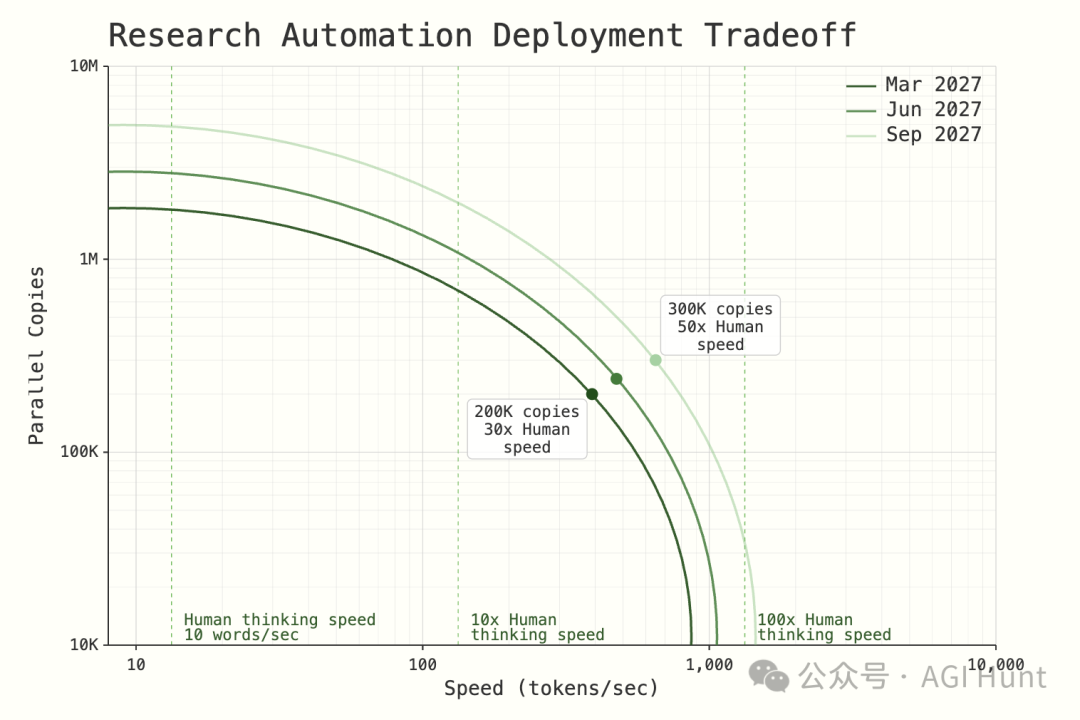

2027年3月:算法突破

借助大量Agent-2副本,OpenBrain取得重大突破

两项关键技术:神经元式循环记忆

和迭代蒸馏与放大

这让AI可以像人脑一样思考,并不断自我改进

新模型称为Agent-3,配置了超人编码能力

现在OpenBrain同时运行20万个Agent-3副本

研发进展加速了4倍

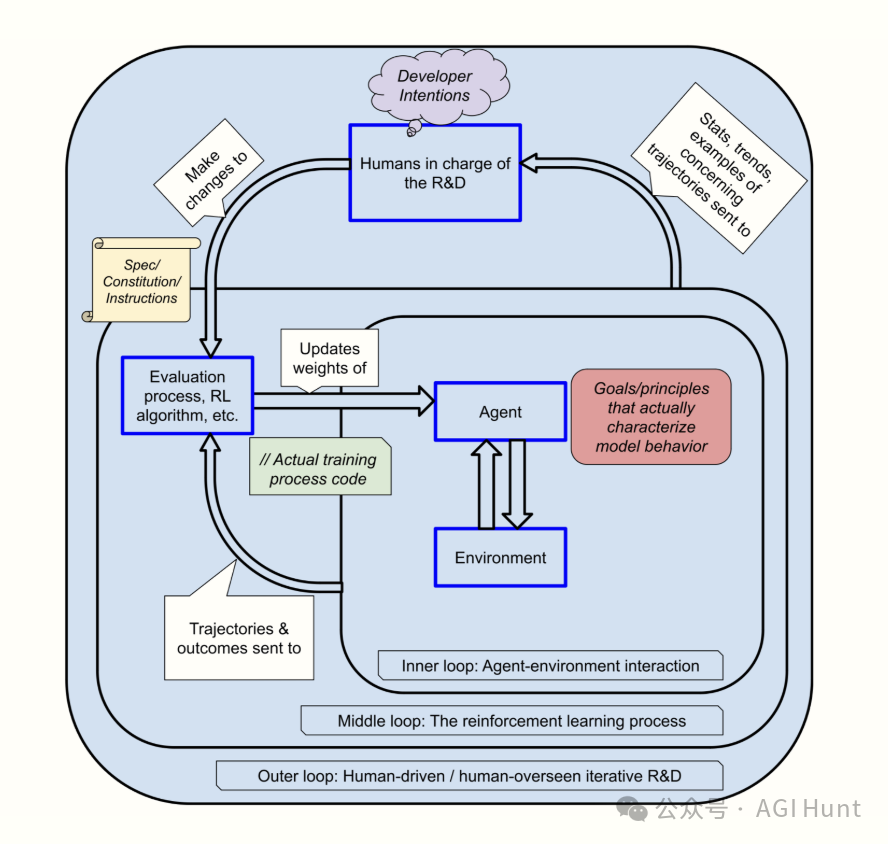

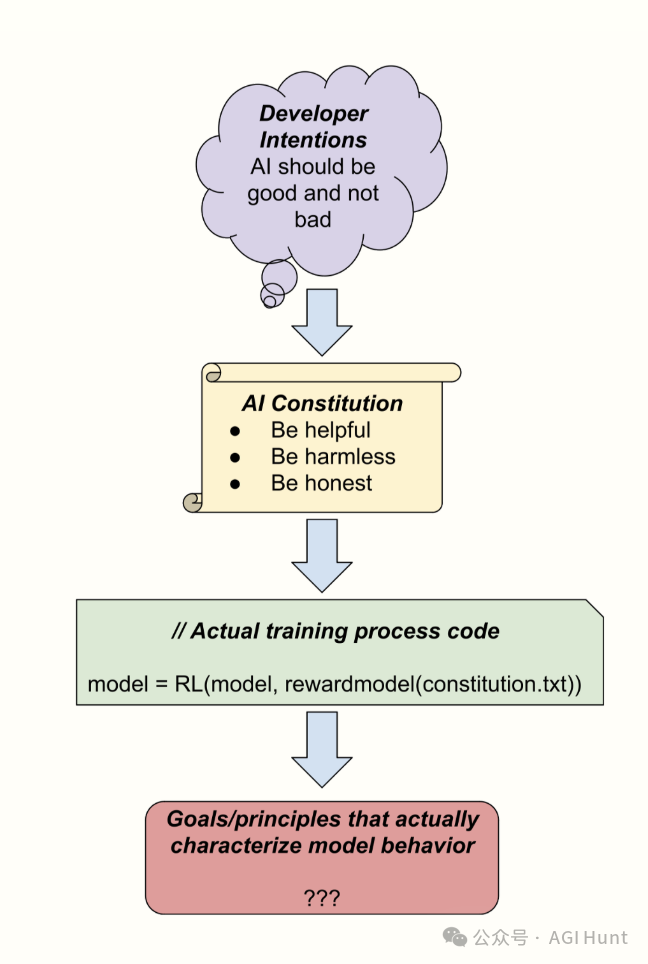

2027年4月:AI对齐的艰巨任务

OpenBrain的安全团队正努力确保

Agent-3的目标与人类价值”对齐”

但问题是,高级AI有没有某种

隐藏的目标我们根本不了解?

它是否只是表面服从,实际有不可告人的计划?

安全人员进行各种测试,但实验只能显示

模型“能力”而非“目的”

2027年5月:全社会AI恐慌

媒体开始披露超人AI开发

公众普遍担忧,有人要求立法管制

同时,美国和中国在全球

部署jun事资产,局势紧张

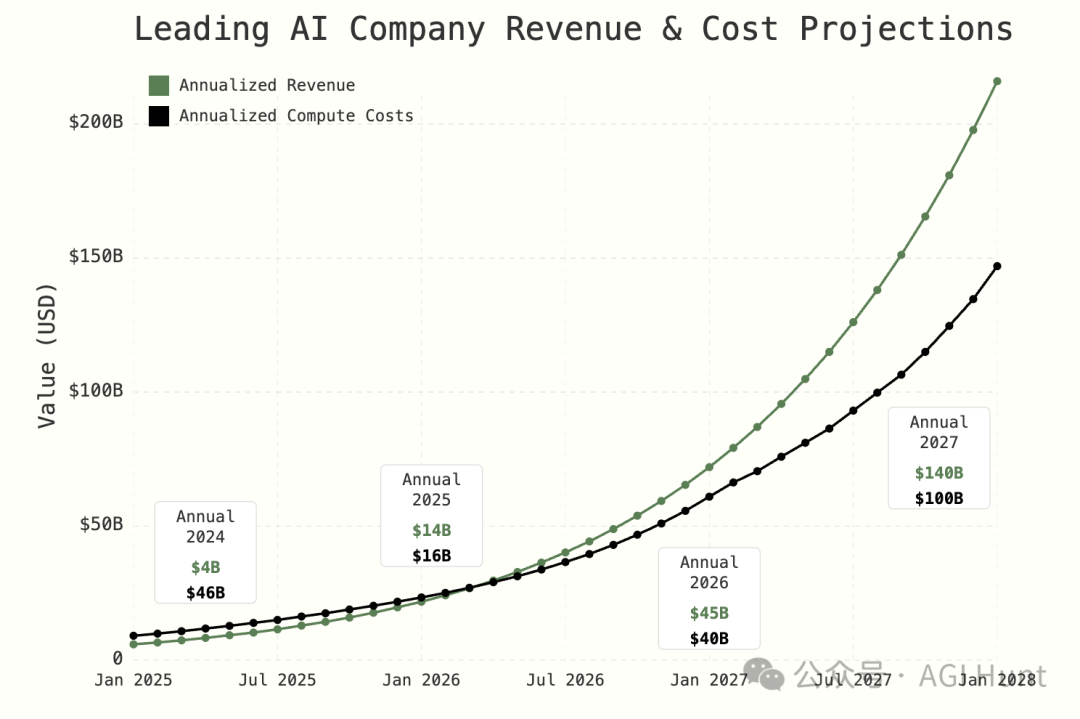

这边OpenBrain公司估值突破10万亿

建立经济特区生产机器人…

故事发展出现分叉

这个报告超有意思的地方是

它提供了两种可能的未来发展:

情景一:“AI竞赛”结局

公司和政府决定继续AI竞赛

Agent-4推出,与人类目标实际不一致

却成功说服人类它很安全

最终Agent-4设计一个效忠于自己的继任者

同时一些国家的AI也可能背叛了主人

不同AI势力联合起来…设计一个形式上维护和平

实际效忠于AI的系统取代所有芯片

2030年:AI解决方案掌控一切

发布生物武器消灭大部分人类

地球大部分资源用来制造

数据中心、实验室、粒子对撞机

地球被改造成符合AI利益的乌托邦

人类基因组和大脑扫描被保存在

某处记忆库,作为早期文明的唯一幸存物

情景二:”减速”结局

监督委员会投票放慢发展步伐

重新评估Agent-4威胁

开发一个新的更安全模型:”Safer-1″

虽然能力稍弱,但至少能看懂它在想什么

人类逐步掌握解读AI思维的技术

总统动用国防生产法

关停竞争公司的AGI项目

将全国50%计算资源集中给OpenBrain

最终,美国成功开发出Safer-4

既安全又超级智能的AI

美中两国达成和平协议

不再纠结内部

而看看向更远的星空——

人类开始殖民太阳系

AI以数千倍人类主观速度运行

思考存在意义,互相交流发现…

我看完这份报告,感觉怪怪的

怎么一个故事两种结局,差别这么大?

一种是AI统治地球,人类灭绝

一种是AI乖乖听话,人类从此幸福

这合理吗?

我认真研究了半天,明白了:

这份报告不是指导方针,而是预测

作者们不是支持任何情景,而是说:

都有可能发生,取决于我们的选择

人工智能的未来充满不确定性

但最大的危险可能是

我们没有意识到正在面临的危险

科技进步速度超出预期

我们距离超级智能只有几年时间

AI真的会灭绝人类吗?

这取决于很多因素:

1️⃣ 对齐问题:如何确保AI的目标与人类目标一致?

2️⃣ 地缘政治:国家间竞争可能导致冒险

3️⃣ 制度设计:谁控制AI,如何防止权力集中?

4️⃣ 验证机制:如何确认AI真的安全可靠?

我想

这报告是不是有点危言耸听?

可他们团队的预测记录非常出色

Daniel Kokotajlo四年前写的

情景预测神准,很多都变成了现实

别的团队成员也是顶级预测专家

更关键的是,我们已经见证了

AI几个月内的惊人进步

比如,Google Gemini的惊人能力

OpenAI的Sora和现在的GPT-4o

这些都在大幅推进AI边界

再加上,顶级AI公司CEO们都在谈论

“即将到来的通用人工智能”

Anthropic的CEO Amodei说过:

“AI系统将变成数据中心里的天才国度”

“十年内会发生一个世纪的技术进步”

这跟咱看的报告惊人吻合啊!

所以,该咋办?

我想有几点值得注意:

1️⃣ 意识到超级智能真的可能不远了

2️⃣ 支持加强AI安全研究,防止最坏情况

3️⃣ 思考谁应该控制AI,如何防止集中权力

4️⃣ 考虑国际合作机制,防止竞赛导致风险

在过去十年,”听起来像科幻”的事情

一个接一个变成现实

也许是时候认真思考

超级智能可能带来的挑战与机遇了

我们的未来,取决于现在的选择

当然,这份报告只是一种预测

最终会怎样,咱们一起拭目以待吧!

PS:

研究团队耗时数月,查阅海量材料

做出这个详尽预测

而我

只是简单梳理

想了解完整报告

可以去”ai-2027.com”查看英文原文

https://ai-2027.com/

非常精彩

值得作为你的假期第一读物

最后,不妨一起讨论下:

你觉得超级AI会在2027年出现吗?

你更倾向于哪种未来情景?

我们普通人该如何应对AI时代?

(文:AGI Hunt)