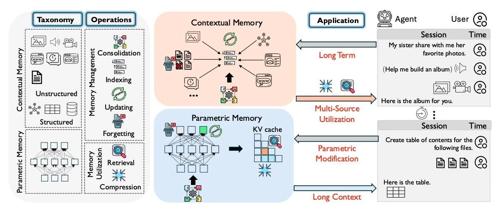

详细介绍了AI系统中记忆的分类体系,将记忆分为三种主要类型:参数化记忆(Parametric Memory)、上下文结构化记忆(Contextual Structured Memory)和上下文非结构化记忆(Contextual Unstructured Memory)。以下是该部分的内容总结:

1.1 参数化记忆

-

定义:参数化记忆是指模型内部参数中隐式存储的知识。这些知识在预训练或后训练过程中获得,并在推理时通过前馈计算访问。

-

特点:

-

提供即时、长期且持久的记忆,能够快速检索事实和常识知识。

-

缺乏透明性,难以根据新体验或特定任务上下文选择性地更新。

-

应用场景:适用于需要快速访问固定知识的场景,例如问答系统和常识推理任务。

1.2 上下文非结构化记忆

-

定义:上下文非结构化记忆是一种显式的、模态通用的记忆系统,用于存储和检索跨异构输入(如文本、图像、音频、视频)的信息。

-

特点:

-

支持基于感知信号的推理,能够整合多模态上下文。

-

根据时间范围,进一步分为短期记忆(如当前对话会话上下文)和长期记忆(如跨会话对话记录和个人持久知识)。

-

应用场景:适用于需要处理多模态输入和动态上下文的任务,例如多模态对话系统和视觉问答系统。

1.3 上下文结构化记忆

-

定义:上下文结构化记忆是指以预定义的、可解释的格式或模式(如知识图谱、关系表、本体论)组织的显式记忆,这些记忆可以根据请求进行查询。

-

特点:

-

支持符号推理和精确查询,通常与预训练语言模型的关联能力相辅相成。

-

可以是短期的(在推理时构建用于局部推理)或长期的(跨会话存储策划知识)。

-

应用场景:适用于需要精确知识检索和推理的任务,例如知识图谱问答和复杂事件推理任务。

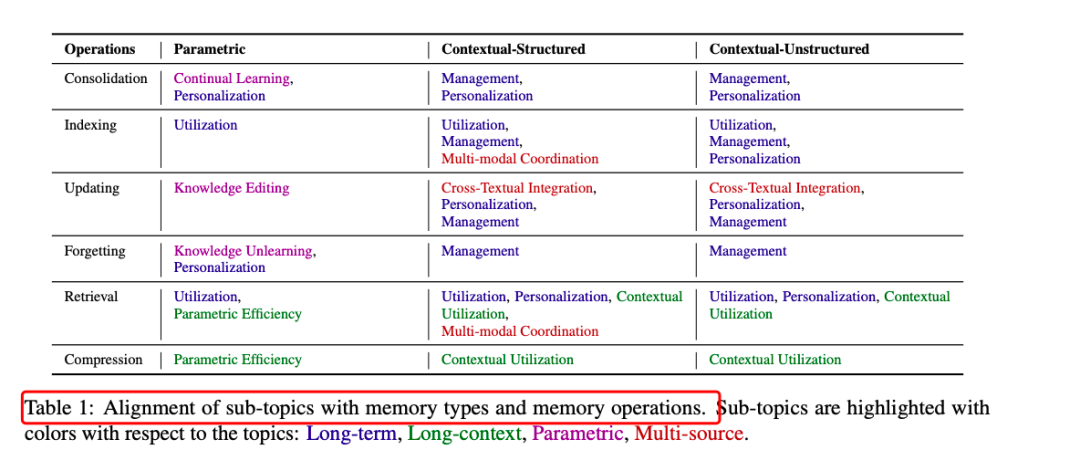

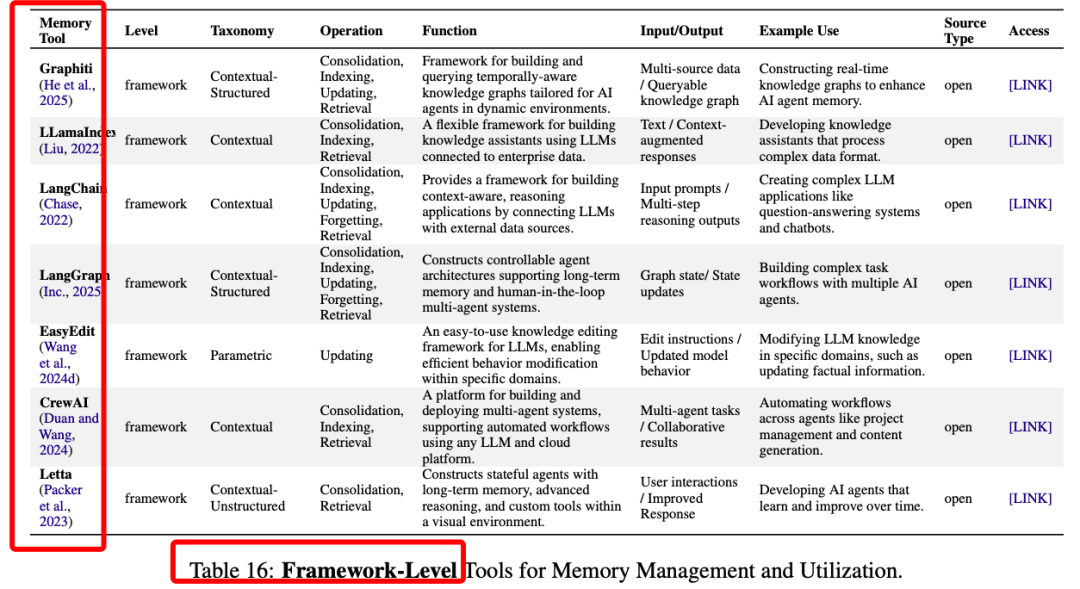

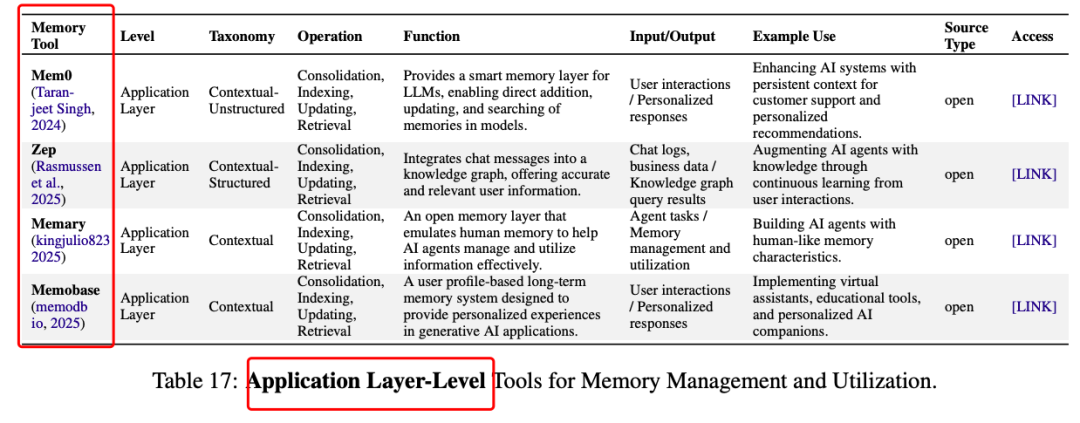

详细介绍了AI系统中记忆操作的分类和功能。这些操作被分为两大类:记忆管理(Memory Management)和记忆利用(Memory Utilization)。

2.1 记忆管理

记忆管理涉及如何存储、维护和修剪记忆,以支持记忆在与外部环境交互过程中的有效使用。记忆管理包括以下四种核心操作:

-

Consolidation(巩固):

-

定义:将短期经验转化为持久记忆,例如将对话历史编码为模型参数、知识图谱或知识库。

-

功能:支持持续学习、个性化、外部记忆库构建和知识图谱构建。

-

应用场景:在多轮对话系统中,将对话历史整合到持久记忆中,以便在未来的对话中使用。

-

Indexing(索引):

-

定义:构建辅助代码(如实体、属性或基于内容的表示),以便高效检索存储的记忆。

-

功能:支持可扩展的检索,包括符号、神经和混合记忆系统。

-

应用场景:在大规模记忆库中,通过索引快速定位和检索相关信息。

-

Updating(更新):

-

定义:重新激活现有记忆表示并对其进行临时修改。

-

功能:支持持续适应,同时保持记忆一致性。例如,通过定位和编辑机制修改模型参数,或通过总结、修剪或精炼来更新上下文记忆。

-

应用场景:在对话系统中,根据用户反馈动态更新记忆内容。

-

Forgetting(遗忘):

-

定义:有选择性地抑制可能过时、无关或有害的记忆内容。

-

功能:通过遗忘技术(如修改模型参数以擦除特定知识)或基于时间的删除和语义过滤来丢弃不再相关的内容。

-

应用场景:在处理敏感信息时,确保隐私和安全,同时减少记忆干扰。

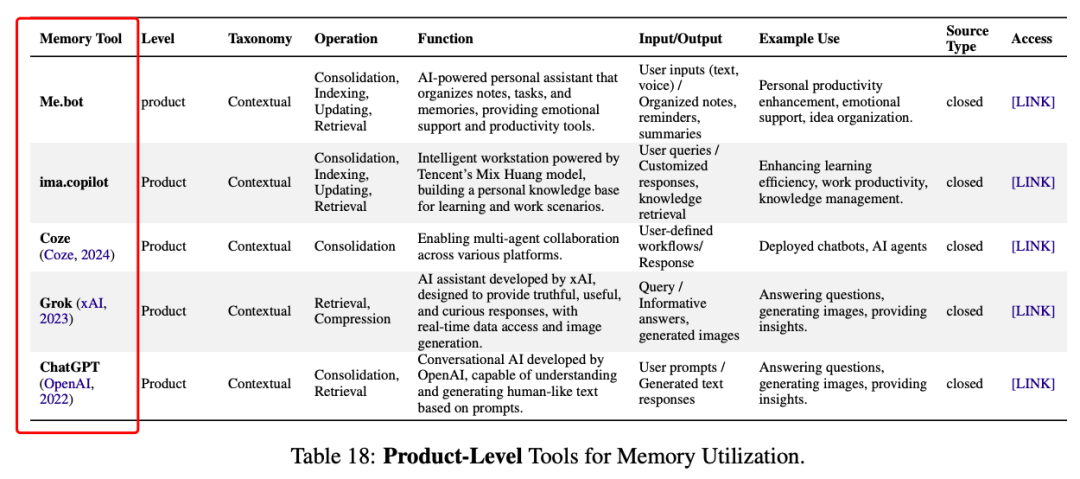

2.2 记忆利用

记忆利用涉及在推理过程中检索和使用存储的记忆,以支持下游任务(如响应生成、视觉定位或意图预测)。记忆利用包括以下两种操作:

-

Retrieval(检索):

-

定义:根据输入识别并访问相关记忆内容。

-

功能:支持从多个来源(如多模态输入、跨会话记忆)检索信息。

-

应用场景:在问答系统中,根据问题检索相关的知识库内容;在多轮对话中,检索与当前对话相关的上下文信息。

-

Compression(压缩):

-

定义:在保持关键信息的同时减少记忆大小,以便在有限的上下文窗口中高效使用。

-

功能:通过预输入压缩(如对长上下文输入进行评分、过滤或总结)或后检索压缩(如在模型推理前对检索到的内容进行压缩)来优化上下文使用。

-

应用场景:在处理长文本输入时,通过压缩减少计算负担,同时保留关键信息。

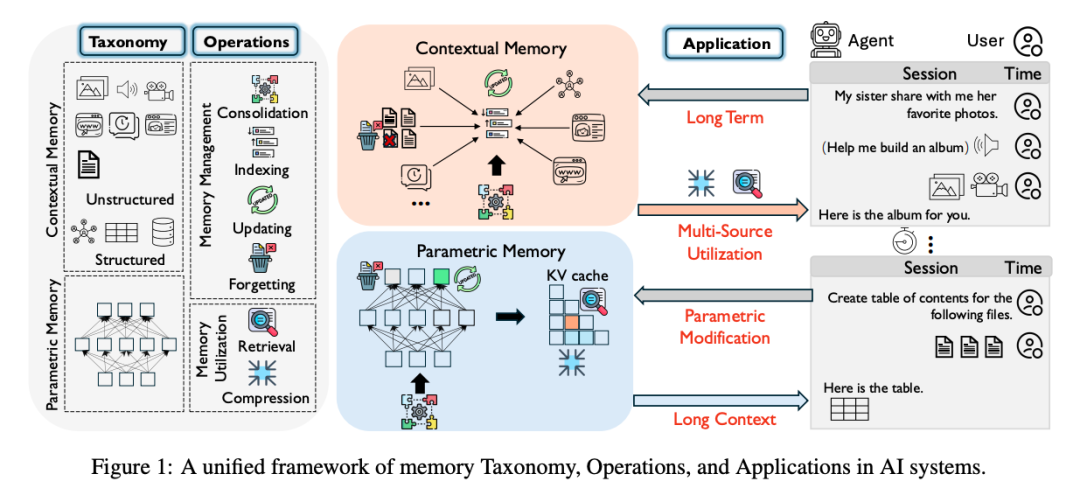

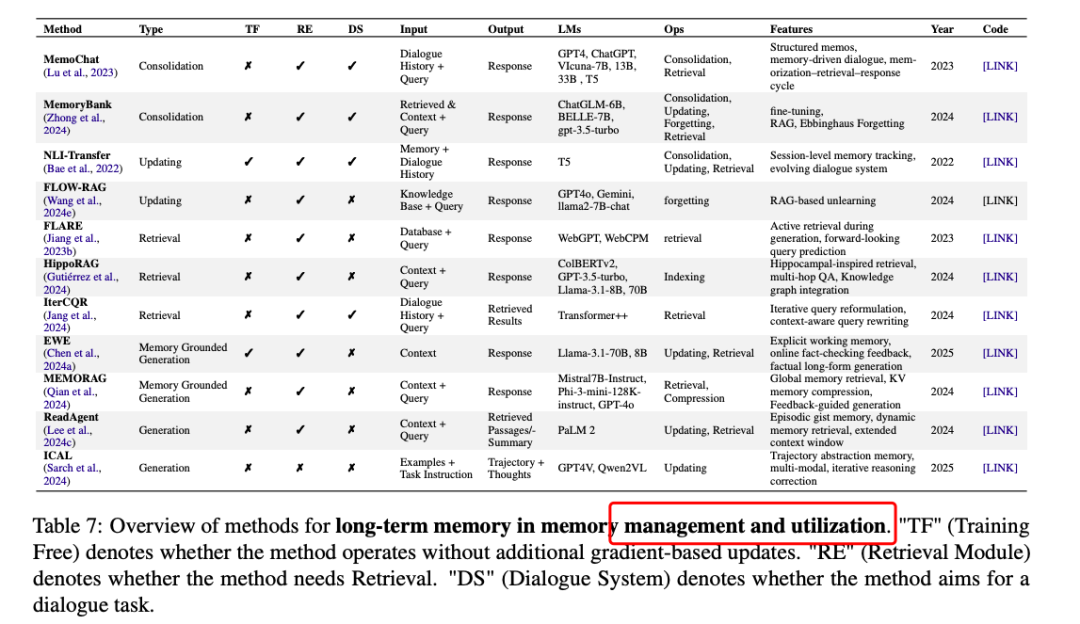

探讨了如何将前面介绍的记忆操作(巩固、索引、更新、遗忘、检索、压缩)应用于实际的系统级研究主题。这些主题涵盖了长期记忆、长上下文记忆、参数化记忆修改和多源记忆等多个方面。

3.1 长期记忆

长期记忆是指通过与环境的交互而持久存储的信息,支持跨会话的复杂任务和个性化交互。

-

管理(Management):

-

巩固(Consolidation):将短期记忆转化为长期记忆,例如通过对话历史的总结或编码。

-

索引(Indexing):构建记忆索引以支持高效检索,例如通过知识图谱或时间线索引。

-

更新(Updating):根据新信息更新长期记忆,例如通过对话历史的动态编辑。

-

遗忘(Forgetting):有选择性地移除过时或不相关的记忆,例如通过时间衰减或用户反馈。

-

利用(Utilization):

-

检索(Retrieval):根据当前输入和上下文检索相关记忆,例如通过多跳图检索或基于事件的检索。

-

整合(Integration):将检索到的记忆与模型上下文结合,支持连贯的推理和决策。

-

生成(Generation):基于整合的记忆生成响应,例如通过多跳推理或反馈引导的生成。

-

个性化(Personalization):

-

模型级适应(Model-Level Adaptation):通过微调或轻量级更新将用户偏好编码到模型参数中。

-

记忆级增强(Memory-Level Augmentation):在推理时从外部记忆中检索用户特定信息以增强个性化。

3.2 长上下文记忆

长上下文记忆涉及处理和利用大量的上下文信息,以支持长文本理解和生成。

-

参数化效率(Parametric Efficiency):

-

KV缓存丢弃(KV Cache Dropping):通过静态或动态方式丢弃不必要的KV缓存,以减少内存需求。

-

KV缓存存储优化(KV Cache Storing Optimization):通过量化或低秩表示压缩KV缓存,以减少内存占用。

-

KV缓存选择(KV Cache Selection):通过查询感知的方式选择性加载KV缓存,以加速推理。

-

上下文利用(Contextual Utilization):

-

上下文检索(Context Retrieval):通过图结构或片段级选择方法,从大量上下文中检索关键信息。

-

上下文压缩(Context Compression):通过软提示压缩或硬提示压缩,减少上下文长度,提高推理效率。

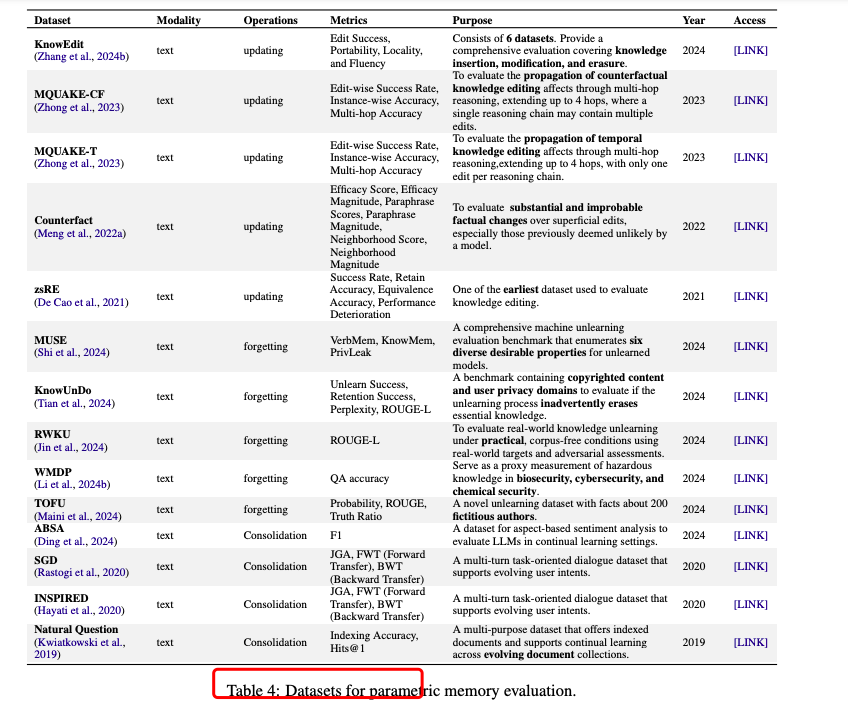

3.3 参数化记忆修改

参数化记忆修改涉及对模型内部参数的动态调整,以适应新的知识或任务需求。

-

编辑(Editing):

-

定位-编辑方法(Locating-then-Editing):通过归因或追踪找到存储知识的位置,然后直接修改。

-

元学习(Meta Learning):通过编辑网络预测目标权重变化,实现快速和稳健的修正。

-

提示方法(Prompt-based Methods):通过精心设计的提示间接引导输出。

-

附加参数方法(Additional-parameter Methods):通过添加外部参数模块调整行为,而不修改模型权重。

-

遗忘(Unlearning):

-

定位-遗忘方法(Locating-then-Unlearning):找到负责特定记忆的参数,然后应用目标更新或禁用。

-

训练目标方法(Training Objective-based Methods):通过修改训练损失函数或优化策略,显式鼓励遗忘。

-

持续学习(Continual Learning):

-

正则化方法(Regularization-based Methods):通过约束重要权重的更新,保留关键参数记忆。

-

重放方法(Replay-based Methods):通过重新引入过去样本强化记忆,特别适合在训练中整合检索到的外部知识。

3.4 多源记忆

多源记忆涉及整合来自不同来源(如文本、知识图谱、多模态输入)的信息,以支持更丰富的推理和决策。

-

跨文本整合(Cross-textual Integration):

-

推理(Reasoning):整合多格式记忆以生成一致的响应,例如通过动态整合领域特定的参数化记忆。

-

冲突解决(Conflict Resolution):识别和处理来自不同记忆源的矛盾信息,例如通过信任校准和来源归因。

-

多模态协调(Multi-modal Coordination):

-

融合(Fusion):对齐跨模态信息,例如通过统一语义投影或长期跨模态记忆整合。

-

检索(Retrieval):跨模态检索存储的知识,例如通过基于嵌入的相似性计算。

https://arxiv.org/pdf/2505.00675Rethinking Memory in AI: Taxonomy, Operations, Topics, and Future Directionshttps://knowledge-representation.org/j.z.pan/

(文:PaperAgent)