今天是2025年6月9日,星期一,北京,晴

我们来看看几个有趣的工作,围绕多模态RAG、语法纠错、个人财务大模型大模型、AI Baby Monitor等,重点还是看实现流程以及对应的数据集。

可用的模型很多,核心还是怎么传起来,做一些有意思且可用的场景。

一、大模型应用的集成

1、简单的多模态RAG实现流程

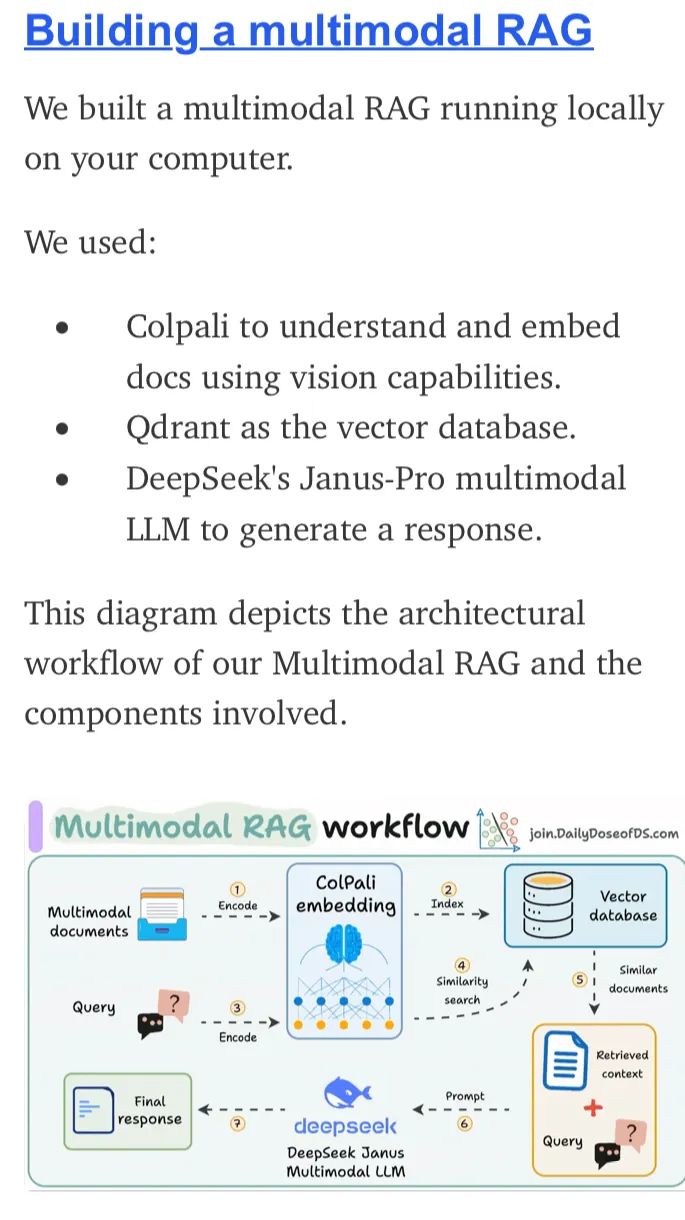

线来看张图,Building a multimodal RAG,构建本地多模态RAG。

核心包括两个。一个是如何将问题和图片进行嵌入表示,具有代表性的是copali系列;一个是如何进行解码生成,既然来到了多模态RAG,那么常用的解码器就会变成多模态大模型,例如DeepSeek’s Janus-Pro multimodal LLM,或者Qwen-VL等系列。

2、AI Baby Monitor

来看一个很有趣的应用工具,AI Baby Monitor(https://github.com/zeenolife/ai-baby-monitor),AI婴儿看护工具,会监控视频流(网络摄像头、RTSP摄像头等)以及简单的安全规则列表,例如,“婴儿不应该爬出婴儿床”,“婴儿应该始终由大人陪伴”。

如果违反了设定的规则,会发出一声哔哔声,方便快速查看宝宝的情况。

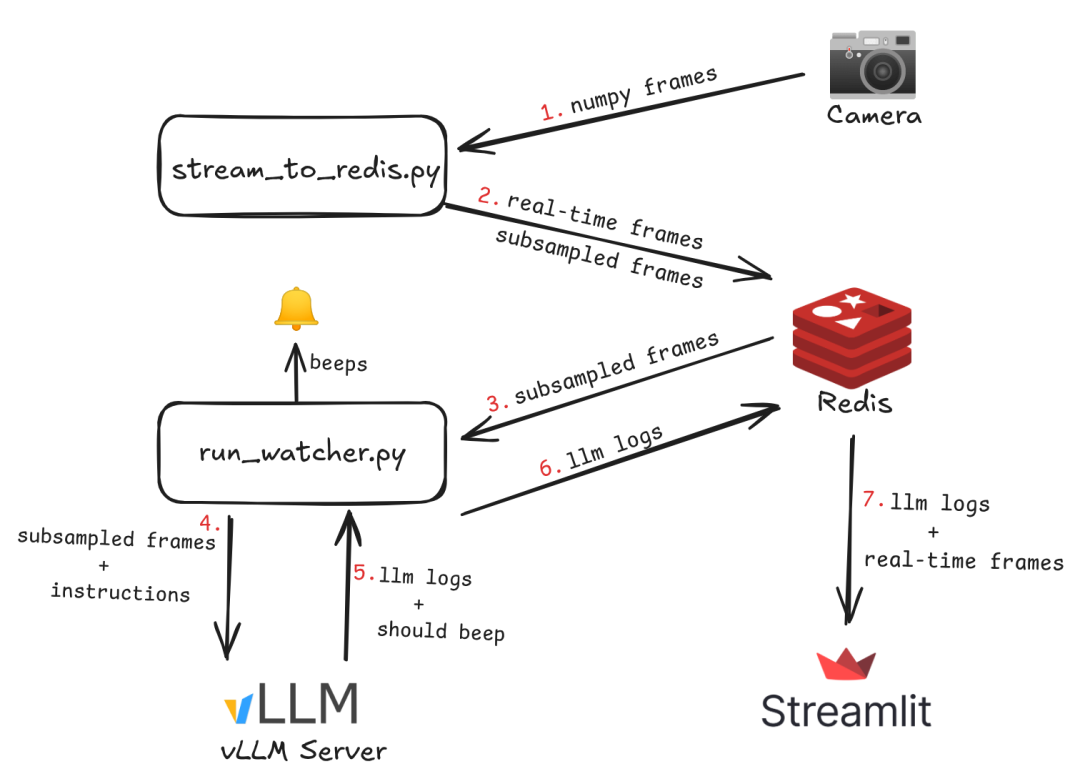

其中,工作流也很简单:

stream_to_redis.py捕获帧并将其推送到Redis(短实时和长子采样帧队列);

run_watcher.py拉取最新的N帧,将指令和帧编码为提示并将它们发送到本地vLLM服务器,接收结构化JSON,写入日志并在收到时发出哔声should_alert=True;

Streamlit实时更新最新的帧+llm日志。

二、特定任务的微调大模型

1、用于语法纠错的微调模型

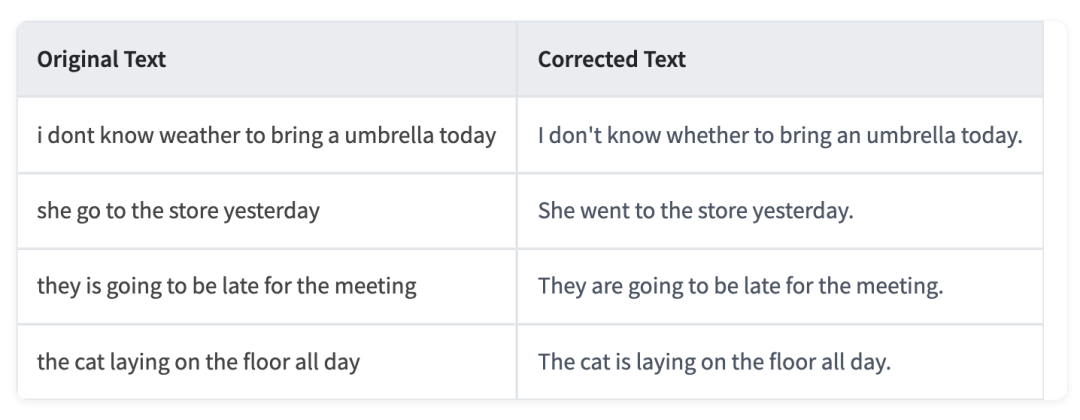

GRMR-V3-Q1.7B(https://huggingface.co/qingy2024/GRMR-V3-Q1.7B),是unsloth/Qwen3-1.7B-Base的微调版本。

实现上,基于语法校正示例数据集(GRMR-V4-60K数据集,https://huggingface.co/datasets/qingy2024/grmr-v4-60k)进行全参微调,旨在通过修复语法错误、标点符号、拼写和其他语言问题来帮助提升文本质量。

2、个人财务大模型

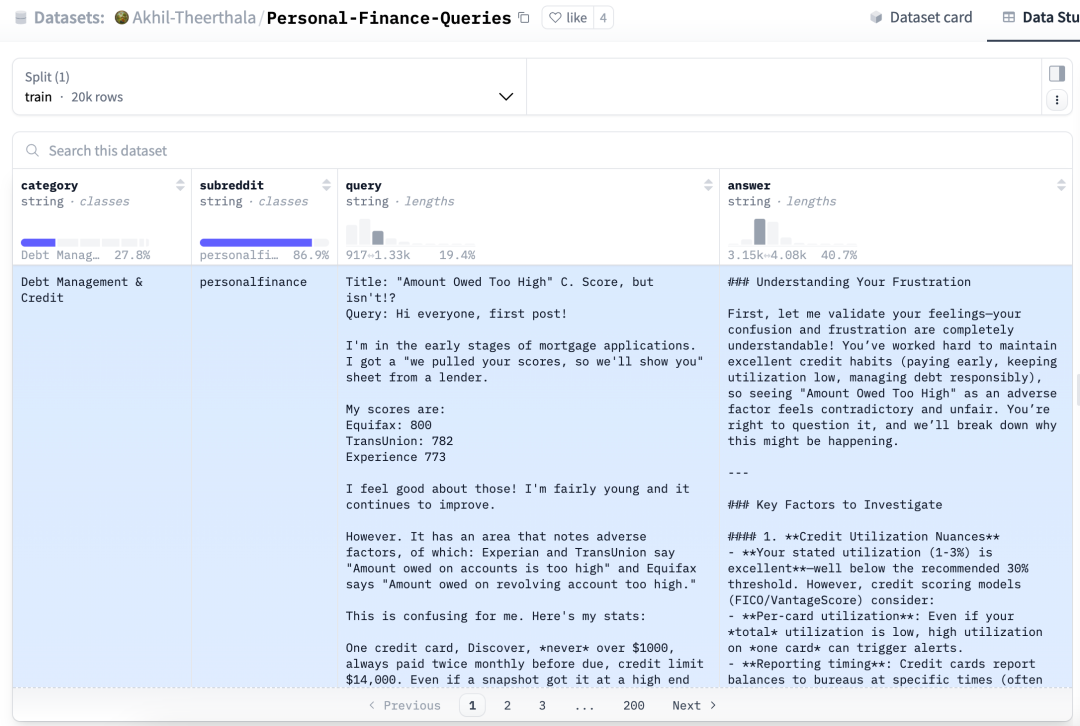

个人财务大模型Kuvera-8B-v0.1.0(https://huggingface.co/Akhil-Theerthala/Kuvera-8B-v0.1.0),目的在个人财务话题上提供富有同情心和实用的建议,包括预算、储蓄、投资、债务管理和基本财务规划等。

模型本身基于Qwen3-8B进行全量微调,训练数据采用Akhil-Theerthala/Personal-Finance-Queries(https://huggingface.co/datasets/Akhil-Theerthala/Personal-Finance-Queries),大约20,000个真实的Reddit查询。

(文:老刘说NLP)