随着虚拟现实(VR)和沉浸式娱乐技术的飞速发展,人们对真实感音频体验的需求日益增长。传统的音频生成技术往往只能提供单声道或立体声,缺乏对声音方向性的捕捉,难以满足沉浸式场景的需求。为此,阿里巴巴通义实验室推出了 OmniAudio 项目,旨在通过 360° 视频生成空间音频,为用户带来全新的沉浸式体验。

一、项目概述

OmniAudio 是阿里巴巴通义实验室语音团队推出的一种从 360° 视频生成空间音频(FOA)的技术。它通过构建大规模数据集 Sphere360 和创新的模型架构,能够直接从 360° 视频生成标准的 3D 空间音频格式 FOA,捕捉声音的方向性,实现真实的 3D 音频再现。OmniAudio 的训练分为自监督的 coarse-to-fine 流匹配预训练和基于双分支视频表示的有监督微调,显著提升了空间音频生成的性能和沉浸感。

二、技术原理

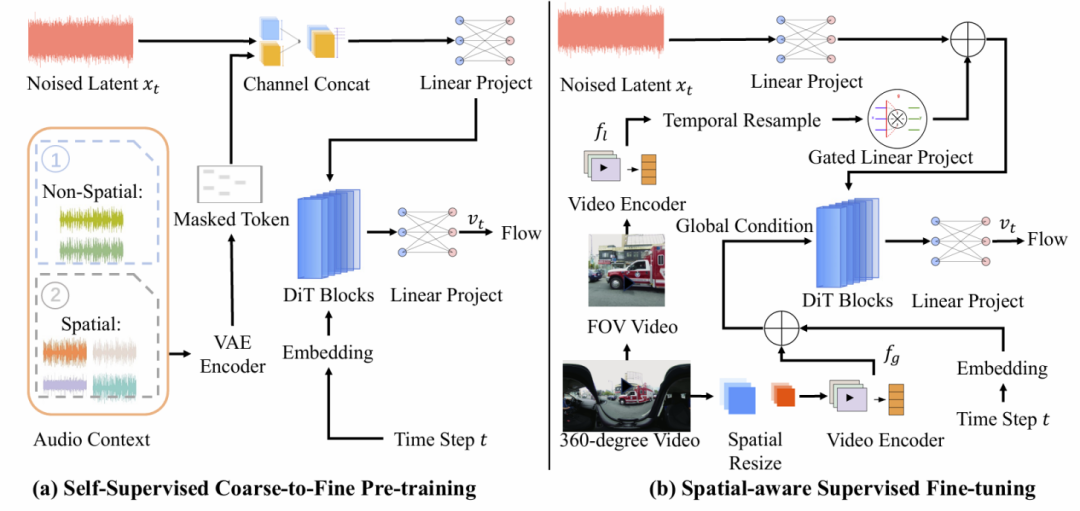

(一)自监督的 coarse-to-fine 流匹配预训练

由于真实 FOA 数据稀缺,OmniAudio 利用大规模非空间音频资源(如 FreeSound、AudioSet 等),将立体声转换为“伪 FOA”格式进行预训练。具体方法是将 W 通道设为左右声道之和,X 通道设为左右声道之差,Y 和 Z 通道置零。通过四通道 VAE 编码器获得潜在表示后,对潜在序列进行随机时间窗掩码,并将掩码后的潜在序列与完整序列一同作为条件输入至流匹配模型。模型通过最小化掩码前后潜在状态的速度场差异,实现对音频时序和结构的自监督学习。

(二)基于双分支视频表示的有监督微调

在微调阶段,OmniAudio 使用真实的 FOA 音频数据,结合双分支视频编码器。具体来说,使用冻结的 MetaCLIP-Huge 图像编码器提取 360° 全景视频的全局特征,并从同一视频中裁取局部视角(Field of View, FoV)以获取局部细节表征。全局特征经最大池化后作为 Transformer 的全局条件,局部特征经时间上采样后与音频潜在序列逐元素相加,作为逐步生成过程中的局部条件。通过这种方式,模型能够更好地捕捉全局和局部信息,提升空间音频的生成效果。

三、主要功能

(一)生成空间音频

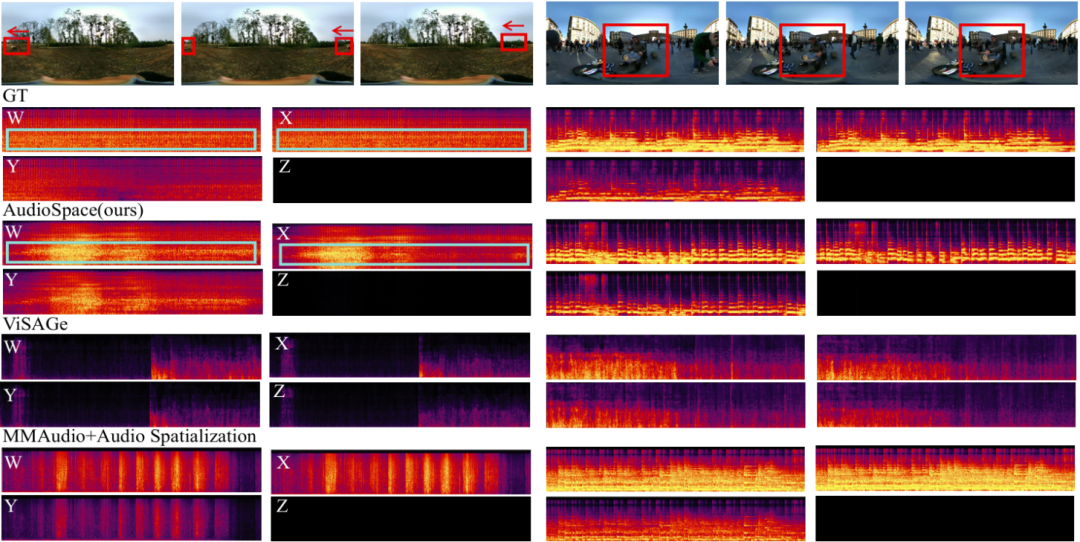

OmniAudio 能直接从 360° 视频生成 FOA 音频,这种音频格式通过四个通道(W、X、Y、Z)捕捉声音的方向性,其中 W 通道负责整体声压,X、Y、Z 通道分别捕捉前后、左右以及垂直方向的声音信息。即使在头部旋转时,也能保持声音定位的准确性,为用户提供真实的 3D 音频体验。

(二)提升沉浸式体验

OmniAudio 解决了传统视频到音频生成技术无法满足沉浸式体验对 3D 声音定位需求的问题。它能够为虚拟现实和沉浸式娱乐提供与视觉场景高度匹配的空间音频,增强用户的沉浸感。例如,在观看 360° 全景视频时,用户可以清晰地感受到声音从不同方向传来,仿佛置身于视频场景之中。

四、应用场景

(一)虚拟现实(VR)和沉浸式体验

OmniAudio 可以为 VR 内容生成与视觉场景高度匹配的空间音频,让用户在虚拟环境中获得更加真实的听觉体验。无论是在虚拟旅游中感受自然的声音,还是在虚拟游戏里体验逼真的战场音效,OmniAudio 都能够显著提升沉浸感。

(二)360° 视频配乐

对于 360° 全景视频创作者来说,OmniAudio 能够自动生成沉浸式音效,无需手动添加音频轨道。这不仅节省了创作时间,还能为观众带来更自然、更真实的听觉享受。

(三)智能语音助手

OmniAudio 可以集成到智能家居设备中,如智能音箱、智能家电等,实现语音控制和交互。通过空间音频技术,用户可以从不同角度与设备进行语音交互,设备能够更准确地识别声音来源,提升交互的自然性和便捷性。

(四)机器人和自动驾驶领域

OmniAudio 还可以应用于机器人和自动驾驶领域,为这些系统提供更准确的声音定位和环境感知能力。例如,在自动驾驶车辆中,OmniAudio 可以帮助车辆更准确地识别周围环境的声音,从而提高驾驶安全性。

五、快速使用

(一)环境准备

确保你已经安装了 Python >= 3.8.20,并运行以下命令来安装必要的依赖项:

pip install -r requirements.txtpip install git+https://github.com/patrick-kidger/torchcubicspline.git

(二)运行推理

运行推理之前,需要准备一个 360° 视频文件,并确保其格式为 equirectangular。然后运行以下命令:

bash demo.sh video_path cuda_id其中,`video_path` 是你的视频文件路径,`cuda_id` 是你的 GPU 设备 ID。如果需要使用自己的训练模型,可以通过修改 `demo.sh` 文件中的 `–ckpt-path` 参数来指定模型权重路径。

(三)体验效果

运行推理后,OmniAudio 将生成与输入 360° 视频匹配的空间音频文件。你可以使用支持 FOA 格式的播放器(如 Omnitone)来体验生成的音频效果。戴上耳机并拖动视频屏幕,感受声音从不同方向传来的沉浸式体验。

六、结语

OmniAudio 作为阿里巴巴通义实验室推出的空间音频生成模型,通过创新的技术原理和强大的功能,为虚拟现实和沉浸式娱乐领域带来了全新的音频体验。它不仅解决了传统音频生成技术的局限性,还为未来智能设备和自动驾驶等领域提供了广阔的应用前景。随着技术的不断发展和优化,OmniAudio 有望在更多场景中发挥重要作用,为用户带来更加真实和沉浸的音频体验。

七、项目地址

项目主页:https://omniaudio-360v2sa.github.io/

技术论文:https://arxiv.org/pdf/2504.14906

GitHub 仓库:https://github.com/liuhuadai/OmniAudio

(文:小兵的AI视界)