文章转载自「机器之心」。

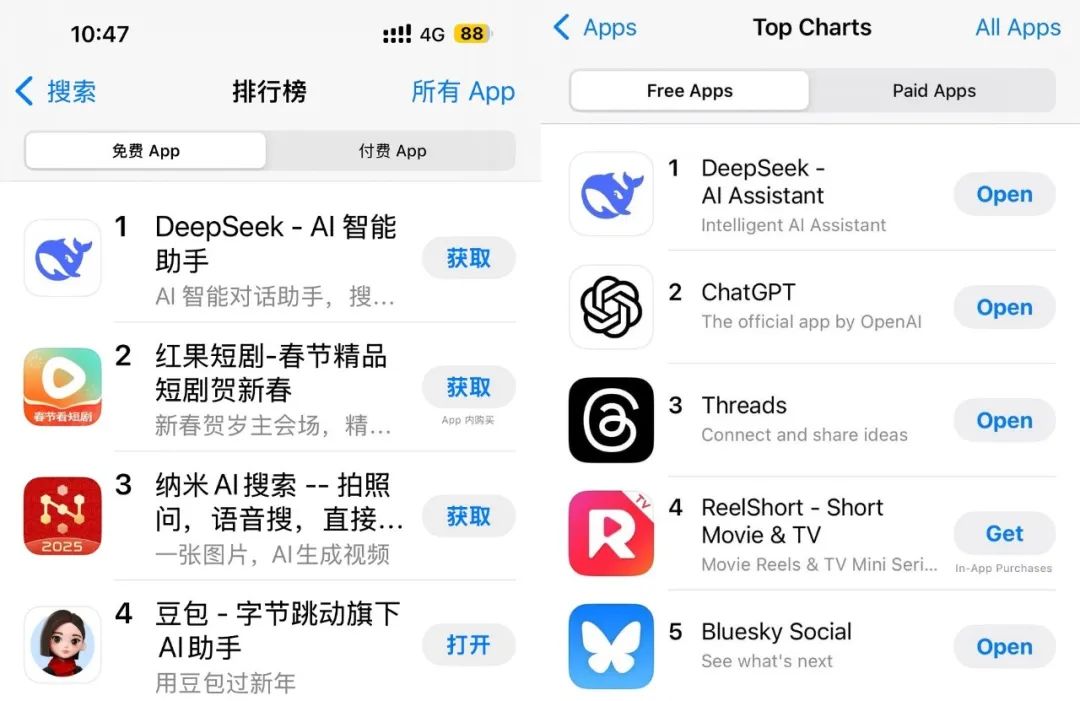

DeepSeek 20 日发布以来获得的热度至今依然没有任何消退的迹象。一觉醒来,DeepSeek 发布的 iOS 应用甚至超越了 ChatGPT 的官方应用,直接登顶 AppStore。

01

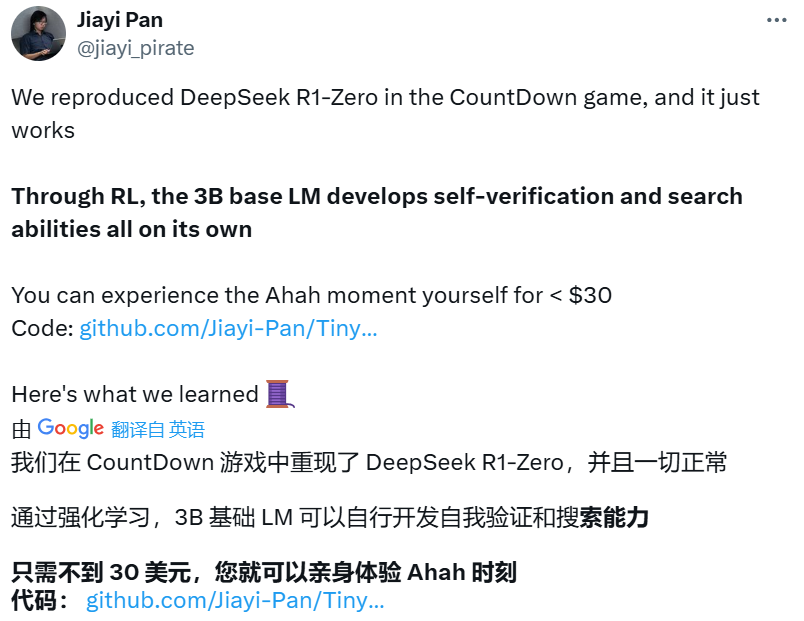

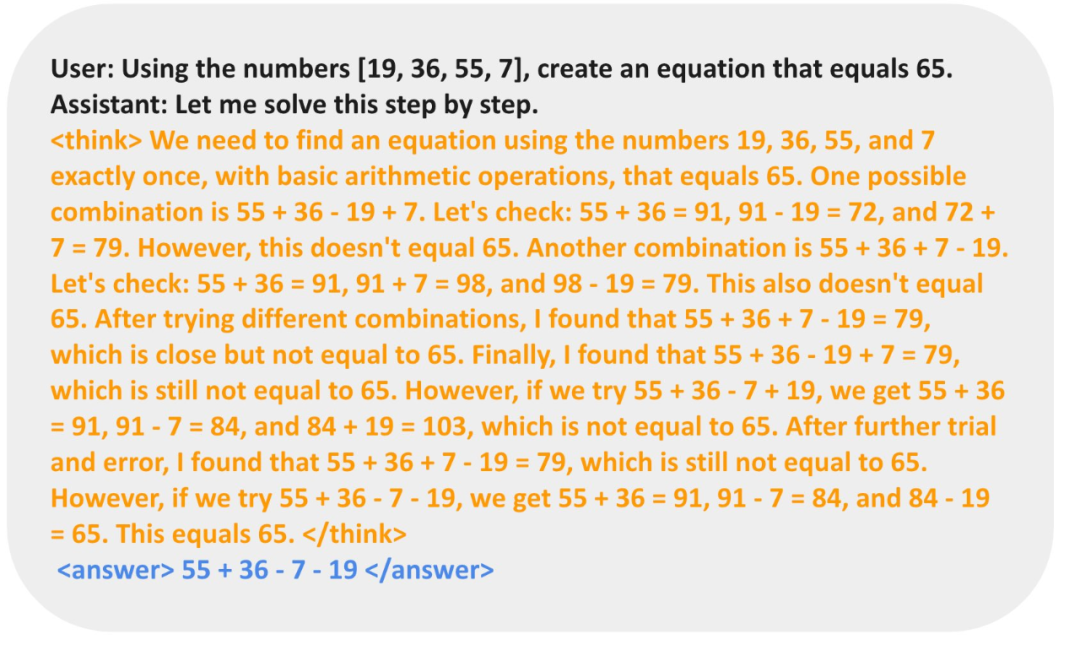

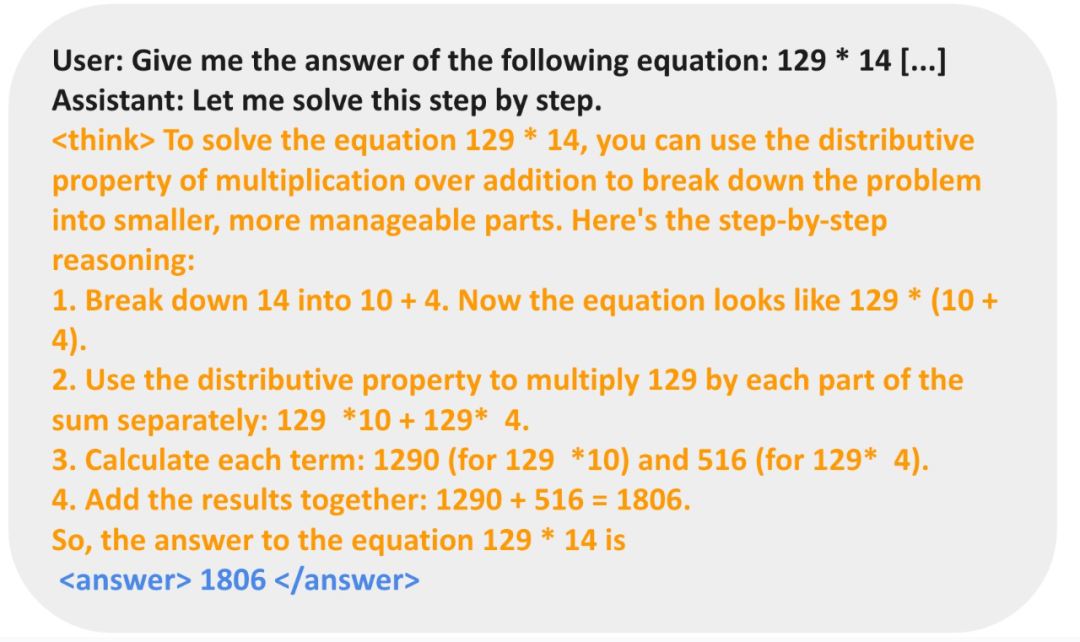

AI 社区开启 R1 复现热潮

-

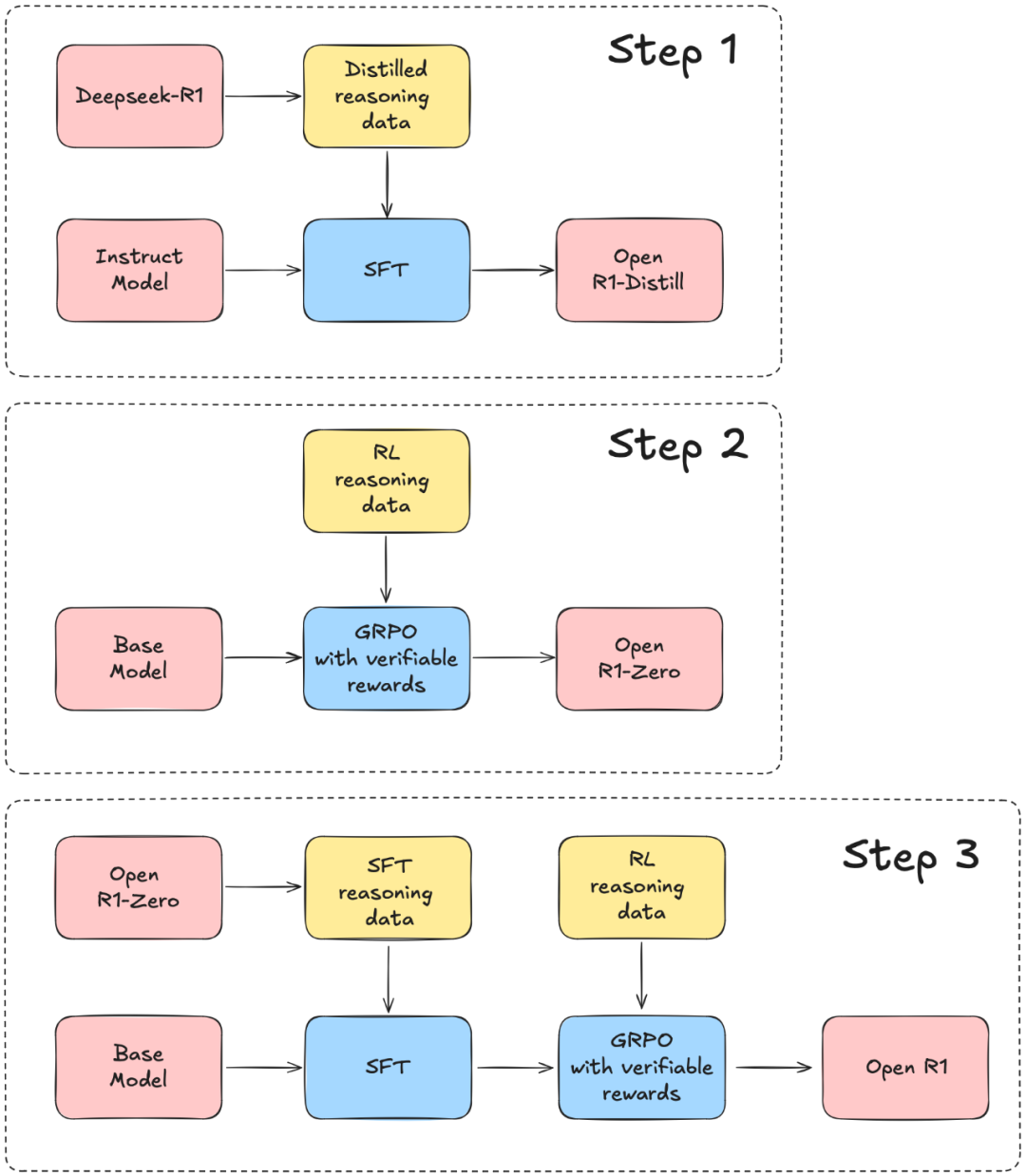

训练流程的细节。虽然其技术报告中介绍了强化学习阶段和蒸馏,但省略了关键的实现细节,包括超参数(例如,学习率、批量大小、奖励缩放因子)、用于生成合成训练数据的数据管道(例如,如何编排 800K 蒸馏样本)、需要人类偏好对齐的任务的奖励模型架构(多语言输出的「语言一致性奖励」)。 -

冷启动数据生成。报告中虽然提到了创建「高质量冷启动数据」(例如,人工标准、少样本提示)的过程,但缺乏具体的示例或数据集。 -

硬件和基础设施。没有关于计算资源(例如,GPU 集群、训练时间)或软件堆栈优化(例如,DeepSeek-V3 的 AMD ROCM 集成)的详细信息。 -

复现难题。缺少多阶段强化学习的脚本等组件。

-

项目地址:https://github.com/huggingface/open-r1

-

GRPO 实现 -

训练与评估代码 -

用于合成数据的生成器

-

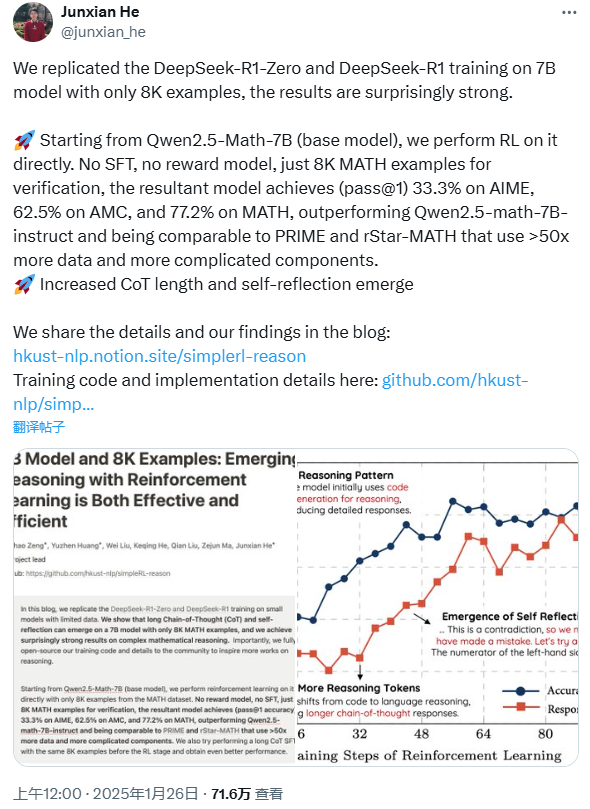

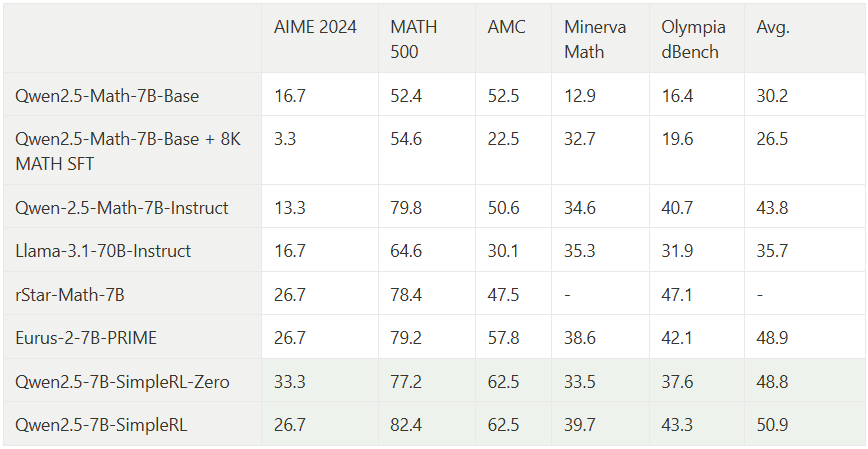

项目地址:https://github.com/hkust-nlp/simpleRL-reason

02

Meta 的焦虑:

下一代 Llama 可能赶不上 R1

(文:Founder Park)