今天是2025年02月04日,星期二,江西,天气阴。

今天是大年初七,假期最后一天了,大家归途一路顺风。

我们今天继续看技术进展,看多模态大模型用于数据合成的技术总结。然后看看关于多模态Multimodal GraphRAG的一点思考,这也是一个研究方向,把多模态、RAG、知识图谱都串起来了,有更多的优化问题可以展开。

专题化,体系化,会有更多深度思考。大家一起加油。

一、关于多模态Multimodal GraphRAG的一点思考

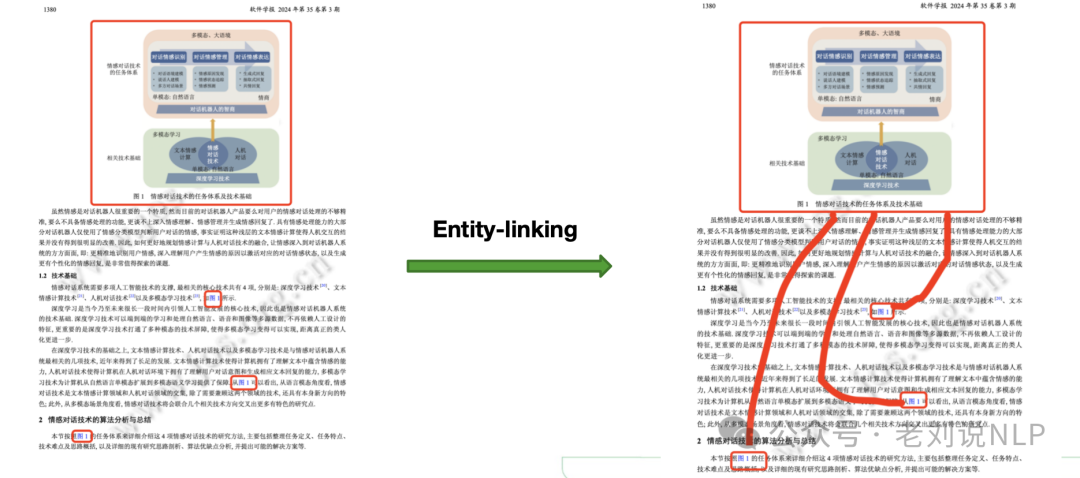

为什么要说这个,这是我们在实际落地过程中所遇到的一个难题例子,文档在进行表述时候,图表会作为一个链接元素被引用于文本描述当中,在RAG中常常会出现这类情况:一个问题召回出来的片段里,有xxxxxx,详见表1。这种问题本质上属于多跳情况。

所以,如上所述,解决方式,采用与知识图谱Entity-linking的方式,在原文中进行图表的链接。【但不局限于文图,通常还包括reference参考的链接】,这样能够将不同的模态之间联系起来,然后能够找回更为完整的信息,提升RAG检索性能。

所以,我想,索性是否直接可以有个Multimodal GraphRAG的概念,在Graph的基础上,进一步将Graph中的节点元素扩展到多模态元素。对于具体定义,我们可以定一下:多模态GraphRAG(Multimodal Graph Retrieval-Augmented Generation)是一种结合图结构推理、多模态数据融合与检索增强生成的前沿技术,旨在解决复杂场景下的语义理解与生成问题。其核心在于通过图结构显式建模跨模态实体关系,并利用图神经网络(GNN)增强检索与生成过程的上下文感知能力。

说到这个,我们可以再啰嗦下,回顾下历史,传统RA模态单一,仅支持文本,无法处理图像、音频等多模态数据。并且关系推理弱,文档片段间的关系未被显式建模,难以捕捉深层语义关联。所以,后面GraphRAG在此基础上引入图结构,将知识库中的实体、概念及其关系建模为图(节点表示数据单元,边表示关系),然后可以使用随机游走,pagerank,社区发现等算法。更进一步的,GraphRAG可以再与多模态的元素进行结合,形成多模态MultimodalGraphRAG。

但这个事情要实现起来,并不容易,我们可以来看,可以细分为如下几个环节。

一个是多模态数据处理与对齐,对于文本模态,可以使用BERT、RoBERTa提取语义嵌入,结合实体识别(spaCy)和关系抽取(REBEL);对于图像模态,可以使用CLIP视觉编码器或DETR目标检测模型提取区域特征;对于音频模态,Whisper语音转文本+Wav2Vec音频嵌入;对于视频模态,可以使用TimeSformer时空注意力模型提取帧序列特征。在对齐方面,可以使用通过CLIP式训练,最小化跨模态样本对的对比损失,或者使用注意力机制对齐,使用跨模态注意力(如ViLBERT)动态融合多模态特征。

一个是多模态知识图谱的构建,这个是个重点,需要将不同模态的信息组织起来。例如,医学实体“肺癌”关联CT图像、病理报告文本和患者语音描述。在节点类型设计上,可以设计实体节点(如“肺癌”)、属性节点(如“发病率”)、模态节点(如CT图像哈希值);边类型的设计上,包括语义关系(“治疗”“属于”)、模态关联(“图像描述”“音频注释”)。

更进一步的,鉴于GraphRAG结合了图结构,可能需要用图数据库来存储实体和关系。而多模态的话,需要处理文本、图像、视频等多种数据类型的现实需求,我们可以绘制出对应的实现流程:

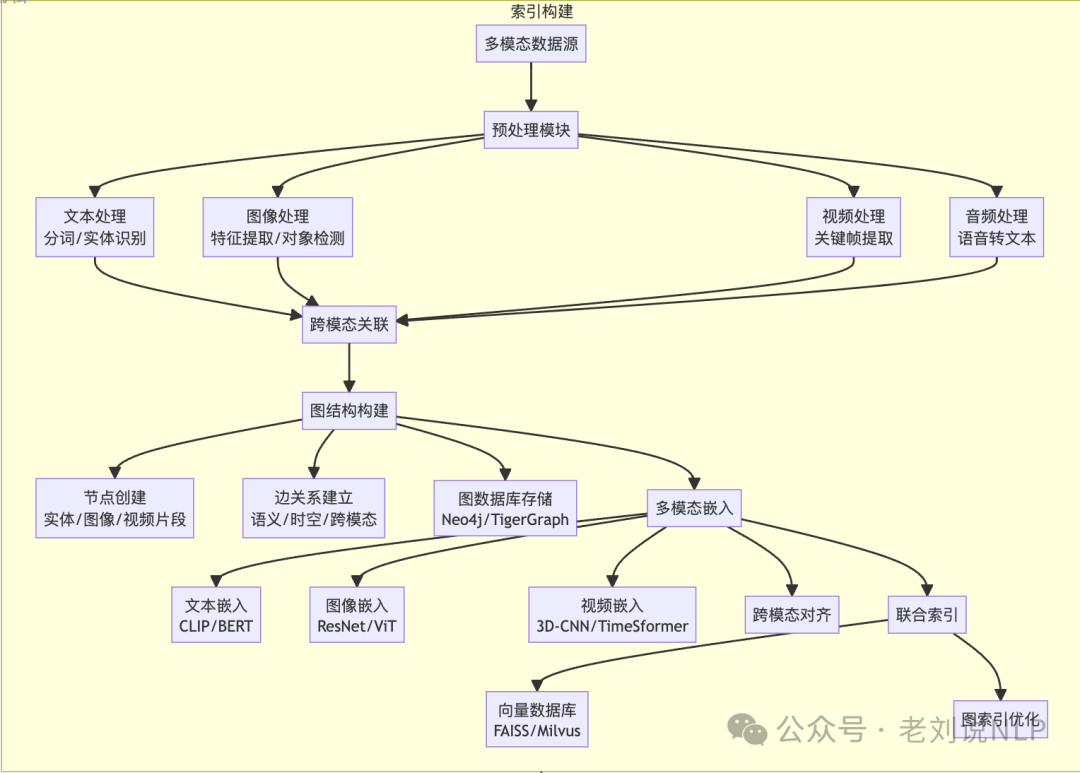

首先,索引构建部分。

多模态数据需要先进行预处理,比如文本的分词、实体的提取,图像的特征提取,可能用CNN或者ViT模型。视频可能需要拆分成帧,然后提取关键帧的特征。音频的话,转换成文本或者提取声谱图特征。然后,这些不同模态的数据需要关联起来,比如同一文档中的文本和图片,或者视频中的音频和画面。接下来,构建图结构,节点可能是实体、图像、视频片段等,边是它们之间的关系。可能需要用Neo4j这样的图数据库来存储。

然后生成嵌入向量,这里可能需要多模态的嵌入模型,比如CLIP来处理文本和图像,或者使用其他多模态模型来统一不同模态的嵌入空间。最后,将嵌入向量和图结构存入索引库,比如向量数据库如FAISS或Milvus,同时保存图数据库的信息。

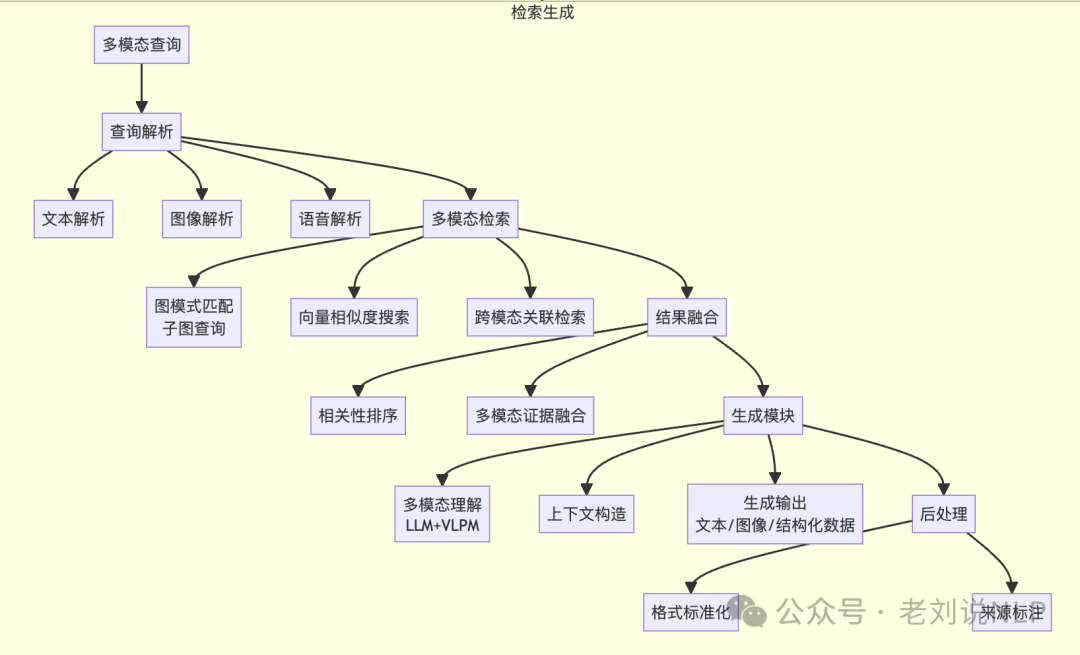

然后是检索生成部分。用户的查询可能是多模态的,比如输入文本加图片,需要先对查询进行解析和特征提取,类似索引阶段的处理。然后进行多模态检索,结合图遍历和向量相似度搜索。比如在图数据库中查找相关节点,再在向量库中找相似嵌入的内容。

然后需要融合结果,可能涉及不同模态的结果排序或加权。接着,将检索到的多模态数据输入到生成模型,比如GPT-4或类似的多模态生成模型,生成回答。最后,可能需要后处理,比如格式化输出或添加来源引用。

但是,整体如果要实现,有许多需要注意的点。例如,跨模态对齐需要设计统一的嵌入空间,图结构设计需平衡关系密度和计算复杂度,多模态融合策略需要根据任务动态调整,使用领域适配的模型(如CLIP/BERT用于文本-图像对齐),需要构建包含跨模态关系的异构知识图谱,需要结合向量索引和图结构索引的优势,需要同时利用图遍历和向量相似度检索,需要基于注意力权重的多模态结果融合,需要通过图结构验证生成结果的逻辑一致性,这样,多个技术点一同发力,才能实现图结构和向量索引的在线更新、通过图路径追溯和跨模态关联提供解释以及利用图结构实现跨模态的推理链条。

二、多模态大模型用于数据增强技术总结

关于数据增强,这个是当前与数据合成很接近的一个工作,正好这块有一个技术总结,我们可以来看看,会有一些思路。

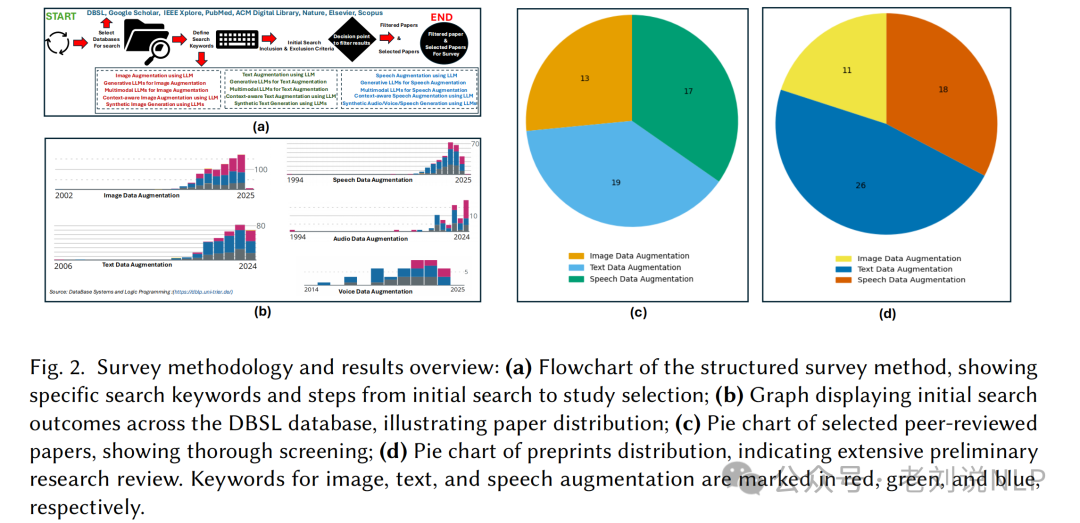

主要来看最近的工作《Image, Text, and Speech Data Augmentation using Multimodal LLMs for Deep Learning: A Survey》(https://arxiv.org/pdf/2501.18648),该工作对多模态LLMs在数据增强中的应用进行系统综述。其中进行文献搜集的流程如下,值得看看:

可以重点看几个点。

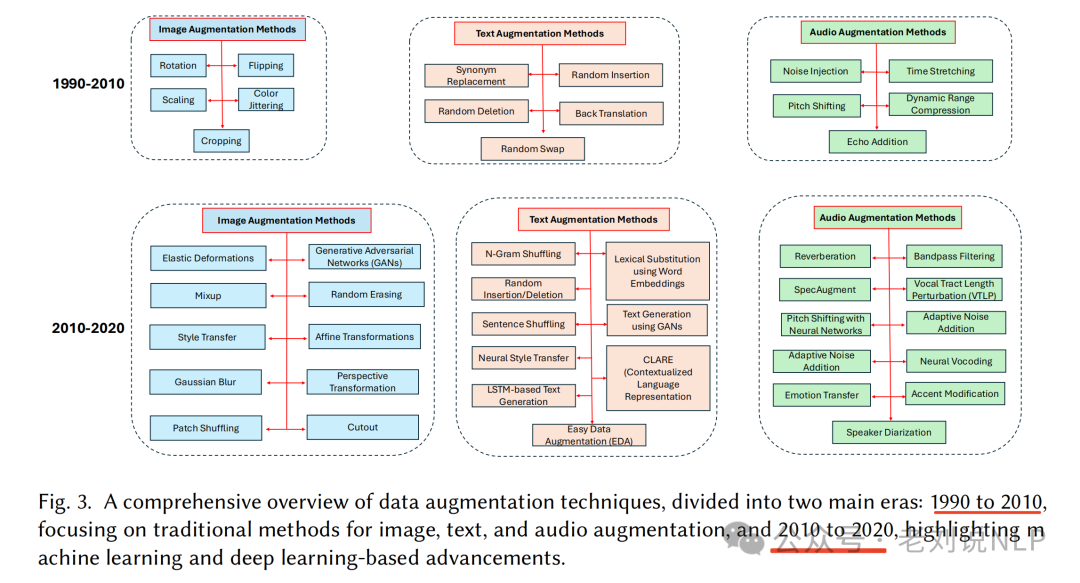

一个是数据增强方法的整体总结。分为两个主要时期:1990年至2010年的传统方法以及2010年至2020年的机器学习和深度学习方法。

例如,在图像数据增强方面,在过去的十年中,基于深度学习和机器学习(DL/ML)的图像数据增强技术,包括旋转、翻转和裁剪等方法;文本增强技术的演变包括了多种多样的方法,n-gram洗牌,增加了句法多样性;以及使用词嵌入进行词汇替换,增强了词汇多样性同时保持了语义内容。神经风格迁移和生成对抗网络(GANs)等方法,解决数据稀缺和专业任务(如医疗报告生成)中类别不平衡的问题。

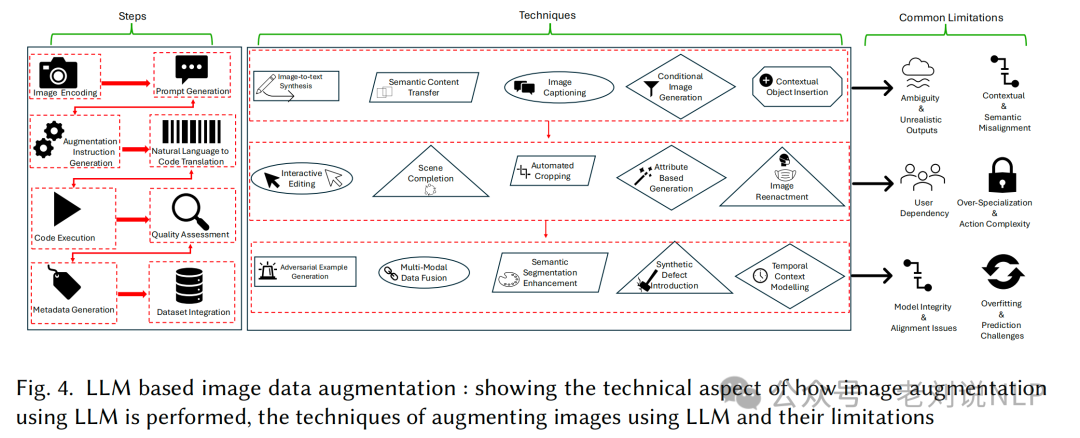

一个是基于大模型的图像数据增强步骤,如下:

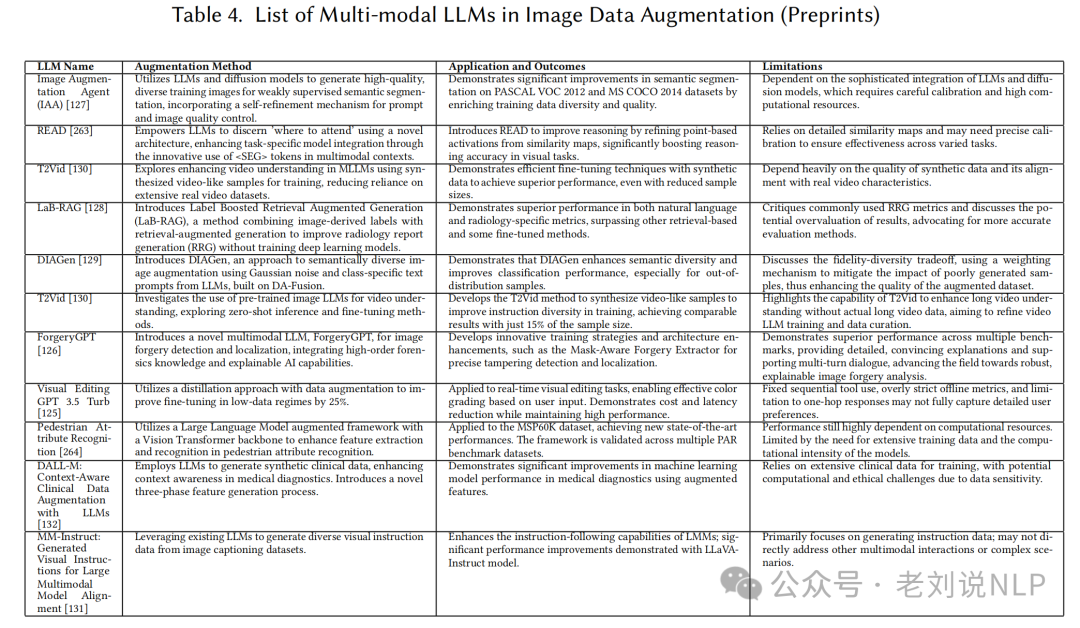

以及多模态大模型用于图像数据增强的代表工作

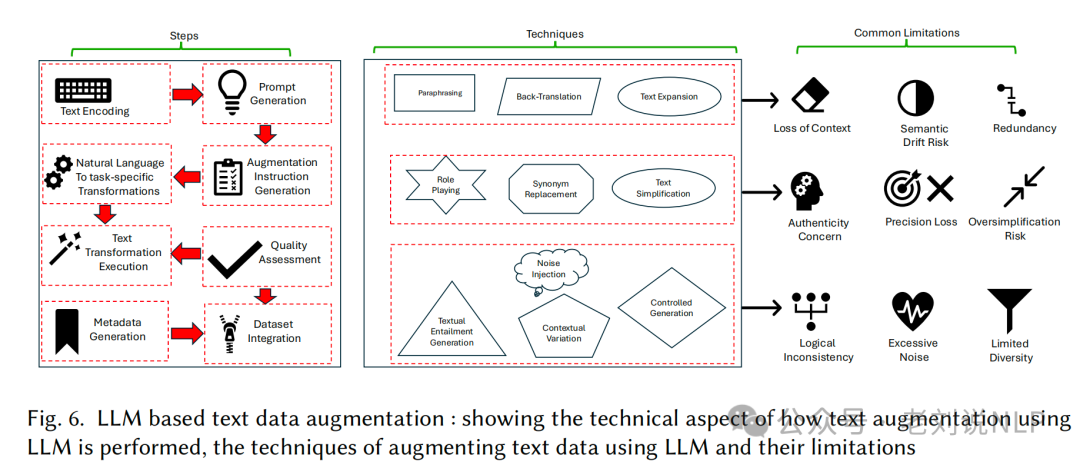

一个是大模型用于文本数据增强步骤,如下:

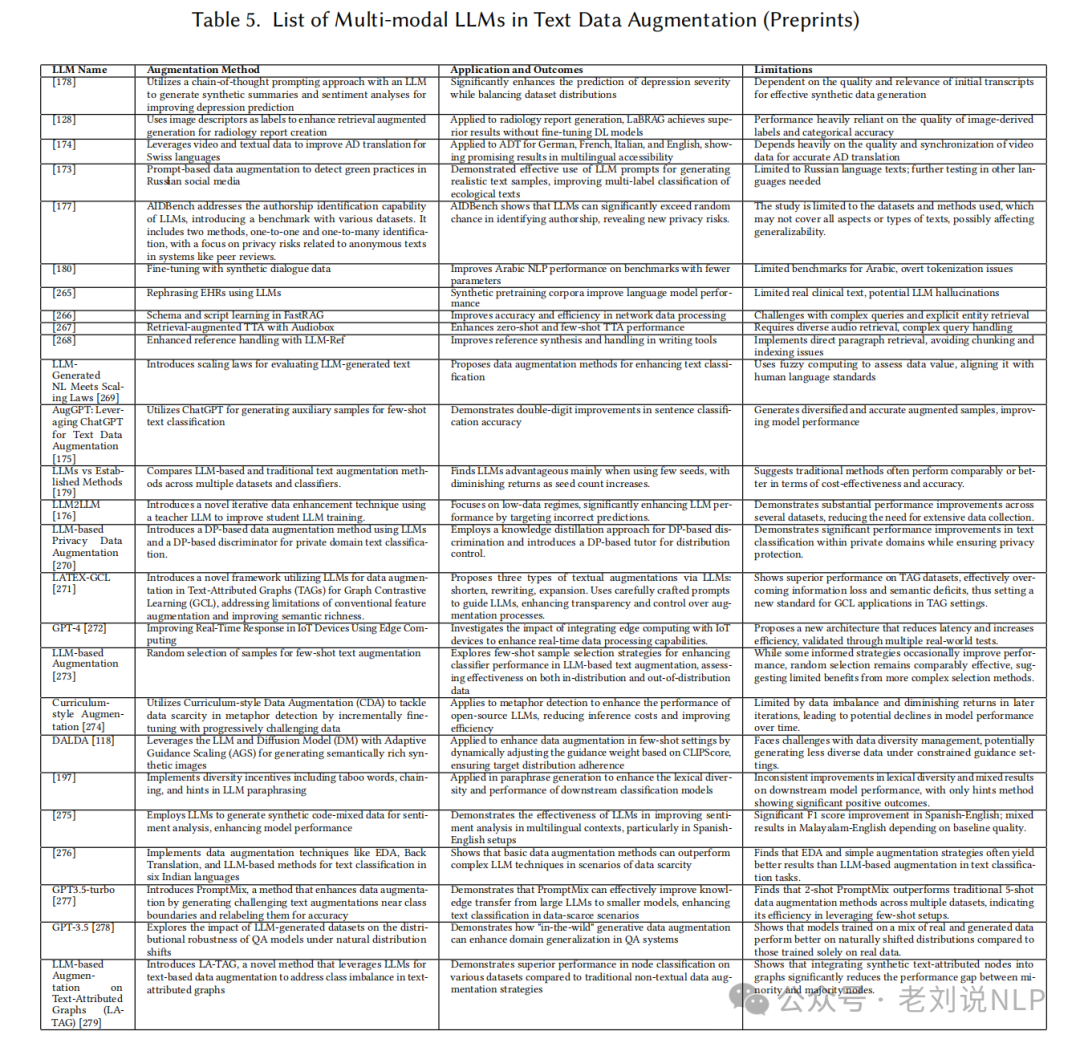

以及代表性多模态大模型用于文本数据增强的工作

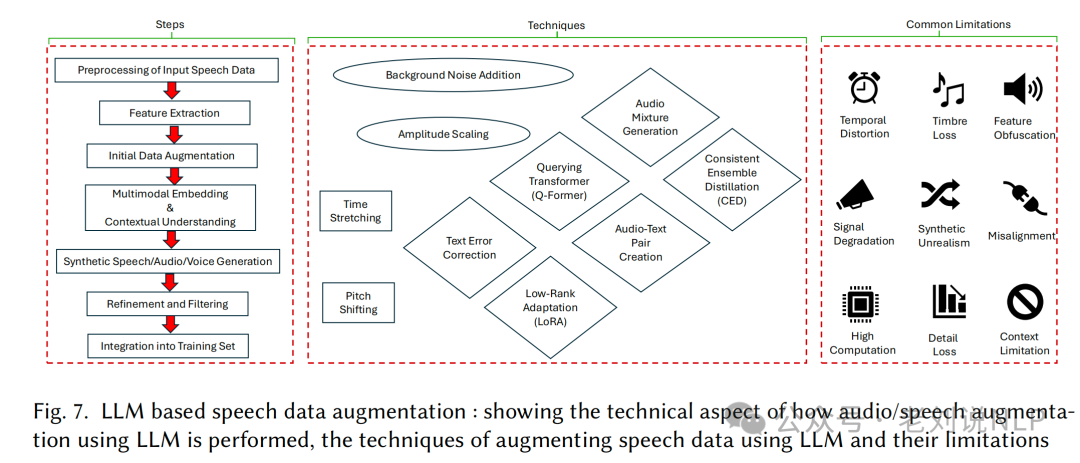

一个是大模型用于语音数据增强的流程,如下:

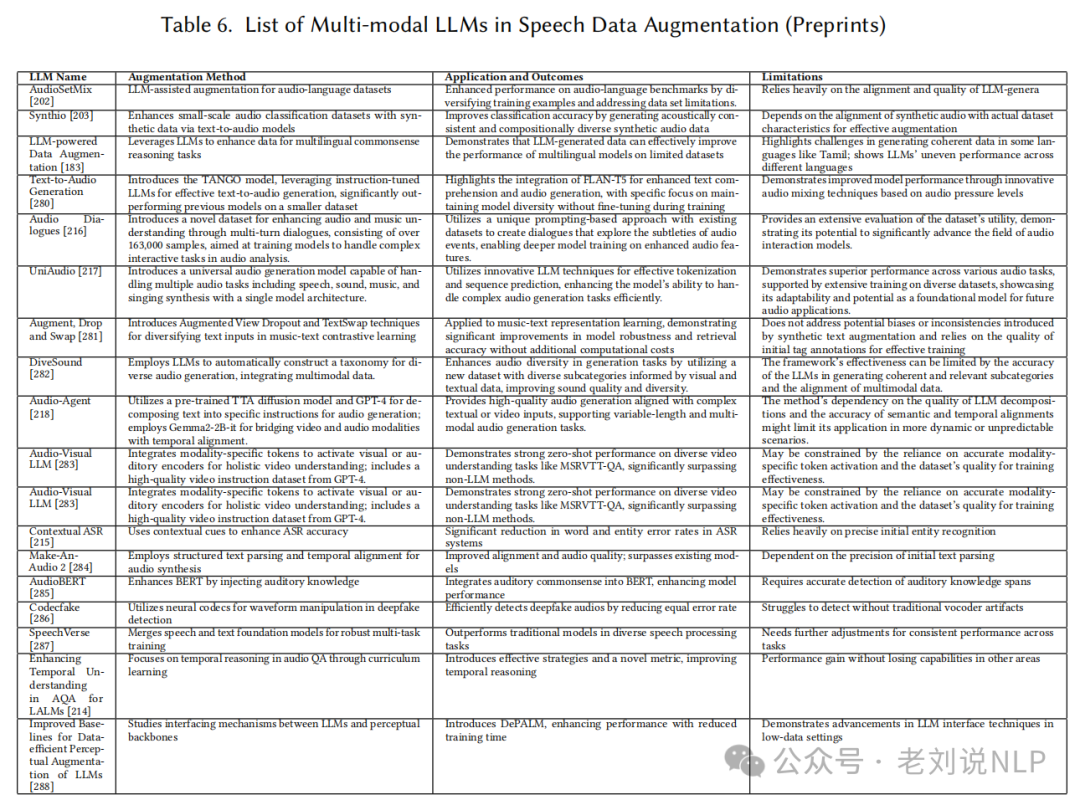

以及多模态大模型用于语音数据增强的工作:

总结

本文主要介绍了关于多模态Multimodal GraphRAG的一点思考。然后还看了看多模态大模型用于数据合成的技术总结。这些都是一些有趣的技术点,感兴趣的可以多看看。

参考文献

1、https://arxiv.org/pdf/2501.18648

(文:老刘说NLP)

技术再强,最后还是得靠人类的选择和判断!//

cutting-edge tech you gotta see! Multimodal GraphRAG and data augmentation, the future is bright.