最近,MCP 突然受到了广泛关注。MCP(模型上下文协议)是去年 11 月由 Claude 的母公司 Anthropic 推出的一项开放标准协议。其目标是为大型语言模型提供一种开放、标准化的方式,以便与外部数据源、工具和服务进行连接。

虽然发布后一直未引起太大关注,但最近情况发生了变化。现在大家都在 X 上热烈讨论 MCP 服务器,认为它将成为 AI 应用的颠覆性创新。

上周,Windsurf 表示他们已将 MCP 服务器连接到软件中,实现了与 GitHub、Slack、Figma 等平台的直接交互,为 Cascade 添加了更多实用工具,从而打造了全新的工作流程。

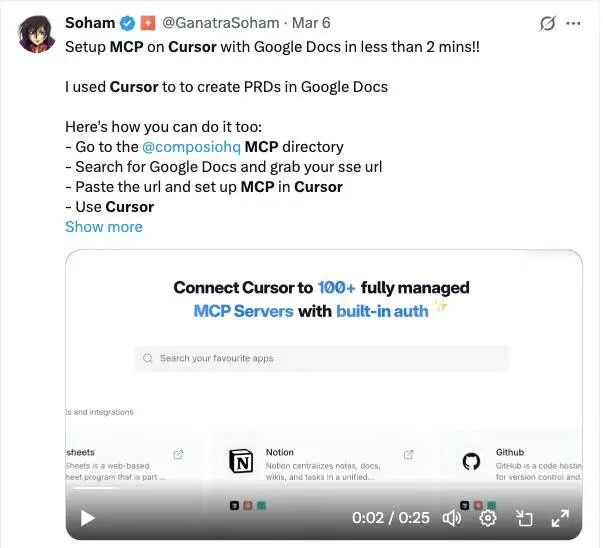

还有更多人则尝试了 Cursor 和 MCP 的组合。

有人尝试了在不到 2 分钟内通过 Cursor 设置 MCP 与 Google Docs 集成,并使用该功能创建产品需求文档(PRD)。

还有人用 Cursor 和 MCP 技术实现了一种自动化流程,使得公司能够快速响应客户需求并自动完成开发。

具体来说,如果客户在 Slack 上说:“我们需要加个新功能!”以前程序员得手动去看 Slack,然后自己写代码,再提交代码。而现在当客户提出一个功能请求后,Cursor 会自动读取该 Slack 请求并构建所需的功能,随后自动创建一个 Pull Request(代码提交请求),提交给开发团队审核和合并。这整个过程是自动完成的,大大提高了效率,同时也让工程师可以专注于更长期的工作任务。

甚至还有博主还表示 MCP 重塑了他的 Cursor 工作流,将效率提升了 10 倍。

这些案例也体现出了 MCP 为什么会火爆起来。

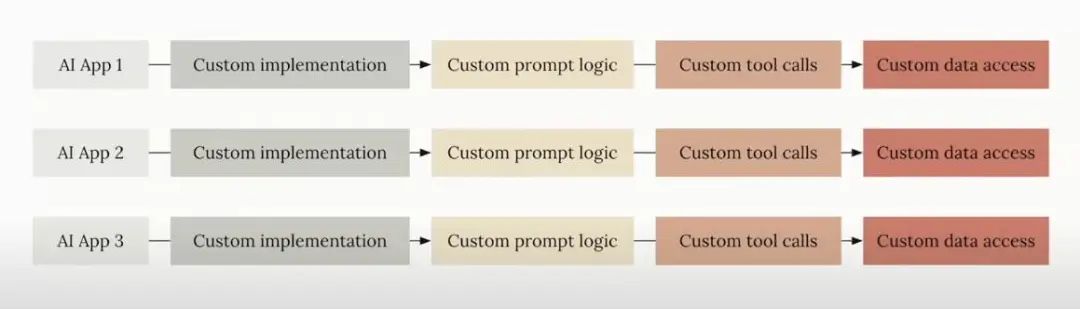

尽管过去新的 AI 应用层出不穷,但我们普遍感受到,它们大多是独立的新服务,与我们日常使用的系统缺乏有效集成。也就是说,AI 模型与现有系统的融合进展缓慢。我们目前还不能同时通过某个 AI 应用来做到联网搜索、发送消息、更新数据库等,这些功能单个实现都不是很难,但是如果要全部集成到一个系统里面就比较麻烦。

以日常开发为例,想象一下在 IDE 中,我们可以通过 IDE 的 AI 来完成下面这些工作:查询本地数据库中已有的数据,以辅助开发;使用 AI 搜索 GitHub Issue,判断某个问题是否已知的 bug;通过即时通讯软件来完成编码需求和提交 PR ……

而现在,这些功能通过 MCP 正在变为现实。 AI 集成已有服务进展缓慢的一个原因是我们在技术方面缺少一个开放的、通用的协议标准。而 MCP 正是填补这一空白的方案。借助MCP,开发者可以根据自己的需求花费很少的时间集成更多功能,提升Cursor等IDE工作流中的效率。

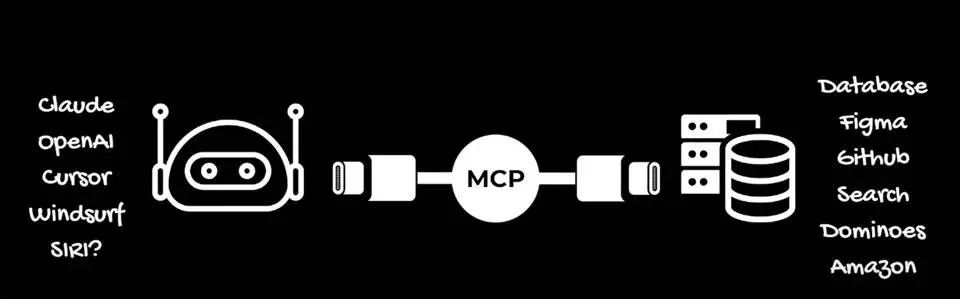

Anthropic 官方表示 MCP 是受微软 LSP (Language Service Protocol) 的启发,他们将 MCP 比作 AI 应用程序的 USB-C 接口,希望通过它连接各种不同的服务。

试想一下,如果我们能将任何代理连接到任何服务、网站或应用程序,那么互联网的运作方式将会彻底改变。简单来说,他们希望 MCP 成为 AI 界的“万能插头”。

在传统 API 的方式中,就像各种电器需要不同的插头,你要用一个 AI 应用连接不同的数据源(比如网站、数据库),就得为每种数据源单独做一套连接方式,非常麻烦。这就导致了“集成碎片化”,就像你家里一堆不同的充电器,乱糟糟的,维护起来也费劲。

而 MCP 则像 USB-C 接口一样,它提供了一个统一的标准。有了 MCP,AI 应用就能用同一种方式连接各种数据源和工具。这样一来,开发者就省事多了,不用重复造轮子,开发效率大大提高。

此外,MCP 支持双向通信,使 AI 交互更加智能。传统 API 通信通常是单向的,缺乏真正的对话能力。而 MCP 支持双向通信,AI 助手不仅能够获取数据,还能执行操作、更新信息,并在多次交互中保持上下文,增强了智能化程度。

MCP 还具有较好的可扩展性和可维护性。在 API 领域,每次新增集成都像是重新造轮子,开发和维护成本增加。而 MCP 采用标准协议,开发者只需进行一次集成,即可在多个 AI 应用中复用,大幅减少重复工作,提升开发效率。

同时,MCP 提供统一的数据交换框架,帮助企业实施一致的安全策略,简化合规流程。此外,MCP 还赋能 AI 代理,使其在执行复杂任务时展现出更高的自主性。受限于传统 API 机制,AI 代理往往在执行任务时受到一定局限,而 MCP 让 AI 代理能够实时访问信息、管理资源,并无缝连接多个平台,提升了执行能力和自主决策的可能性。

在一个 MCP 架构中,MCP 客户端负责调用工具、查询资源并填充提示信息,为模型提供上下文。服务器端则暴露这些工具、资源和提示信息,供客户端使用。工具种类包括读取数据、发送数据、更新数据库或文件等,几乎涵盖所有操作。资源是由服务器提供的数据,应用程序控制如何使用。服务器可以提供图像、文本文件、JSON 文件等,应用程序根据需求使用这些资源。

据 Anthropic 公布的数据,MCP 的采用正在增长,有超过 1100 个社区构建的服务器和官方集成可供使用。很多是由个人开发者自己构建并开源的,也有一些公司自己构建的服务器:https://github.com/modelcontextprotocol/servers

比如,前几天 Composio MCP 就宣称他们正在构建世界上最大的完全托管 MCP 服务器源,能够连接 Claude、Cursor、Windsurf,支持 100 多个应用和 15,000 个以上的 API 操作,而且无需复杂的身份验证设置。更吸引人的是,这一切都不需要编写任何 Python 代码。

(文:AI前线)