该模型拥有 320 亿参数,性能已接近甚至超过一些更大体量的主流模型。它用 15 万亿高质量数据预训练,特别强化了推理类任务。重点提升了模型在理解指令、写代码、调用函数等方面的能力。目前它在代码生成、搜索问答、写报告等任务上表现出色,部分评测指标已接近 GPT-4o、DeepSeek-V3 等超大模型。

GLM-Z1-32B-0414 是一款专注深度思考的推理模型,基于基座模型 GLM-4-32B-0414 打造,并通过强化学习等技术重点提升了数学、代码、逻辑等能力。

在多个测试中(如 AIME、LiveCodeBench、GPQA),它的表现已经接近参数量大出 20 倍的 DeepSeek-R1,展现出强大的数理推理能力,适合解决更复杂、更挑战性的任务。

此外,小参数量的 GLM-Z1-9B-0414 也实现了在数学推理和通用任务上的高性价比表现,是轻量部署场景的可选项。

同时除了开源外,基座模型和这个推理模型也上线了智谱 MasS 开放平台,面向企业与开发者提供 API 服务。

上线的推理模型分为三个版本,分别满足不同场景需求:

不止反思,更是沉思。前段时间上线的 AutoGLM 沉思的核心就是它。

该模型能在深度思考过程中整合搜索工具处理复杂任务,并运用多种规则型奖励机制来指导和扩展端到端的强化学习训练。支持“自主提出问题—搜索信息—构建分析—完成任务”的完整研究闭环,从而在研究型写作和复杂检索任务上的能力得到了显著提升。

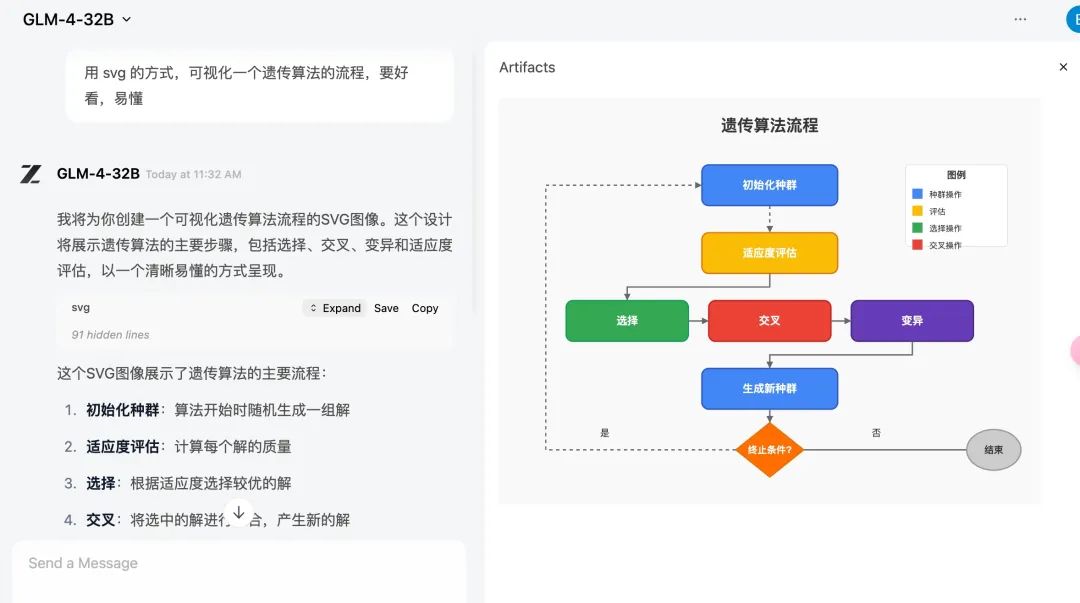

例如让它搜索最近两天关于智谱的新闻,实测效果如下。

(文:特工宇宙)