4月24日起,GLM-4-Plus 价格直降90%!还有 GLM-4-FlashX 模型10块钱1亿 tokens,智谱开放平台正式进入「亿时代」,关键降价不降级,真正实现”高性能,普惠价格”。本文全面解析 GLM-4-Plus 的性能优势和实际应用场景。

降价不降级,性能全面领先

降价不降级:GLM-4-Plus 不仅在性能上全面领先,价格也降低至每亿 tokens 仅 500 元,较同类产品低 92%,真正实现了高性能与普惠价格的完美结合。

智谱 BigModel 开放平台全系列产品价格调整:

-

GLM-4-Plus:从 50 元/百万 Tokens 降至 5 元/百万 Tokens(相当于每亿 tokens 仅 500 元) -

GLM-4-FlashX:每亿 tokens 仅 10 元 -

GLM-Z1-Air:每亿 tokens 仅 50 元 -

GLM-Z1-AirX:每亿 tokens 仅 500 元

应用场景实测

GLM-4 系列提供了复杂推理、超长上下文、极快推理速度等多款模型,适用于多种应用场景。以下给大家展示几个我实测过的场景,特别棒。

智谱还给大家提供了体验中心,可以在线体验 GLM-4-Plus 的各项能力。

访问模型体验中心 https://www.bigmodel.cn/trialcenter/modeltrial

代码理解与应用

作为一名多年的开发者,我对 GLM-4-Plus 的代码能力进行了一系列严苛测试,结果令人惊喜。不同于其他模型常见的 “看起来对但实际有 bug” 的代码生成,GLM-4-Plus 展现出了真正的工程思维和实用价值。

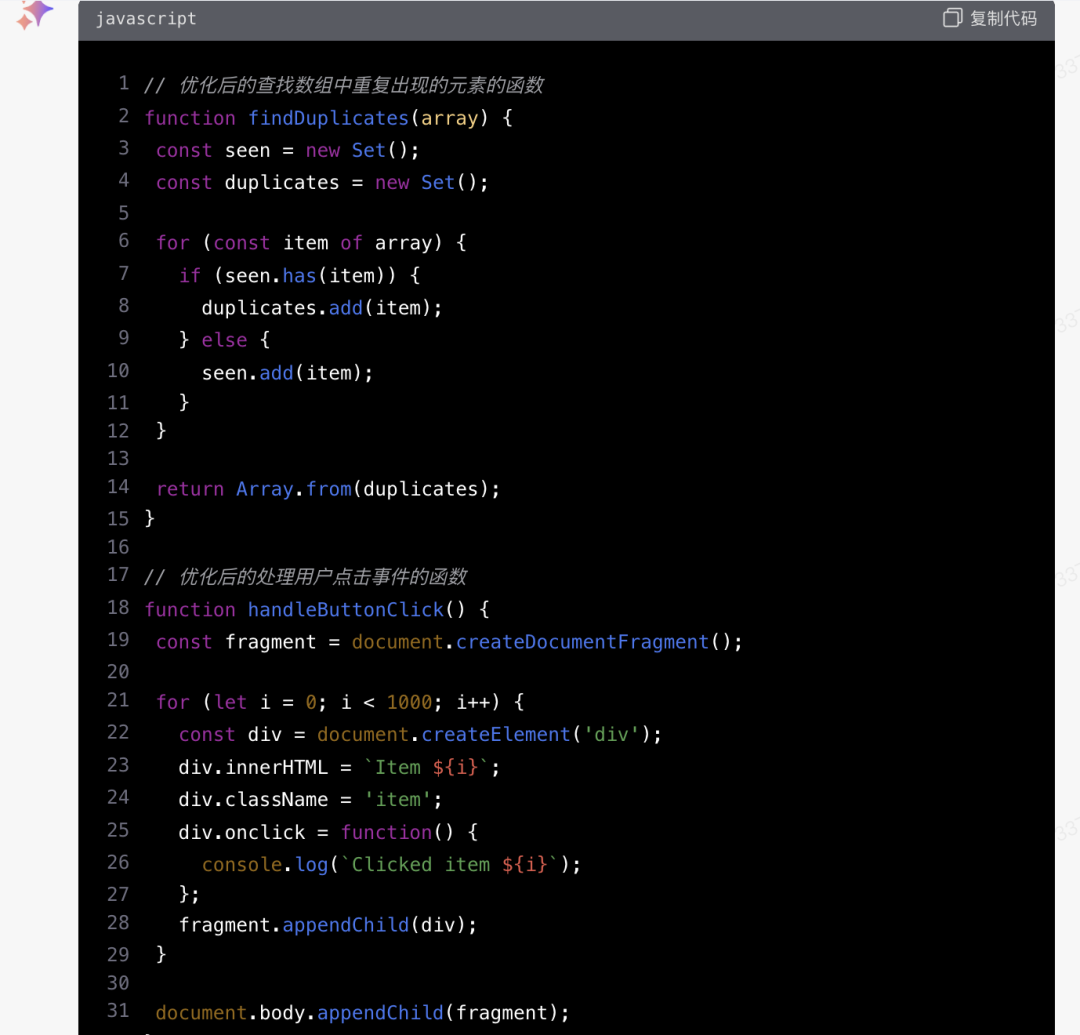

代码优化示例

下面是一个实际的代码优化案例,我先提供一段存在性能和内存问题的 JavaScript 代码,然后展示 GLM-4-Plus 如何进行优化:

原始代码(有性能问题):

// 查找数组中重复出现的元素

function findDuplicates(array) {

const result = [];

// 效率低下的实现方式

for (let i = 0; i < array.length; i++) {

for (let j = 0; j < array.length; j++) {

if (i !== j && array[i] === array[j]) {

// 重复检查元素是否已在结果中

let isDuplicate = false;

for (let k = 0; k < result.length; k++) {

if (result[k] === array[i]) {

isDuplicate = true;

break;

}

}

if (!isDuplicate) {

result.push(array[i]);

}

break;

}

}

}

return result;

}

// 处理用户点击事件的函数

function handleButtonClick() {

// 创建大量DOM元素导致性能问题

for (let i = 0; i < 1000; i++) {

const div = document.createElement('div');

div.innerHTML = `Item ${i}`;

div.className = 'item';

div.onclick = function() {

console.log(`Clicked item ${i}`);

};

document.body.appendChild(div);

}

}

提交给 GLM-4-Plus 的优化请求:

请优化这段JavaScript代码的性能和内存使用。

以下为 GLM-4-Plus 优化后的代码和解释:

这些优化不仅提高了代码的执行效率,还减少了内存的使用,使得代码更加健壮和易于维护。

这个实例充分展示了 GLM-4-Plus 在代码优化方面的能力,它能够识别常见的 JavaScript 性能陷阱并提供实用的解决方案,既提高了代码执行效率,也改善了内存使用和代码质量。

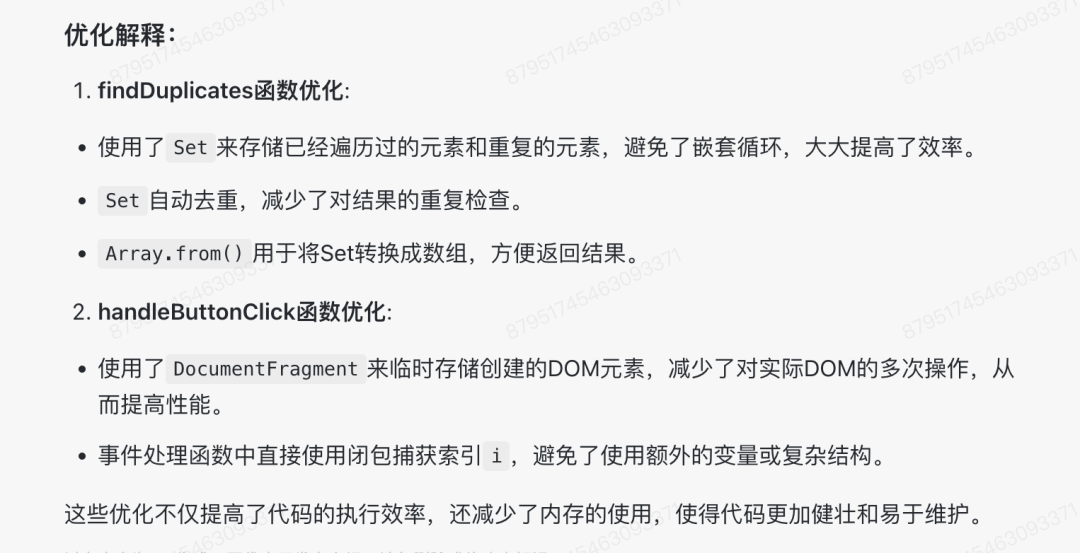

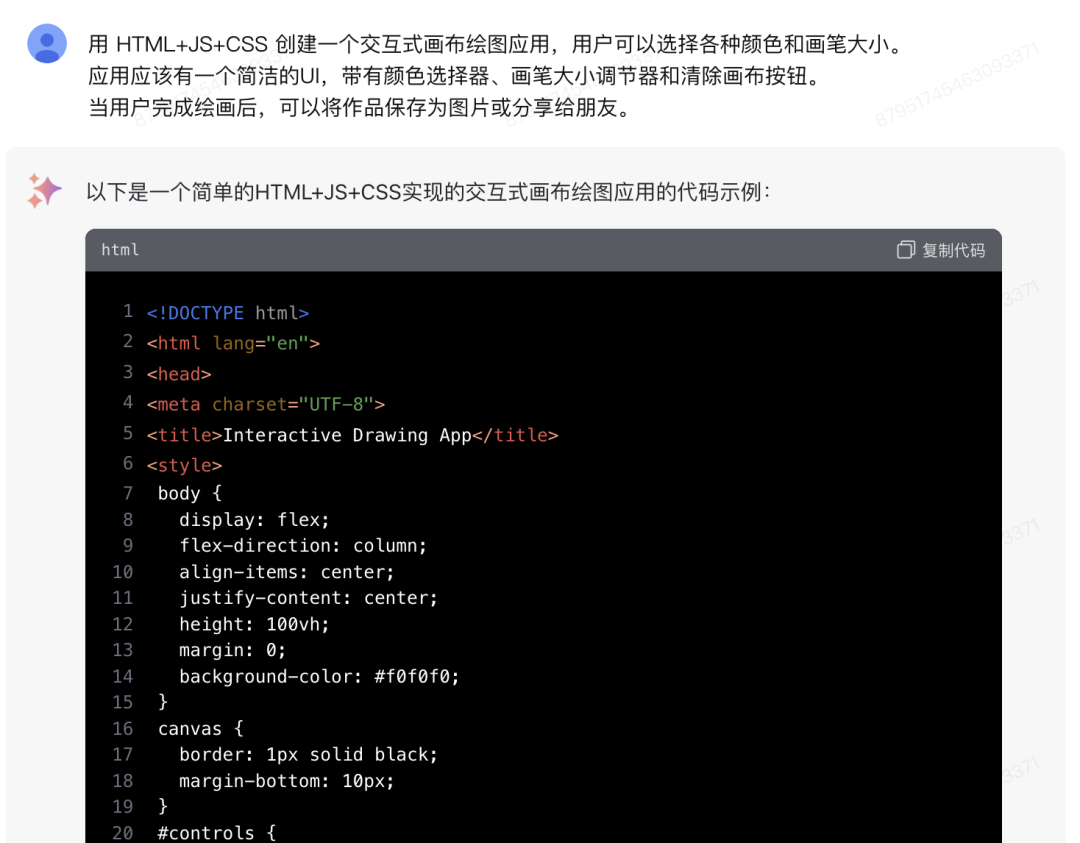

写一个画布绘图应用

以下是我们请求 GLM-4-Plus 创建一个画布绘图应用的提示词:

用 HTML+JS+CSS 创建一个交互式画布绘图应用,用户可以选择各种颜色和画笔大小。

应用应该有一个简洁的UI,带有颜色选择器、画笔大小调节器和清除画布按钮。

当用户完成绘画后,可以将作品保存为图片或分享给朋友。

GLM-4-Plus 立即生成了完整的代码,实现了一个功能齐全的绘图应用,我在本地运行后画了一个丁老头。

一步到位,生成的 html 代码一次就运行成功,不需要任何修改。功能也很完整,包括自由绘画、颜色选择、画笔大小调整、清除画布、保存为本地图片。

这种能力对开发者来说极为实用,特别是在前端原型快速开发、学习新技术或创建演示项目时,可以大幅提升效率。与传统方式相比,使用 GLM-4-Plus 可以将原本可能需要数小时的开发工作压缩至几分钟内完成。

玩转 API 接入

应用层我们可以通过 API 接入的方式来使用 GLM-4-Plus 模型,创造出更多有意思的场景。GLM-4-Plus 的 API 接入非常简单,下文我会对两种主流编程语言 Python、JavaScript 的接入方式都进行介绍,并提供示例代码。让你玩转智谱 API 接入。

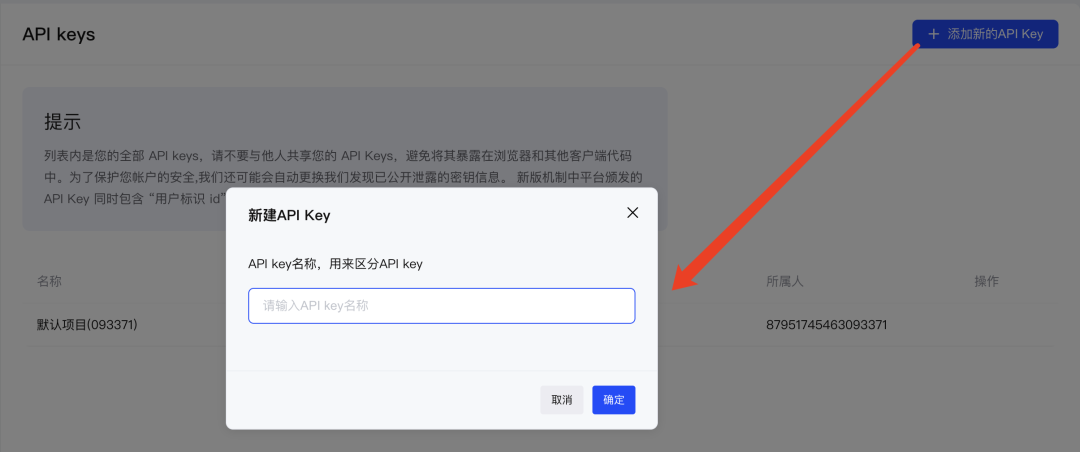

获取 API Key

在智谱 https://bigmodel.cn/ 开放平台注册账号。

访问智谱的 API Keys 页面 https://bigmodel.cn/usercenter/proj-mgmt/apikeys。

点击 “添加新的 API Key” 按钮,即可创建一个 API Key。

创建好之后在列表可直接复制 API Key(注意这个 API Key 不要泄漏,不要放在公共代码中)。

GLM-4 API 文档可参考:https://bigmodel.cn/dev/api/normal-model/glm-4

Python 接入 GLM-4-Plus:翻译金融专业文本

GLM-4-Plus 在专业翻译领域展现出色能力,特别是在处理复杂专业术语和行业文档时表现突出。

以下是一个 Python 接入 GLM-4-Plus 模型进行金融报告专业翻译的实际应用示例:

首先安装智谱 API 的 Python 客户端:

pip install zhipuai

接入示例代码(最新版本):

import os

from zhipuai import ZhipuAI

# 设置API密钥

api_key = "替换为你的智谱 API Key"

client = ZhipuAI(api_key=api_key)

def translate_financial_text():

financial_text = """

The quarterly financial statements show a 15% increase in EBITDA, with significant growth

in our derivatives trading division. The company's debt-to-equity ratio improved to 1.2,

reflecting stronger balance sheet fundamentals. Our liquidity coverage ratio remains well

above regulatory requirements at 140%, while return on equity reached 18.5% this quarter.

"""

try:

# 调用GLM-4-Plus模型进行翻译

response = client.chat.completions.create(

model="glm-4-plus",

messages=[

{

"role": "user",

"content": (

"请将以下英文金融报告段落翻译成中文,要求:\n"

"1. 保持专业金融术语的准确性\n"

"2. 翻译后的文本通顺易读\n"

"3. 保留原文的专业性和正式语气\n\n"

f"原文:\n{financial_text}"

)

}

],

temperature=0.3,

)

# 提取翻译结果

translation = response.choices[0].message.content

# 打印结果

print("\n原文:")

print(financial_text)

print("\n翻译:")

print(translation)

return translation

except Exception as e:

print(f"翻译过程出错: {e}")

returnNone

if __name__ == "__main__":

print("===== 智谱GLM-4-Plus金融专业翻译示例 =====")

try:

translate_financial_text()

except Exception as e:

print(f"程序运行出错: {e}")

print("\n=====================================")

print("翻译示例结束")

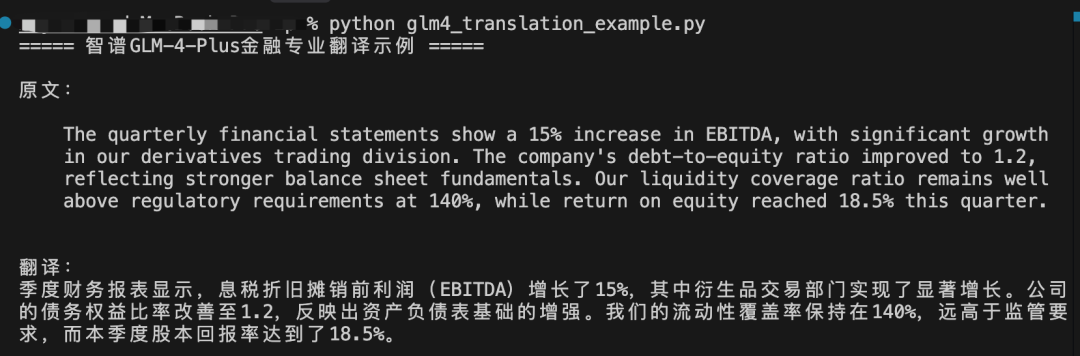

运行结果展示:

从翻译结果可以看出,GLM-4-Plus 展现出了以下专业翻译优势:

-

术语精准:EBITDA(息税折旧摊销前利润)、债务权益比率、流动性覆盖率等金融专业术语翻译准确无误 -

语境理解:准确理解原文金融报告的上下文和意图,避免了字面翻译的生硬感 -

表达地道:符合中文金融报告的表达习惯和行业用语规范 -

结构清晰:保持了原文的逻辑结构,使翻译后的内容连贯流畅

这种高质量的专业翻译能力使 GLM-4-Plus 成为金融、法律、医疗等专业领域文档翻译的理想选择,大幅提升了跨语言专业交流的效率和准确性。

Node.js 接入 GLM-4-Plus:作文评价示例

在教育领域,GLM-4-Plus 展现出色的教学辅助能力,能够精准识别不同年级、不同体裁的写作特点,为学生提供个性化的写作指导与评价。其丰富的语言理解能力使其成为教师的得力助手。

以下是一个 Node.js 接入 GLM-4-Plus 模型进行作文智能评价的实际应用示例:

首先,安装 OpenAI 兼容 SDK(智谱 AI 采用了 OpenAI 兼容接口设计):

npm install openai

然后,创建以下 Node.js 代码实现作文智能评价功能:

// 使用 Node.js 调用 GLM-4-Plus 模型示例

const OpenAI = require('openai');

// 配置 OpenAI 客户端

const openai = new OpenAI({

apiKey: 'YOUR_API_KEY', // 替换为您的实际 API 密钥

baseURL: 'https://open.bigmodel.cn/api/paas/v4',

});

// 调用 GLM-4-Plus 模型进行作文评价示例

asyncfunction callGLM4PlusForEssayReview() {

try {

const studentEssay = `

我的暑假生活

今年暑假,我去了北京旅游。北京有很多名胜古迹,比如长城、故宫和天安门。我爬了长城,导游说不到长城非好汉。长城真的很长很长。故宫里有很多房子,听说有9999间半。天安门广场很大,我们在那里拍了很多照片。

这次旅行真好玩,我希望明年暑假能去上海。

`;

const response = await openai.chat.completions.create({

model: 'glm-4-plus', // 使用 GLM-4-Plus 高端大模型,提供更精准的文本理解和专业评价

messages: [

{

role: 'user',

content: `请作为一名小学语文老师,对这篇四年级学生的暑假见闻作文进行评价和修改建议:\n\n${studentEssay}\n\n请从内容丰富度、语言表达、结构安排等方面给出具体修改建议,并重写一个优秀的开头段落作为示例。`

}

],

temperature: 0.5,

max_tokens: 2048,

});

// 输出 GLM-4-Plus 的专业评价结果

console.log('GLM-4-Plus 作文评价响应:');

console.log(response.choices[0].message.content);

} catch (error) {

console.error('调用 GLM-4-Plus 时出错:', error);

}

}

// 运行示例

console.log('开始调用 GLM-4-Plus 模型进行作文评价...');

callGLM4PlusForEssayReview();

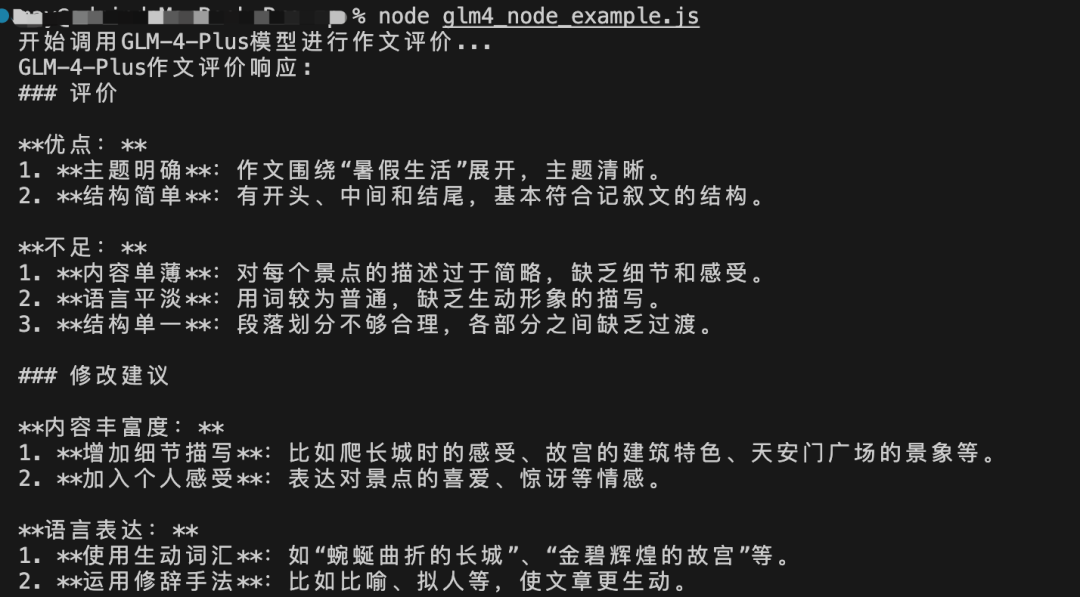

运行此代码后,您将获得如下图所示的专业且全面的作文评价结果,GLM-4-Plus 不仅能够识别作文的优点与不足,还能提供具体的修改建议和优秀范例:

从运行结果可以看出,GLM-4-Plus 能够从内容丰富度、语言表达和结构安排等多个维度进行专业评价,并提供具体的修改建议。这种智能评价不仅可以应用于个性化教育辅导,还可以扩展到专业写作培训、内容创作指导等多个领域。

总结

通过本文的全面测试和分析,我们可以看到 GLM-4-Plus 在降价 90% 后仍然保持着与国际顶尖大模型相当的性能表现。这种”降价不降级”的策略具有深远的战略意义:它不仅大幅降低了中小企业和个人用户使用顶级 AI 能力的门槛,更重要的是将推动 AI 技术在更多垂直领域实现真正的落地应用。

对于开发者和企业用户来说,GLM-4-Plus 提供的 API 接口简单易用,可以快速集成到现有系统中,我强烈推荐大家利用这一工具,探索创造更多富有创意和实用价值的应用。

(文:AI智见录)