今天是2025年4月28日,星期日,北京,晴。

我们来看看Deepresearch与RAG相关进展,重点看看起实现思路。

另一个,看看DeepSeek-R1的一个有趣的实验模型,思路还不错。

抓住根本问题,做根因,专题化,体系化,会有更多深度思考。大家一起加油

一、Deepresearch与RAG相关进展回顾

1、Deepresearch与github进展

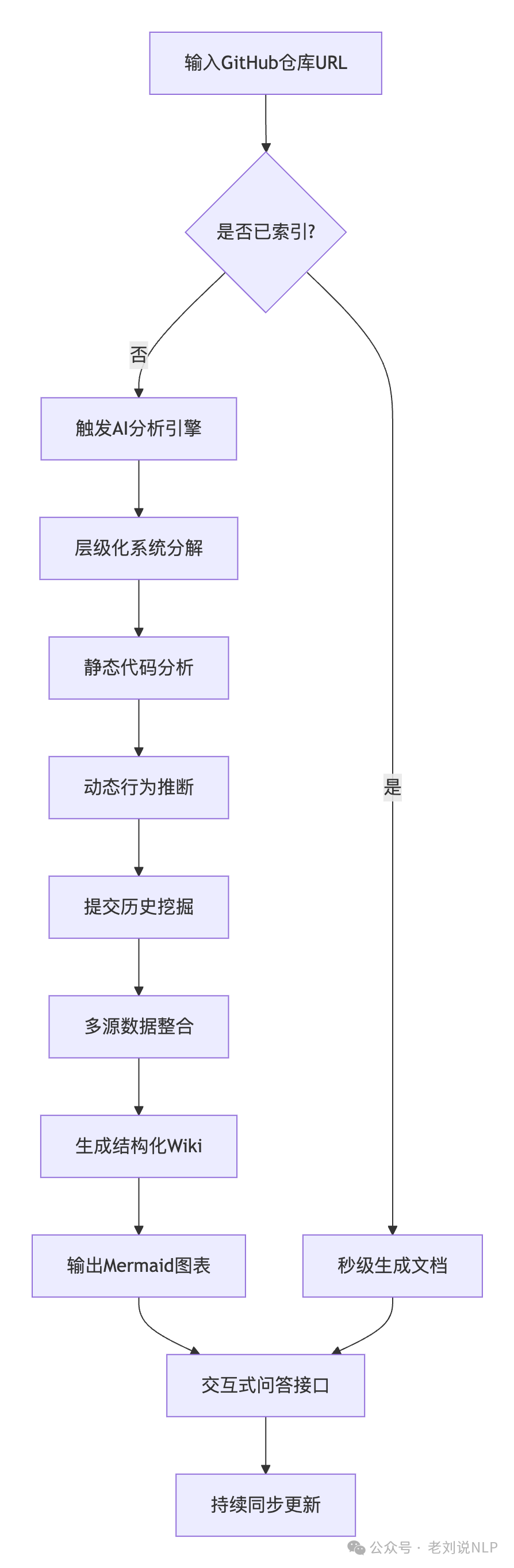

Cognition Labs推出DeepWiki项目,可为GitHub仓库提供AI驱动的实时交互式文档,通过层级化分解和提交历史分析来理解代码全局结构,已索引3万个仓库,处理超40亿行代码。实现流程图下:

进一步的,DeepWiki首先将复杂代码库分解为层级化的高阶系统结构(如前端、后端、数据库层),通过分析代码组织结构、模块依赖关系等,构建清层级架构。每个子系统生成独立的Wiki页面,形成类似于项目知识图谱的质量。

使用方式简单,将github.com替换为deepwiki.com即可访问对应仓库的AI文档,项目地址在:https://deepwiki.com/langchain-ai/langmem deepwiki,是阅读github的不错方式。

2、RAG框架进展Chatwiki

Chatwiki,基于企业私有知识库的智能客服机器人问答系统,为企业打造专属AI客服,解决客户咨询难题,支持20多种主流大模型,灵活适配企业需求,地址在:https://github.com/zhimaAi/chatwiki

可以看看其特点:

1、支持从上传的PDF、Word等知识库文档中自动提取内嵌图片,问答过程中当关联到含图片的文档内容时,同步返回文本与图片信息,实现图文关联回复;

2、基于语义分析自动生成猜你想问 推荐列表,也支持手动维护高频常见问题,结合用户历史交互动态优化推荐逻辑。

3、提供企业级多级权限控制,支持角色分配(管理员/编辑员/只读成员)。

4、提供自动分段、QA分段、手动输入和CSV等多种方式导入数据,自动对导入的文本数据进行预处理、向量化或QA分割。支持word文档、Excel文档、PPT、PDF、OFD、markdown文档等多种格式文档自动解析、智能分段。

二、DeepSeek-R1的一个有趣的实验模型

最近有个模型很有意思,DeepSeek-R1T-Chimera,基于DeepSeek-R1构建,并使用DeepSeek-V3-0324数据进行微调,通过融合DeepSeekR1和V3-0324 的优势,实现推理能力与效率的平衡。 https://upload.chinaz.com/2025/0428/6388143308830674716580098.png

地址在:https://huggingface.co/tngtech/DeepSeek-R1T-Chimera

在实现效果上,相比R1,Chimera的运行速度更快,输出标记数量减少40%。

在具体实现上,采用混合式架构,模型直接从V3和R1两种父模型的中提取、融合关键部分。

然后,

共享专家(Shared Experts)直接复用V3-0324的共享专家参数;

路由专家(Routed Experts)融合R1和V3-0324 的路由专家,部分参数可能采用加权平均(如 (R1+V3)/2)。

在Embedding层、Attention模块等复用V3-0324的权重。

(文:老刘说NLP)