今天是2025年5月12日,星期一,北京,晴。

我们今天来重点看看两个技术总结,分别是25个代表性大模型推理引擎对比总结,推理工程角度。

另一个是看多模态领域的推理进展,看评测数据和实现路径,会有些思路。

抓住根本问题,做根因,专题化,体系化,会有更多深度思考。大家一起加油。

一、25个代表性大模型推理引擎对比总结

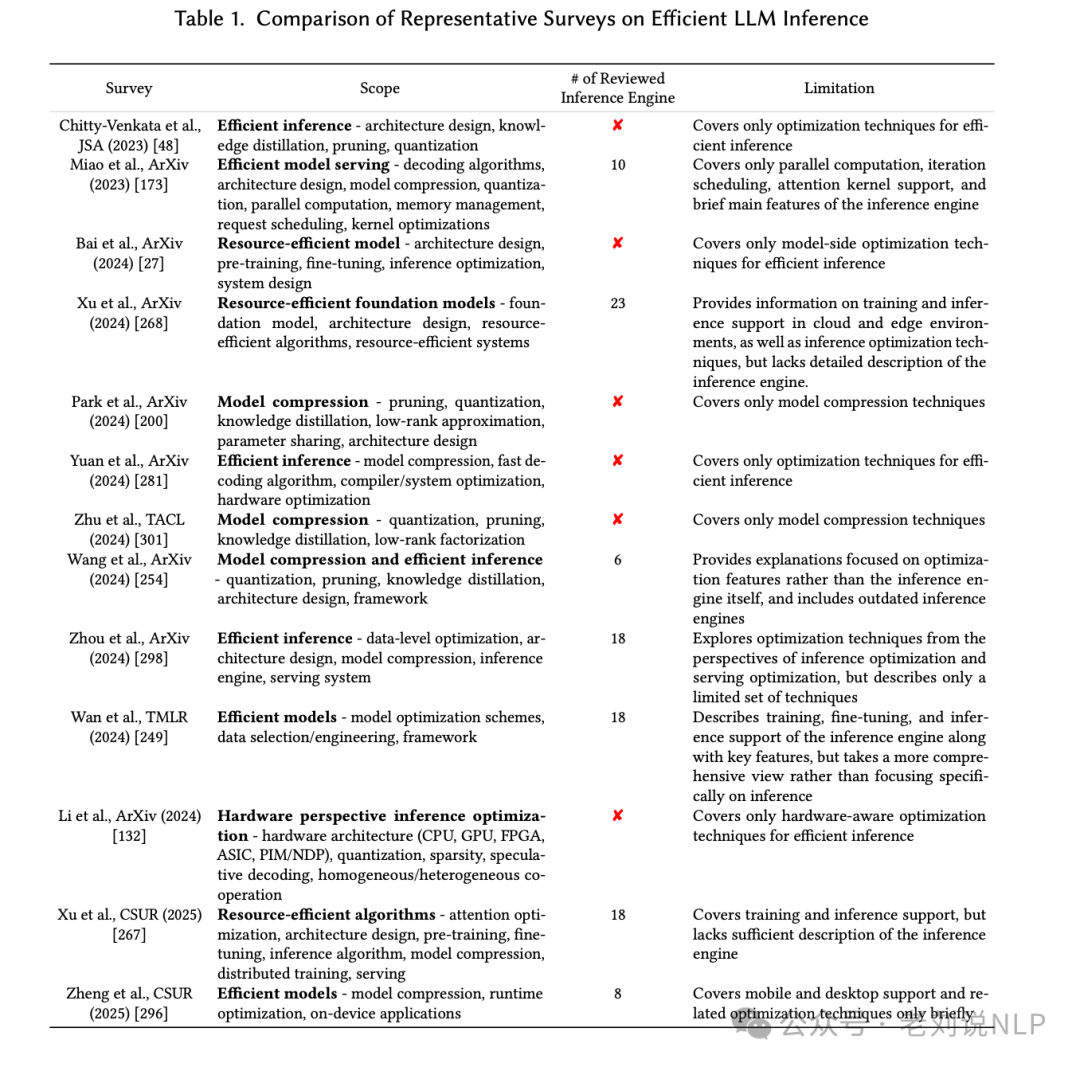

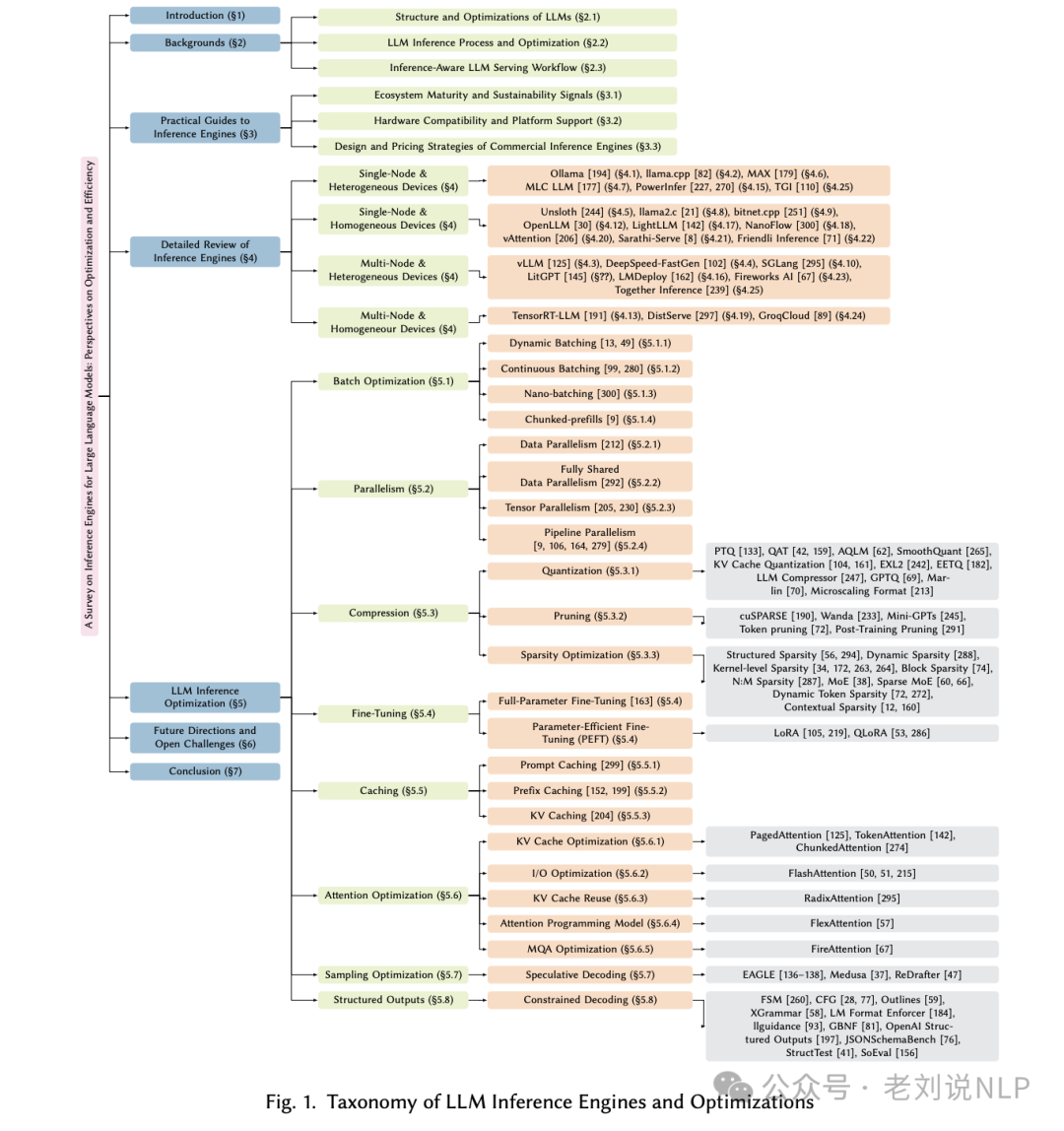

大模型推理引擎进展,《A Survey on Inference Engines for Large Language Models: Perspectives on Optimization and Efficiency》(https://arxiv.org/pdf/2505.01658),对25个主流LLM推理引擎进行多维度评估和优化技术梳理。

可以重点看几点:

1、过去已有的大模型推理引擎总结

2、 LLM推理引擎的优化方案分类

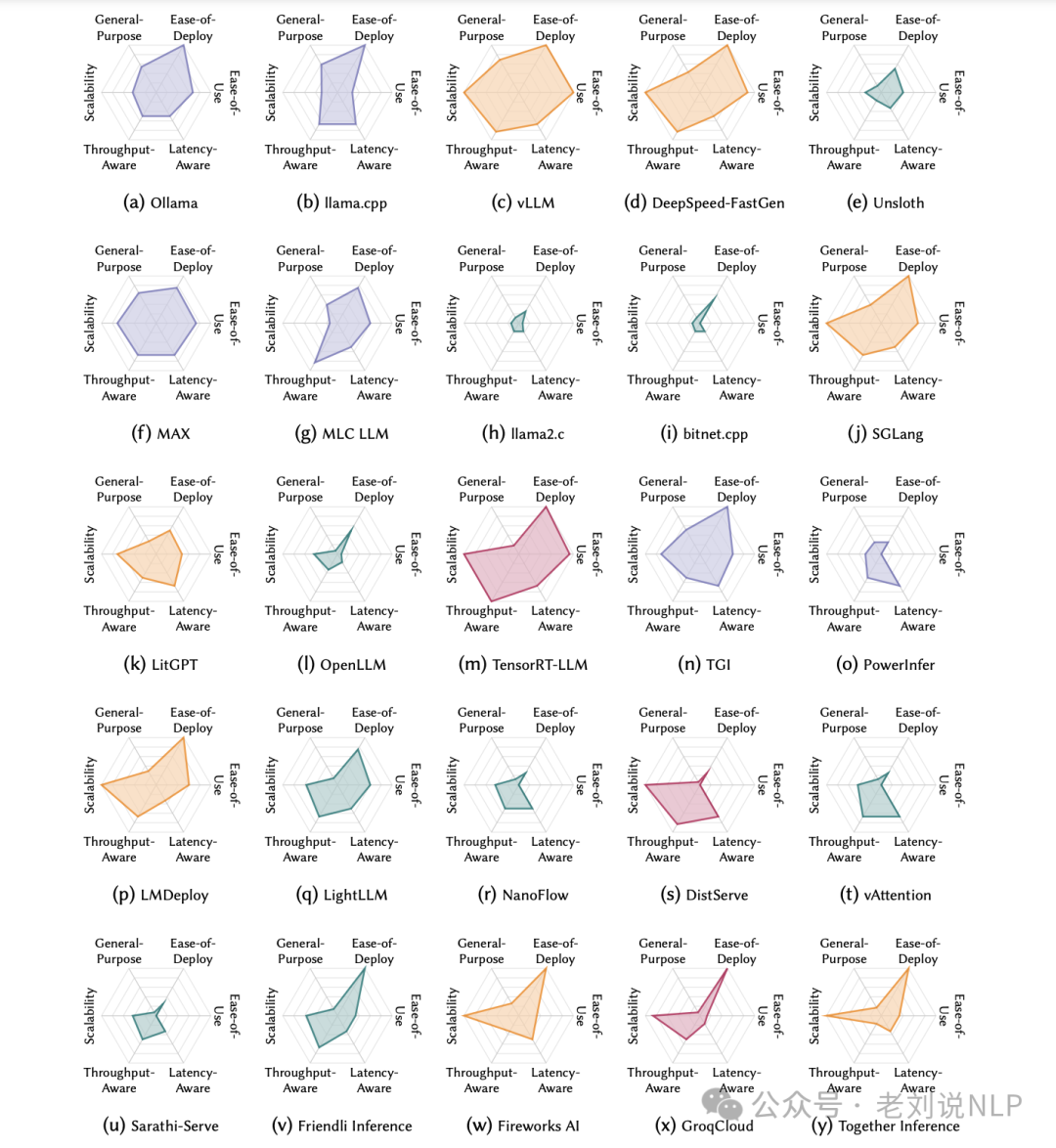

3、六个维度下LLM推理引擎的代表性特征比较:模型通用性、部署和使用的便捷性、延迟和吞吐量优化以及可扩展性

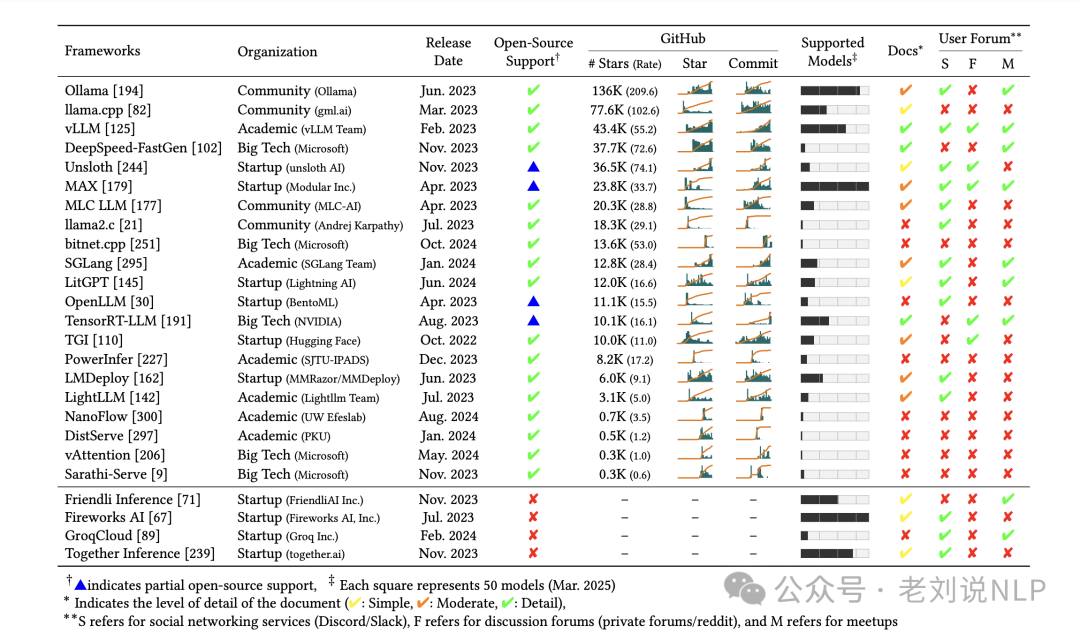

4、25个LLM推理引擎的基本情况比较,比如Github信息、发布机构、发布日期、支持模型等。

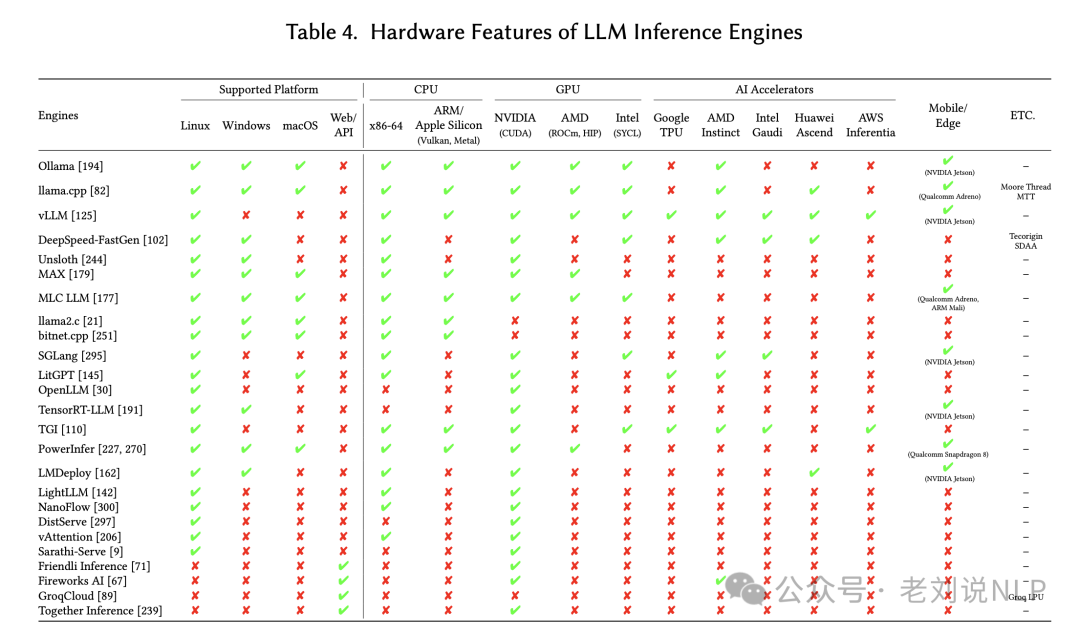

5、25个LLM推理引擎的硬件支持对比

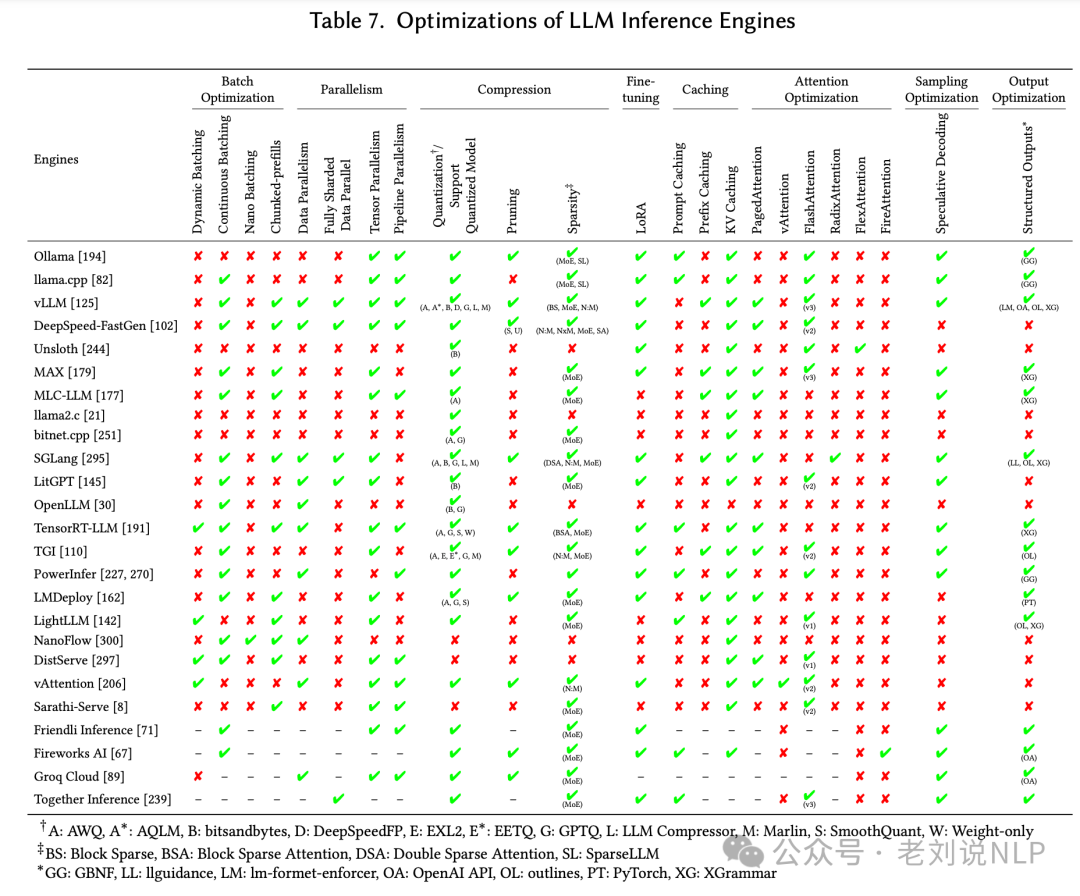

6、25个LLM推理引擎的优化策略对比

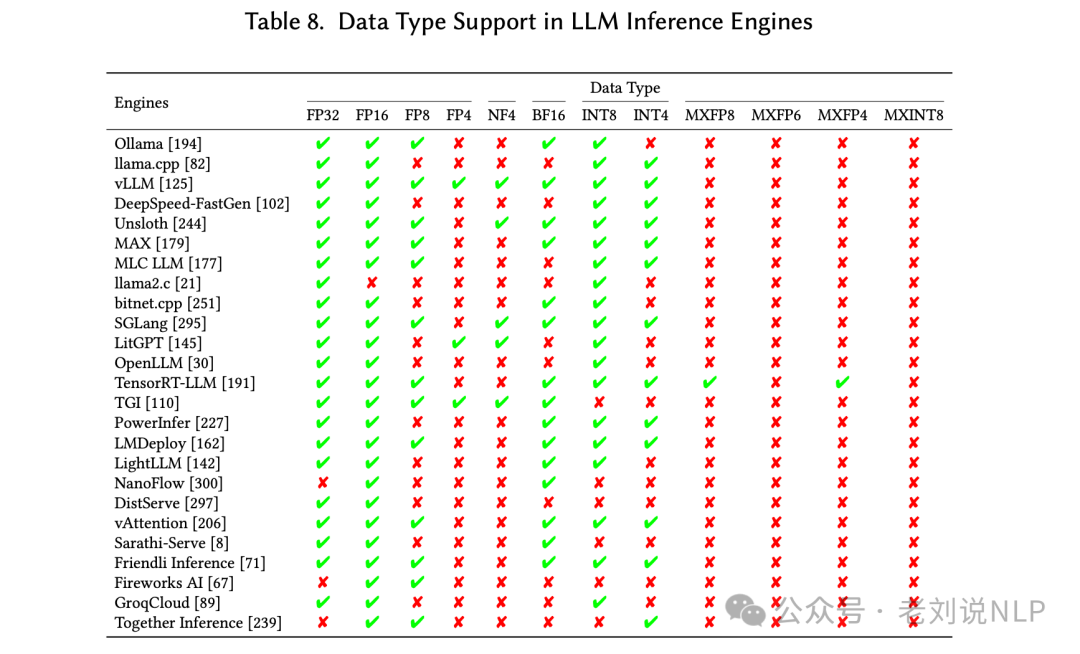

7、25个LLM推理引擎的数据类型支持对比

这些对比结论,对我们进行工程架构设计和使用选型都是有直接帮助的。

二、多模态推理大模型技术总结

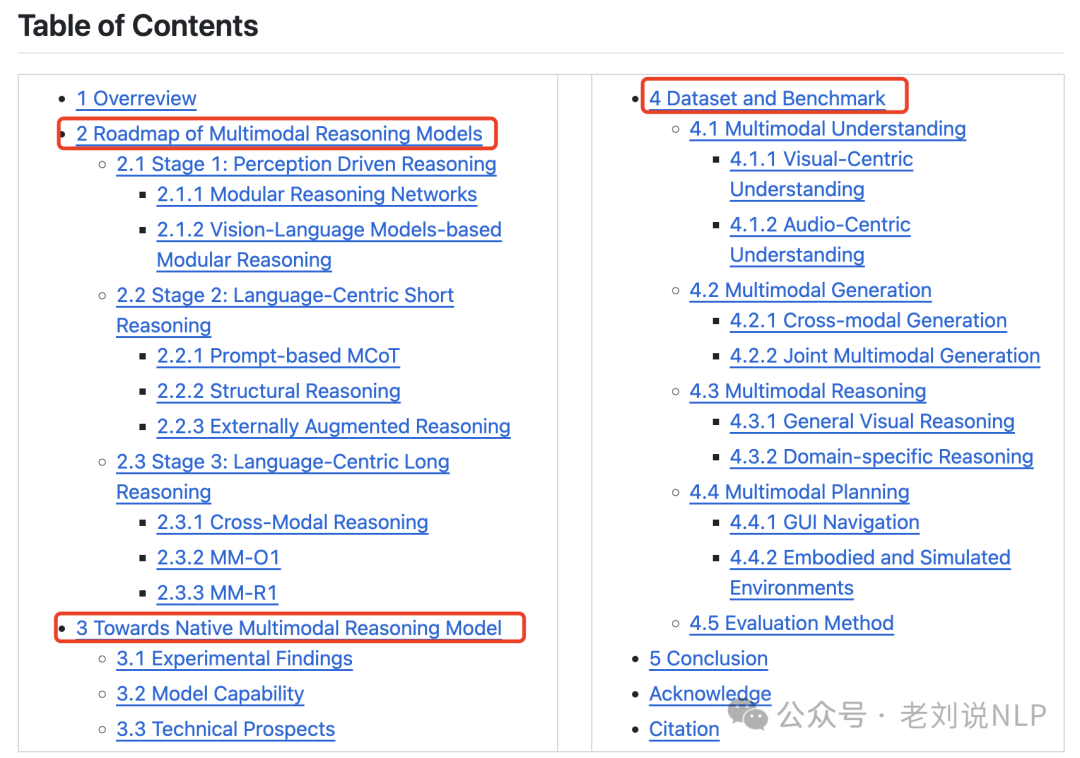

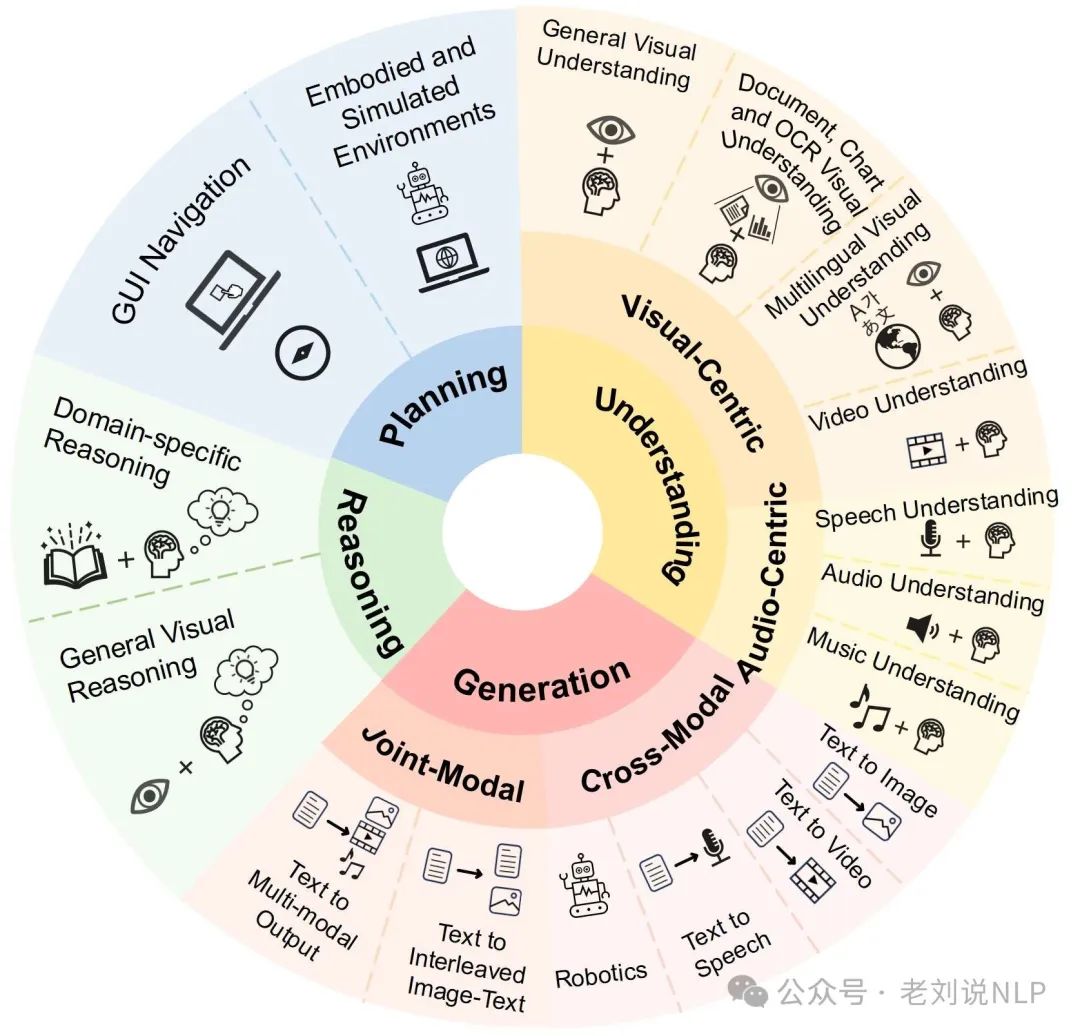

继续看推理技术总结,《Perception, Reason, Think, and Plan: A Survey on Large Multimodal Reasoning Models》,https://arxiv.org/abs/2505.04921,https://github.com/HITsz-TMG/Awesome-Large-Multimodal-Reasoning-Models,分析了550多篇论文,从基础到前沿的多模态模型,总结数据集和基准测试,总结的还是蛮好的,值得看看。

核心看几个信息点。例如:

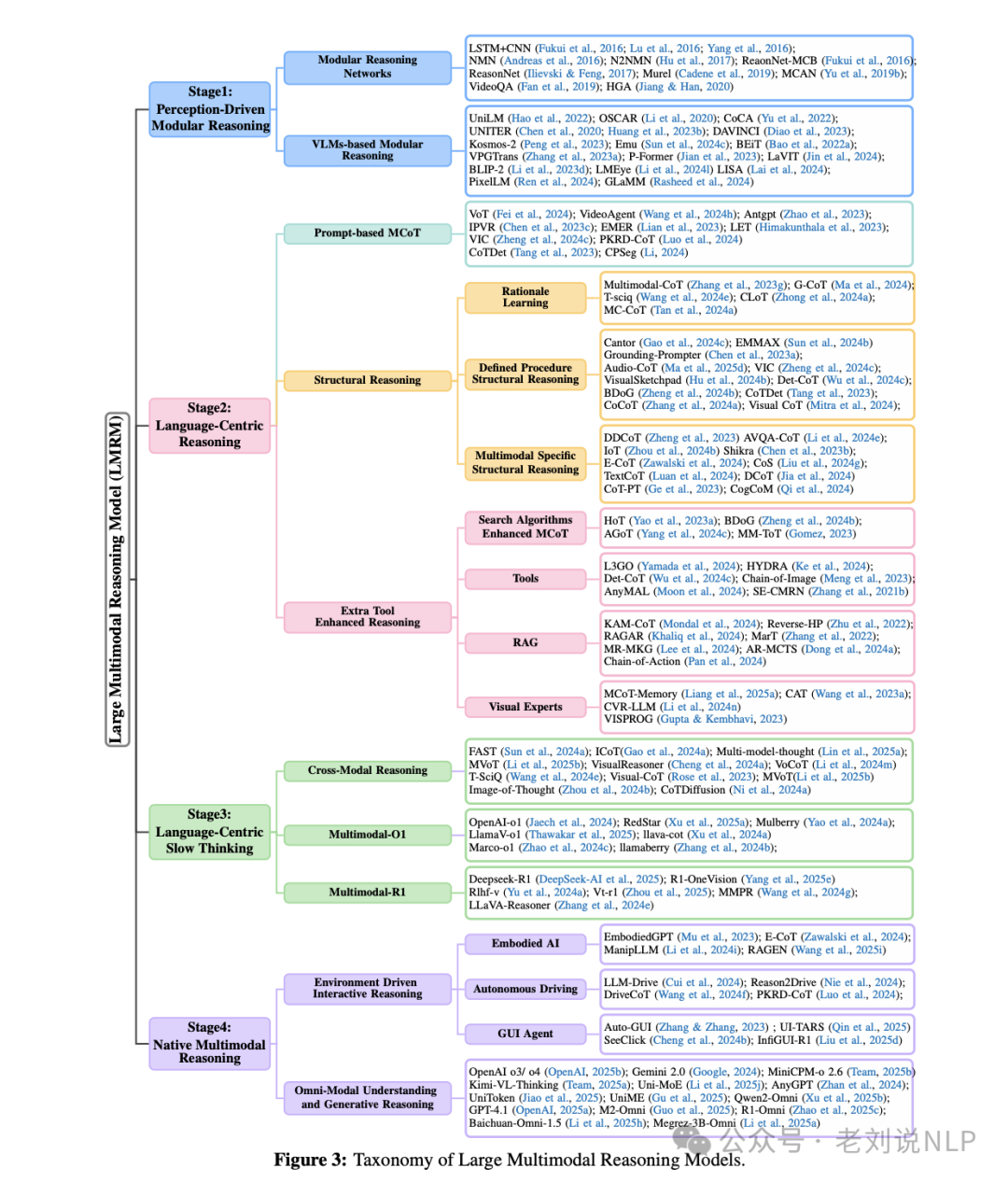

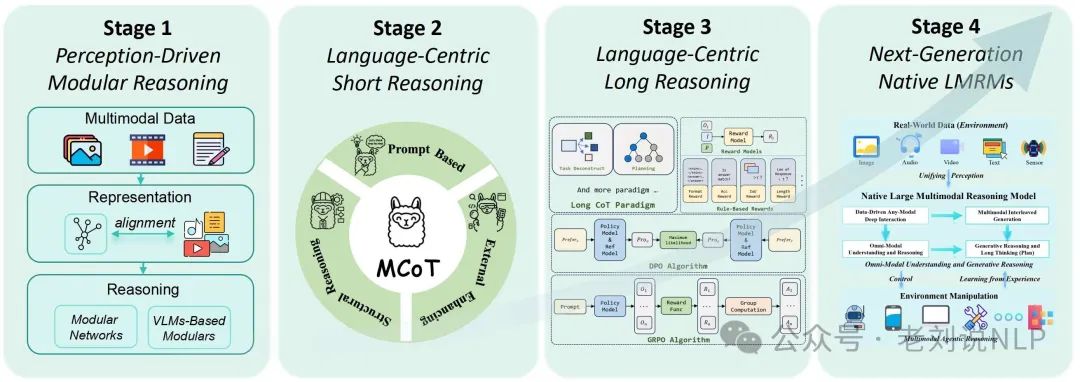

1、多模态推理模型的核心发展路径,4个阶段

例如,第一阶段感知驱动推理,开发特定任务的推理模块。例如,通过分层跨模态注意力将问题语义与图像区域对齐。

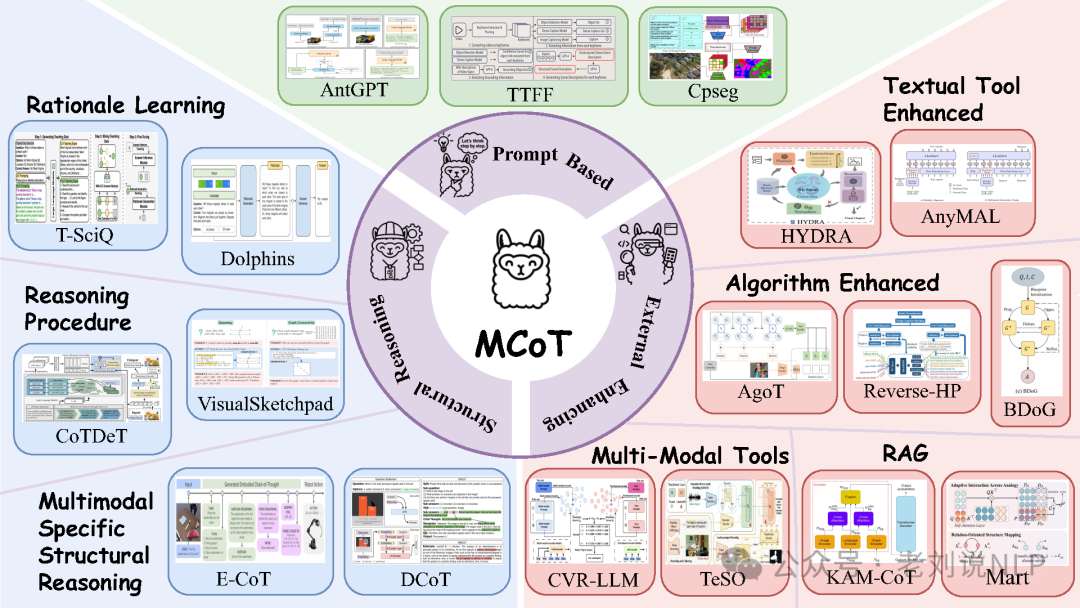

第二阶段以语言为中心的短推理,将现有方法分为三种范式:基于提示的MCoT、基于预定义模式的结构化推理以及利用轻量级外部模块的工具增强推理。

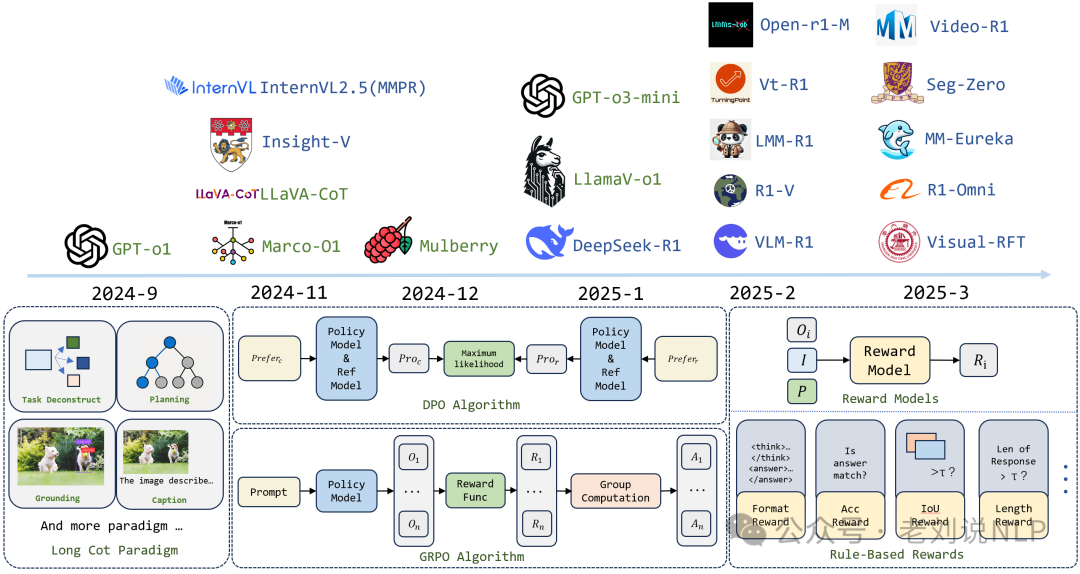

第三阶段通过扩展推理链,将其置于多模态输入中,并使用监督或强化信号进行训练。

并且对未来的形态的设想:

2、对应的数据集和评测集

参考文献

1、https://arxiv.org/pdf/2505.01658

2、https://arxiv.org/pdf/2505.01658

(文:老刘说NLP)