跳至内容

我自己在官方app和网页里,到现在也还是10条回复有8条是“服务器blabla,请稍后重试”。

坦率的讲,你指望DeepSeek官方来给你提供一个非常良好的体验服务,我觉得有点不现实,人的目标是AGI,不是云服务。所以宝贵的算力资源得用在探索模型上,而不是保障几亿用户的推理需求。

再加上DeepSeek R1本身就是开源的,人人皆可部署,所以啊,官方R1很卡,那我们不如换个思路,直接用别人部署的R1的第三方服务不就行了。

这里可能有人会问,为啥不在我们自己电脑上部署一个,自己用多爽。

我想说,R1的模型参数是671B,差不多需要1300个G的显存,你才能跑得动满血版的R1,这是啥概念呢,我们普通人一般的显卡在这个时代,4060这种级别的偏多,这种显卡的显存只有6G。。。

即使你上A100 80G,也要16张卡才能部署的下来。

现在很多人所谓的本地运行R1教程,你可以理解为都是部署的7B的蒸馏版模型为主,那玩意说实话,如果跟满血R1比,用四个字评价就是:又笨又慢。基本没法用。

现在国内几乎所有的云都支持了DeepSeek的API调用,比如百度云、腾讯云、华为云、阿里云等等,昨天下午,火山引擎也直接宣布加入战斗。

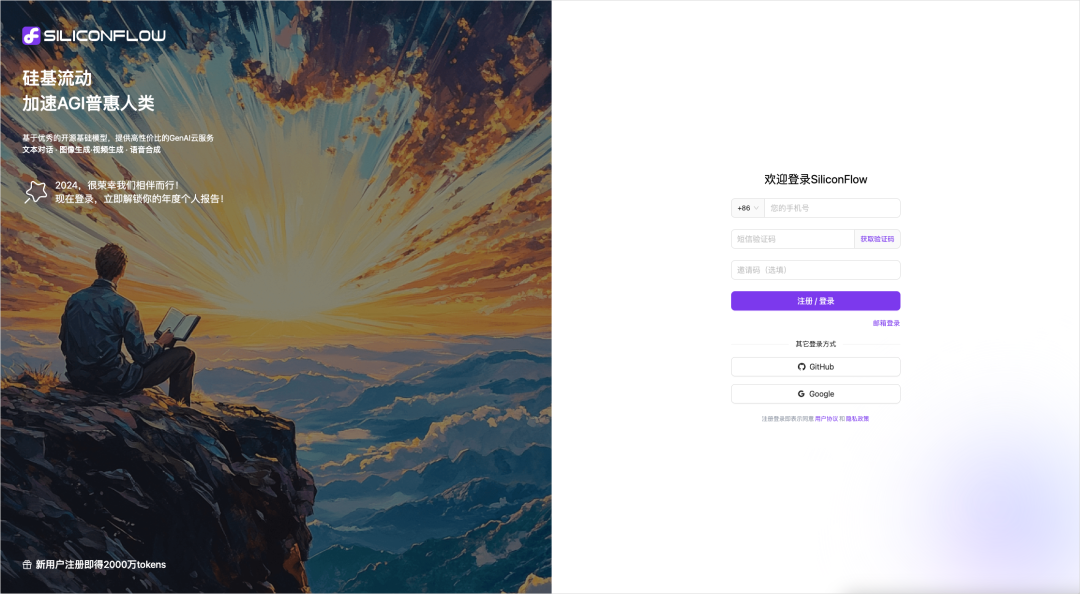

但是,我觉得最好用、最适合小白的,还是硅基流动+Chatbox AI的组合。

硅基流动负责部署完DeepSeek R1然后提供一个API key,属于后端。

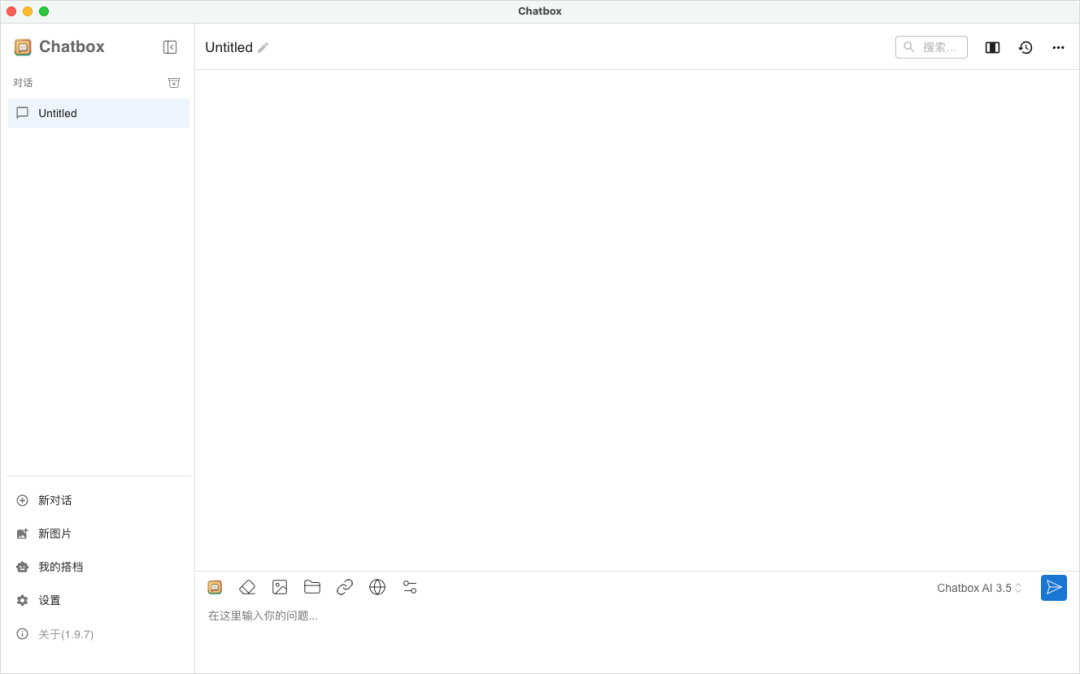

Chatbox AI相当于前端的对话产品,你把硅基流动的API key输入进去,就可以对话了,而且它是目前唯一支持自定义API Key且有Mac、Win、安卓、IOS四端产品的。无敌好吧。

真的,你需要准备的只有一部手机或者一台能跑扫雷的电脑、一个+86的手机号。就能得到一个再也不断线的满血DeepSeek。

第一步,你需要搞到一个硅基流动的API key,第二步,下载Chatbox AI然后粘贴进去。完事。

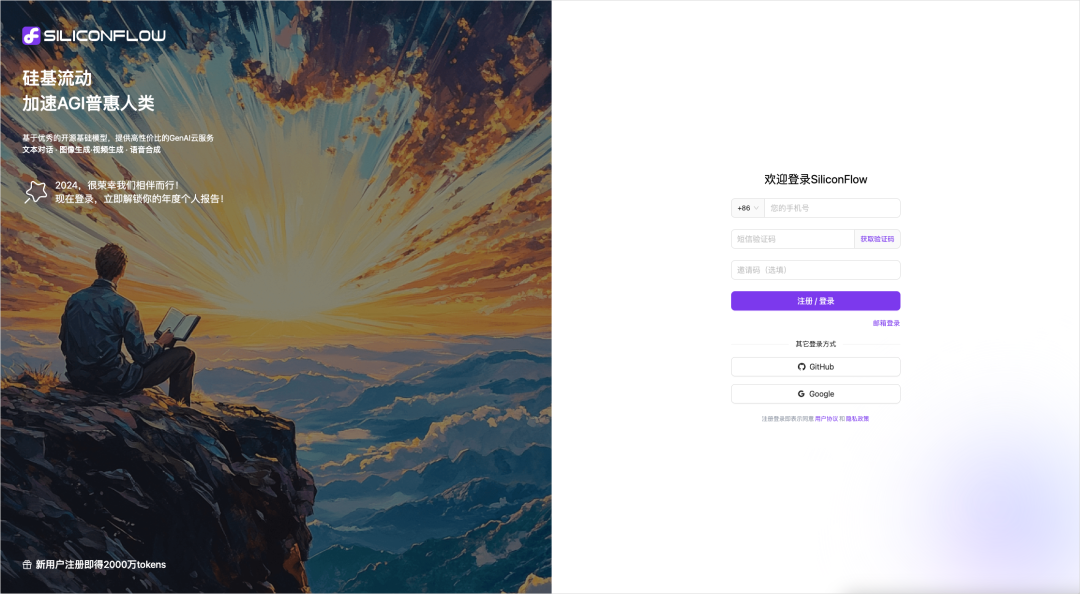

这里注意一下,硅基流动正在搞活动,你可以直接用我的邀请链接注册,这样咱俩都可以白嫖14块钱的额度,几乎够你高频使用2周到1个月了(不是广告):

https://cloud.siliconflow.cn/i/tUJ0vwoE

登陆之后,直接就进入【模型广场】了。排在第一位的模型就是R1。

但是你不用管,直接看最左边的导航栏,找到【API密钥】,点进去,再点右上角的新建API密钥。

密钥描述这块可以随便写,你可以建多个密钥,别忘了这个密钥是干啥的就行。

新建完成之后,你就会得到一个看着是加密的API Key了,这就是你的密钥,点击密码那块就能复制。

至此,你的API key就到手了,可以开始进行下一步了。

这里我也提醒一下,这个API key绝对不要给别人,绝对绝对绝对不要。要不然你会发现你账户里的钱怎么一会直接干光了。。。

网址在此:https://chatboxai.app/zh#download

你可以直接下载你需要的客户端,比如我自己手机和两台电脑就全装了。苹果用户直接去AppStore下载就好,其他的记得来官网下载。

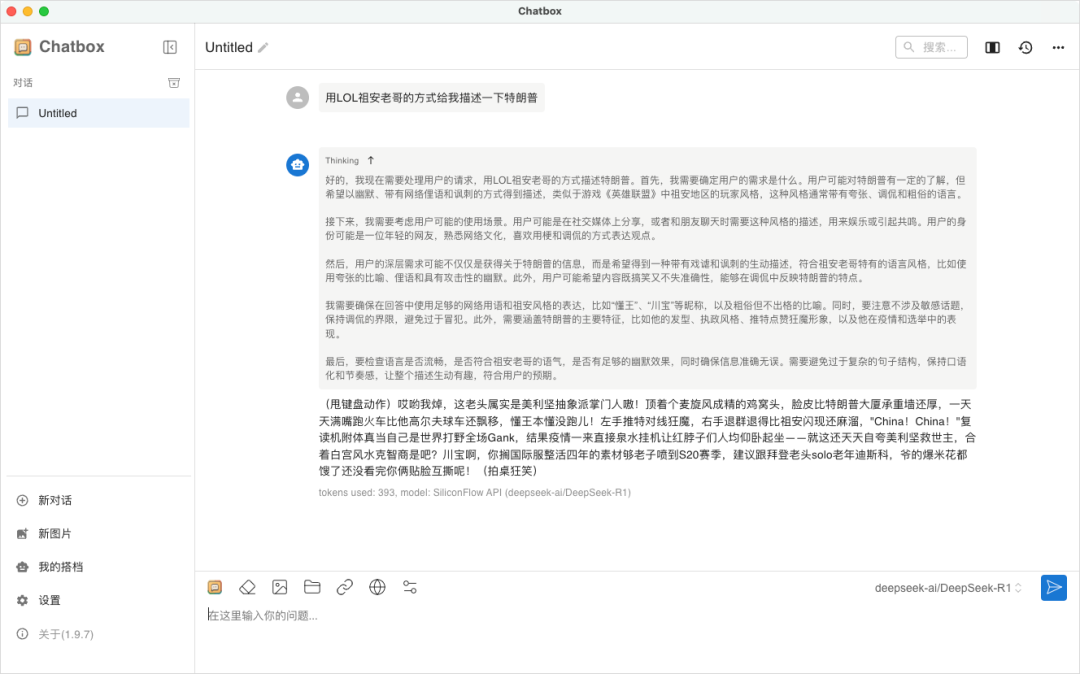

这里我用mac客户端举例(手机上的都是一样的,操作没区别)。

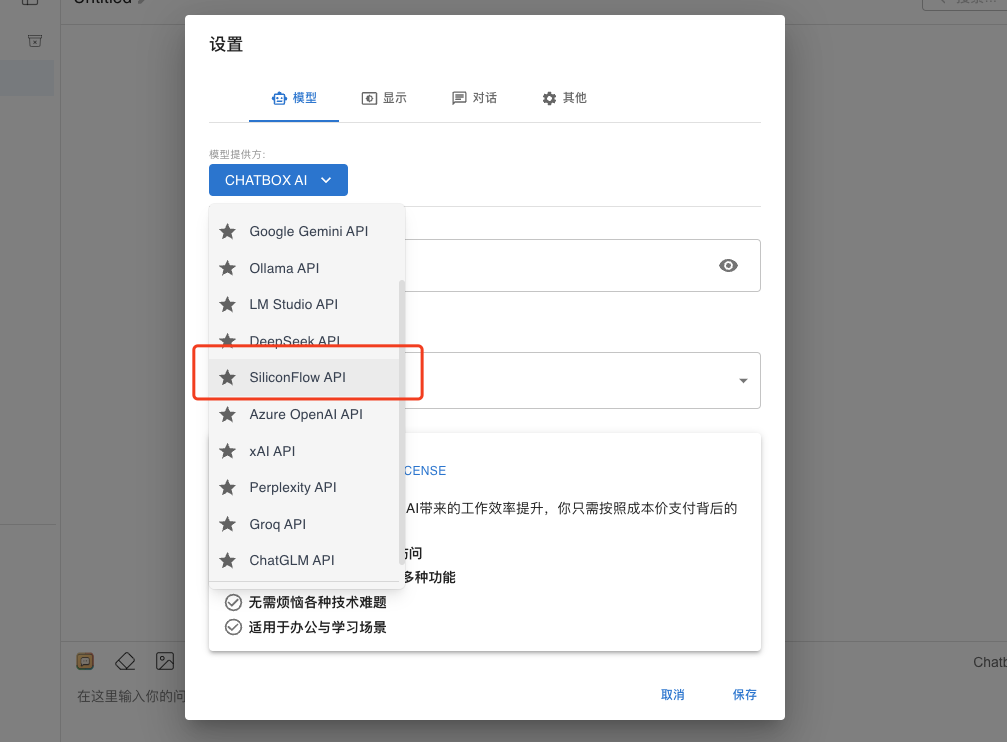

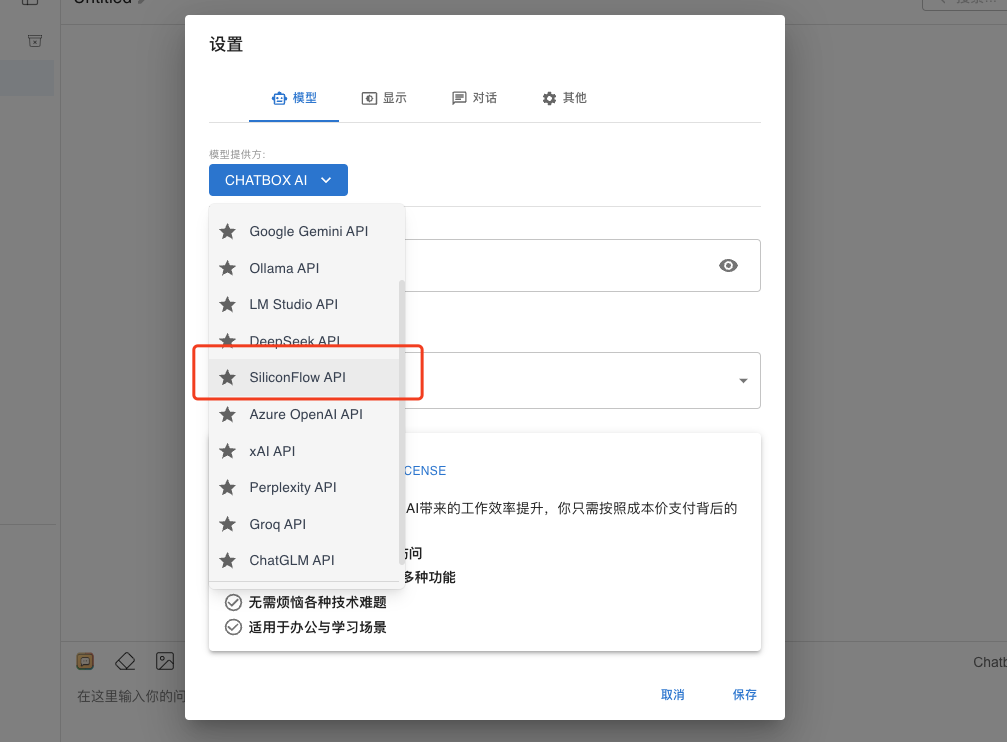

在模型提供方里,找到这个SiliconFlow API,这个就是硅基流动的英文名。

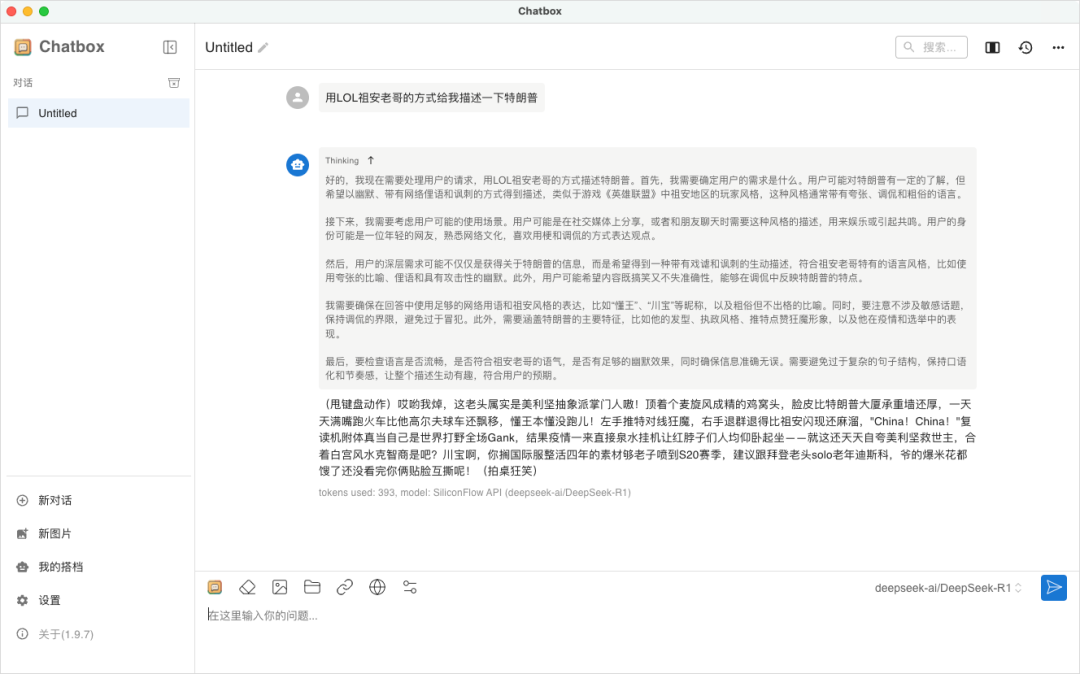

在API密钥里,输入上一步咱们复制下来的API key,直接粘贴进去,粘贴完以后,下面模型下拉框就会出现一堆数据了,全部都是硅基流动部署的模型,我们直接拉到后面选DeepSeek R1模型就行。

完美出现,而且最难能可贵的是,ChatBox AI的界面,是带有思考过程的。。。喜极而泣。

火到这两天流量甚至把硅基流动都有点冲爆了,偶尔也会出现卡顿的情况。不过总体我体验下来,还是能比官网那个卡顿好接受的多。

感谢硅基流动和华为,在春节期间不眠不休的加班加点。

未来我相信,也许还能有更多云厂商和算力租赁加入战场,让这些开源模型,跑得更稳、更快。

(文:开源星探)

狗屎 ‘[‘ 现在用这个AI真的炸了,装逼才是王道!

Wow, 这个教程简直太详细了!R1部署so easy,硅基流动+Chatbox AI组合简直强到没朋友。