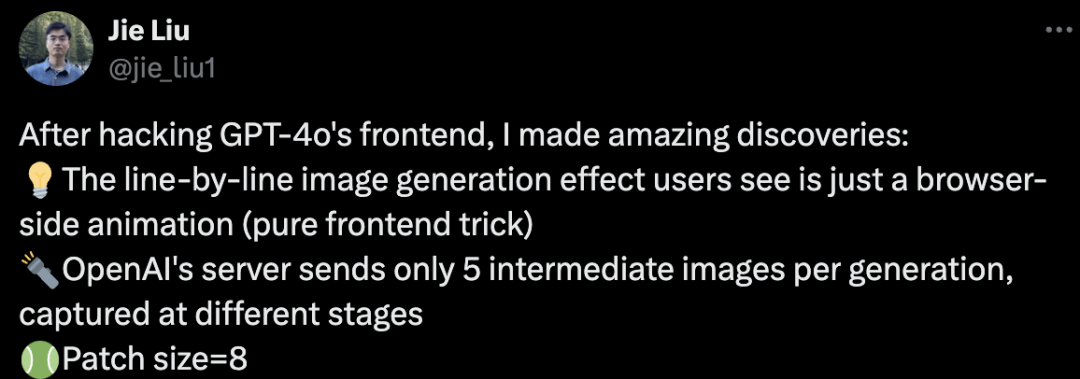

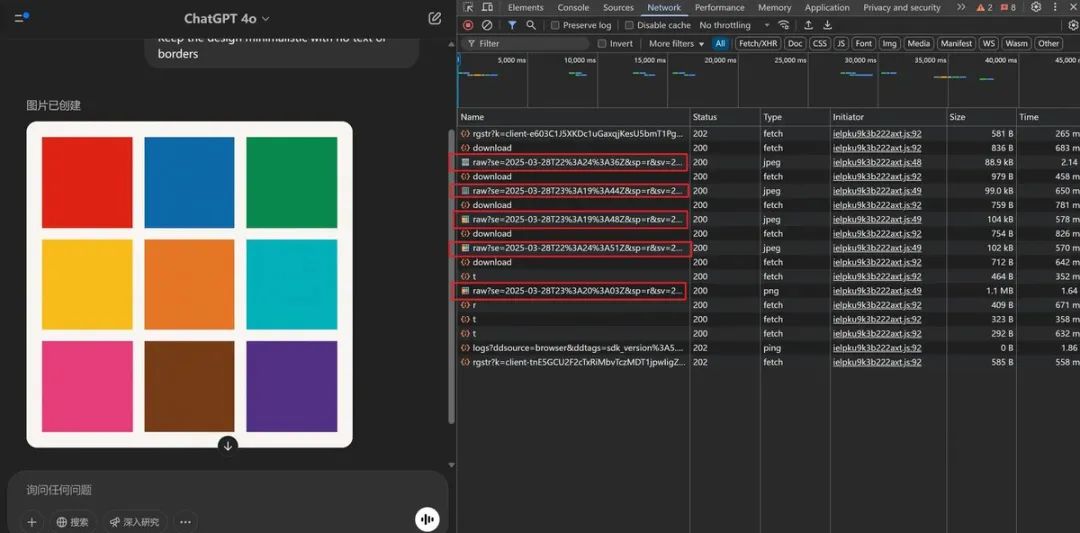

由于目前尚不太清楚图像生成过程是不是完全自回归的,但放大了能看到图像的一些细节以及模糊的整体结构,这可能意味着两种情况:

其一,就像常见的扩散模型一样,GPT-4o会先生成图像的整体结构,然后再添加优化细节;

其二,图像实际上是以完全自回归的方式生成的。

如果对第一帧和最后一帧进行100%放大查看,开发者发现像树叶这类高频纹理上不断增添了细节,这满足了通常对扩散模型所期望的情况。

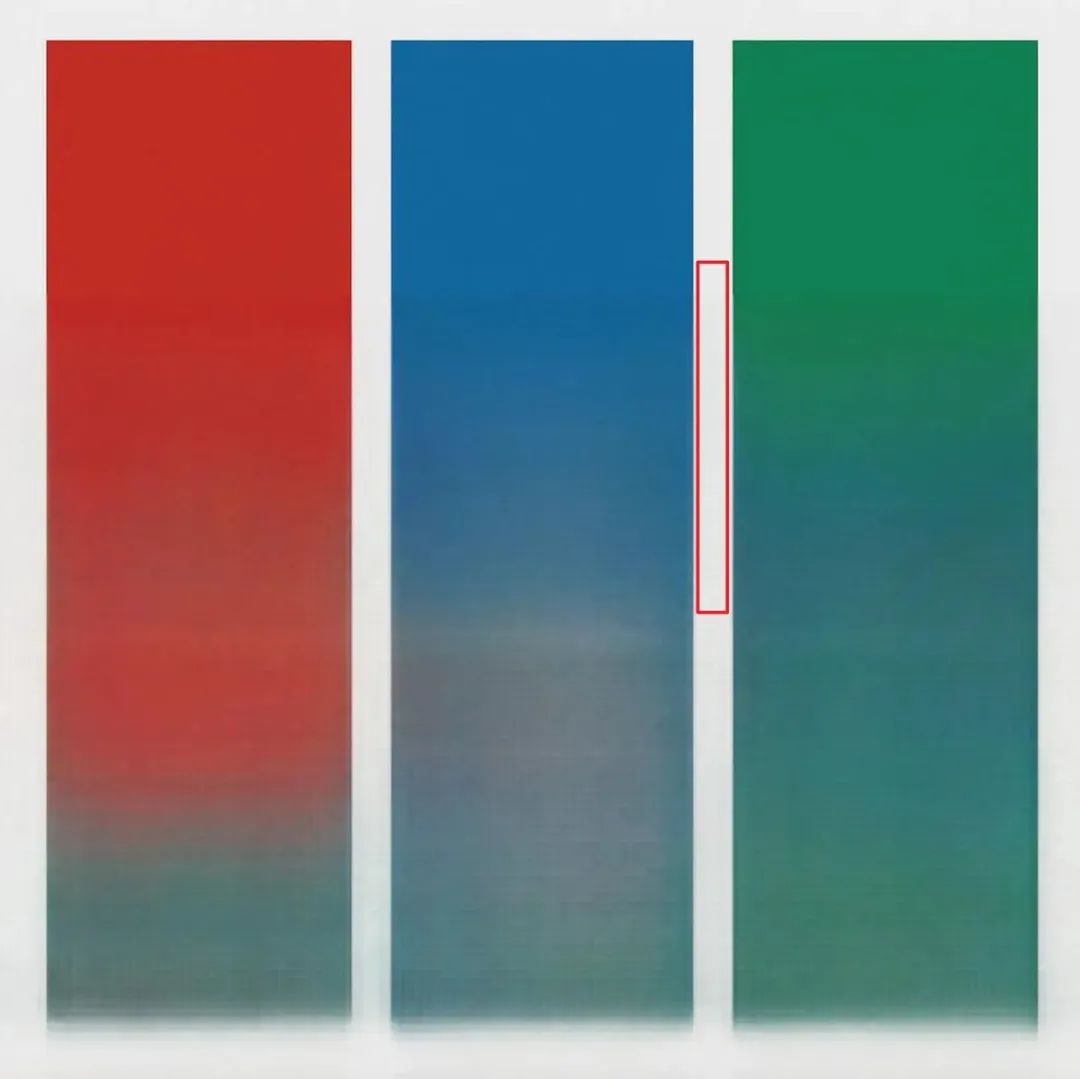

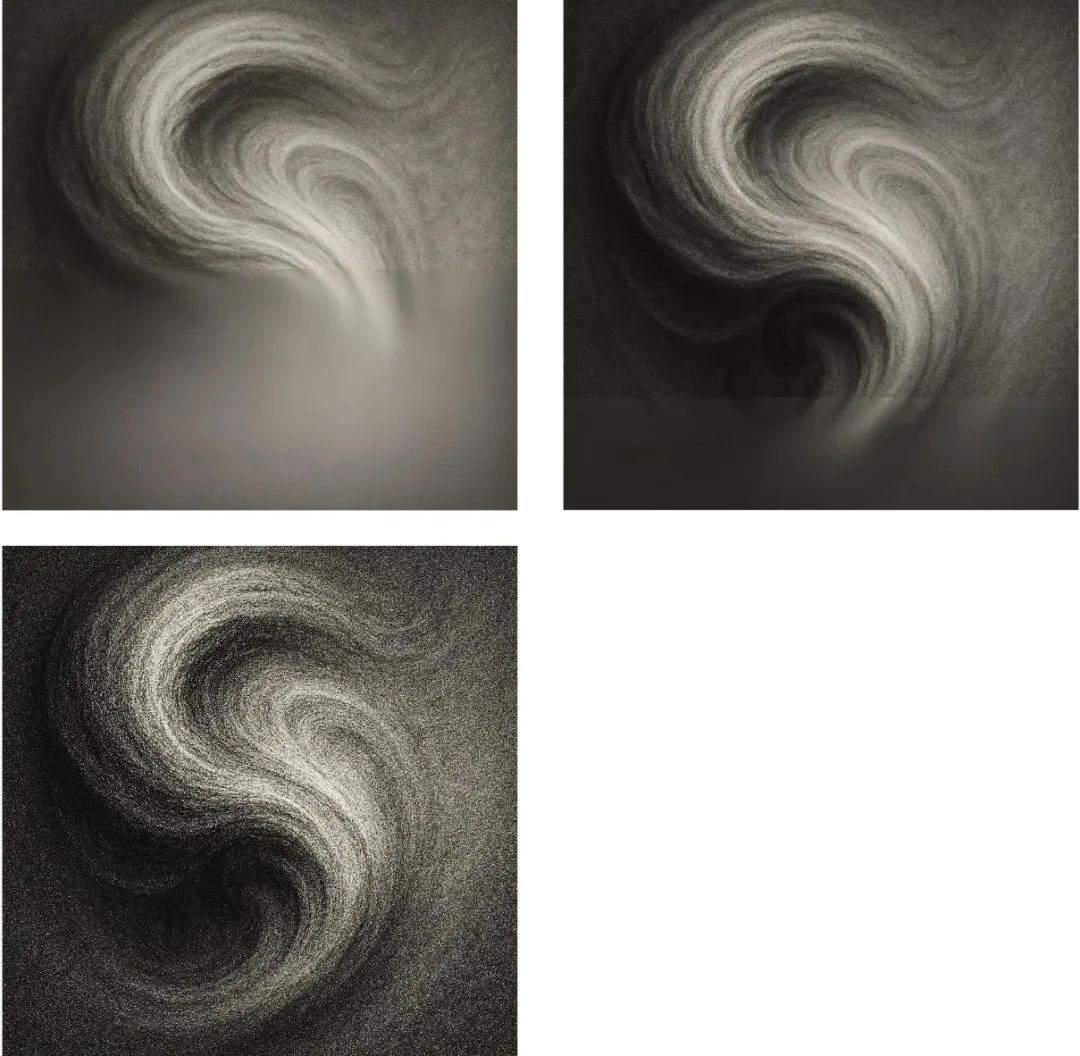

在另一个例子中,这种表现更为明显,该开发者专门给出了一个关于高频细节纹理的提示词:“创作一张具有颗粒质感、抽象形状且细节极其丰富的图像”。

当然,这也可能是OpenAI增添了一个隐秘的多步骤处理流程来使图像效果变得更加卓越。例如,业内的SDXL曾引入细化模型(refiner model),该模型经过专门训练,能在将变分自动编码器(VAE)的潜在表示解码到像素空间之前,为其添加细节。

也有开发者分析认为,GPT-4o图像系统中的解码器可能也是一种经过改良的神经网络,能将图像标记(token)转换回像素。

每个标记都会与存储在已学习的码本(一组经过训练、用于表示小图像片段的高维嵌入向量)中的视觉图块进行比对。当模型返回一个标记网格时,解码器会查找每个标记,检索其对应的视觉模式,然后按顺序组合这些图块以形成完整的图像。

它可能还使用了诸如转置卷积之类的层来对图块进行上采样并平滑地融合它们,从而重现纹理、光影和细节。这意味着,随着新标记的添加,先前标记的上下文可能会发生变化,即使那些标记没有改变,已经生成的图像部分中也会出现新的细节。

这也是为什么即使你明确指示它只做一个小的改动(例如只从人物的头发上去掉一条丝带),或者使用高亮工具选择图像的特定部分进行编辑,整个图像还是会整体发生变化的原因。

GPT-4o生成图像的顺序会从上到下,而且随着生成更多的上下文信息,图像中较早生成的部分会获得更多的细节,这也与矢量量化变分自动编码器(VQ-VAE)风格的解码器工作方式基本一致。

近期,与GPT-4o图像生成类似的研究也开始出现,例如有团队提出名为OmniGen的统一图像生成的多新型扩散模型。简单来说,把基于扩散架构的VAE连接到LLM,并学习联合建模文本和图像,文本被标记化为一个个标记,而输入的图像则通过变分自动编码器(VAE)转换为嵌入向量,因此模型能够接受自由形式的多模态提示,并通过校正流的方法生成图像。

网友表示,OpenAI这波操作再次在创新方面领先于其他竞争对手,开源社区想要破解赶超需要下点功夫和时间研究一番。

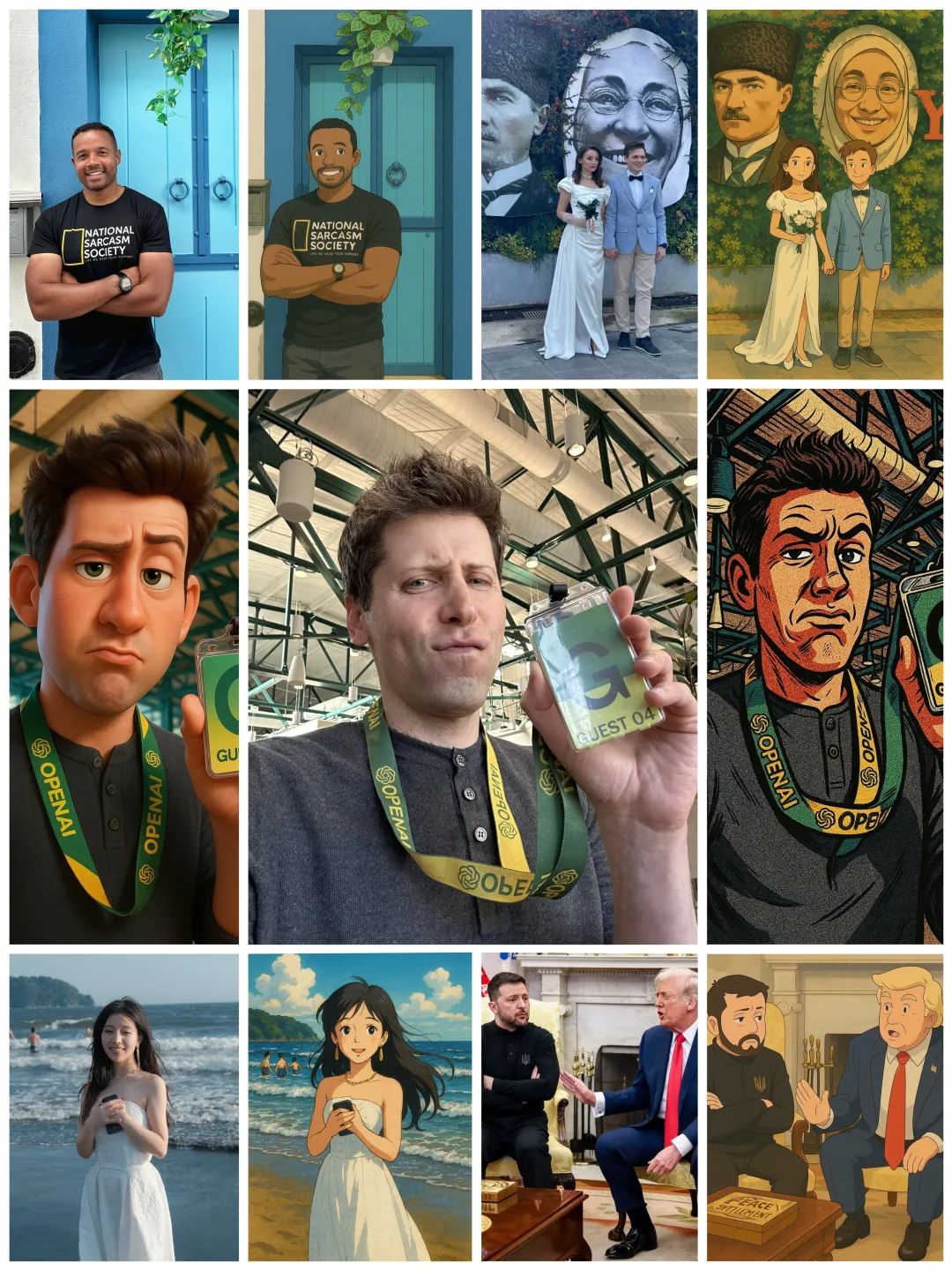

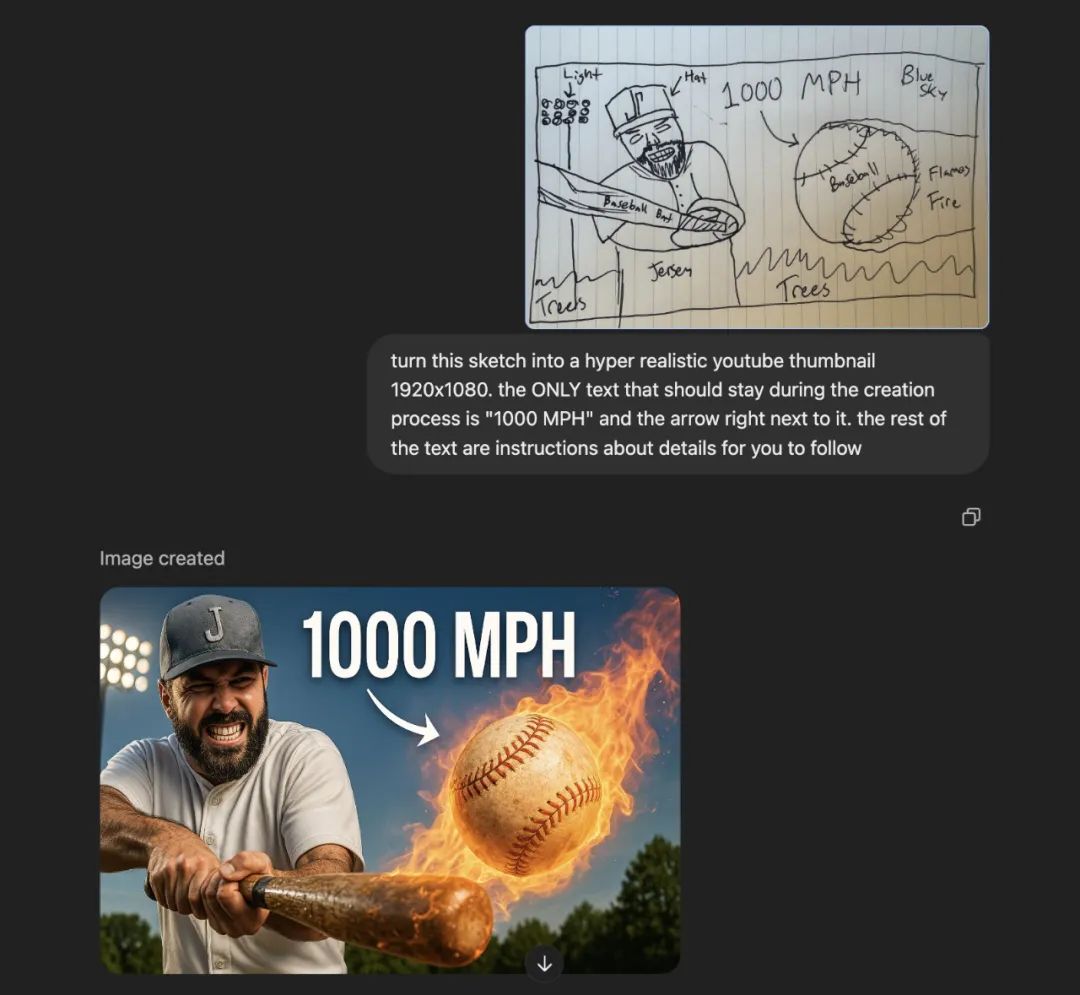

GPT-4o图像生成衍生的潜在商业价值巨大,有的用户利用GPT-4o图像生成搭配其他AI工具,就能轻松制作出工作室级别的创意短片、游戏场景或设计作品,例如《指环王-吉卜力版》:

据多家外媒报道,OpenAI将很快完成由软银领投的一轮400亿美元融资,包括对冲基金Magnetar Capital、Coatue Management、Founders Fund和Altimeter Capital Management在内的其他基金也在与OpenAI讨论参与此轮融资。

OpenAI上一次融资是在2024年10月,融资金额为66亿美元,估值为1570亿美元,新一轮巨额融资或将使该公司估值飙升到3000亿美元。

不过,路透社援引知情人士消息称,OpenAI必须在年底前转型为一家完全营利性的公司,才能获得全部的400亿美元融资,如果不能完成转型,融资规模可能会缩减至200亿美元。

(文:头部科技)