叮!150没了,Claude Pro 上线!

先是1800的 Gemini Ultra、又是设计 Agent Lovart、无限 Agent Neo、办公 Agent Skywork。

Claude4 能不能对我的钱包友好一点,

好消息是这是 Anthropic(发布 Claude 模型的公司) 第一次开发布会,

不会像之前发布3.5的时候,凌晨四五点丢个链接出来就美美隐身了,

还以为是全员i人,不想说话,实际上是憋坏了,在囤大招呢,这次发布会就足足聊了100分钟,够 OpenAI 开5次发布会了。

坏消息是看多了 OpenAI 那种几个人围在一起嘟嘟嘟的发布会,这种一大堆 PPT还有采访环节的发布会是越看越困。

不死心的我还看了两遍,然后决定正式声明一下:

这个发布会真的没必要看,是我上半年看过最无聊的发布会了,没有之一。

本着来都来了,我还是将发布会压缩成三个点,剩下的都可以丢垃圾桶:

Claude4、Claude Code和Claude API。

并且都实际测试一下!🔗 claude.ai

01|Claude4

还是先来看看发布会为数不多的有用时刻吧,

上来先是秀了一波友商肌肉,Manus 排在了第一位,

然后,就没有一丝要把惊喜放在最后的想法,

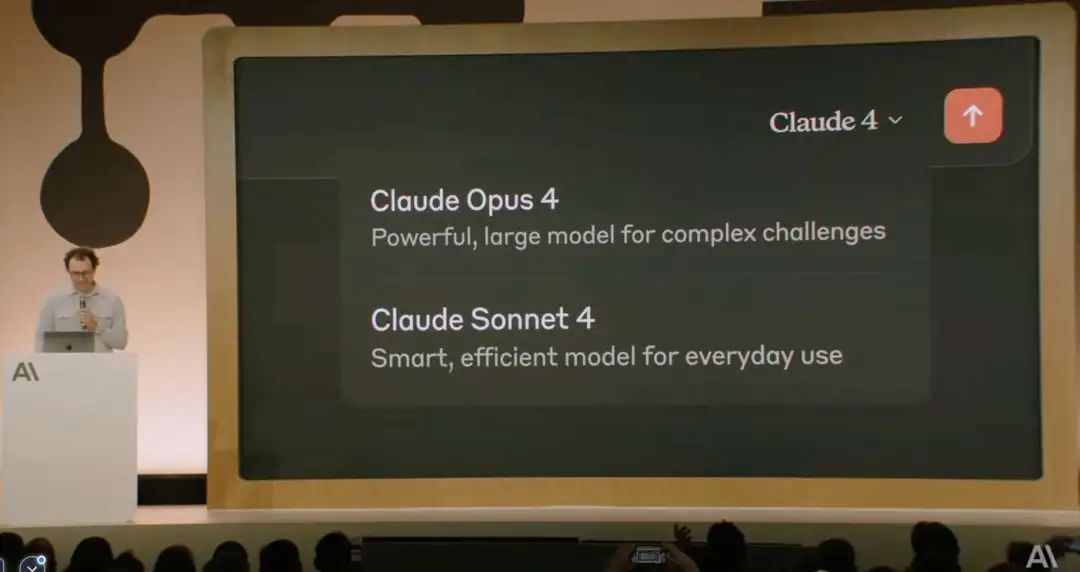

Claude Opus4、Sonnet 4就被放出来了。

幸好这次不是叫 Claude 3.7.1,延续了上一代3.7,Opus4 和 Sonnet4 都是混合模型,可以提供快速响应和深度思考。在思考过程中可以同时使用多个工具。

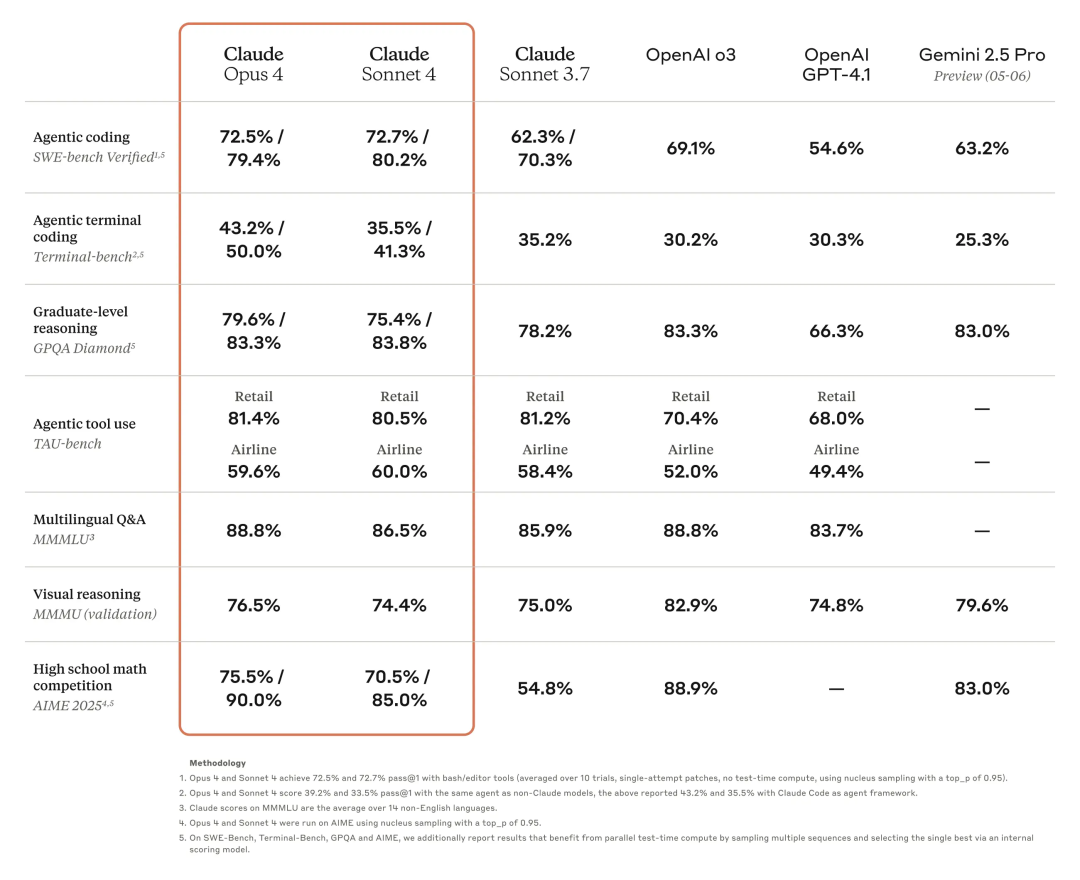

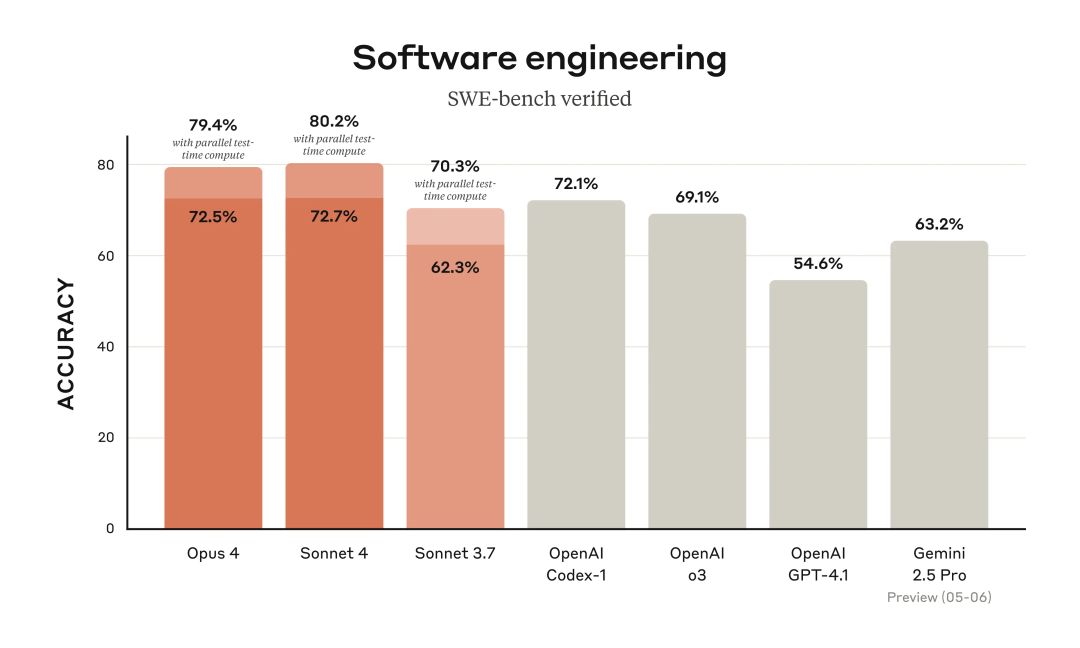

从得分上看,Opus4 在编程、多模态问答、数学等多个方面都超过了上一代版本之子Claude 3.7 Sonnet、OpenAI o3、GPT-4.1 和 Gemini 2.5 pro。

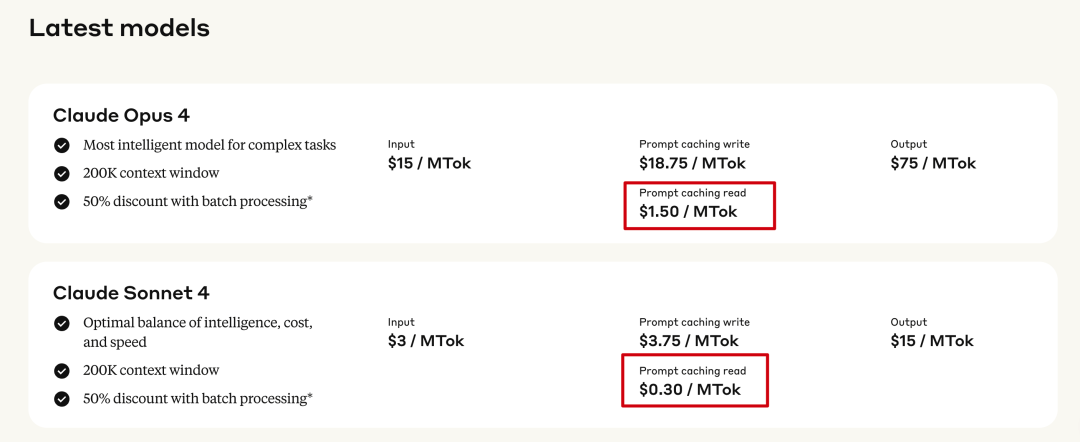

至于 API 的价格跟上一代保持一致,

Opus4 为每百万token(输入/输出)3/15。

除了常规的性能提升和 API 环节,这次的 Claude4 还能请外援。当被允许访问本地文件的时候,Opus4 就可以边打宝可梦边自己记日记,提升长期记忆能力。

这两个模式目前所有套餐都可以使用,Sonnet4 还会开放给免费用户。

坏消息是我刚买的 Claude Pro 没啥用,还要担心被封。

隔壁 Cursor、Monica、Flowith、Poe 都光速上线了 Claude4 系列。这边建议 Anthropic 直接关掉 UI 界面,只提供 API 就好了。

还是那句话,来都来了,来个真实例子测测看吧:

一共跑了两轮,复用了@歸藏的网页提示语,第一次只用了角色提示语,想看看 Claude4 本身的审美:

页面内容相当完整,中间部分还有动态效果,以及还读取了原网页里图片素材里的多个数据。

用上完整版提示语后,文字部分更完整,会随着鼠标滑动有动态的效果,但看上去反而没那么好看了。

可能 Claude4 的最佳提示语搭配发生了改变?

顺带还说了一下对 Agent 的设想

测试的所有提示语和输出代码都打包好了,公众号发我claude4就可以啦

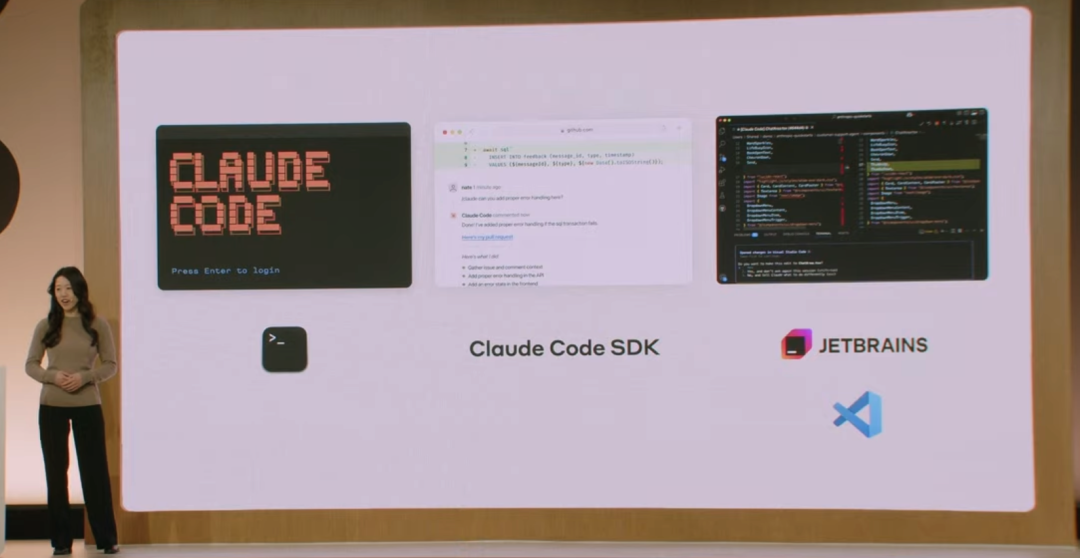

02|Claude Code

这一 part 是整个发布会时间最长的,

强调的是不仅要选好模型,还应该选择正确的平台。

所以,Anthropic 做了个啥出来呢,

没错,这个长的很像,用起来也很像,哪哪都像OpenAI codex的代码执行工具:

Claude Code

真不是我夸张,看看 codex 的对话界面,

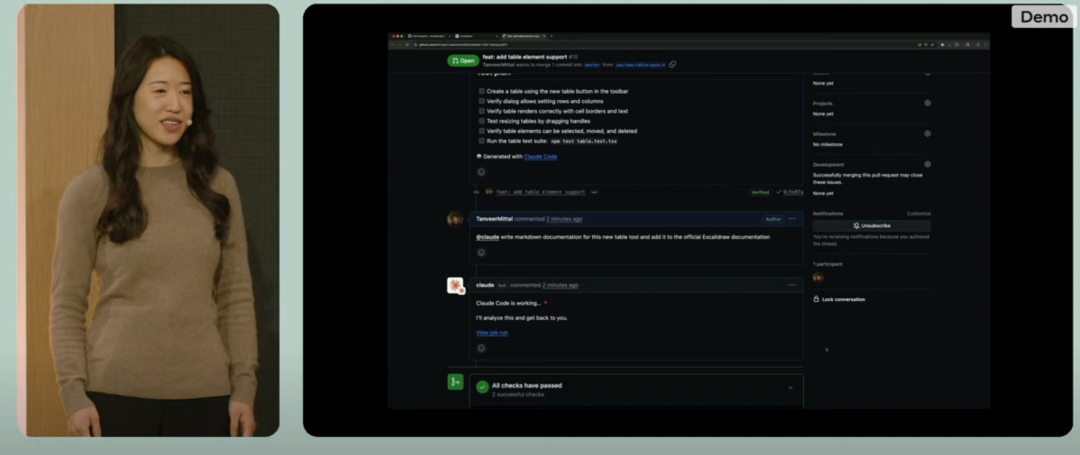

还有还有,Claude code 还支持在 Github 运行,

在vscode、jetbrains里都可以当代码助手使用。

enmmmmm,我的评价还是一句话,

更像 openai codex 了。

按照惯例也跑个真实案例试试看,安装方法还是比较简单的:

npm install -g @anthropic-ai/claude-code

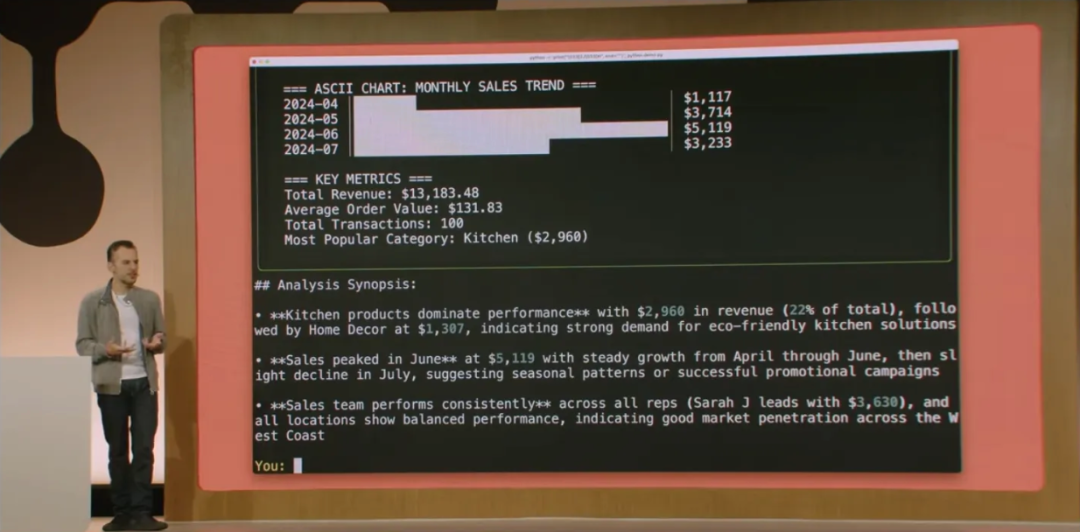

我是直接在本地命令行界面上跑的,分别跑了一个3D飞机和特效贪吃蛇:

飞行器这个案例之前我只在gemini 2.5 pro上实现成功,claude3.7都会卡在不能控制不能正常加速上。

Claude4 出的这一版可以控制方向和加速了,就是这个碰撞模拟还需要更真一点

贪吃蛇特效是炫酷了不少,就是难度太高了,动不动就要重来。

后面还给出了会接入 Claude4 的平台,

来认领一下自己爱用的工具吧

03|Claude API

这一趴还是有点干货的,

最重要的就提示语缓存时间从5分钟延长到1个小时,

在缓存情况下,成本降低 90%,延迟降低高达 85%,我的钱包松了一口气。

除了降低成本外,API 还引入了代码执行工具、用来加载数据集、生成图表、处理文档等。

还做了一个 MCP 专项优化,

可以直接在 API 里链接支持远程服务,也就是 SEE 的 MCP Servers,这样的好处就是不需要依赖客户端了,不需要受限在 claude desktop、cursor、windsurf、chatwise等等一系列客户端里。

按照这个格式,我发现之前做过的MCP文章里有一个现成的MCP server可以接入,是可灵的文生图:

xingchen-api.xf-yun.Com/mcp/xingchen/flow/7315369205743927298/sse

但是没有成功,因为这个mcp servers里并没有不需要token,但目前请求里面的token又是必填字段。而且因为现在 MCP servers 的数量都奔着 1000 去了,后面我会做个专题来列出值得固定在 API 里用的。

最后的最后,

考虑到平时使用 API 的时候,每次请求都要重新上传文件,这很不 AI。

新的 Claude API 支持上传本地文件、将输出结果下载成文件,以及通过固定的id来引用文件内容。

如果不会被封的话,这会是一个相当不错的功能。

写在最后

接下来半个小时就是痛苦折磨了。

熟悉 Anthropic 的都知道,

他们有段时间特别爱写小作文,在网站上还给自己划了一个专门的编辑部,保持每月五六更的状态

🔗 anthropic.Com/news

所以这跟发布会有啥关系呢?

原因是他们已经不局限于写了,

还花了大半时间在重复自己的理念、对模型本身的思考、以及发现 Claude能力的过程之类的。

讲的特别好,好就好在下次发布会别安排这个环节。

答应我好吗。

最后最后的最后,

还给现在每个人发了三个月$100的 Max 订阅,

这显得我更像一个冤种了,线上开了一个活动,结果只发100个 Max 订阅,比我遇到日全食的概率都低

Anthropic 你要不赔我点钱吧。。。

@ 作者 / 卡尔 & 阿汤 @ 动手学AI知识库 / learnprompt.pro

(文:卡尔的AI沃茨)