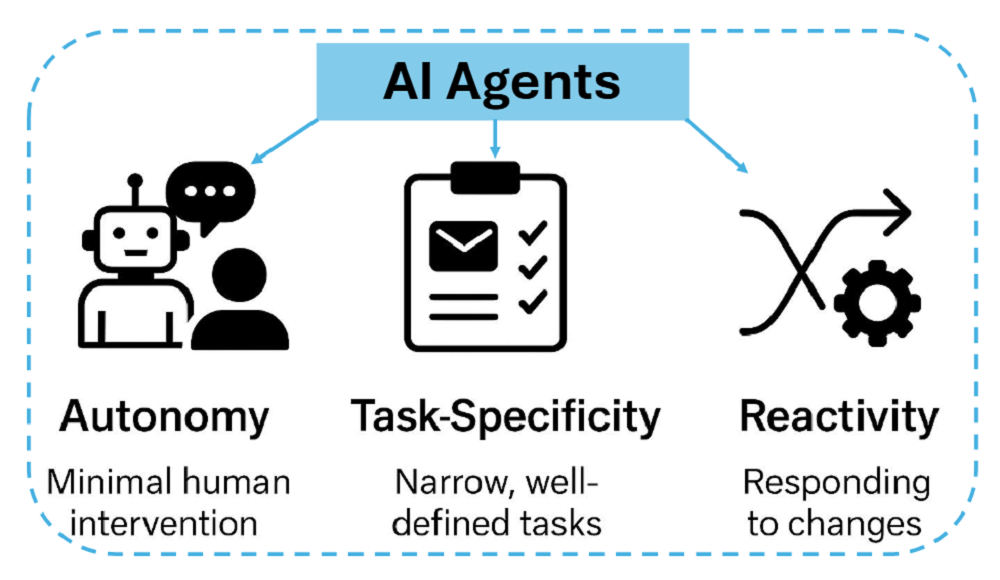

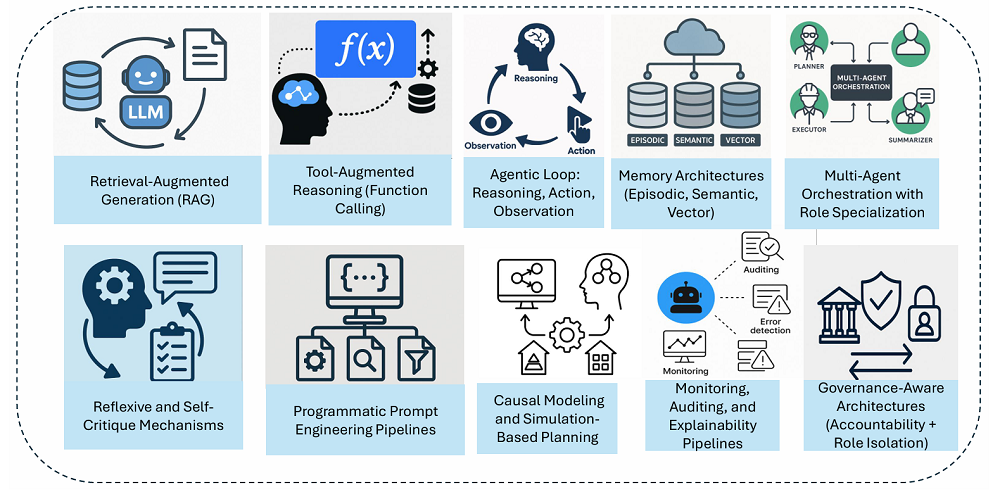

AI Agents的定制化通常通过领域特定的提示工程、规则注入或工作流模板实现,它与硬编码的自动化脚本的区别在于有上下文感知的决策能力。以ReAct系统为例,其采用推理与行动的迭代框架,使智能体在执行前能进行内部“思考”。

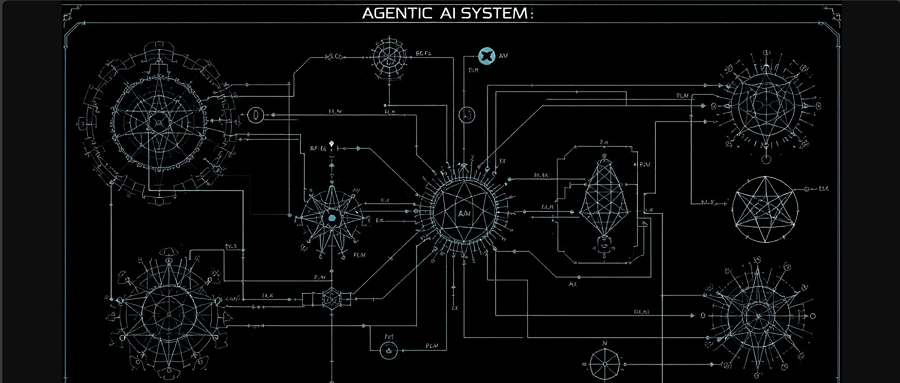

Agentic AI系统继承了AI Agents的模块化结构,但在此基础上引入了分布式智能、智能体间通信和递归规划等增强能力。文献中总结了多项关键架构改进,这些改进构成了Agentic AI相较于AI Agents的本质区别:

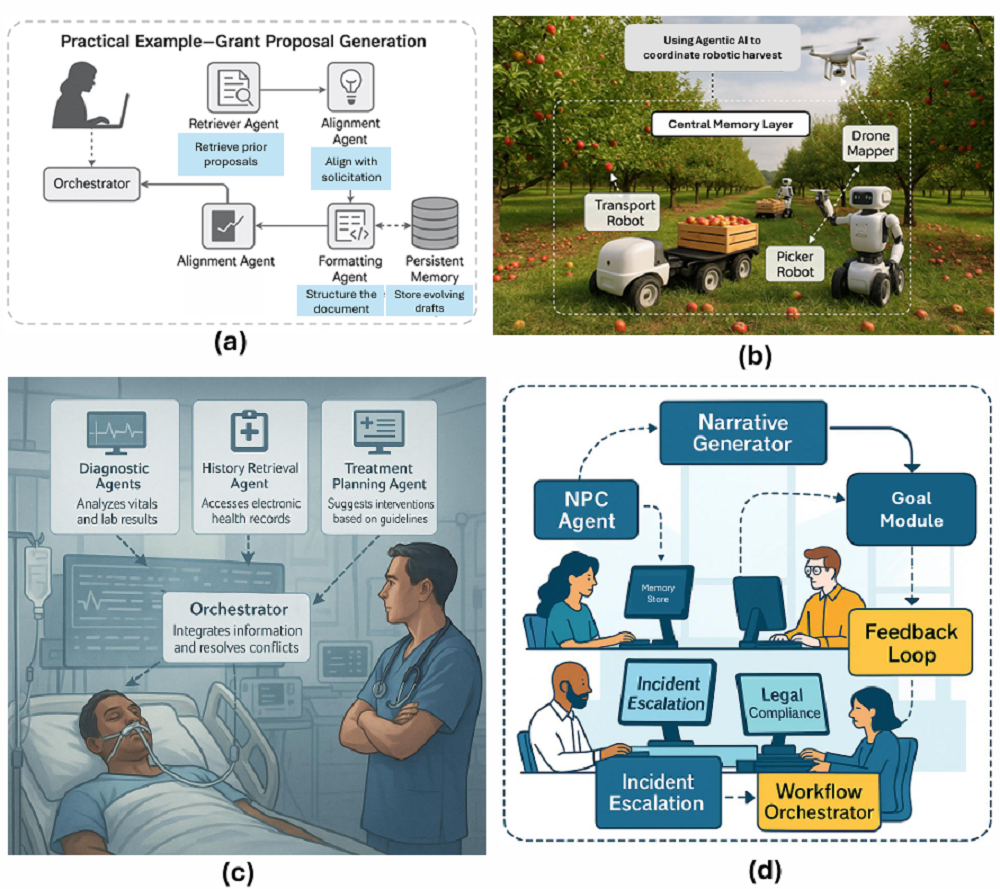

(1)专责智能体协作体系(Ensemble of Specialized Agents):Agentic AI不再是单一智能体运行,而是由多个专责智能体组成,每个负责不同功能,如摘要、检索、规划等。这些智能体通过消息队列、黑板机制或共享内存等方式进行通信。例如MetaGPT采用模拟公司部门(如CEO、CTO、工程师)角色的方式构建智能体,角色模块化、可复用、职责清晰。

(2)高级推理与规划能力(Advanced Reasoning and Planning):Agentic AI系统内嵌递归推理机制,如ReAct、思维链(Chain-of-Thought, CoT)和思维树(Tree of Thoughts)等框架。这些机制允许智能体将复杂任务分解为多个推理阶段,评估中间结果,并动态调整行动计划,从而提升系统应对不确定性或任务失败的能力。

(3)持久化记忆架构(Persistent Memory Architectures):与传统智能体不同,Agentic AI具备持久记忆子系统,能够在多个任务周期或智能体会话间保留知识。记忆类型包括情景记忆(记录任务相关的交互历史)、语义记忆(长期事实或结构化数据)以及向量记忆(用于检索增强生成,RAG)。例如AutoGen智能体使用草稿本记录中间计算结果,支持任务的逐步推进。

(4)编排层 / 元智能体(Orchestration Layers / Meta-Agents):Agentic AI的一项关键创新是引入了编排器或元智能体,负责协调各子智能体的生命周期、管理依赖关系、分配角色并解决冲突。这类元智能体通常包含任务管理器、评估器或协调者角色。例如在ChatDev系统中,一个虚拟CEO元智能体将子任务分配给不同部门智能体,并整合它们的输出形成统一的策略响应。

这些架构方面的调整使Agentic AI能够胜任需要持续上下文、多智能协作、多模态协调及策略适应的复杂任务场景。典型应用包括:多个智能体协同完成检索、摘要、文稿撰写的研究助理(如AutoGen流水线);或监控物流、供应商绩效与动态定价模型的智能供应链系统。

研究团队认为,Agentic AI正在成为下一代AI基础设施,其能力不仅限于执行预设流程,更能构建、调整和管理复杂目标,实现最小人工干预下的自主运行。

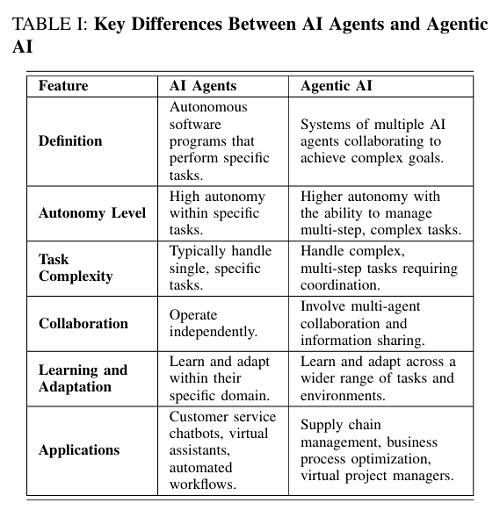

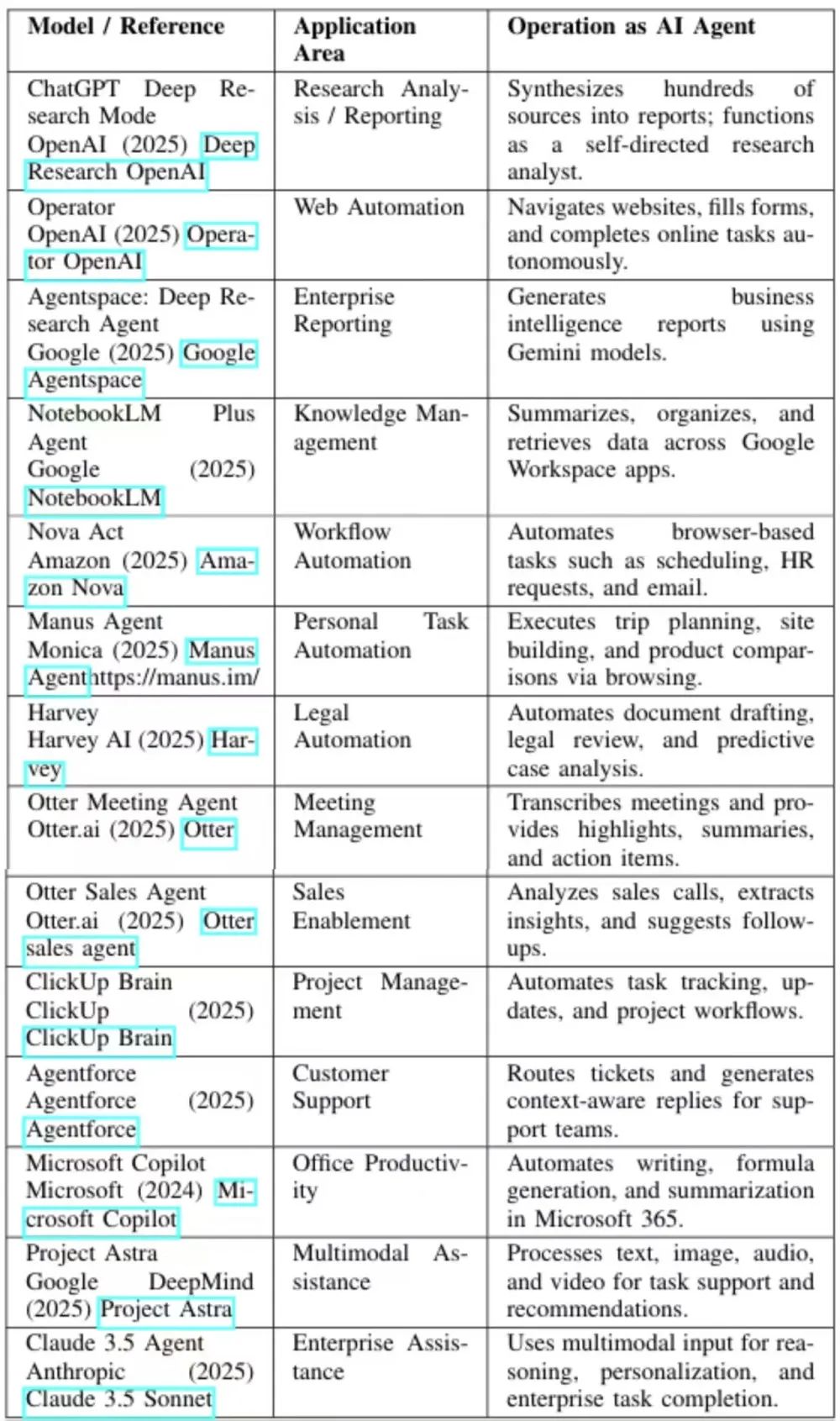

▲业内有代表性的AI Agents

(文:智东西)