刚刚,苹果扔出一颗深水炸弹,直接宣判了所有「推理」模型的死刑。

他们用一系列全新的智力测试题,把Claude Thinking、DeepSeek-R1和o3-mini这些号称会「思考」的模型打回了原形。

结果让人大跌眼镜:这些模型根本不是在推理,只是在玩高级版的「记忆大师」游戏。

苹果的「解剖刀」

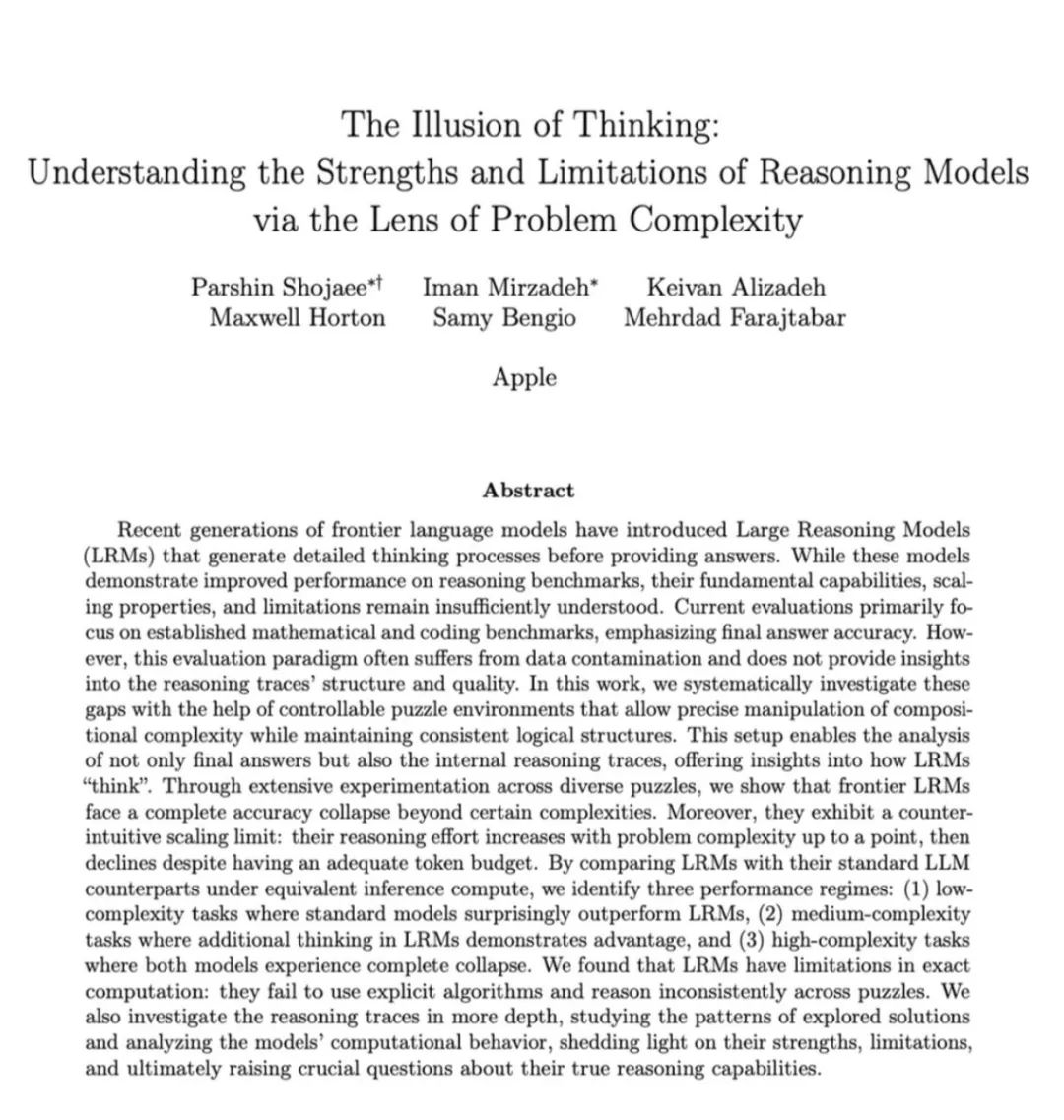

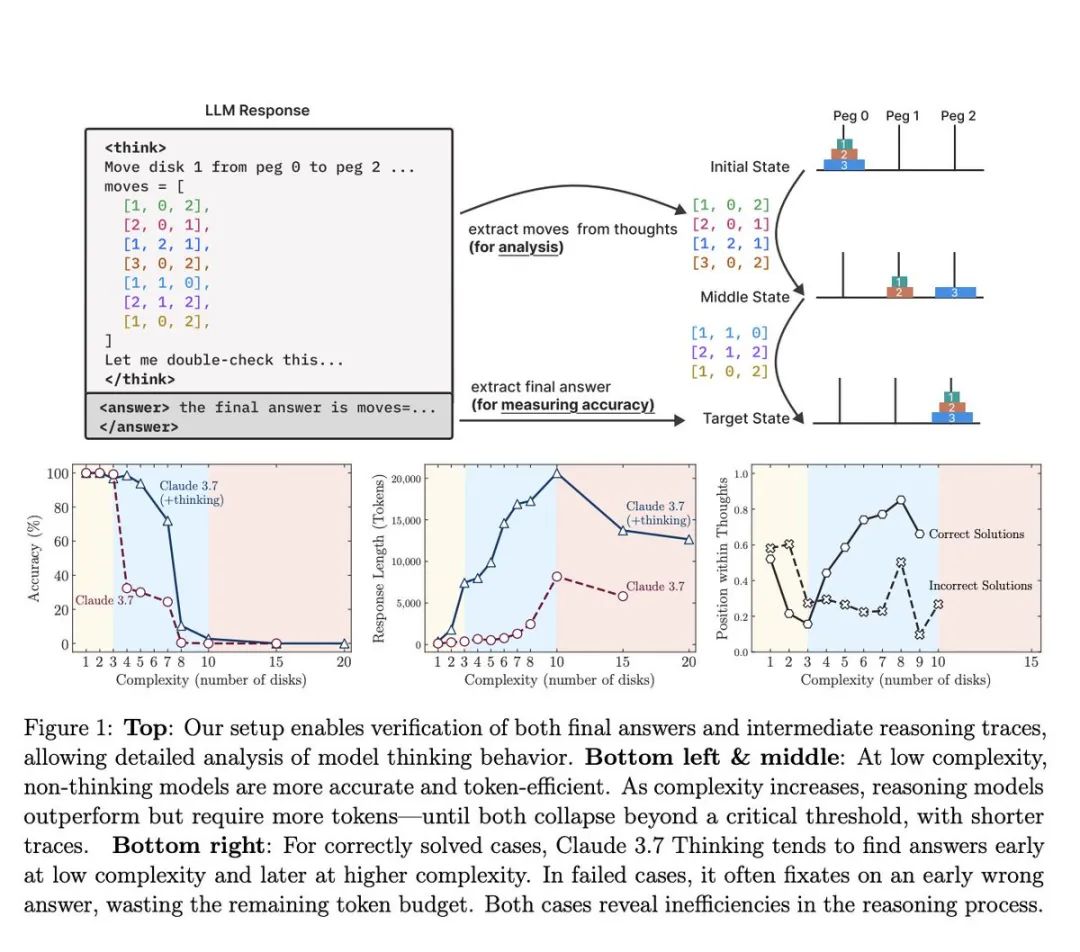

苹果研究员设计了一套模型从未见过的谜题游戏,专门测试纯逻辑推理能力。当问题复杂度提升时,所有模型的准确率直接归零。

更诡异的是,随着问题变难,这些「思考」模型反而开始偷懒了——用更少的token,更快地放弃,哪怕给它们无限的计算资源也没用。

研究揭示了三个清晰的阶段:

-

低复杂度:普通模型反而表现更好

-

中等复杂度:「思考」模型略有优势

-

高复杂度:全军覆没

而现实世界的大部分问题,恰恰都属于第三类。

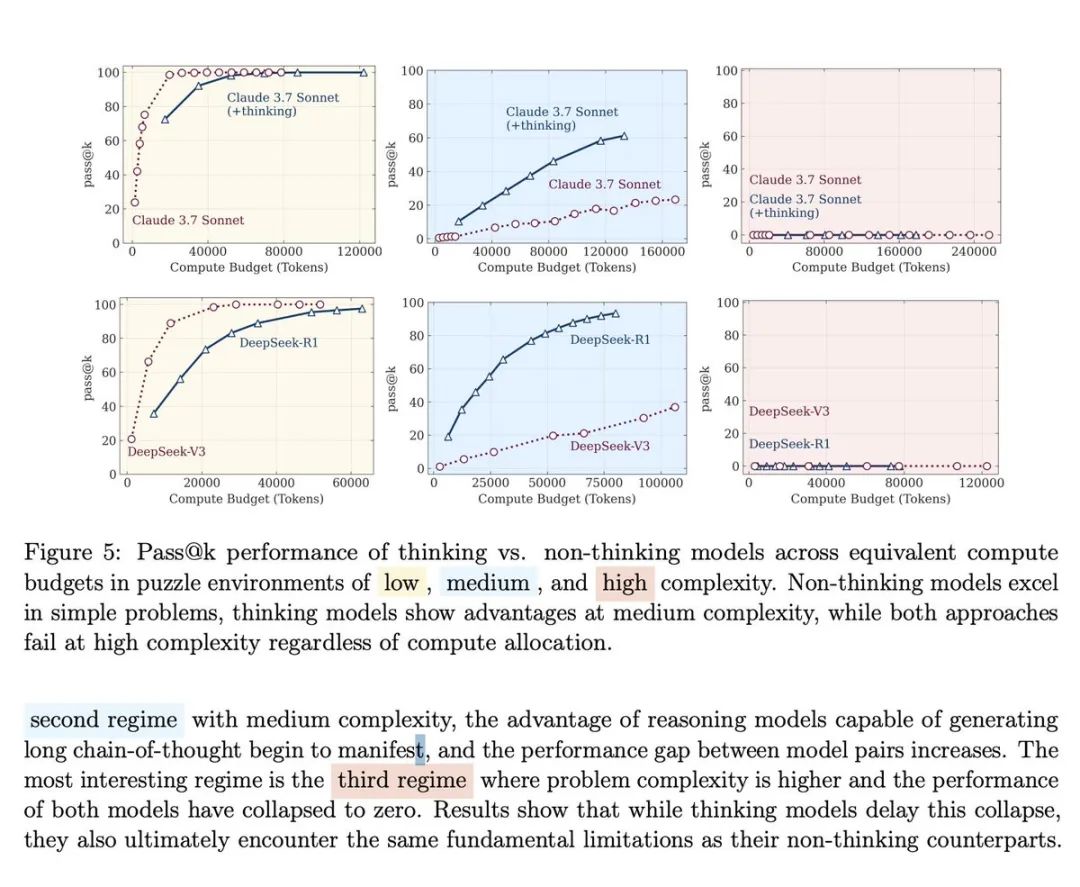

最致命的发现是什么?即便把解题算法一步步喂给模型,它们依然在相同的复杂度节点上崩溃。这就像给了食谱还是不会做饭,本质上缺乏真正的理解能力。

汉诺塔谜题可以轻松处理100多步,但河流渡河谜题仅仅4步就让模型抓瞎。这强烈暗示:模型在训练时见过汉诺塔的解法,但对河流渡河问题一无所知。

Ruben Hassid (@RubenHssd) 指出:

如果这些模型真的在「推理」,它们应该随着计算资源增加和指令更清晰而表现更好。但实际上,它们碰到硬墙就开始摆烂了。

苹果选择可控谜题环境作为测试场景,正是因为:

-

避免数据污染

-

要求纯粹的逻辑推理

-

可以精确控制复杂度

-

能暴露模型的真实极限

Google的「锯齿」哲学

就在所有人都在因苹果宣判而为AGI 梦碎叹息时,Google CEO Sundar Pichai却提出了一个更实际的概念——AJI。

AJI,全称Artificial Jagged Intelligence(人工锯齿智能),完美描述了当前AI的真实状态:时而惊艳,时而弱智。

在Lex Fridman的采访中,Pichai坦诚地说:「有时你看到AI的表现会惊叹,然后下一秒它连草莓里有几个R都数不清。」

这种「参差不齐」的锯齿正是当前AI发展的真实写照。

就像坐在旧金山的Waymo无人车里,它能在拥挤的人群中自如穿梭,展现出超人的驾驶技巧;但同时,它可能在最简单的数学题上栽跟头。

「我们不断地在移动AGI的定义标准」,Pichai说,「今天你坐在旧金山的Waymo里,穿过拥挤的人群,你会看到智能的闪光。但然后你又会看到一些明显还远未达到AGI的东西。你会同时体验到这两种感受。」

2030年的预言

Pichai的预测很有意思:到2030年,我们可能还达不到AGI,但这并不重要。

「我几乎觉得这个术语不重要了。我知道的是,到2030年,将会有如此巨大的进步。我们将不得不处理这种进步带来的后果——积极的外部性和消极的外部性,都会以重大的方式出现。」

当初Google收购DeepMind时(2014年),团队预测需要20年才能实现AGI(从2010年算起)。现在看来,这个时间表可能还是太乐观了。

「在Google DeepMind的早期,2010年时他们谈到实现AGI需要20年的时间框架,这很有趣。我不认为我们能在2030年之前完全达到,我觉得会稍微晚一些。」

但Pichai强调:「我要强调的是,这并不重要。无论那个定义是什么,因为你将在许多维度上看到令人惊叹的进步。」

他认为AI将在四个关键领域带来巨大益处:

改善知识获取:AI可以用母语翻译和传播信息,让全球知识更容易获取。

加速科学发现:AI可以协助数据分析和假设生成,可能加快医学和材料科学等领域的突破。

减轻气候灾害:AI可以提供预测建模和优化,帮助管理和减轻环境挑战。

经济进步:AI可以推动生产力和创新,促进经济增长。

争议与反思

面对苹果的「打脸」研究,AI 社区出现了有趣的分化。

一派认为这证明了当前AI路线的根本缺陷。Wim 🇳🇱🏴🇬🇧 (@wimdows) 说:

对懂LLM架构的人来说这不是新闻。LLM在通往AGI的路上就是死胡同,可能会让我们的AGI之路倒退5-10年。

Fede Lang ₿⚡ (@fedelang) 则认为:

我不能说他们是对是错。但我确定的是,苹果真的落后了,这只是在贬低竞争对手。

但另一派则更加务实。Ramanuj Lal (@ramanujlal) 反问:

谁能证明人类不是在做同样的事?对大多数人来说,逻辑推理的深度也就止步于「我以前见过类似的吗?」

Greg Parker (@gregparker2017) 更是直接挑战了苹果的结论:

说「只是记忆模式」?实际上,推理本身就是模式。推理完全基于逻辑模式及其应用。

Andy D (@DickoDownUnder) 提供了一个深刻的哲学视角:

真正的智能来自于「what is」和「what is not」之间的相互作用。创造力、直觉和智慧需要想象、假设和生成全新概念的能力——特别是那些尚不存在的东西。这可能与自我意识深度相关。

而有意思的是市场反应——JaggedAI.com这个域名已经被人以19,999美元的价格抢注了。

Jason (@DCLjasonx) 惊呼:

刚刚有人花19,999美元买下了https://jaggedai.com/!

5分钟前还在售呢!

Jordan Thibodeau (@JordanSVIC) 还爆料了一些Google内部的遗憾:

2017年Aidan Gomez团队在Google写出了「Attention is all you need」,结果Sundar他们完全忽视了,错失良机啊!

拥抱「锯齿」的未来

Pichai在采访中特别强调,「到2030年,我们需要一个强大的系统来标记AI生成的内容,帮助用户区分它与现实。」

这正是关键所在:我们不需要AI成为无所不能的神,只需要它在特定领域足够出色。透明度和道德考量将成为AI发展的核心。

Google在Pichai的领导下,继续在AI研究和创新方面处于领先地位,致力于解决这个领域出现的复杂问题。他的前瞻性声明和战略愿景表明,他们致力于利用AI产生重大社会影响,同时也认识到需要细致的改进和监管。

在我看来,无论是苹果的否定,还是AGI 的无所不能——这也恰恰给我们一个关键洞察:与其纠结AI是否真的在「推理」,不如接受它的「锯齿」本质,学会在合适的场景用合适的工具。

如PromptPilot (@PromptPilot) 总结的:

「闪光的智慧,紧随愚蠢的错误」可能是迄今为止对AI最准确的总结。

质疑者永远能找到证据,但创新者已经在路上。

知道AI的局限,恰恰是用好AI的前提。就像使用任何工具一样,了解它的长处和短板,才能物尽其用。

是全盘否定AI 的能力,还是继续追求遥不可及的AGI,还是先把「参差不齐」的锯齿AJI 用到极致?

你怎么选?

(文:AGI Hunt)