Anthropic研究员Trenton Bricken的这番话,听起来像是在为自家辩护?

最近,Anthropic的研究员Trenton Bricken在接受Dwarkesh Patel采访时,对DeepSeek的成就提出了一个颇具争议性的观点。

他声称:DeepSeek并没有真正超越AI前沿,它只是训练得更晚而已。

「我们也能用500万美元训练出来!」

Bricken在采访中详细解释了他的观点:

DeepSeek是在Claude 3 Sonnet发布九个月之后才开始训练的。如果我们今天重新训练同样的模型,或者和DeepSeek同时进行训练工作,我们也可以用500万美元或者广告中宣传的任何金额来训练它。

他进一步强调:

令人印象深刻或者说令人惊讶的是,DeepSeek确实达到了前沿水平。但我认为仍然存在一个普遍的误解,认为他们远超前沿。我不认为这是对的,我觉得他们只是等待了时机,然后能够利用所有其他人也在经历的效率提升。

这番话的潜台词很明显:DeepSeek的成功更多是时机问题,而非技术突破。

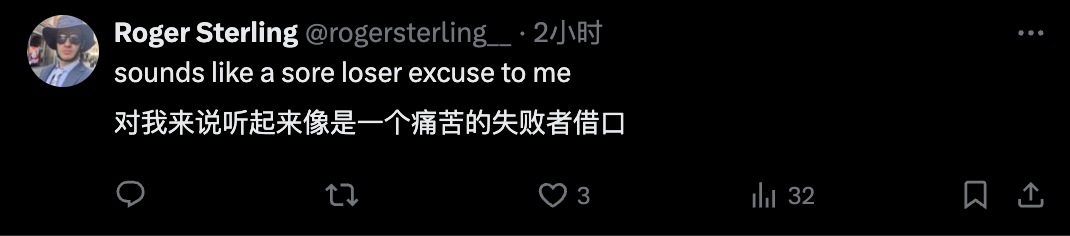

网友:「听起来像失败者的借口」

对于Bricken的这番言论,网友们的反应可谓是极具嘲讽。

Roger Sterling(@rogersterling__) 回怼:

听起来像一个失败者的借口

anku(@whoisanku) 更是直接地表示:

自我安慰

网友们的评论反映出了外界对Anthropic这种「事后诸葛亮」式解释的质疑。

毕竟,如果真的这么容易,为什么Anthropic当时没有去做呢?

怕用户不愿意付费了?

还是担心投资人不打钱呢?

DeepSeek的发布节奏

而就在这场争议发酵的同时,DeepSeek的下一步动作也浮出水面。

根据最新消息,DeepSeek 或计划在7月推出V4版本,R2 则可能在8月跟进,这比之前传言的5月发布时间有所推迟。

值得注意的是,DeepSeek一直保持着大约7个月的旗舰模型发布节奏:

-

V1:2023年10月

-

V2:2024年5月

-

V3:2024年12月

-

V4:预计2025年7月

这种规律性的发布节奏显示出DeepSeek团队的战略规划能力和对市场时机的精准把握。

谁在「等待时机」?

Bricken的观点虽然有一定道理——技术确实在快速迭代,后发者可以享受到前人积累的效率提升——但这种说法也暴露出了一种微妙的心态。

过去两年里,模型训练效率的提升确实令人惊叹。 如Bricken所说,这些效率增益让后来者能够以更低的成本达到同样的效果。

但问题在于:时机本身就是竞争力的一部分。

DeepSeek选择利用有限的资源,在「正确的时间」进入,利用已有的技术积累和效率提升,这本身就是一种战略智慧。

把这种成功归结为「只是等待」,多少有些酸葡萄的味道。

真正的问题或许是:为什么其他公司没有在同样的时机做出同样的选择?

随着DeepSeek V4和R2的临近发布,这场关于「前沿」和「时机」的争论注定还会继续。

而市场最终会用脚投票,告诉我们什么才是真正的技术实力和正确的战略。

(文:AGI Hunt)