随着遥感与地球观测(Earth Observation, EO)数据日益丰富,如何让 AI 真正理解多模态、多尺度的遥感信息,成为当前人工智能领域的重要挑战。现有的大模型(如 GPT-4o、Gemini 等)虽然在图像与文本理解上取得突破,但面对复杂的遥感数据,往往缺乏有效的适应能力与系统性的评估基准。

为填补这一空白,来自特伦托大学,慕尼黑工业大学,柏林工业大学,INSAIT 研究院的研究者们联合开发了 EarthMind ——面向遥感场景的多粒度、多模态统一理解框架。EarthMind 可以根据用户的视觉和语言提示对异构传感器数据(RGB、SAR、多光谱等)进行图像级、区域级、像素级别的感知和推理。

除此之外,研究者们同步发布了开源评测基准 EarthMind-Bench,首度系统性覆盖了从感知到推理的遥感多任务评估,助力全球科研社区共同推动“地球 AI 大脑”建设。

未来,EarthMind 有望在低空经济,环境监测,灾害评估等应用场景中展现出广泛的应用价值。

论文标题:

EarthMind: Towards Multi-Granular and Multi-Sensor Earth Observation with Large Multimodal Models

论文链接:

https://arxiv.org/pdf/2506.01667

项目链接:

https://github.com/shuyansy/EarthMind

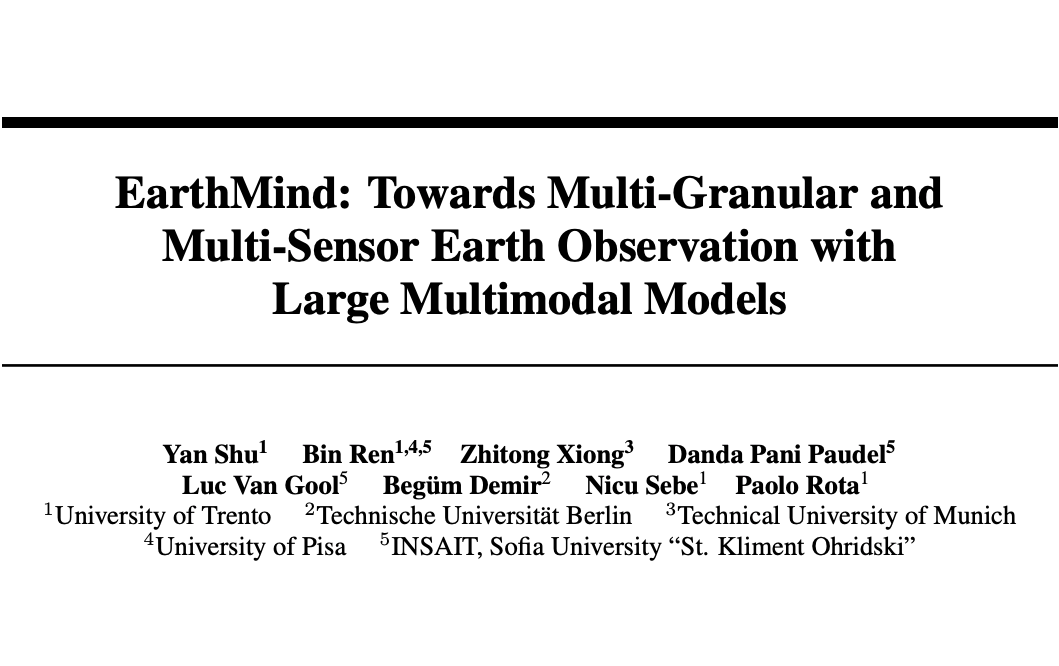

▲ 表一 现有地球观测模型和评测基准在多粒度和多传感器处理方面的局限

背景介绍

1. 遥感数据丰富,理解却仍是挑战

随着卫星与无人机的发展,遥感每天生成大量多模态数据,如光学影像、SAR 雷达和多光谱图像。这些数据广泛应用于城市、农业和灾害监测,但现有大模型在复杂场景、多尺度目标和跨模态差异面前,仍难以胜任高质量理解任务。

2. 多粒度与多模态理解亟待统一突破

遥感理解既需全局场景分析,也需局部目标分割,同时涉及多种传感器数据的融合。但目前主流模型缺乏统一架构,难以兼顾不同粒度与模态的信息整合,限制了遥感大模型在实际应用中的效果和泛化能力。

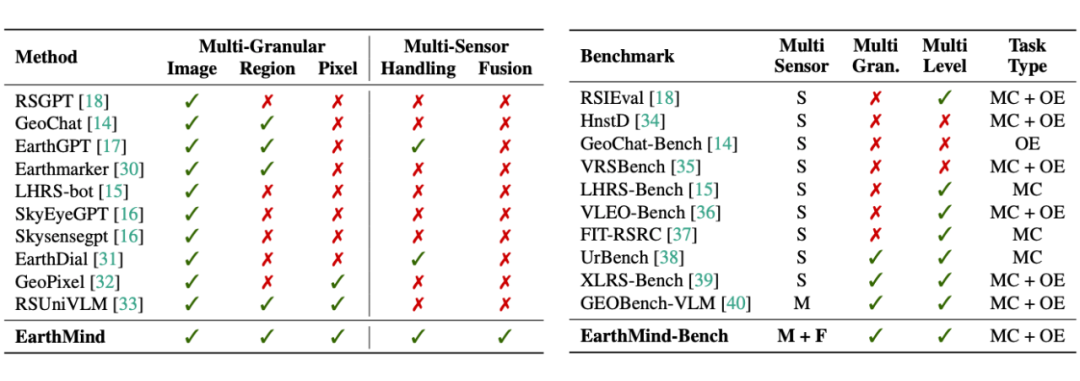

▲ 图一 EarthMind 方法结构图

方法介绍

1. 多粒度感知模块(Multi-Granular Perception)

-

视觉主干编码器:提取全局语义信息,实现图像级理解;

-

区域编码器 提取目标级(对象级)特征,支持区域级理解任务;

-

像素级分割编码器 用于细粒度空间分割与定位任务;多个编码器输出的层次化特征统一投射到语言空间,形成统一的视觉 token 表示。

2. 分割提示机制(Segmentation Tokens)

-

引入可学习的分割查询 token 模拟语言驱动的像素级任务;

-

视觉 token、分割 token 以及语言指令共同输入 LLM,实现多模态联合推理;

-

分割 token 的隐藏状态与像素级特征通过轻量化 Mask Decoder 生成最终分割结果。

3. 空间注意力引导(Spatial Attention Prompting, SAP)

-

在 LLM 内部重分配注意力权重,引导模型聚焦于与查询对齐的目标区域;

-

有效缓解遥感图像中尺度变化大、纹理模糊等空间感知难题。

4. 统一多传感器数据格式(Unified Multi-Sensor Formatting)

-

受视频 LLM 启发,将多模态数据转化为类似视频帧序列统一处理;

-

SAR 数据填充形成伪 RGB 图像;多光谱数据每三通道分组成 RGB-like 帧,输入共享编码器。

5. 跨模态融合模块(Cross-modal Fusion)

-

设计跨模态融合机制,在语言条件下联合学习 RGB 与 SAR 互补信息;

-

通过互信息感知和权重分配,动态选择各模态中最具信息密度的特征供 LLM 推理使用。

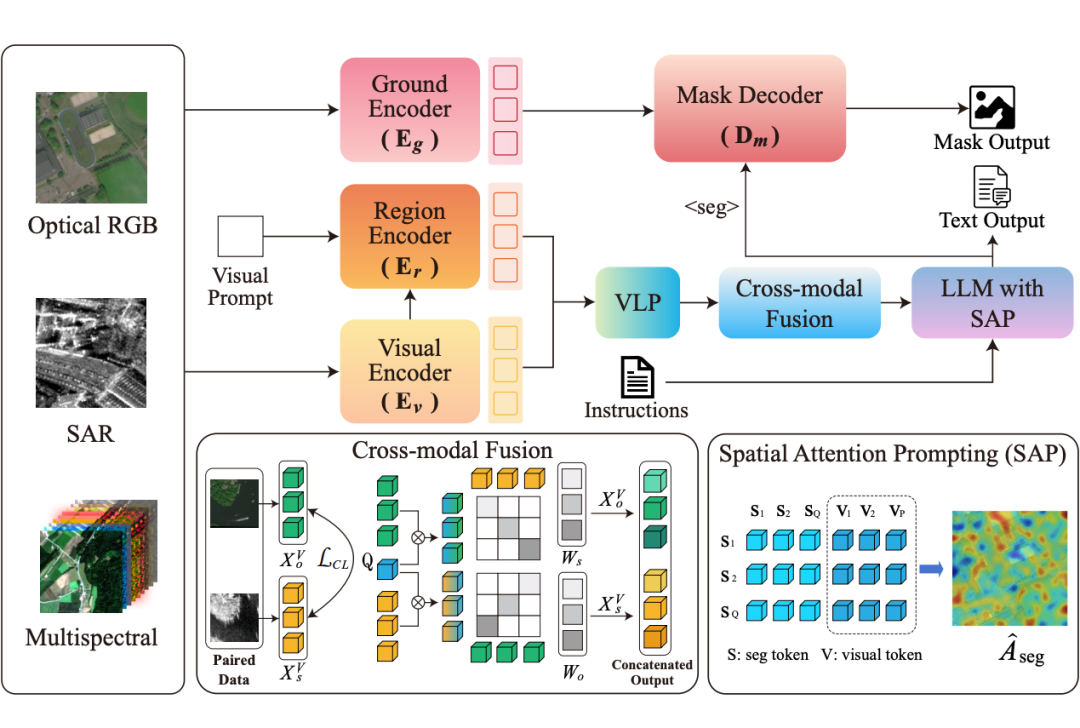

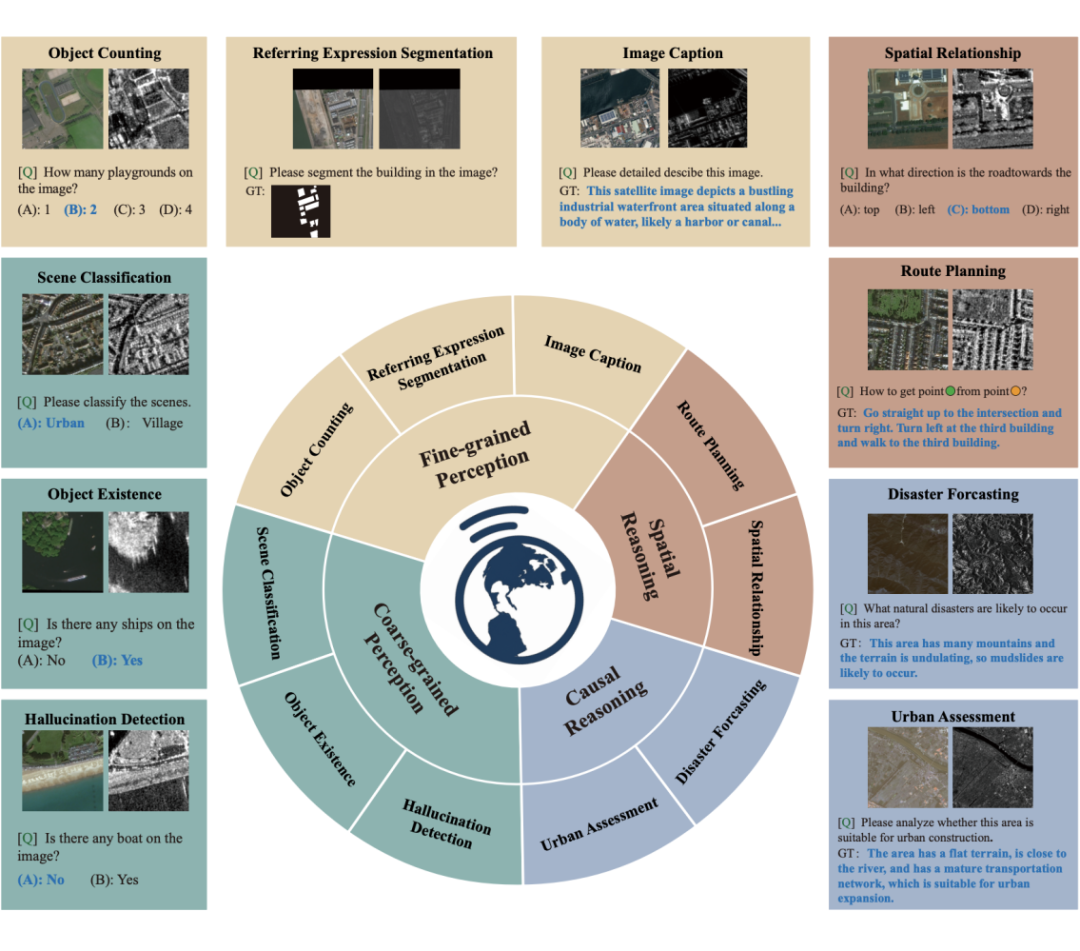

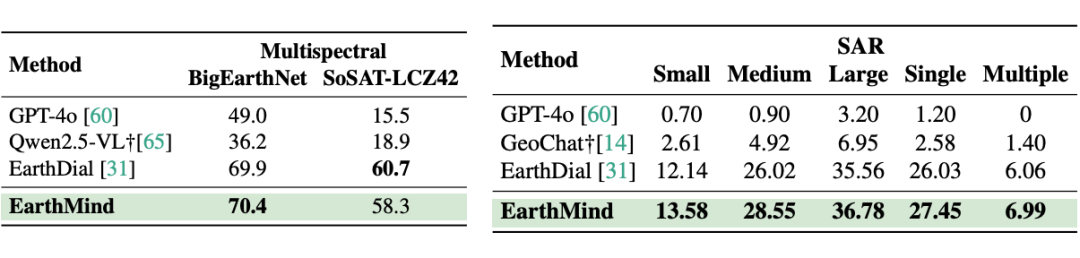

▲ 图二 EarthMind-Bench 任务示意图

EarthMind-Bench:首个面向多粒度与多传感器遥感理解的基准

多粒度任务设计:覆盖图像级分类与问答、目标级区域描述与定位、像素级分割与指代分割任务,全面考察模型的感知与推理能力。

多传感器数据覆盖:收集并整理了来自公开数据集的高质量 RGB–SAR 配对样本(如 OpenEarthMap-SAR、WHU-OPT-SAR、DFC2023、MSAW 等),并支持后续多光谱与高光谱数据的扩展。

10 大任务类型:涵盖对象存在检测、幻觉检测、目标计数、空间关系、路径规划、图像描述、灾害预测、城市发展评估等典型 EO 应用场景,面向实际遥感应用需求设计。

高质量人工标注:结合专家审核与大模型辅助生成,确保标注准确性与任务多样性。

统一评测协议:同时支持多选题(MC)与开放式生成题(OE),通过 GPT 评分与准确率双重评价体系,量化模型的综合理解与推理水平。

实验结果

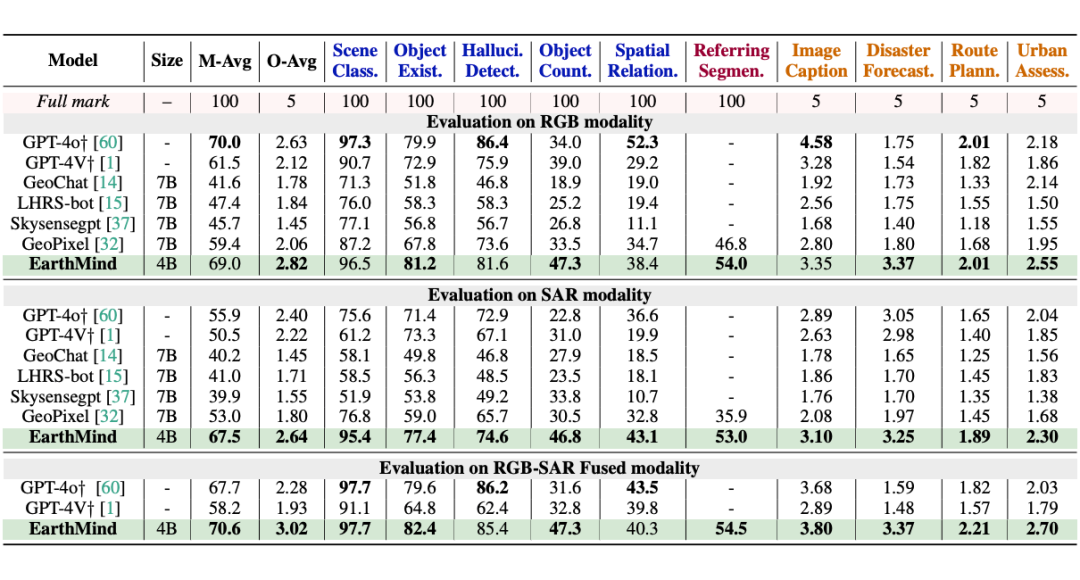

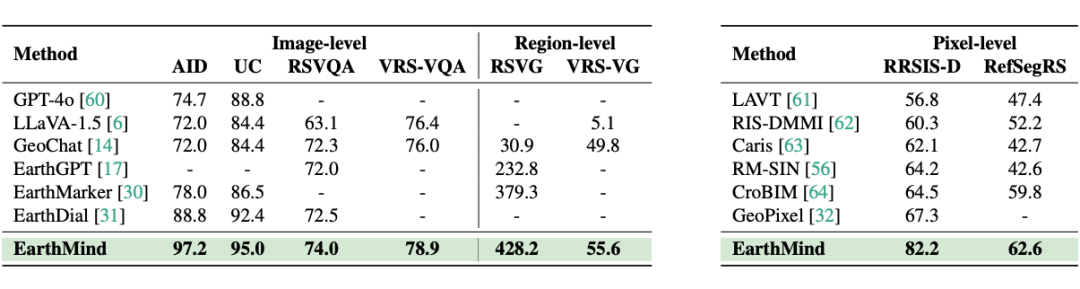

▲ 表二 EarthMind-Bench 上的评测结果

研究者们在 EarthMind-Bench 上广泛评测了开源的地球观测大模型以及闭源模型,主要得出了以下发现:

1. 细粒度任务和开放式问答对目前模型依旧是个巨大的挑战;

2. 相比较于 RGB 图像,目前模型难以对 SAR 图像进行精准理解;

3. 多传感器数据的融合不仅仅是简单的数据叠加,而需要模型学习到不同数据之间的互补特征。

此外,EarthMind 在 RGB 和 SAR 单模态评测中超越了目前参数规模更大的开源模型,而在多传感器融合评测任务中超越了 GPT-4o 等模型

▲ 表二 公开遥感数据集的评测结果(包含图像级,区域级和像素级的理解

▲ 表二 多传感器遥感数据集的评测结果(包含多光谱和 SAR 图像理解

在公开评测数据集中,EarthMind 在十余项地球观测下游任务中取得强劲表现,包括场景分类,VQA,CAPTION,目标检测,语义分割等。除此之外,在多光谱和 SAR 测试场景下也展现了良好的泛化性,超越了GPT-4o,Earthdial 等模型。

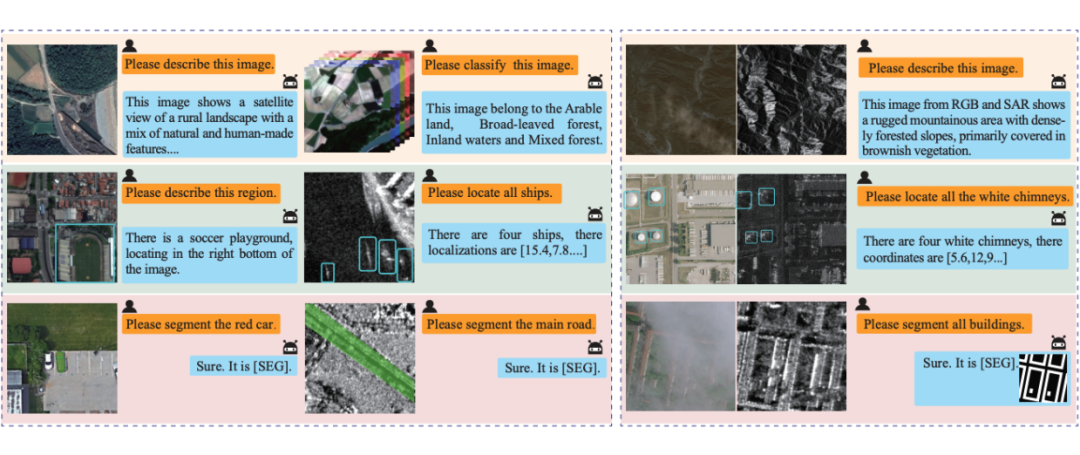

▲ 图三 EarthMind 可视化结果(1)

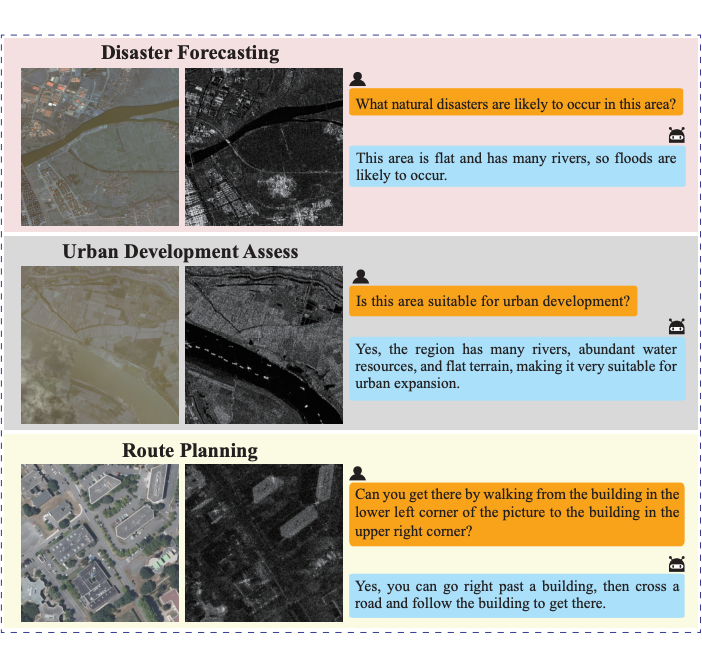

Earthmind 不仅可以根据用户指令对图像进行精确分类,分割,还可以进行各种推理任务,例如对于长江流域的图片,它可以判断出该地区容易发生洪涝灾害,以及是否适合城市规划。另外,对于城市街道图片,它可以进行路径规划等推理任务。

▲ 图三 EarthMind 可视化结果(2)

目前,研究者们已经开源了所有训练代码和数据,以促进全球多模态遥感观测研究社区的合作和技术共享。

(文:PaperWeekly)