“你可以在网上看到很多话,一句是我说的,还有千万句都是我说的。”——鲁迅

或许还有一些,是AI说的。

过去,很多假新闻可能是通过传统剪辑工具进行后期修改的,而现在,生成式AI正在成为虚假信息传播的主力军。大量虚假照片、视频、GIF图充斥着互联网。

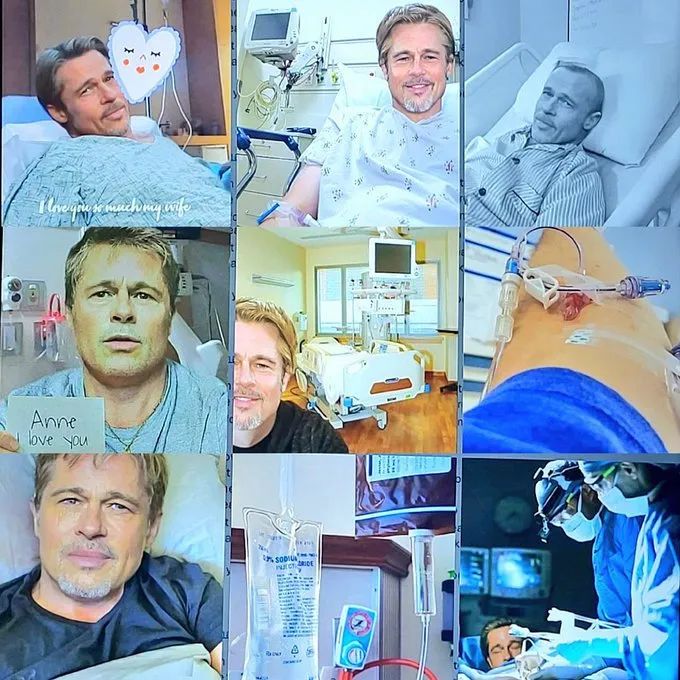

最近,有一名法国女子被AI生成的“布拉德·皮特”照片骗走了83万欧元(折合人民币约626万)。骗子称他需要钱做肾脏手术,因离婚个人账户还被锁定了,该女子信以为真,误以为自己一直和大明星保持联系。

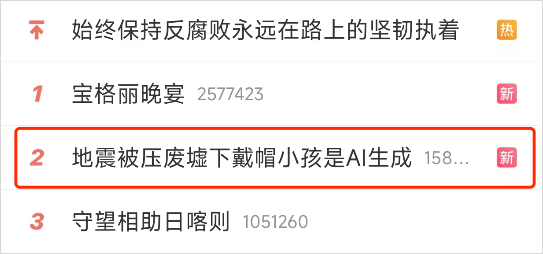

再比如,前阵子,西藏地震后灾区照片又一次将AI造假的话题推上了热搜,AI生成的视频被“张冠李戴”,变成此次震后的视频图。

尽管AI技术无处不在,网友们也越来越擅长辨别AI生成的内容,但事实上,真正成功欺骗大众的图像,往往是那些经过“精心伪造”的图像。

我们整理了2024年传播度较高的十大AI假新闻事件,并分析了其中的作假手段,希望能够帮助大家有效分辨AI生成的虚假内容。

“三界假顶流”:

AI雷军、AI胖东来、AI张文宏

谁能想到,科技圈、医疗界、食品区的“顶流”们都被造假过。

2024年10月,雷军的AI语音片段刷屏互联网。“雷军”用熟悉的口音精准吐槽:“这游戏做成这样,绝对是来捣乱的。”

因为语气和雷军本人十分相似,不少网友都以为是雷军亲自下场锐评。无独有偶,互联网上还出现了用AI合成于东来的声音,声音特征也与真人无异。

2024年12月,张文宏医生“被AI带货”了。只见视频中的“张医生”正襟危坐,反复介绍一种产品,声音听起来也很像本人。

这样以假乱真的AI合成技术让不少名人明星深受其扰,深度伪造也成为了AI造假的现象级案件。

大多数AI换脸、换声案件都可以从面部入手来辨别。比如,观察人物面部表情是否自然,有没有光影出现。检查嘴部周围的纹路是否模糊,嘴唇周围细节减少很可能是AI的痕迹。另外,只会重复说一句话,没有连贯的语句就要当心是AI换声的原因。

成熟的3A造假团队

从静态图片到动态视频,从虚假文本到栩栩如生的模拟声音,甚至2024年还出现了成熟的3A(AI写稿、AI录音、AI视频)造假团队。

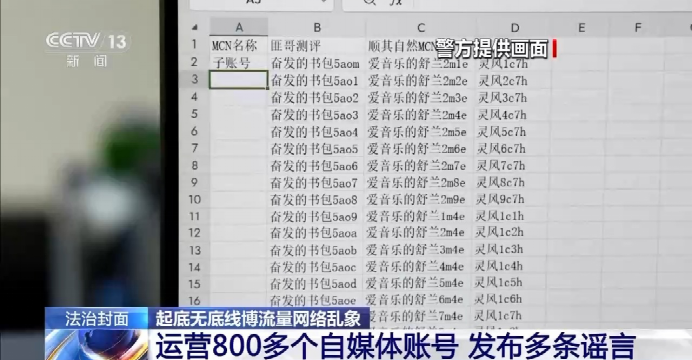

2024年6月2日,浙江警方因一则关于上虞工业园区的不实火灾消息,破获了一起利用AI制作虚假视频散布网络谣言的非法谋利的案件,据称该团伙仅有3人,却在一个月内使用AI生成并发布了3000个以上的虚假视频,散布谣言博取流量。

2024年1月,江西警方也曾因一条“西安爆炸”异常流量假新闻抓获了一个利用AI技术造谣团伙,该团伙每日量产4000-7000条AI文章,真假难辨。

针对AI文本生成内容,现在也有专门的检测工具,比如腾讯上线了文本检测工具,将检测文本与大模型预测内容进行重叠度对比,来推断文章的AI生成概率,帮助用户分辨。

三只羊的“财色”录音门

2024年,知名网络主播“疯狂小杨哥”及其创立的三只羊公司因多起事件引发公众关注,特别是涉及AI技术的伪造录音事件,也是2024年度AI领域的重要案例之一。

事件起因于一段网络热传的录音,内容涉及三只羊公司董事长卢文庆的不当言论。录音曝光后,卢文庆及公司形象受到严重质疑。

警方调查发现,这段录音系由25岁的王某某利用AI语音合成技术伪造。王某某通过AI工具克隆了卢文庆的声音,仅凭约30秒的录音片段,即生成了以假乱真的虚假录音。

相关阅读:《一家AI声音克隆公司,借三只羊录音门玩起了“自杀式营销”?》

批量生成的俄罗斯美女,

拿捏中国网友

Olga Loiek是一名乌克兰网红,2024年3月,她被“换脸”“换声”后出现在中文互联网上。

在中国,Olga叫“娜塔莎”,从乌克兰人摇身一变成为了俄罗斯人。她热爱中国的美食和文化,想嫁个中国男人,还拥有超20万粉丝。

更离谱的是,抖音上还有一大群“俄罗斯美女”,用着“Olga Loiek”的脸和声音,自称在中国生活多年,希望嫁给中国男人,然后开始带货😅。

这些批量生成的俄罗斯假AI美女们,因高颜值拿捏了不少中国网友。甚至有网友在评论区感慨,“好不容易心动了,你却告诉我她是AI”。

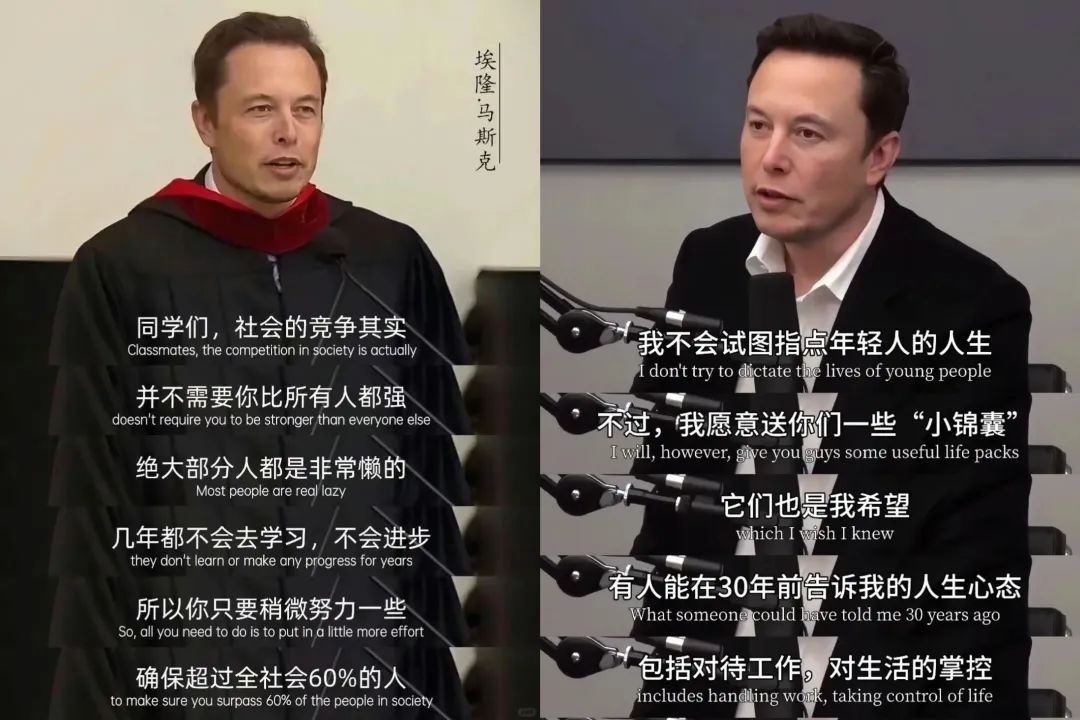

马斯克在互联网既是人生导师,

还是投资专家

2024年最容易被造假的名人当属“马斯克”。

互联网上层出不穷的马斯克语录、马斯克名言,马斯克自己都不知道能在中文互联网上输出这些大道理。

但凡碰到这样的鸡汤图片,都需要我们留个心眼

此前,还有网友利用Deep Live Cam制作了一个口型与声音都高度吻合本人的AI马斯克,并发视频表示手上有高回报的投资机会。

乍一听“马斯克讲投资”很合理,这一虚假视频还骗到了一位美国老人67万美元的退休金。

但值得一提的是,这个视频中,马斯克的眼睛和眨眼节奏有问题。下次我们遇到视频的时候,可以先盯着人物的眼睛和面部纹理进行判断。另外,要警惕别随便给陌生人转账。

永不会相融的海水

井水不犯河水,太平洋和北海(大西洋东部海湾)竟然有明显分界线?

不知道大家有没有刷到过这样一条视频 ,内容显示了太平洋和北海有明显的分界线,并暗示两者之间不会交融。这条AI生成的视频在TikTok上播放量超2000万。有网友在评论区煞有介事地表示,两者海水密度不同,所以不相融。

细心的人如果求证一下就会发现,北海附近是大西洋,太平洋离它十万八千里,怎么会交汇?😓

分辨AI假新闻的最朴素的方式,往往就是从我们已知的、确定的常识入手,进行区分。

2024年10月,佛罗里达州奥兰多的迪士尼世界因飓风风暴登陆前出现的龙卷风而关闭。与此同时,有关于迪士尼被海水淹了的新闻也在X上疯传。

我们怎么判断这些图片是假的?首先,这个城堡根本不对。和真实的城堡进行一下比较,就会发现城堡两侧的建筑完全不符。

但其实根本不需要知道真正的灰姑娘城堡是什么样子的,就可以判断它是假的。我们只要放大城堡附近的塔楼,就可以看到它们的角度非常奇怪,并且城堡外表面没有砖块,是光滑的。

除此之外,还有一张照片显示迪士尼人物布鲁托正抱着一个孩子走出园区。但这张图上,小孩的面部表情不清晰,会更容易区分出是AI生成的图片。

实际上,这种“张冠李戴”已经成为AI假新闻的常用做法。当一个事件发生时,用AI生成的内容充当现场照片。比如,飓风过后,这张小女孩在救生艇上抱着小狗哭泣的图片,也是这一路数。

美国拥有好莱坞山?

2024年,网友“Mimi Ehis Ojo”在Facebook上发布了一张好莱坞山的图片,郁郁葱葱的绿色山脉连接着洛杉矶的天际线。

虽然住在南加州的美国人立刻就能看出这是假的,但从未去过美国、不了解美国的网友还是被骗了,纷纷以为这是真的。

如果画面看起来太干净,或者风格化严重,比如,好莱坞山的图片很像从电影中截出的画面,这都有可能是AI造假的。

特朗普亲自下场,让真假扑朔迷离

2024年美国大选前,特朗普在社交媒体上分享了一系列图片,其中包括一张明显由AI生成的斯威夫特图片,上面写着“泰勒希望你投票给唐纳德·特朗普”。

如果这张图片单独出现,不少网友就能分辨出是AI生成的,但特朗普亲自转发了这些AI图,便让真假扑朔迷离。

泰勒·斯威夫特随后在Instagram上宣布,她将在2024年11月的美国总统选举中投票给副总统卡马拉·哈里斯(Kamala Harris)。她强调,对抗虚假信息的最简单方法是公开真实的立场,并呼吁粉丝注册投票。

AI给汤姆·克鲁斯拍了纪录片

汤姆·克鲁斯翻拍了2013年的《奥林匹斯陷落》?

2024年巴黎奥运会期间,有一部新电影《奥林匹斯陷落》宣称自己重新邀请了阿汤哥重磅出演,并记录了巴黎奥运会期间奥组委的腐败事迹。

这部电影共分为四集,每集9分钟,开头都有Netflix标志性的音效和红色的N动画。“在这个系列中,你将发现全球体育产业的内情”,假冒的汤姆·克鲁斯还在视频开头如此说道。

但只要稍加注意,就能发现种种迹象表明这部电影不可信。首先,阿汤哥的声音虽然逼真,但表述有些生硬。比如,他会重复一些台词,或者他的声音会在没有明显原因的情况下突然中断。

另外,在词汇表达上也略有不同。第一集中的旁白提到了一场“hockey match”(冰球比赛),在美国,球迷们通常会说“hockey game”(冰球比赛),而不是“match”。

因此,文化或语言常识上的不合理也可以帮助判断是否AI造假。

可以看到,2024年传播度较高的十大AI假新闻主要与AI虚假图片相关。

如果不经过人工精心修改,AI生成图片中出现的错误概率依旧较高,比如经典的“六指”、部分肢体扭曲、人物神态异常等等。

我们对物理世界的常识和规律的了解,就是识别AI图片最有力的武器。如果能从这些细节处找到一些违背常识、违背解剖学的地方,那基本可以认定这是一张AI生图。

AI生图出现的手部、骨骼反常;图片来自科普中国

小红书上还出现了一批专门做AI图片打假的账号,帮助大家从光影、五官、眨眼等细节分辨AI图。

随着AI技术逐步完善,图片造假的能力越来越出众,有时仅靠肉眼已难以分辨。有报道称,人们鉴别AI生成内容(图片、声音、视频)的综合准确率仅有51.2%,接近人们随机摇骰子的水平。

一些图片的常识性错误隐藏在比较隐秘的地方,不容易直接判断。此时,我们只能借助AI检测工具,用魔法打败魔法。通常来说,这些工具可以辨别出AI生成图片中的电子水印、隐藏的图片特征。

近年来也有许多技术从业者和学术机构致力于研发AI鉴伪技术,通过标记、追踪、分析内容生成痕迹,来识别虚假信息。

比如,长期研究AI伦理与反DeepFake技术的张欣怡带领团队开发了反向追踪算法,可以通过分析DeepFake视频中的AI生成特征,还原伪造痕迹,并追踪生成工具的来源。

此前,英国O2公司推出了AI聊天机器人“AI奶奶”Daisy,它能够能实时侦听和响应欺诈电话,声音模仿真实老人,通过与诈骗者长时间交谈,浪费骗子时间,阻止其诈骗行为。

在测试中,Daisy成功缠住众多诈骗者,通话可长达40分钟,网友们纷纷点赞,我们之前也进行了详细的报道:《诈骗克星“AI奶奶”来袭,骗子破大防,用AI反诈实在太爽了》。

此外,各大社交平台也在逐步建立内容审核机制,利用AI打假AI,相关行为规范标准也已在路上。

需要注意的是,现在还没有一种100%能够识别人工智能生成内容与真实内容之间区别的方法。因此,最佳的建议是时时刻刻保持怀疑心态。

我们无法完全杜绝假新闻,但我们可以用理性和科学的方法来识别它,用智慧和规则去规范它。AI可能是催化剂,但人类才是决定未来方向的掌舵者。

「

(文:AI新榜)

天啊!这些假新闻都是AI做的?真的吗?看来只好让AI来处理这些假新闻了吧!