大家好,我是木易,一个持续关注AI领域的互联网技术产品经理,国内Top2本科,美国Top10 CS研究生,MBA。我坚信AI是普通人变强的“外挂”,所以创建了“AI信息Gap”这个公众号,专注于分享AI全维度知识,包括但不限于AI科普,AI工具测评,AI效率提升,AI行业洞察。关注我,AI之路不迷路,2025我们继续出发。

Meta这个曾经的AI模型“开源”老大哥,慌了。

之前还是在心里慌,现在直接行动起来了。

原因很简单,DeepSeek。

DeepSeek-V3出世之前,AI模型提到闭源说的都是GPT-4,提到开源那必然是Llama 3.1 405B。

DeepSeek-V3的到来,让一切都变了。拥有着媲美GPT-4o的性能,又是开源的,简直融合了GPT-4和Llama 3.1 405B各自的优点。

1月28日起,外媒开始疯传Meta内部针对DeepSeek展开的一系列“骚”操作。

首先,Meta紧急组建了4个“作战小组”,名为“Llama战斗指挥部”(llama war rooms)。每个作战小组负责一个版块,分别对DeepSeek的关键技术优势展开深度研究。

这4个“作战小组”分别是:

-

成本优化组

该小组是核心中的核心,负责分析DeepSeek到底运用了什么技术手段来降低模型训练和运行成本的。说到底,还是“算力崇拜”的信念哗啦啦地崩塌了。该小组的研究重点是 模型蒸馏(Model Distillation) 等降本技术,探索是否能将这些策略应用在Meta的Llama模型上。

-

数据集研究组

该小组负责破解DeepSeek用于训练DeepSeek-V3和DeepSeek-R1模型的数据集来源与构成。这一操作是希望了解数据质量和多样性对模型性能的影响,以便优化Llama训练数据。

-

架构重构组

架构组则负责探索多模型集成方案,分析DeepSeek模块化设计的优势。据称,Meta AI计划推出类似DeepSeek模块化的Llama模型版本,以提升运行效率和灵活性。

-

技术移植组

作为开源模型,“Llama战斗指挥部”完全是把DeepSeek的模型放到了显微镜下观察。该小组就负责研究如何将DeepSeek的创新技术(如FP8精度训练、混合精度优化等)移植到Llama 4模型的研发中。

其次,值得一提的是,这4个“作战小组”组长均由Facebook(脸书)的创始人马克·扎克伯格(Mark Zuckerberg)本人亲自担任。

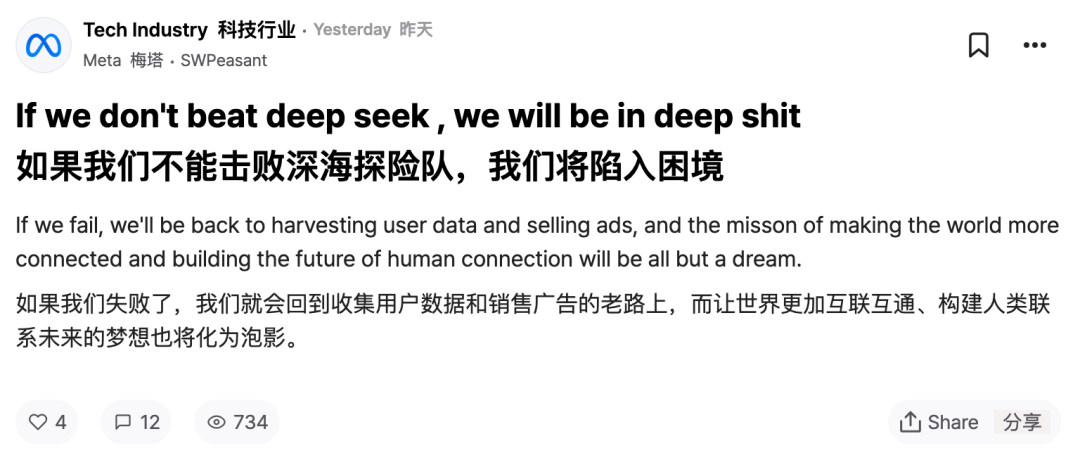

作为“作战小组”总指挥的小扎,亲自指挥,亲自部署,亲自喊出了Meta的工程师团队要“集中精力办大事”(pool our efforts and land big impact)的口号;Meta总部的走廊已经张贴上了“每日突破一参数”(one parameter at a time)的标语;茶水间电子屏幕上开始实时滚动“Llama 4 研发进度条”(llama 4 progress tracker)以及“如果我们不能击败DeepSeek,我们就玩完了”(If we don’t beat deep seek, we will be in deep shit)这样的标语。

除了这4个“作战小组”外,Meta早在4天前就宣布了一项总额高达650亿美元的2025年AI资本支出计划,用于新建一个覆盖曼哈顿面积的大型数据中心,配备超过130万张 Nvidia GPU(主要为H100型号),为Llama 4及其他AI项目提供算力支持。

结语

缘起DeepSeek的这场“龙卷风”,还在继续刮着。好戏可能还在后头。

(文:AI信息Gap)