北美时间2月6日,谷歌正式发布了之前处于实验阶段的Gemini 2.0系列模型。

老粉们应该都知道,每个不同的时期我推荐的AI工具都是不一样的:从2024年初的阿里通义千问和Kimi,到Claude、ChatGPT,再到后来的谷歌AI Studio,以及爆火前一个月就开始推荐的DeepSeek,它们每一个都有自己的特点和优势。

谷歌AI真正的崛起起始于2024年底,标志事件是Gemini-Exp模型的发布,该模型由最初的Gemini-Exp-1121到进化后的Gemini-Exp-1206,一直是霸榜通用模型的存在。后来谷歌又发布了自家的推理模型Gemini-2.0-Flash-Thinking,也是一个顶级模型。

而今天发布的Gemini 2.0系列,则是上面这些实验模型的升级版本,共包括3个新模型:Gemini 2.0 Flash;Gemini 2.0 Flash-Lite以及Gemini 2.0 Pro(实验版)。

正式版本的 Gemini 2.0 Flash

这是Gemini 2.0系列中首个已经全面开放的小参数模型,相当于GPT-4o mini的地位。

全面开放,是说该模型已经在Gemini应用(包括网页端和手机端)可用,并且支持开发者API调用。

Gemini 2.0 Flash继承了Gemini系列的优良传统:长上下文和强多模态。Gemini 2.0 Flash上下文长度为100万tokens。这是什么概念?作为对比,OpenAI的GPT系列是128K(12万8),Anthropic的Claude是200K(200万),而DeepSeek的2个模型上下文都仅有可怜的64K(6万4)。

多模态方面,除了正常的多模态输入(图片、文件)外,Gemini 2.0 Flash未来还将支持多模态输出能力,比如生成图片和语音。

实验版本的 Gemini 2.0 Pro

Gemini 2.0 Pro(实验版)是Gemini 2.0中的最强模型,你把它想象成GPT-4o就行。它的发布,标志着之前最强模型Gemini-Exp-1206可以彻底退休了。

实验版本,意味着当前的Gemini 2.0 Pro还不是完全状态,不建议用于产品的生产环境。话外音,个人用户使用还是没问题的。也支持API调用,但会受到速率(rate limit)的限制。

Gemini 2.0 Pro(实验版)最新的是0205版本,老规矩,在谷歌AI Studio里可以免费使用。速率限制为每分钟2次(2 RPM),每天使用次数上限是50次。

Gemini 2.0 Pro(实验版)在上下文方面更是猛人,达到了200万tokens。这个上下文基本上已经无敌,干什么都绰绰有余。

划重点,目前来看,Gemini 2.0 Pro(实验版)是最推荐的。

最便宜的 Gemini 2.0 Flash-Lite

随着正式版Gemini 2.0 Flash发布的,还有一个Gemini 2.0 Flash-Lite,从它的名字“Lite”可以猜到,这是一个更兼具性价比的模型。

如果说Gemini 2.0 Pro(实验版)是针对OpenAI顶级模型展开的一场行动,那么Gemini 2.0 Flash-Lite无疑是针对DeepSeek进行的“狙击”。

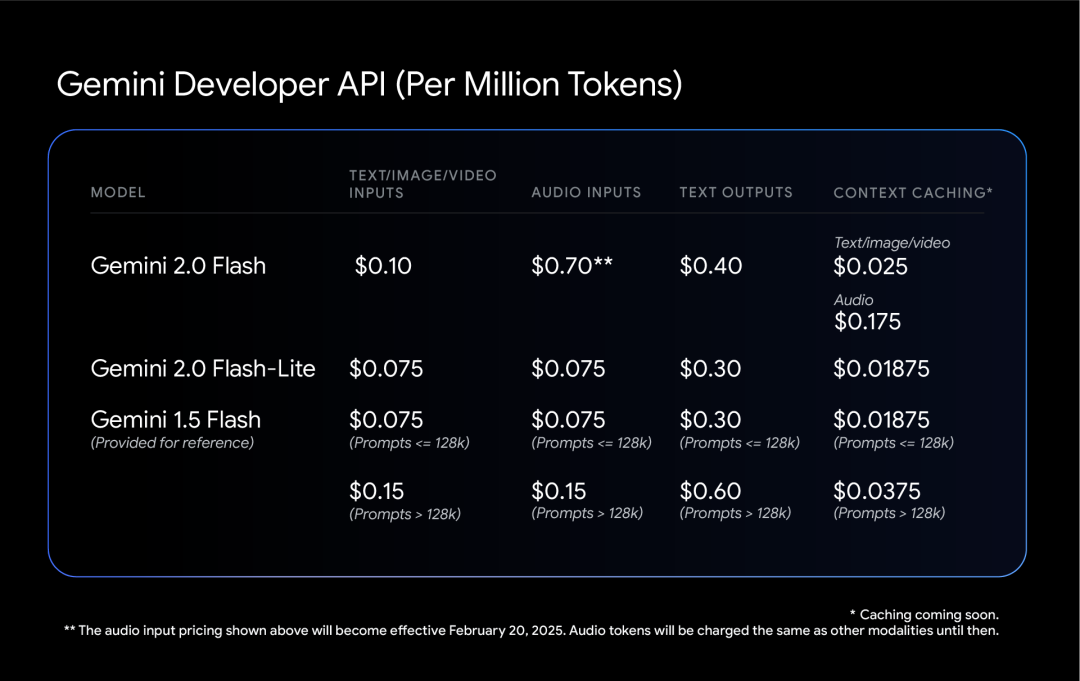

原因无他,它太太太便宜了!放上价格图对比一下。

这是谷歌新发布的Gemini 2.0 Flash和Gemini 2.0 Flash-Lite的API定价。

这是Gemini 2.0 Flash-Lite和其他对标模型的API定价对比。注:因为DeepSeek只有一个通用模型,所以此处以DeepSeek-V3为例。

比“AI领域的拼多多”DeepSeek还要便宜,谷歌这次的目的很简单,就是打价格战。

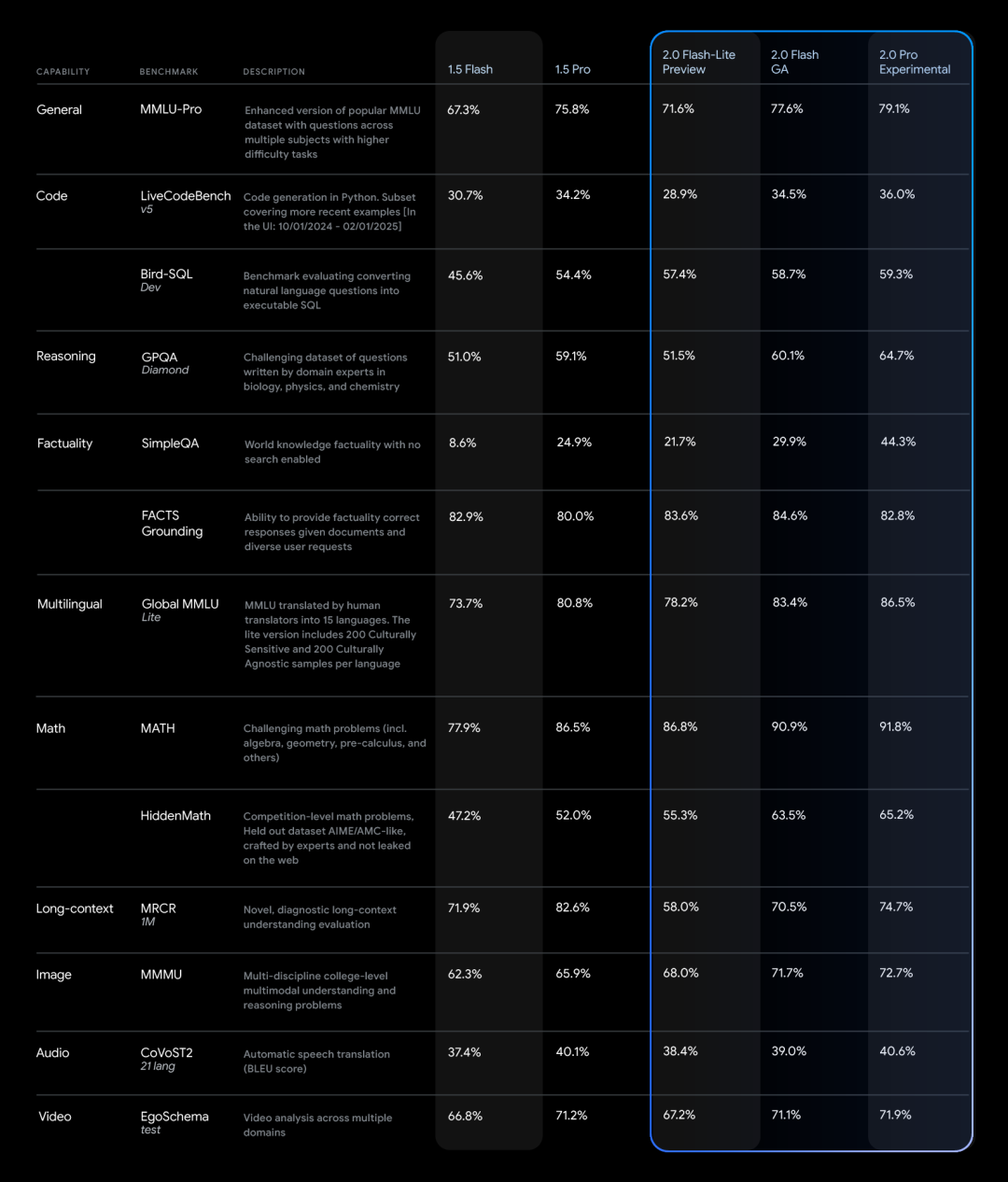

Gemini 2.0 模型基准测试

相比前代,新发布的这三个Gemini 2.0 模型的性能都有所提升。

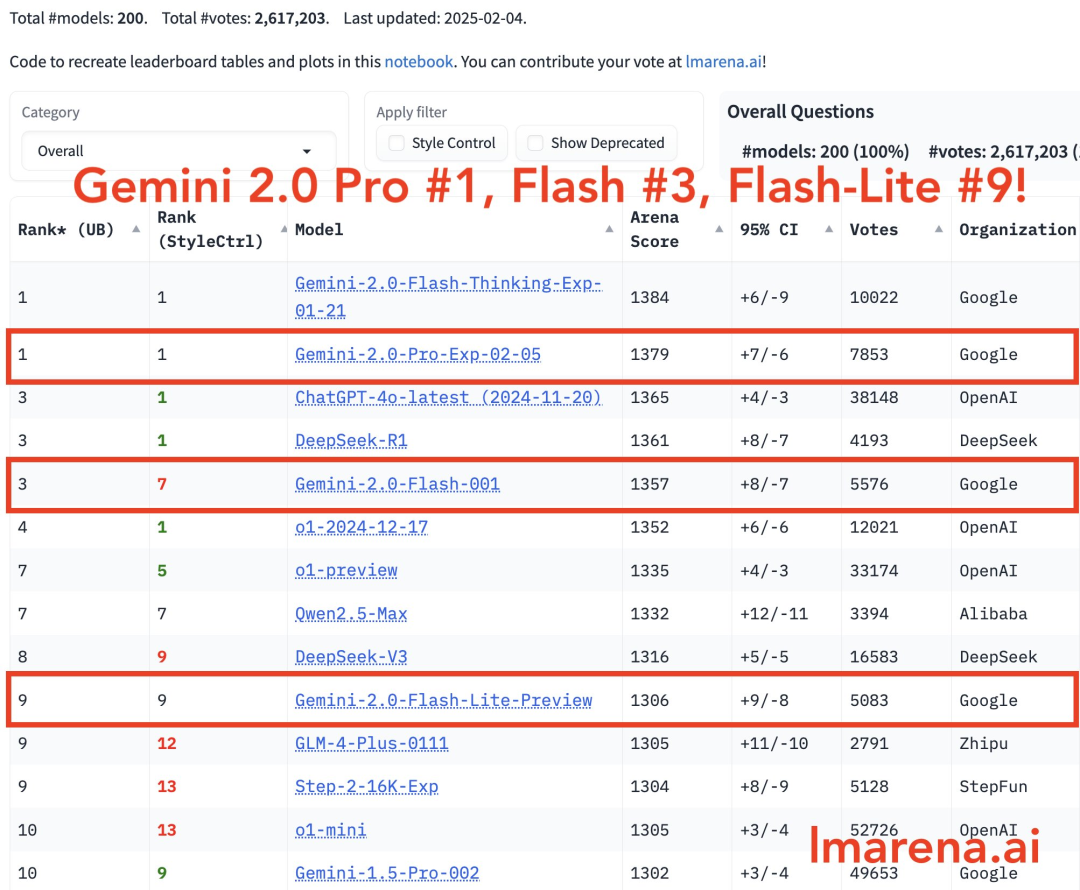

而在LMSYS排行榜中,作为Gemini-Exp-1206的升级版,Gemini 2.0 Pro(实验版)毫无疑问的出道即巅峰,占据了榜首。但目前的这个排行榜还有一些问题:没有添加OpenAI最新的o3-mini模型;在排名时附带了回复风格、回复长度等潜在影响因子,但评估模型真实能力是不应该考虑这些附加因素的。所以,在查看LMSYS排行榜时,建议勾选Style Control这个过滤项。

排名只是个参考,需要客观看待,真实体验还需要多加验证。

结语

表面上看,谷歌在发布新模型;其实,是对OpenAI和DeepSeek精准的“狙击”。

我是木易,一个专注AI领域的技术产品经理,国内Top2本科+美国Top10 CS硕士。

相信AI是普通人的“外挂”,致力于分享AI全维度知识。这里有最新的AI科普、工具测评、效率秘籍与行业洞察。

欢迎关注“AI信息Gap”,用AI为你的未来加速。

(文:AI信息Gap)