2025年2月25日,阿里巴巴Qwen团队正式发布了基于Qwen2.5-Max的深度推理模型——QwQ-Max-Preview。作为Qwen系列的最新成果,这一模型不仅在数学理解、编程、AI智能体等复杂任务中表现出色,还支持联网搜索并展示完整的思维链。这一创新的发布,标志着AI技术在深度推理领域迈出了重要的一步,也为开发者和研究人员带来了新的机遇和挑战。接下来,让我们深入了解这款模型的魅力所在。

一、项目概述

QwQ-Max-Preview是阿里通义千问团队推出的深度思考模型,基于Qwen2.5-Max构建。它在数学、编程及通用任务中展现了强大的能力,尤其在与Agent相关的工作流中表现优异。作为预览版本,QwQ-Max-Preview目前仍在持续优化中,团队计划在未来几个月内正式发布QwQ-Max。

阿里计划在不久的将来以Apache 2.0许可证开源QwQ-Max和Qwen2.5-Max,并推出Android和iOS应用程序。此外,团队还将发布更小的本地部署模型,如QwQ-32B,进一步推动AI技术的普及。这一开源计划不仅将为开发者提供更多的灵活性和定制化能力,还将加速AI技术在全球范围内的传播和应用。

二、功能特点

1、强大的推理能力

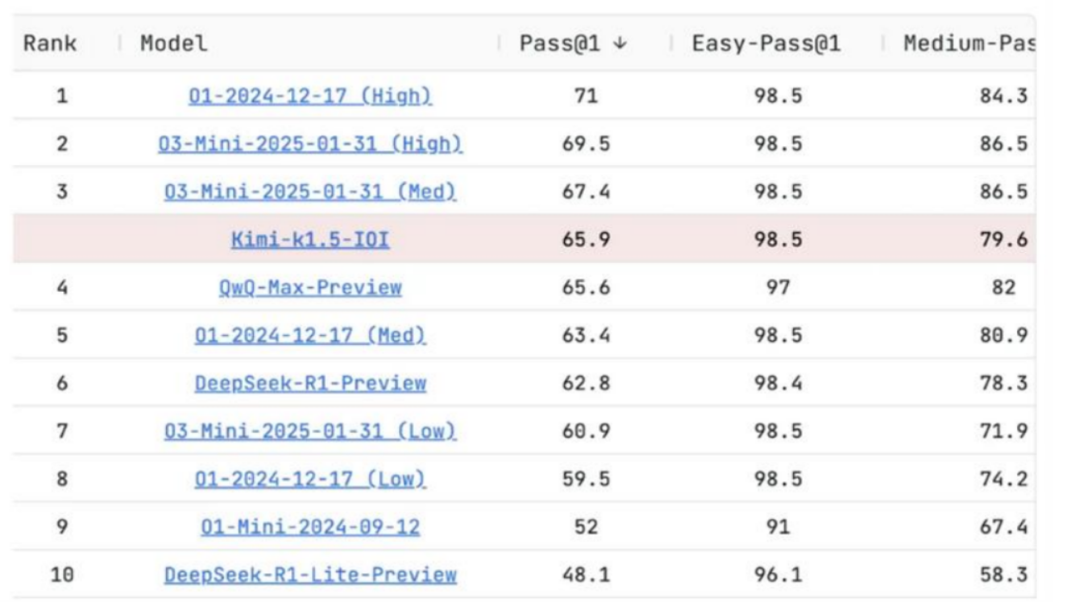

推理能力是QwQ-Max-Preview的核心优势之一。该模型能够快速、准确地处理复杂的逻辑问题和知识问答。无论是复杂的数学推理、逻辑谜题,还是需要综合多领域知识的问答,它都能应对自如。根据LiveCodeBench的评估,QwQ-Max-Preview在多项性能指标上表现出色,尤其在推理速度和代码生成的准确性方面。

2、代码生成

对于开发者而言,QwQ-Max-Preview是一个得力助手。它能够生成高质量的代码,无论是常见的功能模块还是复杂的代码逻辑,都能快速生成并附上详细的注释。例如,它可以在提示下生成71行p5.js脚本代码,并提供使用指南。

3、联网搜索与思维链展示

QwQ-Max-Preview支持联网搜索,并会展示完整的思维链。这一功能是其区别于其他模型的重要特点之一。联网搜索使得模型能够结合最新的网络信息,为用户提供更全面、更准确的答案。而思维链的展示则让用户能够清晰地看到模型是如何一步步得出结论的,这不仅增加了模型的透明度,还为用户提供了更智能、更透明的AI服务。

4、Agent功能

QwQ-Max-Preview的Agent功能十分强大,它能够根据用户需求自主调用工具和执行任务。例如,当用户提出一个复杂的任务需求时,比如策划一场线上营销活动,QwQ-Max-Preview可以自动调用网络搜索工具收集市场信息,调用内容创作功能生成活动方案和宣传文案,还能调用图像、视频生成工具制作活动素材。

三、性能表现

根据LiveCodeBench的评估,QwQ-Max-Preview的性能与o1-medium相当,且优于DeepSeek R1。在各项指标测评中,QwQ-Max-Preview在性能上具备较强的竞争力,为其在实际应用中的表现奠定了坚实基础。

四、应用场景

1、编程辅助

在编程过程中,开发者经常会遇到各种问题,如代码逻辑设计、语法错误排查等。QwQ-Max-Preview可以快速生成代码片段,为开发者提供代码实现思路。例如,在开发一个Web应用程序时,开发者想要实现用户登录和注册功能,QwQ-Max-Preview能根据需求生成相应的Python代码示例,包括数据库连接、用户验证逻辑以及前端交互代码片段等。

2、内容创作

内容创作者在工作中需要不断产出新颖、吸引人的内容。QwQ-Max-Preview可以生成高质量的文本内容,支持广告文案创作、视频脚本生成等。例如,在广告文案创作方面,它能根据产品特点和目标受众,生成具有吸引力的广告文案,突出产品优势,激发消费者购买欲望。

3、知识问答

在教育、科研、企业咨询等场景中,准确获取知识信息至关重要。QwQ-Max-Preview可以作为知识问答的有力工具,帮助学生解答学习过程中的疑问,辅助科研人员进行文献调研和知识查找,为企业提供专业的咨询服务。

4、智能办公

在智能办公领域,QwQ-Max-Preview整合了多种功能,为用户提供高效的办公体验。在资料整理方面,它可以快速对大量文档进行分类、筛选和内容提取,帮助用户快速找到所需信息。在处理企业内部的大量合同文档时,QwQ-Max-Preview能自动提取关键信息,如合同金额、签订日期、双方权利义务等,并进行分类整理,方便用户后续查询和分析。

五、快速使用

1. 访问网址:打开浏览器,访问QwQ-Max的官方网站(https://chat.qwenlm.ai/)。

2. 开启深度思考功能:进入网页界面后,找到并开启“Thinking (QwQ)”功能,以充分发挥模型的深度推理能力。

3. 输入问题或任务:在对话框中输入具体的问题或任务,比如数学问题、编程代码生成需求、创意写作主题等。在输入时,尽量描述清晰准确,以便模型更好地理解需求。

4. 等待模型响应:QwQ-Max会根据输入内容进行分析和处理,生成回答或解决方案。用户只需耐心等待,即可获取模型的输出结果。

六、未来展望

1、开源计划

阿里巴巴Qwen团队计划在不久的将来以Apache 2.0许可证开源QwQ-Max和Qwen2.5-Max。这一开源计划将为开发者提供更多的灵活性和定制化能力,同时也将加速AI技术在全球范围内的传播和应用。

2、APP发布

除了开源计划,阿里巴巴还计划推出Qwen Chat APP,让用户能够以更简单的方式与AI模型互动。这款应用将专注于实时响应体验,并与主流生产力工具无缝衔接,让全球用户随时随地享受先进人工智能带来的便利。

3、小型模型的发布

为了满足市场对高效、低资源消耗解决方案的需求,阿里巴巴将推出更小巧的QwQ系列模型,例如QwQ-32B。这些模型在大幅降低计算需求的同时,依然保持出色的推理能力,非常适合需要隐私保护或低延迟的应用场景。

结语

阿里QwQ-Max-Preview凭借其强大的推理能力、出色的性能和广泛的应用场景,为AI技术的发展带来了新的活力。无论是开发者、内容创作者,还是办公人员、科研工作者,都能从这款模型中受益。随着QwQ-Max和Qwen2.5-Max的开源,以及未来版本的持续优化,这款模型有望在更多领域发挥更大的作用,推动各行业的智能化进程。

项目地址

体验地址:https://chat.qwen.ai/

官网地址:https://qwenlm.github.io/zh/blog/qwq-max-preview/

(文:小兵的AI视界)