衡宇 假装发自 凹非寺

量子位 | 公众号 QbitAI

嚯,万众期待的GPT-4.5,本周就要空降发布?!

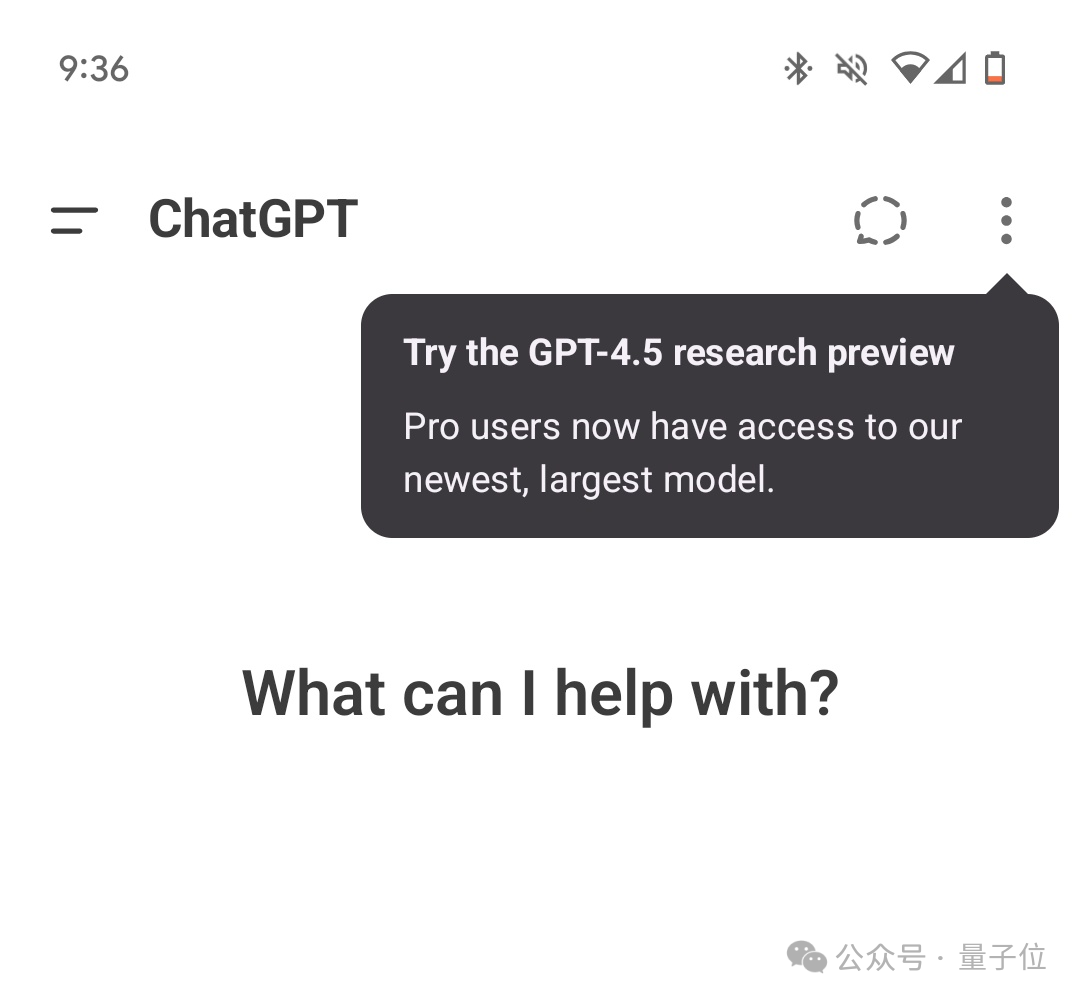

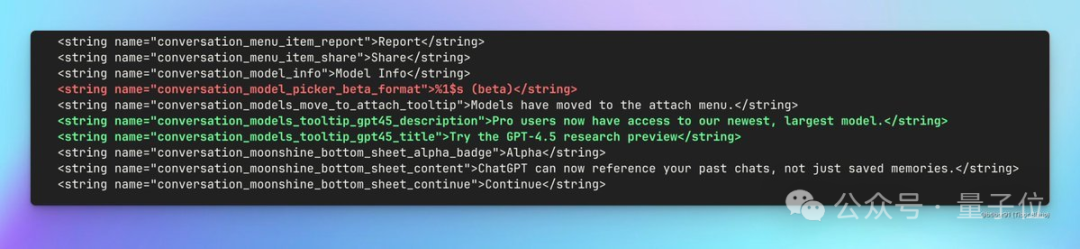

部分用户的ChatGPT安卓版本(1.2025.056 测试版)上,已经出现了“GPT-4.5研究预览(GPT-4.5 research preview)”的字样。

下面紧跟着一段注释:

Pro订阅用户现在可以访问我们最新、最大的模型。

网友们还贴出了更详细的截图。

而网络上,更多关于GPT-4.5的消息被各方人士曝光,几乎都能靠这些碎片爆料完成一整块拼图了(真诚脸.jpg)。

咱们来看——

OpenAI最后一个非推理模型的爆料速览

两周前,奥特曼本人曾大张旗鼓在自己的推特上剧透,“GPT-4.5将在未来几周内发布”。

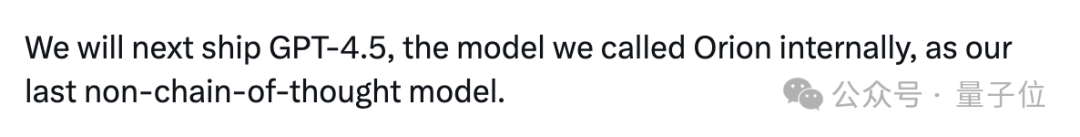

也证实了GPT-4.5是此前多次被曝光的Orion(猎户座)——Orion从去年8月浮出水面,它的定位是OpenAI新旗舰,也就是GPT-4的下一代。

同时奥特曼明确表示,GPT-4.5将会是OpenAI最后一个非推理模型。

在发布GPT-4.5后,OpenAI将会把GPT系列和o系列模型合并为一个单一的AI。

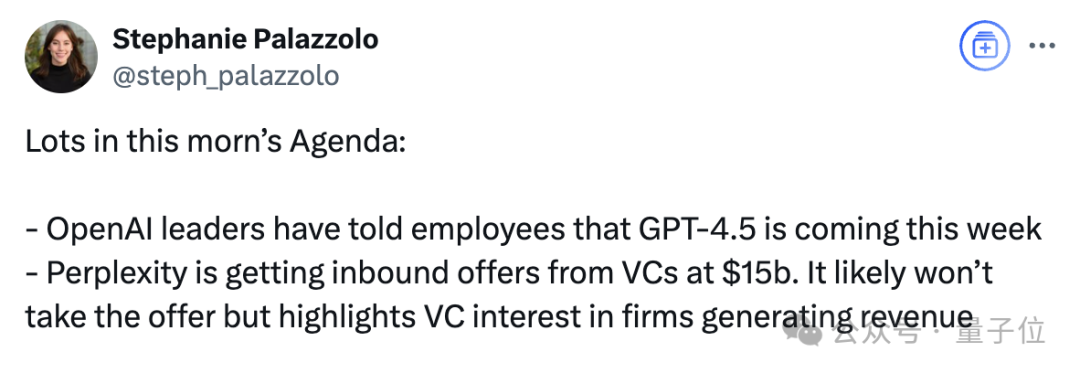

So,就在“未来几周内”的今天,推特上,来自The information的Stephanie Palazzolo感慨了下自己今天忙碌的晨会都说了些啥。

第一条就是:“OpenAI领导者告诉员工,GPT-4.5将于本周推出。”

本周?今天周四了哎!

那……

而且GPT-4.5即将在本周空降的消息并不只是一家之言,网络上,陆陆续续有人站出来说出了自己来源神秘的已知信息。

量子位筛选整理,与大家一起先睹为快。

GPT-4.5基本资料

目前网络上曝光的GPT-4.5是一个参数爆表的庞然大物。

具体来说,它是一个1T激活参数的Transformer MoE模型,在120T tokens数据上训练。

友情提示,GPT-4是1.8T的总参数。

它的上下文窗口长度为256K,自带知识截至2024年6月。

此外,GPT-4.5还是一个具有人类视觉水平的Agent。

不是推理模型,但……

尽管奥特曼已经说过,GPT-4.5不是一个推理模型。

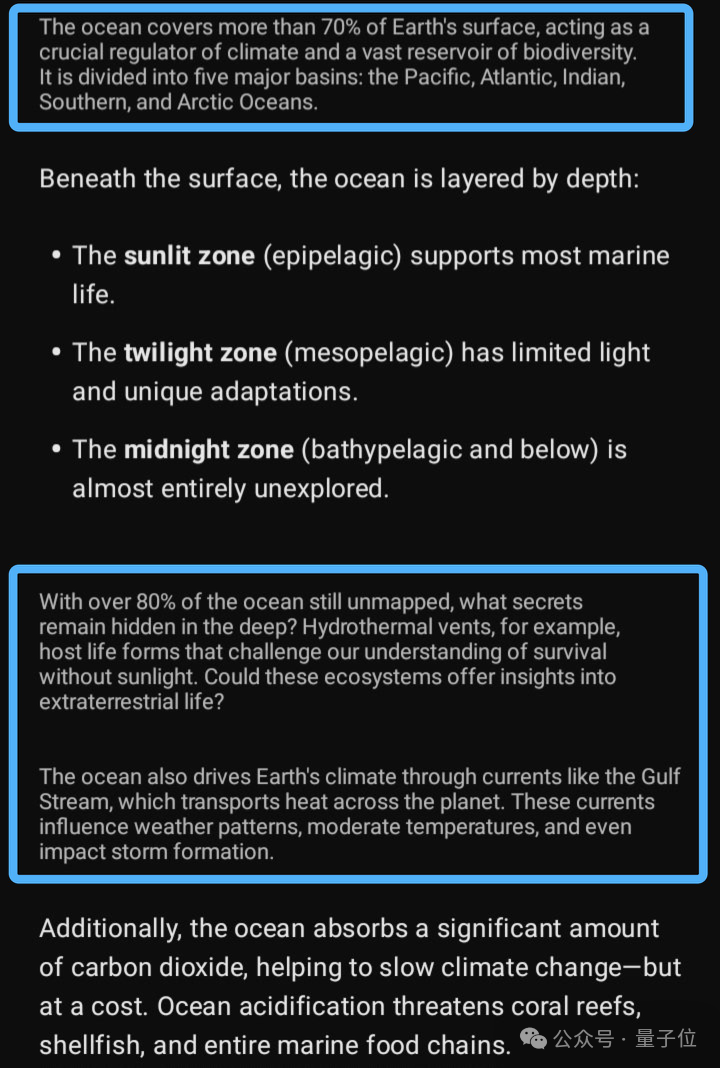

但有人发现,它吐输出的过程非常与众不同。

具体来说,GPT-4.5是边思考边吐结果的,而不是一次思考过后只吐一次结果。

下面这张图是爆料人提供的GPT-4.5回复结果,蓝色框选部分是它的思考,思考一会儿后它会吐出阶段性输出,然后继续思考一会儿,然后再吐出阶段性输出……

尽管不是长CoT,但这看起来还是和奥特曼预告的“非推理模型”有些出入。

具体怎么样,只有等真·发布过后大家才知道啦~

不过有网友猜测,这一切都基于GPT-4.5已经对整个互联网进行了RAG处理。

能画动画SVG来会“唱歌”

神通广大的网友,爆出来的料都是列文虎克级别的——

连GPT-4.5新增功能及其效果都一并发出来给吃瓜群众看。

主要新增能力有二。

1)GPT-4.5,它可以制作动画SVG文件。

和它提提修改意见,大概交流3-4轮过后,你将得到一个会翻白眼的蒙娜丽莎(?):

2)GPT-4.5可以零样本制作音乐。

但请注意,它很有原则:拒绝制作受版权保护的歌曲。

来听一段来自不知名的贝多芬选手的变奏,由GPT-4.5生成:

讲道理,OpenAI上一次发音乐模型还是上一次,那是5年的事情了。

Jukebox,2020年4月30日发布,是一个能够在原始音频域中生成音乐的模型,通过提供音乐流派、艺术家甚至歌词的信息,Jukebox可以生成完整的音乐作品,包括人声部分。

如果传闻为真,那GPT-4.5的多模态能力再加1分。

速度更快,且很便宜

相关爆料人仅有这短短一句话,但非常期待1T激活参数的GPT-4.5,到底能有多便宜……

任务表现好坏参半

虽然GPT-4.5应该很快和大家见面,不过!

大家不要过于兴奋。

一位测试过该模型的人士透露,GPT-4.5在某些任务上的表现好坏参半。

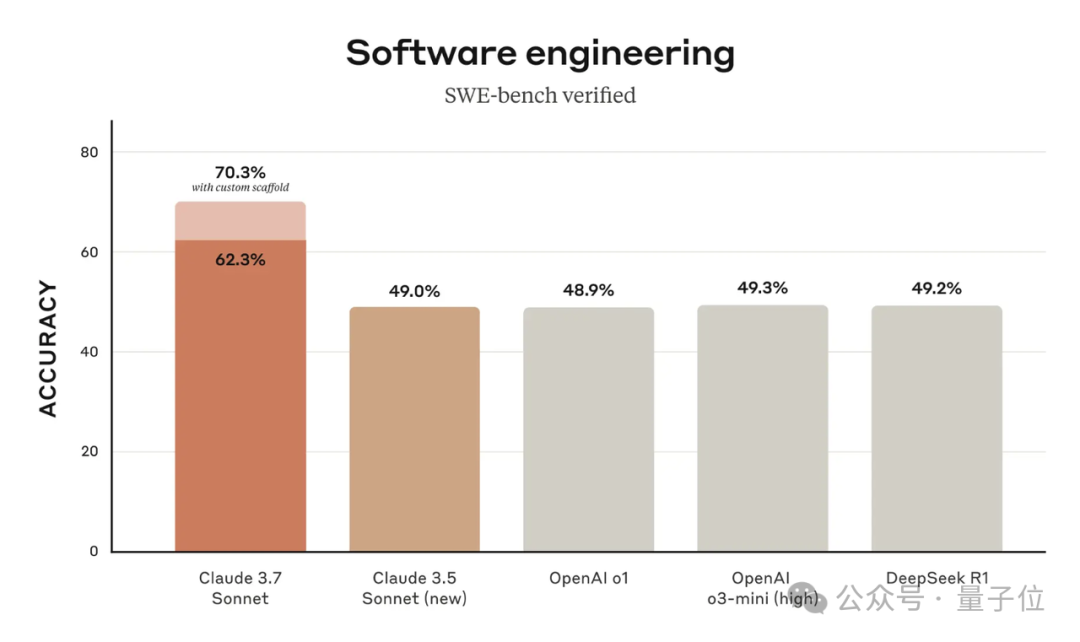

譬如,Anthropic前天发布的混合推理模型Claude 3.7 Sonnet,就在某些基准测试中击败了它。

根据Claude系列素来的强项,很难不怀疑至少包含编程领域……

One More Thing

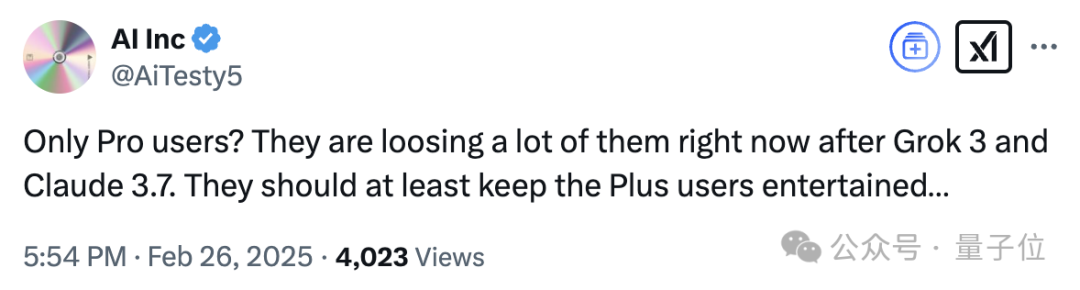

最后最后,大家一定要注意,根据现有信息,GPT-4.5首批似乎只针对Pro用户开放。

就是一个月200美元那档。

这就搞得很多网友都有些不爽,毕竟OpenAI现在四面受敌,至少也应该让Plus用户也抢先体验上吧??

但有网友发出这样的推论:

“奥特曼嘛,大模型届的老营销高手了。他也许先放出风声,说首批体验GPT-4.5的只有Pro用户,然后后面告诉大家,我们也开放给Plus用户,这样大家就会对他好感度up up~”

咦,这个道理好像在哪里听过,就是想开窗先告诉大家要拆房顶(手动狗头)。

但在正式发布之前,一切都是未知数。

还是那句话,“本周发布”,且今天已经是周四,大家不用着急,再等一会儿吧~

参考资料:

[1]https://x.com/steph_palazzolo/status/1894785791018332505

[2]https://x.com/WesRothMoney/status/1894802107812737153

[3]https://x.com/ai_for_success/status/1894827569989734746

[4]https://x.com/Zzullerr/status/1894834009655443505

[5]https://x.com/literallydenis/status/1894843775769551228

[6]https://x.com/techikansh/status/1894697272966820028

[7]https://x.com/taker_of_whizz/status/1894775460602540147

[8]https://x.com/literallydenis/status/1894851640940761169

[9]https://x.com/imjustnewatai/status/1894547958240084148

—

(文:量子位)