极市导读

一种高效的多视角目标跟踪方法MITracker,它通过融合多视角特征解决了传统单视角跟踪中的遮挡和目标丢失问题,并通过构建大规模多视角跟踪数据集MVTrack推动了该领域的发展。 >>加入极市CV技术交流群,走在计算机视觉的最前沿

Title: MITracker: Multi-View Integration for Visual Object Tracking

论文: https://arxiv.org/abs/2502.20111

主页: mii-laboratory.github.io/MITracker/

动机:

视觉目标跟踪是计算机视觉领域的核心任务之一,广泛应用于增强现实、自动驾驶等场景。然而,传统的单视角跟踪方法在面对遮挡、目标丢失等挑战时表现不佳。尽管多视角跟踪(MVOT)通过多视角信息的互补性提供了潜在的解决方案,但该领域的发展受到以下限制:

-

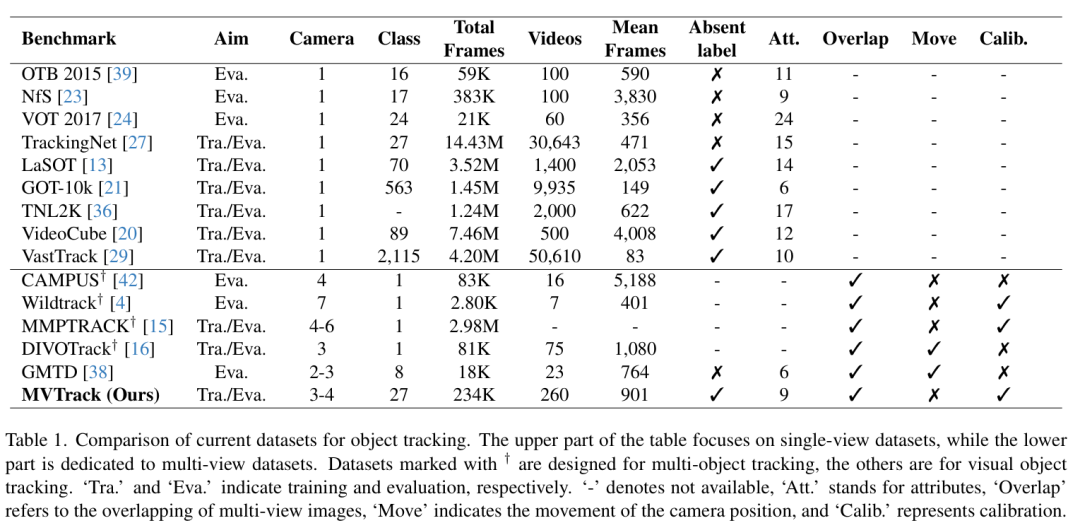

数据集限制:现有的多视角数据集大多局限于特定类别(如行人或鸟类),缺乏通用性。

-

方法限制:现有的多视角跟踪方法主要依赖于检测和重识别技术,难以实现类无关的目标跟踪。

-

跨视角信息融合不足:现有的方法在跨视角信息融合方面效果有限,难以应对复杂的空间关系和视角变化。

为了解决这些问题,我们提出了一个新的多视角跟踪数据集 MVTrack 和一个高效的多视角跟踪方法 MITracker,旨在通过多视角信息的融合提升跟踪的鲁棒性和准确性。

本文贡献:

-

MVTrack数据集:我们构建了一个大规模的多视角跟踪数据集,包含234K高质量标注帧,涵盖27个不同类别的物体和9种具有挑战性的跟踪属性(如遮挡、变形等)。MVTrack是首个支持类无关多视角跟踪训练和评估的综合性数据集。

-

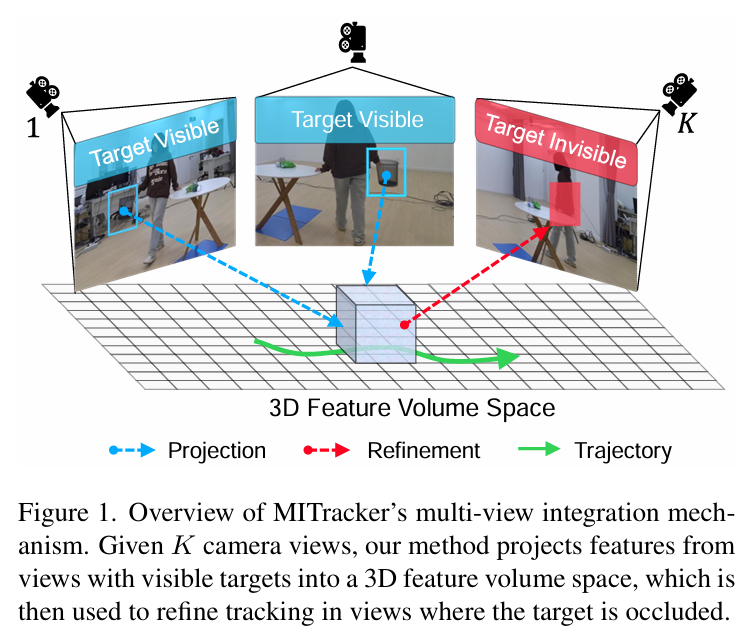

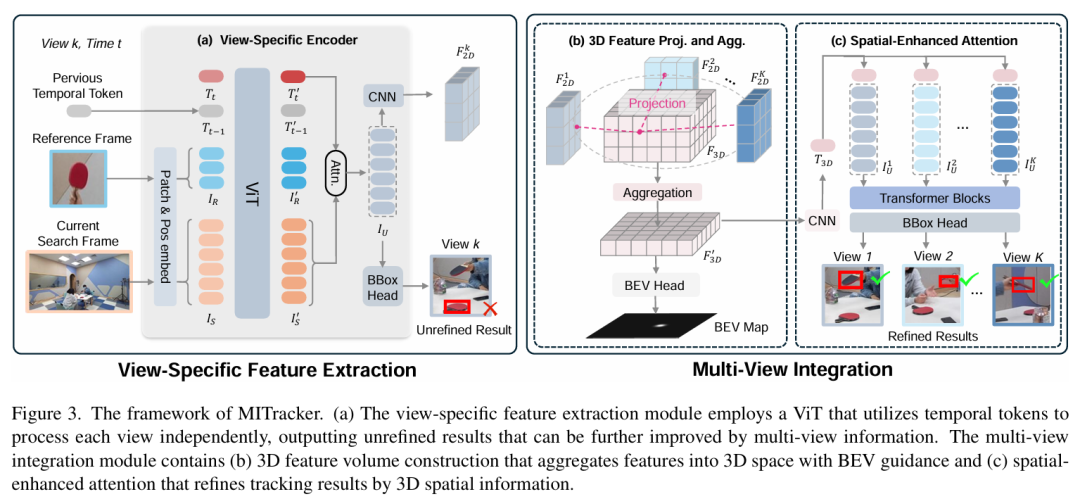

MITracker方法:我们提出了一种新颖的多视角跟踪方法MITracker,通过将2D图像特征转换为3D特征体积,并利用鸟瞰图(BEV)引导的多视角信息融合机制,显著提升了跟踪的稳定性和准确性。

-

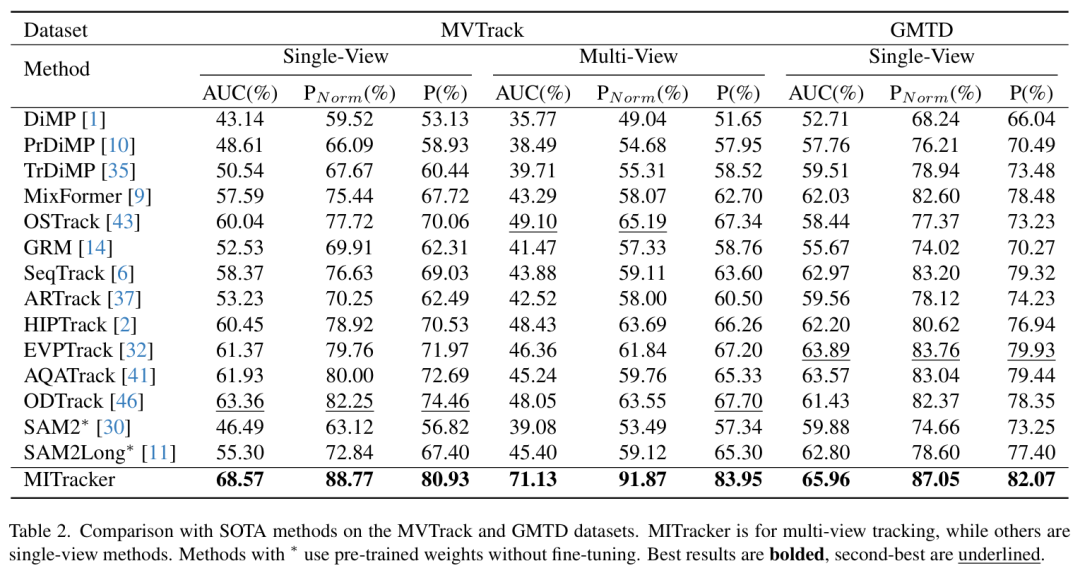

性能提升:MITracker在MVTrack和GMTD数据集上均达到了最先进的性能,特别是在遮挡和目标丢失等复杂场景下,恢复率从56.7%提升至79.2%。

MVTrack数据集特性:

-

多视角数据:3-4个同步相机拍摄,确保多视角重叠。

-

丰富类别:涵盖27个日常物体,从小型物体(如笔)到大型物体(如雨伞)。

-

高质量标注:每帧提供精确的2D边界框(BBox)和鸟瞰图(BEV)标注。

-

挑战性属性:包含9种常见的跟踪挑战,如背景杂乱、运动模糊、部分遮挡、完全遮挡、目标消失等。

-

大规模数据:包含260个视频,总计234,430帧,分为训练集、验证集和测试集。

MITracker方法亮点:

-

多视角特征融合:通过将多视角的2D特征投影到3D空间,并利用BEV引导的特征聚合,显著增强了模型的空间理解能力。

-

空间增强注意力机制:通过引入3D感知的注意力机制,MITracker能够在目标丢失或遮挡的情况下快速恢复跟踪。

-

高效跟踪:MITracker能够在任意长度的视频帧中跟踪任意物体,并在多视角场景下保持稳定的跟踪效果。

实验与结果:

我们在MVTrack和GMTD数据集上进行了广泛的实验,MITracker在多个评估指标上均达到了最先进的性能。特别是在多视角场景下,MITracker的表现显著优于现有的单视角跟踪方法,展示了其在复杂场景下的强大鲁棒性。

未来工作:

我们计划进一步扩展MVTrack数据集,增加室外场景和更多类别的物体,以提升模型的泛化能力。同时,我们也将探索减少对相机校准的依赖,使MITracker在更多实际场景中应用。

总结:

MITracker通过多视角信息的有效融合,解决了传统单视角跟踪中的遮挡和目标丢失问题,为多视角视觉目标跟踪领域提供了新的解决方案。我们相信,MVTrack数据集和MITracker方法将为未来的研究提供强有力的支持,推动视觉目标跟踪技术的进一步发展。

(文:极市干货)