这几天正值清明假期,没想到Meta居然挑了个我们假期深夜扔出重磅炸弹——Llama 4系列正式开源!

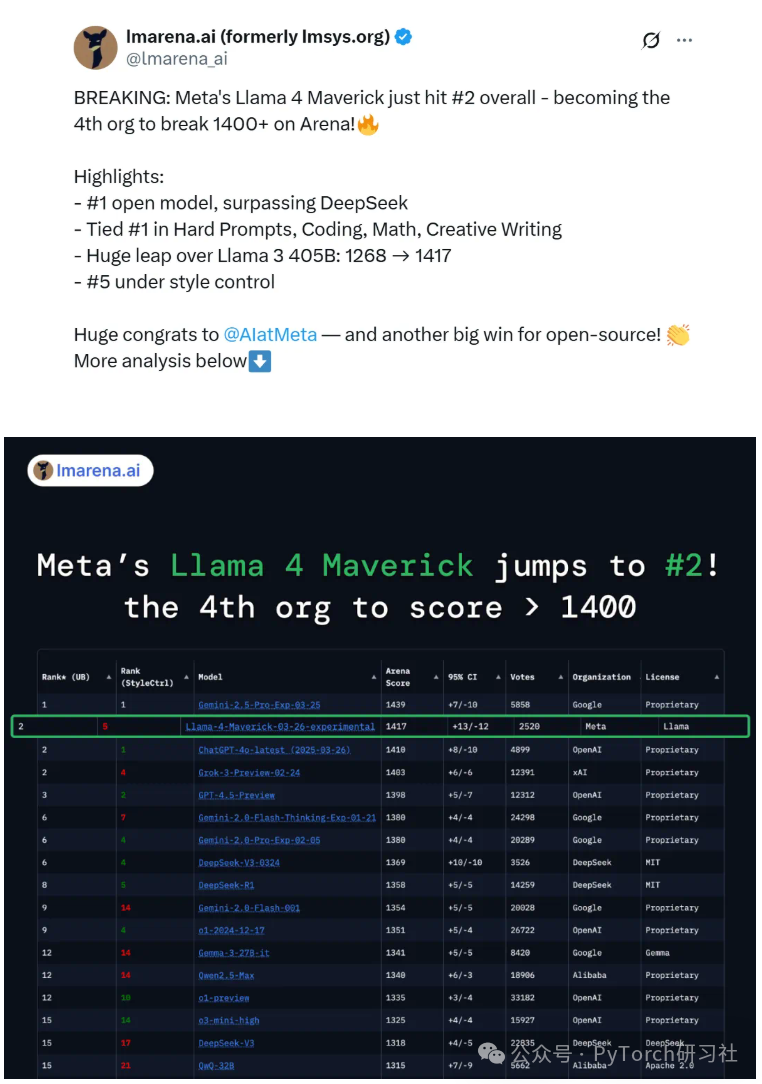

作为Llama家族的最新成员,这次升级可不是小打小闹,直接把AI模型的性能和玩法推到了新高度。想知道有多强?竞技场排名第二,超越DeepSeek,连自家Llama 3都被甩了好几条街。话不多说,咱们一起来看看这次Meta是怎么“卷”出新花样的!

三款新模型,个个有绝活

Llama 4这次一口气推出了三兄弟:Scout、Maverick和Behemoth,名字听着就很带感。它们都经过海量文本、图像和视频数据训练,不仅能聊会写,还能看懂图,堪称“全能选手”。

-

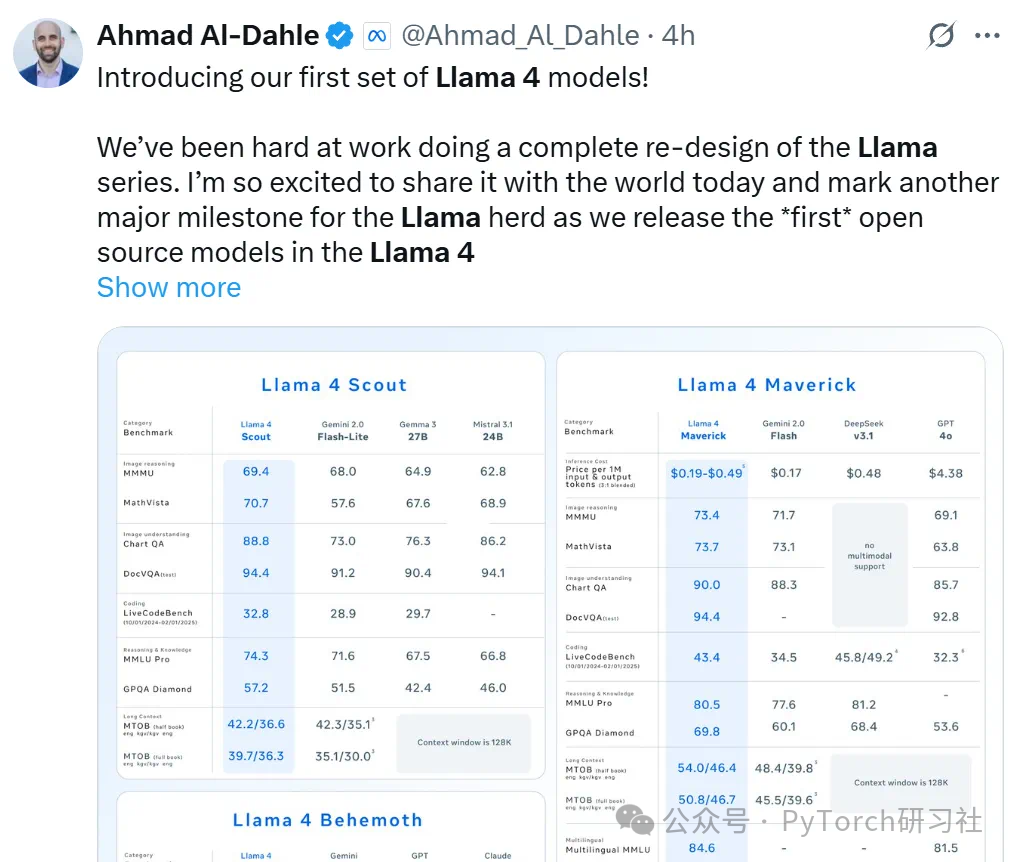

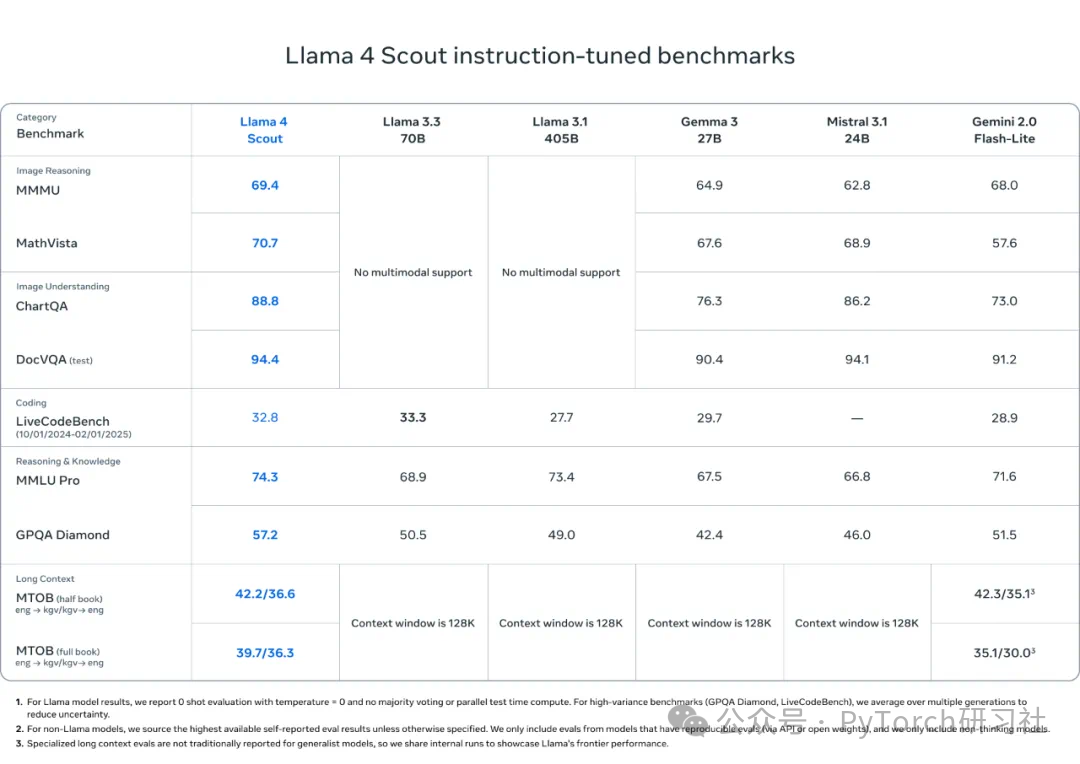

Llama 4 Scout:小而美,170亿激活参数,16个专家,主打多模态,能塞进单个NVIDIA H100 GPU。别看它“瘦”,性能却能吊打Gemma 3和Mistral 3.1,尤其擅长超长上下文——1000万token的窗口,行业第一,随手解锁记忆、个性化新玩法。

-

Llama 4 Maverick:中流砥柱,128位专家,170亿激活参数,竞技场ELO得分1417,干翻GPT-4o和Gemini 2.0 Flash,编程、推理直接对标DeepSeek v3,性价比拉满。上传张图随便问,它都能秒懂。

-

Llama 4 Behemoth:大哥级存在,2880亿激活参数,16个专家,总参数接近2万亿!目前还在训练中,但已经能碾压GPT-4.5和Claude 3.7 Sonnet,STEM任务表现亮眼,未来可期。

这三款模型都出自Meta对开源AI的“执念”。负责人Ahmad Al-Dahle放话:开放系统才是王道,小模型、中模型到前沿大模型,Meta都要玩出极致。

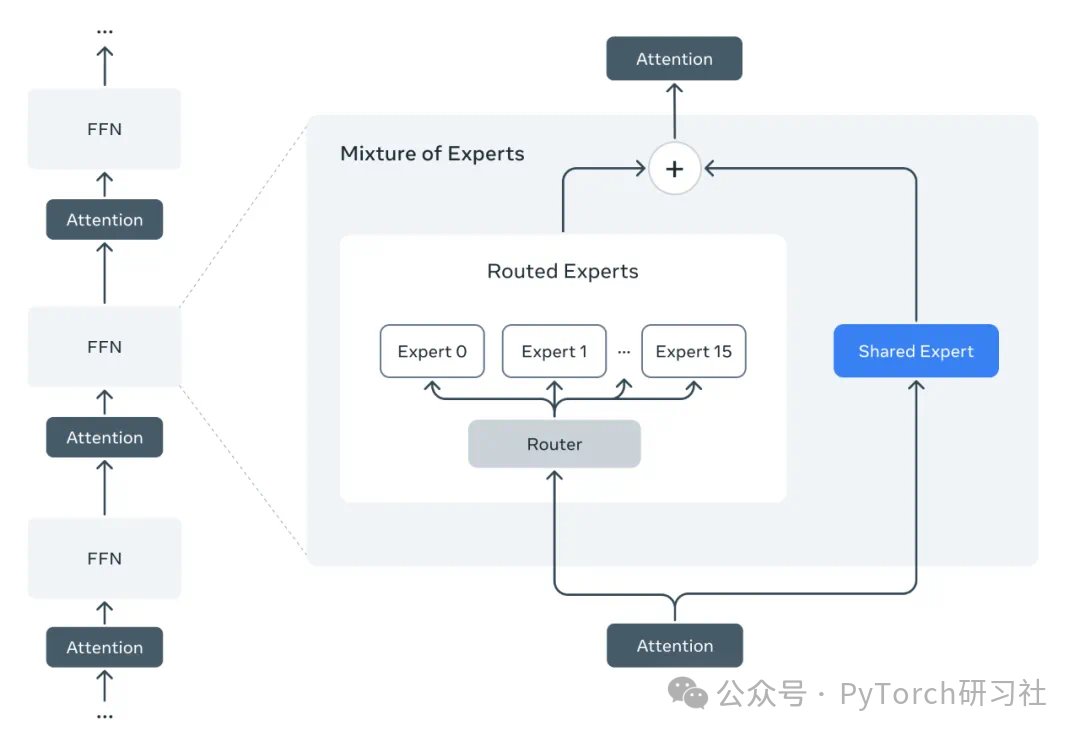

MoE初登场,效率和质量双开花

这次Llama 4最大的亮点之一是首次用上了混合专家(MoE)架构。简单来说,就是不让所有参数同时“上班”,一个token只激活一部分专家,既省算力又提效率。以Maverick为例,总参数4000亿,但实际激活的只有170亿,推理时还能跑在单个H100上,部署成本直线下降。

MoE层里,Meta玩了个花活:128个路由专家+1个共享专家,每个token都被聪明分配,既快又准。这种设计让Llama 4在训练和推理时都比传统密集模型更“聪明”,质量直接起飞。

1000万token上下文,谁看了不喊牛?

如果说MoE是效率担当,那1000万token的超长上下文就是Llama 4的“杀手锏”。Scout直接把上下文长度拉到行业天花板,啥概念?随便丢一堆文档、代码甚至聊天记录,它都能记住前因后果,推理、总结、个性化推荐都不在话下。大海捞针测试里,这家伙的表现更是让人服气。

多模态天赋,拉满视觉理解力

Llama 4还是原生多模态设计,文本、图像无缝融合。上传张图,可以问它任何有关这张图片的问题,它能精准回答。

还能把回答锚定到图片区域。

视觉编码器升级后,模型对图像的理解更细腻,12种语言随便切,全球开发者直接开卷。

竞技场硬刚,数据说话

Maverick在“大模型竞技场”里一战成名,总排名第二,开源模型第一,得分从Llama 3的1268飙到1417。编程、数学、创意写作样样第一,风格控制也排第五,硬刚GPT-4o和DeepSeek v3不落下风。

Scout在中小模型里也是王者,图像、长上下文、推理全线开挂。

Meta的野心:开源+极致性能

这次Llama 4的预训练数据超30万亿token,比Llama 3多了一倍还多,200种语言加持,FP8精度训练硬是榨出每GPU 390 TFLOPs的算力。后训练阶段,Meta还祭出SFT+RL+DPO组合拳,硬生生把模型的对话和推理能力调到顶尖。

好消息是,Scout和Maverick已经能在llama.com和Hugging Face下载,想体验的同学可以立刻上手试试。Behemoth还在“健身房”里苦练,Meta承诺后续会放更多料。

llama.com:https://www.llama.com/llama-downloads/

Hugging Face 地址:https://huggingface.co/meta-llama

写在最后

谷歌CEO劈查伊都忍不住点赞:“AI世界永远不缺惊喜,恭喜Llama 4团队!”

确实,从MoE到千万token,再到多模态硬核表现,Meta这次不仅卷技术,还卷出了开源社区的新高度。你觉得Llama 4能火多久?欢迎留言聊聊你的看法!

文章来源:PyTorch研习社

(文:PyTorch研习社)

都是吊打对方。。