机器之心编辑部

谷歌的 AI,再次站在了引领业界的位置。

北京时间今天凌晨 1 点,今年的 Google I/O 2025 开发者大会正式开启。谷歌最近的大模型技术风头正劲,今年的这场「科技春晚」吸引了全球关注的目光。

没有意外,今年的核心主题自然是 AI。会上,谷歌发布或升级了一系列 AI 相关工具和服务,如下图所示。

不过也有一些预料之外的发布。

下面我们就来概括性地盘点一番 Google I/O 2025 开发者大会这场 AI 的盛宴。

Gemini 大爆发

首先最重要的就是基础模型。

今年,Gemini 无疑是 Google I/O 2025 开发者大会上最亮眼的关键词。谷歌不仅为其带来了新升级,同时还推出了一系列围绕 Gemini 开发的工具。

2.5 Pro 不仅在学术基准测试中表现出色,如今更是 WebDev Arena 和 LMArena 排行榜上全球领先的模型,在帮助人们学习方面也同样出色。

DeepMind 为 2.5 Pro 和 2.5 Flash 带来了全新功能:原生音频输出 —— 能实现更自然的对话体验;先进的安全保障;以及 Project Mariner 的计算机使用功能。

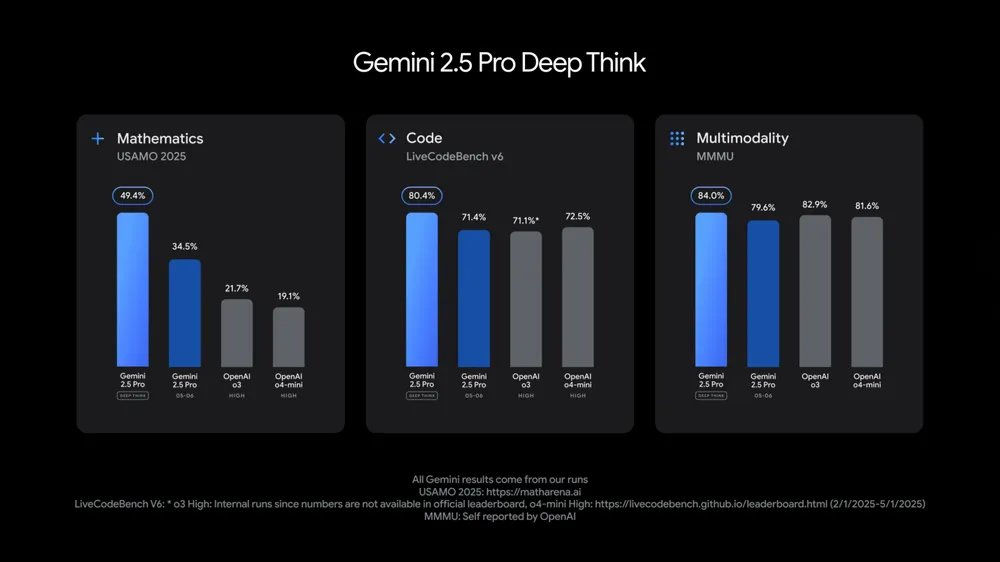

Deep Think 还能进一步提升 2.5 Pro 的能力,这是一种实验性的增强型推理模式,适用于高度复杂的数学和编码。

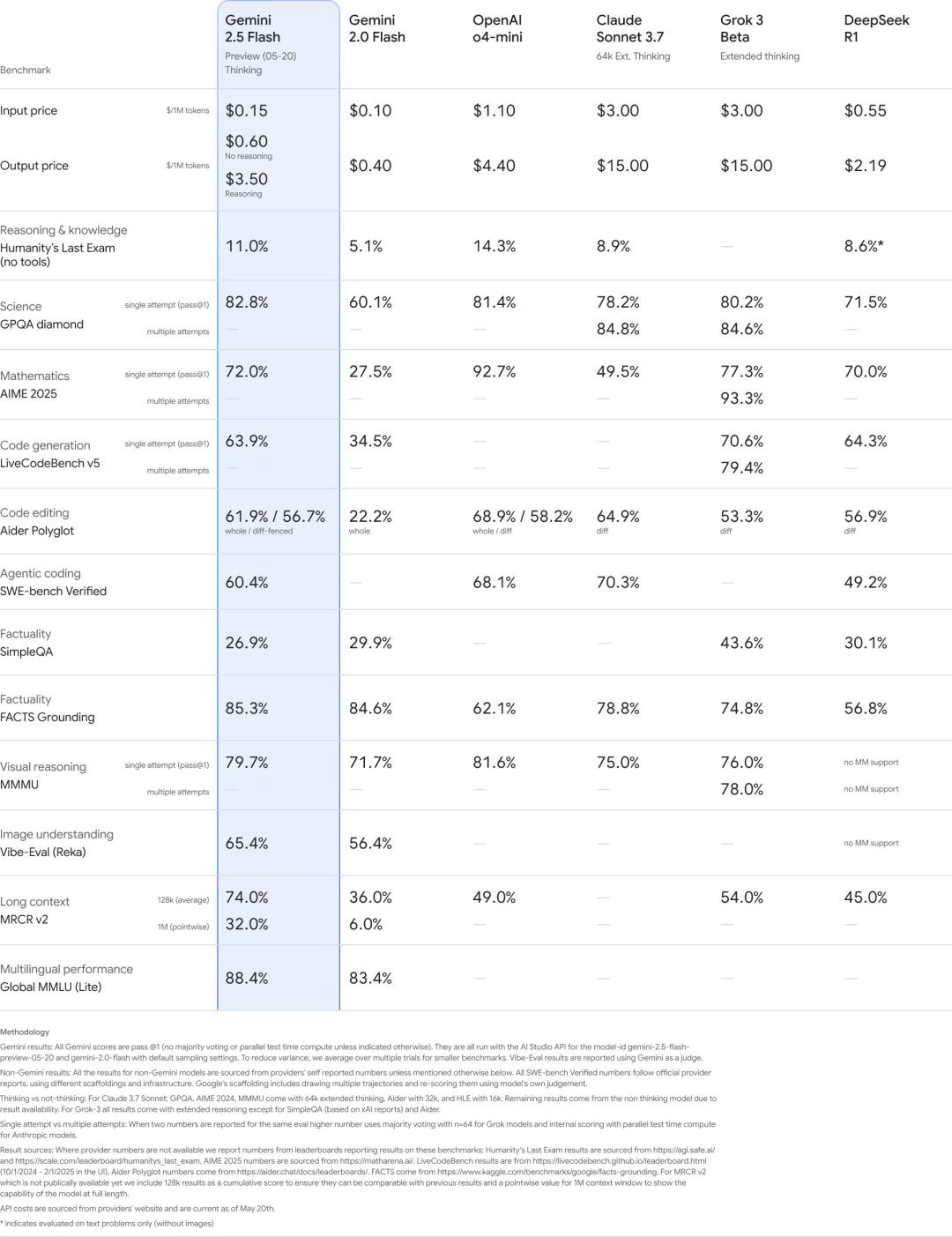

另外, 最高效的主力模型 Gemini 2.5 Flash 也在多个维度上得到了提升,包括推理、多模态、代码和长上下文等关键基准,同时效率进一步提升。在 DeepMind 自家的评估中,使用的 token 也减少了 20-30%。

2.5 Flash 现已在 Gemini 应用中面向所有用户开放,DeepMind 计划将于 6 月初在面向开发者的 Google AI Studio 和面向企业的 Vertex AI 中正式发布更新版本,2.5 Pro 也将很快发布。

谷歌还在 Gemini API 和 Vertex AI 中引入思维摘要(thought summaries)功能,以提高透明度;将思维预算扩展到 2.5 Pro 以增强控制力;并在 Gemini API 和 SDK 中增加对 MCP 工具的支持,以便用户访问更多开源工具。

另外,谷歌还宣布了一个名叫 Gemini Diffusion 的新模型。从名字上看,这应该是一个采用了扩散模型的 AI。

为了提升大模型推理速度,以进一步贴近生产应用,Google DeepMind 正在使用「扩散」技术来探索新的语言模型方向,该模型旨在为用户提供更强大的控制力、创造力和文本生成速度。

扩散模型的工作原理有所不同。它们不是像大语言模型那样直接预测下个文本 token,而是通过逐步细化噪声的方式来学习生成输出。这意味着它们可以快速迭代解决方案,并在生成过程中进行错误纠正。这有助于它们在编辑等任务中表现出色,包括在数学和代码环境中。

谷歌表示:「这个新的最先进的文本模型不仅速度快,而且速度非常快,今天发布的 Gemini Diffusion 实验演示的生成速度是我们迄今为止最快模型的五倍,同时具有相当的编程性能。」

谷歌表示,Gemini Diffusion 的推理速度可以达到每 12 秒 10095 token。

对这个新模型感兴趣的读者可以在这里加入等待列表:

https://docs.google.com/forms/d/1aLm6J13tAkq4v4qwGR3z35W2qWy7mHiiA0wGEpecooo/viewform?edit_requested=true

Gemini 应用的未来也值得期待。Demis Hassabis 亲自撰写了一篇题为「我们构建通用 AI 助手的愿景」的博客文章,其中写到:「我们正在将 Gemini 扩展为一个世界模型,它可以通过模拟世界的各个方面来制定计划并想象新的体验。」

「我们的终极愿景是将 Gemini 应用打造成一个通用的 AI 助手,它可以为我们执行日常任务,处理日常的日常管理,并提供令人愉悦的新建议,从而提高我们的工作效率,丰富我们的生活。」

这一愿景的起点是 Project Astra,谷歌基于其首次探索了视频理解、屏幕共享和记忆功能等功能。

在过去的一年里,谷歌一直在将这些功能集成到 Gemini Live 中,以便让更多人体验到这些功能。同时,谷歌也在创新,例如,升级了语音输出,使其更加自然地融入原生音频,改进了记忆功能,并增加了计算机控制功能。

编程工具升级

既然是开发者大会,那必然少不了编程工具的升级。在这方面,谷歌可以说是火力全开。

首先,谷歌正式宣布了前两天悄然上线的编程智能体 Jules。据介绍,Jules 是一款异步、智能体式的编码助手,可直接与用户现有的代码库集成。它可将用户代码库克隆到安全的 Google Cloud 虚拟机 (VM) 中,了解项目的完整上下文,并执行编写测试、构建新功能、提供音频更新日志、修复错误、升级依赖项版本等任务。

Jules 以异步方式运行,让用户可在 Jules 后台运行时专注于其他任务。完成后,它会展示其计划、推理过程以及所做更改的差异。Jules 默认为私有 —— 谷歌承诺不会使用用户的私有代码进行训练,并且会在执行环境中隔离用户数据。

目前,Jules 处于公测阶段(beta),访问免费,但使用量会受到限制。谷歌表示会在公测结束后推出定价机制,想要尝鲜的可得抓紧。

此外,谷歌还宣布了 Gemini Code Assist 的新升级。Gemini Code Assist 是谷歌几个月前发布的 AI 编程助手,其中包括个人版 Gemini Code Assist for individuals 和代码审查智能体 Gemini Code Assist for GitHub。谷歌表示:「自二月份发布预览版以来,我们一直在征求意见、听取反馈,并逐步实现开发者所需的功能。」

现在,谷歌宣布 Gemini Code Assist 个人版和 GitHub 版正式发布,开发者可以在不到一分钟的时间内上手。Gemini 2.5 现已支持 Gemini Code Assist 的免费版和付费版,拥有更强大的编程性能;可帮助开发者在创建视觉效果出色的 Web 应用以及代码转换和编辑等任务上表现出色。

此外,谷歌还宣布为 Gemini Code Assist 提供了更多自定义选项,包括更多自定义工作流程以适应不同项目需求的方式,更轻松地从上次中断的位置继续执行任务的功能,以及用于强制执行团队编码标准、样式指南和架构模式的新工具。

另外,Gemini Code Assist 标准版和企业版开发者也已经可以使用 200 万 token 的上下文窗口,这能帮助开发者完成大规模的复杂任务,例如错误追踪、代码转换以及为新用户生成全面的入门指南。

谷歌还展示了一个使用统计数据:Gemini Code Assist 可将开发者完成常见开发任务的成功率提高 2.5 倍。

感兴趣的用户可以在 VS Code 或 JetBrains IDE 中下载 Gemini Code Assist 插件,并通过 GitHub 应用访问代码审查智能体。此外,用户现在还可以利用 Android Studio for Business 中的 Gemini,在 Android 开发生命周期的每个阶段充分利用 Gemini。

谷歌还推出一款全新的 AI 驱动式 UI 工具:Stitch。它能基于自然语言描述或图像提示词,生成适用于桌面和移动设备的高质量 UI 设计及相应的前端代码。Stitch 能让用户快速将创意变为现实,以对话方式迭代设计,调整主题,并轻松将自己的作品导出为 CSS/HTML 或 Figma 以继续创作。

谷歌还宣布了 Colab 和 Firebase Studio 的一些功能升级。其中 Colab「很快就会具有一种全新的、完全智能体的体验。只需告诉 Colab 你想要实现的目标,它就会在你的笔记本中执行操作,修复错误并转换代码,从而帮助你更快地解决难题。」可以期待一下。

最新视频、图像生成模型

谷歌最新的视频和图像生成模型 Veo 3 和 Imagen 4 凭借其优异的新功能,打破了媒体生成的界限。此外,全新的 AI 电影制作工具 Flow 已经用上了 Google DeepMind 最先进的模型,让你能够更精细地控制角色、场景和风格,创作出具有电影质感的影片。

Veo 3:视频与音频的结合

Veo 3 是一个先进的视频生成模型,它不仅提高了 Veo 2 的质量,而且首次可以生成带有音频的视频。

Veo 3 今天在 Gemini 应用程序和 Flow 中为 Ultra 在美国的用户提供服务。它也适用于 Vertex AI 上的企业用户。

Veo 2 更新

Veo 2 添加了新功能,包括:

-

先进的参考视频功能,从而实现更佳的创意控制和一致性。

-

相机控制,可以帮助用户定义精确的相机运动,包括旋转,变焦,以实现完美的拍摄。

-

Utpainting,拓宽视频帧,并使其更容易适应任何屏幕尺寸。

-

对象添加和删除,让用户从视频中添加或删除对象。

Flow

Flow 是一款 AI 电影制作工具,专为创意人士打造,它整合了 Google DeepMind 最先进的模型:Veo、Imagen 和 Gemini,让用户能够无缝创作电影级的片段、场景和故事。

Imagen 4

Imagen 4 在精细细节方面拥有非凡的清晰度,例如复杂的织物、水滴和动物皮毛,并且在照片级写实和抽象风格方面均表现出色。Imagen 4 可以创建各种宽高比的图像,分辨率高达 2k,更适合打印或演示。它在拼写和排版方面也得到了显著提升,让你可以更轻松地创作自己的贺卡、海报甚至漫画。

很快,谷歌还将推出 Imagen 4 变体,比 Imagen 3 快 10 倍。

Google Beam + 语音翻译

几年前,谷歌推出了 Starline 项目,旨在重新定义视频通信。Starline 项目实现了远程对话,让人感觉如同身处同一房间,而无需佩戴专门的眼镜或头显。

今天,谷歌宣布 Starline 项目正在演变为一个全新的 3D 视频通信平台:Google Beam。

Google Beam 平台利用 AI 赋能新一代设备,帮助人们无论身在何处都能建立有意义的联系。

Google Beam 借助最先进的视频模型,通过一个由六个摄像头组成的阵列并结合 AI 技术,将标准的 2D 视频流转化为逼真的 3D 体验,让用户以更自然、更直观的方式进行连接。

此外,谷歌也正在探索使用 Google Beam 进行语音翻译。这项功能将于今日在 Google Meet 上线。

Google Meet 的语音翻译功能最初将支持英语和西班牙语,未来几周将支持更多语言。

有了这项功能,用户在保持语音、语调和表情的同时,还可以享受近乎实时的翻译对话。

搜索升级

搜索可以说是谷歌的立身之本,但近段时间来已经开始受到新生代的 AI 搜索应用的冲击,而谷歌也正积极地应对。

在今天的 I/O 开发者大会上,谷歌宣布其搜索中的 AI 概览(AI Overviews)功能进行了功能升级,现已覆盖 200 多个国家和地区,支持 40 多种语言,并新增了对阿拉伯语、汉语、马来语、乌尔都语等语言的支持。

简单来说,AI 概览功能可以改进用户的搜索体验,用新类型的问题快速查找信息并浏览网络上的相关网站。当谷歌的系统认为这些信息最有帮助时,它们就会显示在谷歌搜索中,并显示醒目的网页链接,方便用户轻松了解更多信息。而且谷歌表示这个功能的速度很快:「AI 概览功能提供业内最快的 AI 响应速度」。

谷歌也表示,AI 概览确实可以帮到用户:让用户的对搜索结果更加满意,搜索频率也更高。此外,从本周开始,谷歌将在美国的 AI Overviews 中引入其最智能的模型 Gemini 2.5 的一个定制版本,以便搜索能够解决更棘手的问题。

在谷歌 I/O 开发者大会上,谷歌还宣布今天起在美国正式推出 AI 模式(AI Mode)—— 无需注册 Labs。

AI 模式今年早些时候开始在 Google 实验室测试,可以说是谷歌功能最强大的 AI 搜索功能,拥有更先进的推理能力和多模态分析能力,并能够通过后续问题和有用的网络链接进行更深入的探索。在接下来的几周内,美国用户将在谷歌搜索和谷歌应用的搜索栏中看到一个新的 AI 模式标签页。

据介绍,AI 模式的底层采用了谷歌的查询扇出(query fan-out)技术,可将问题分解为子主题,并同时发出多个查询。这使得新谷歌搜索能够比传统的谷歌搜索更深入地挖掘网络内容,帮助用户发现更多网络资源,并找到与用户查询高度相关的内容。

当然,谷歌也有自己的深度搜索(Deep Search)了。谷歌宣布会通过深度搜索将深度研究功能引入 AI 模式。深度搜索使用相同的查询扇出技术,但更上一层楼。它可以发起数百次搜索,对不同的信息进行推理,并在几分钟内创建专家级的完整引用报告,从而节省用户数小时的研究时间。

谷歌还为搜索引入实时功能,可实时提供帮助。事实上,之前每月已有超过 15 亿用户使用 Google Lens 来搜索他们所看到的内容。现在,谷歌宣布将 Project Astra 的实时功能引入搜索,在多模态搜索方面迈出了新的一步。借助实时搜索功能,用户可以使用摄像头与搜索实时交流所看到的内容。

谷歌还将 Project Mariner 的智能体功能引入 AI 模式,可帮助用户节省购票等任务的时间。只需输入「在更下面的观众席找到两张本周六红人队比赛的平价门票」,AI 模式就会启动查询扇出,跨网站分析数百个潜在的门票选项,并提供实时价格和库存,并处理繁琐的表单填写工作。AI 模式将呈现符合确切条件的门票选项,让用户可以在任何喜欢的网站上完成购买。

此外,谷歌还为搜索的 AI 模式引入了个人上下文(personal context)与定制图表等能力。

全新的 AI 购物模式

谷歌推出了全新的 AI 购物体验,其将 Gemini 功能与 Shopping Graph 进行完美结合,Shopping Graph 目前拥有超过 500 亿条商品信息,涵盖全球零售商,每条信息都包含评论、价格、颜色选择和库存情况等详细信息。并且信息是准确的、及时的,因为每小时有超过 20 亿条此类商品信息在 Google 上更新。

用户还能进行虚拟试穿:只需上传一张照片,你就可以虚拟试穿数十亿种服装。

该功能由一个全新的时尚定制图像生成模型支持,该模型能够理解人体结构和服装的细微差别 —— 例如不同面料在不同人体上的折叠、拉伸和悬垂效果。

试穿实验已经正式启动。当你在谷歌上选购衬衫、裤子、裙子和连衣裙时,只需点击产品详情上的试穿图标即可。之后,你可以上传自己的全身照 —— 片刻之后,就能看到衣服穿在身上的效果。

结语

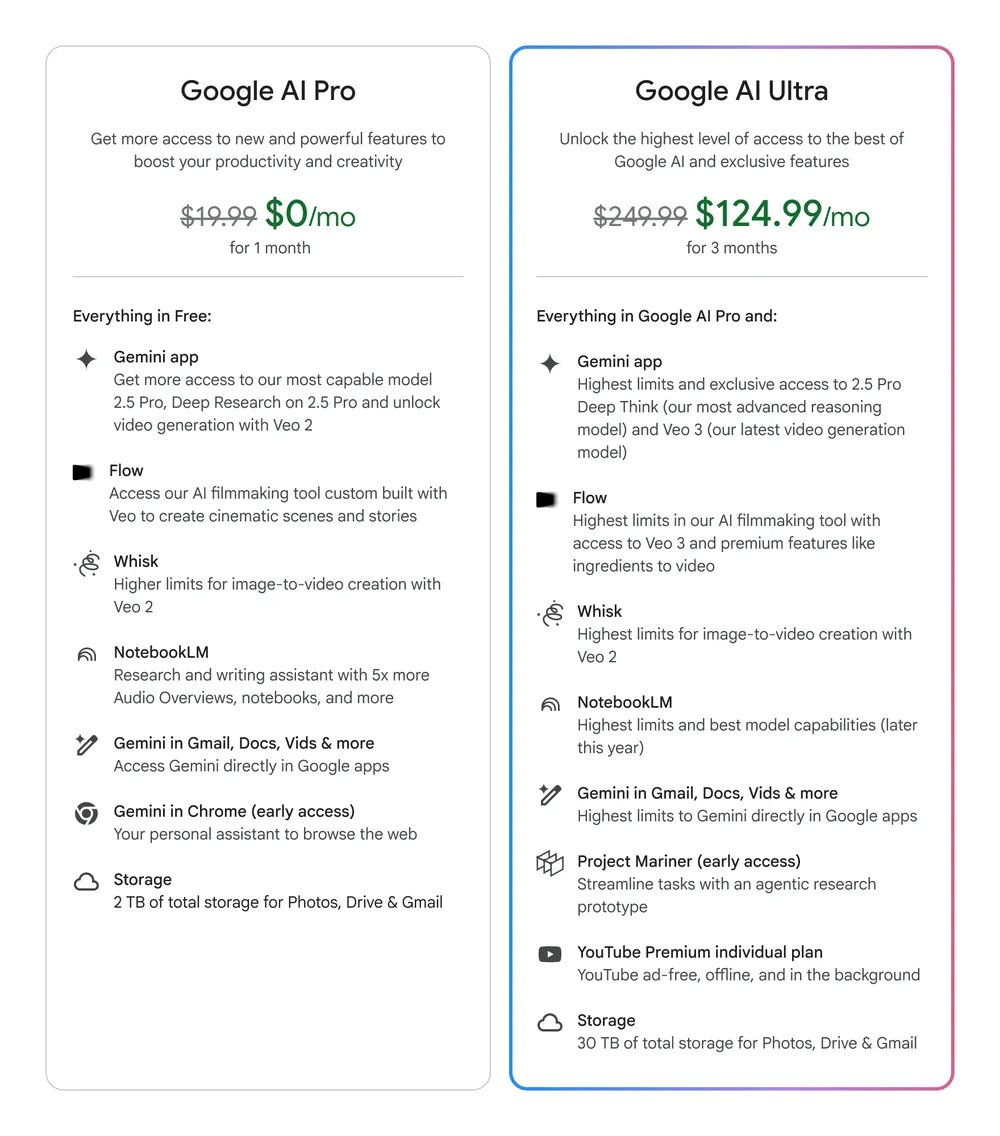

以上的盘点性介绍还并未穷尽谷歌今年的 I/O 大会上发布、升级或规划的一切,比如他们还推出了 Gemma 3n 的预览版本,这是一个可以在手机、笔记本电脑和平板电脑上流畅运行的开放式多模态模型,可以处理音频、文本、图像和视频。另外,谷歌在 AI 辅助科研、AI 内容鉴定(SynthID Detector)、NotebookLM、云计算、办公辅助、增强现实等多个领域都有新的动态。他们甚至还推出了新的订阅套餐:每月 249.99 美元的 Google AI Ultra!

前三个月有折扣

谷歌一直是 AI 研究的先驱,早在 Transformer 架构和 AlphaGo 时代就奠定了技术基础。然而,近年来在 AI 应用层面,谷歌略显保守,未能在用户体验上与竞争对手齐头并进。此次 2025 年 I/O 大会,谷歌通过一系列重磅发布,展现了其在 AI 应用领域的强势回归。

从 AI Mode 彻底重塑搜索体验,到 Project Astra 引领多模态交互,再到 Gemini 2.5 的深度推理能力和 Project Mariner 的智能智能体,谷歌不仅追赶上了 AI 应用的浪潮,更在多个关键领域实现了超越。这场大会不仅是技术的展示,更是谷歌向未来发出的宣言:在 AI 驱动的新时代,谷歌将继续引领潮流,塑造更加智能和互联的世界。

(文:机器之心)