新智元报道

新智元报道

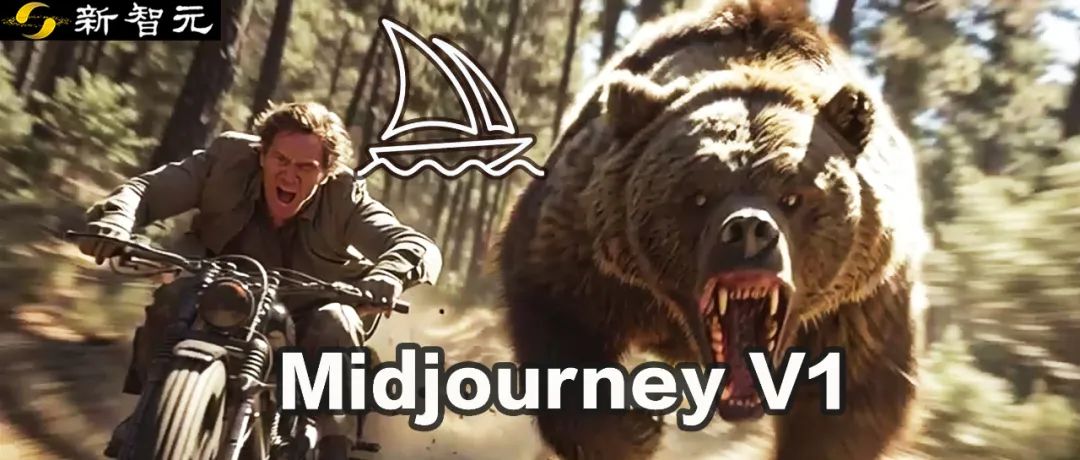

【新智元导读】AI视频生成,Midjourney终于落下大锤了!今天,V1视频生成模型正式上线,每一帧效果超逼真,网友上手实测惊掉下巴。

终于等来了!Midjourney首个AI视频模型,猝不及防震撼登场。

一大早,官方正式上线了V1视频模型,仅用三个词总结——有趣、易用、惊艳。

每个月仅需10美金,最长输出20秒,即可体验

Midjourney放出了2分多V1视频的畅享版,毫不夸张,每一帧都是视觉盛宴。

左右滑动查看

它的视觉效果,分分钟秒掉Runway Gen-4,足以媲美谷歌Veo 3、OpenAI Sora。

V1强大之处在于,它还可以生成图像,然后点击「动画」按钮,瞬间便可让画面动起来。

真的是,一键直出大片。

最关键的是,每秒视频的成本,约等于一张图像!

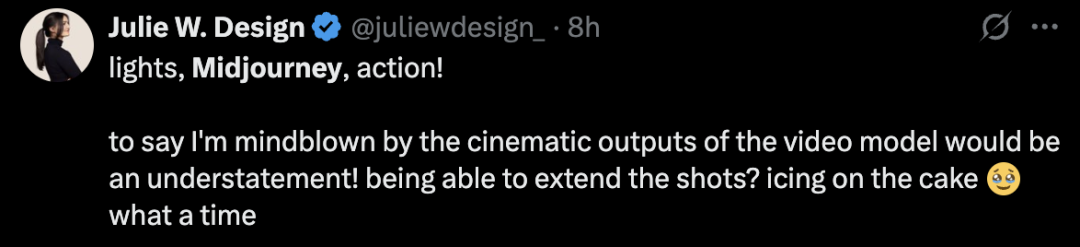

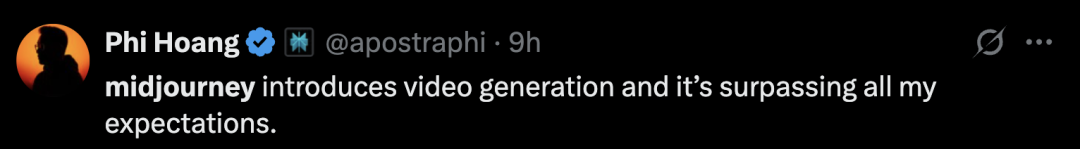

上手后的网友纷纷惊呆,好评如潮,「完全超出了我的预期」。

左右滑动查看

V1生成的视频,究竟是一种怎样的惊艳?

直接上图。

列车飞快驶过,一头卷发女孩的3D卡通人物特色非常鲜明。

再来看真人面部刻画,效果非常逼真,可以称得上是电影级输出了。

左右滑动查看

萌宠怼镜头的视角,丑萌丑萌的。

雕塑+赛博朋克元素相撞,给人一种视觉冲击感。

还有打破想象的各种艺术风格效果。

左右滑动查看

日漫风视频,再加上配乐,演唱会现场的氛围就来了。

恐龙和人类大战,画面质感堪比好莱坞大片。

再来看V1的流体测试,可能还未通过「物理测试」,倒入红酒感觉是对的,但总到不满就有些诡异了。

海平面上一个大火球,被海浪推起,但画面存在定格问题,不是特别流畅。

沃顿商学院CS教授Ethan Mollick点评,V1与图像生成一脉相承,这样的优势在于:

它能创造出其他视频工具难以实现的独特风格,摆脱传统视频拼贴的套路感。

左右滑动查看

更多V1生成的视频demo如下。

左右滑动查看

过去几年,Midjourney当红出道,一夜成为AI生成图像领域炸鸡子。

然而,今时不同往日,AI视频模型备受热捧。

火遍全网的谷歌Veo 3热度不减,甚至油管博主凭切一切的解压视频,狂揽百万粉丝。

视频模型V1正式上线(目前是一个过渡版本),标志着Midjourney终于迈出了关键的一步。

这款视频工作流,被称为「图像到视频」。

这意味着,你可以像往常一样生成图像,然后点击「动画」按钮让它们动起来。

V1提供了两种模式:「自动动画」和「手动动画」。

前者系统会生成运动提示,一键让画面动起来,简单又有趣;后者是通过文字描述,精准控制物体如何移动、场景如何展开。

此外,它还有「高运动」和「低运动」两种设置:

低运动:更适合环境场景,摄像头基本保持静止,主体以缓慢或刻意的方式移动。缺点是,有时可能会得到完全不动的效果!

高运动:最适合希望一切都动的场景,包括主体和摄像头。缺点是,所有这些运动有时会导致奇怪的错误。

喜欢某个视频?也没问题。

V1可以将其延长「扩展」,每次大约增加4秒,最多四次,能打造出更完整的动态故事。

更酷的是,还可以上传外部图像,作为「起始帧」,通过运动提示让其动起来。

一位网友为一个视频片段,扩展3次,整体氛围、色彩、一致性表现非常出彩。

目前,V1仅限网页版。

至于收费,每个视频价格大约是图像的8倍,一次可生成四个5秒视频。

简言之,每秒视频大约是「一张图像的成本」。令人惊讶,比市场之前推出的便宜25倍以上。

在不过上千字的介绍中,Midjourney还分享了一个技术愿景——

实时开放世界模拟,是一个必然的方向。

想象一下,一个AI系统不仅能实时生成动态画面,人类能命令其在3D世界中移动,环境和角色也会随之移动,还可以与一切进行互动。

这不就是,矩阵中的世界么?

Midjourney希望的是,能够将虚拟世界带入现实。正因此,他们决定先放出V1,进而推动下一步计划。

如前所述,为了实现这个最终目标,他们需要一步步构建基础模块。

· 视觉效果:首个图像模型,为画面奠定了基础。

· 动态影像:首个视频模型V1,让图像「活」起来

· 空间移动:3D模型,能在空间中自由探索

· 实时响应:实时模型,确保这一切快到起飞

未来一年,Midjourney将会逐一完善这些模块,最终整合成一个统一的系统。

可以期待的是,这样的世界离我们不会太遥远。

(文:新智元)