-

• 用户需求明确: 员工并非抵触AI,而是渴望利用AI自动化重复、低价值的任务。46.1% 的任务获得了积极的自动化意愿,首要动机是解放时间从事更高价值的工作。 -

• 市场供需错配: 当前AI领域的投资和研发方向存在显著偏差。研究发现,高达41%的YC投资项目映射到了用户需求较低的领域,而自动化意愿最强的职业,其在主流AI工具中的使用率仅占 1.26%。 -

• 协作是核心范式: 未来的主流并非“替代”,而是“人机增强”。超过45%的职业期望与AI建立“平等伙伴关系” (H3)。然而,在 47.5% 的任务中,员工期望的控制权高于专家认为的技术必要性,预示着潜在的采纳摩擦。 -

• 核心技能价值重估: AI正在重塑技能的经济价值。传统的信息处理与分析技能价值下降,而以“人际沟通”和“组织规划”为代表的非标技能,正成为新的核心竞争力。

AI Agent,从技术前沿到工作现实

2025年,AI的发展已越过单纯模型能力的奇点,进入了复合型AI系统(AI Agent)的落地应用浪潮。这些系统不再是简单的对话窗口,而是被赋予了明确目标、能够调用工具、并自主执行多步骤复杂任务的“数字实体”。它们通过Orchestrator-Worker(协调器-工作器)等新兴架构,整合邮件、日历、数据库和各类软件,正在从理论走向实践。据预测,近80%的美国劳动力至少有10%的任务会受到AI影响,AI Agent的渗透已是不可逆转的趋势。

当AI Agent的能力边界以前所未有的速度扩张时,一个根本性的问题摆在了所有产品经理和工程师面前:我们应该构建什么样的AI产品?真正的用户需求在哪里?技术研发的下一个突破口又是什么?

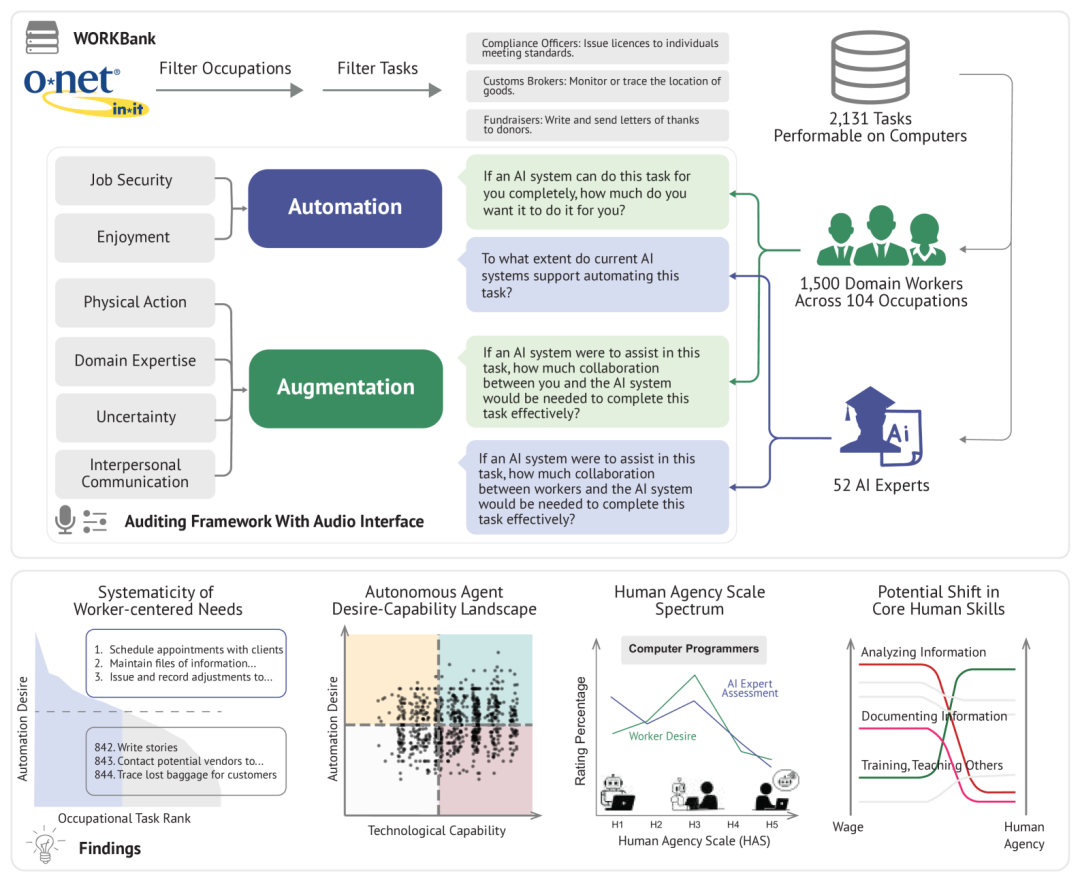

为了回答这些问题,斯坦福大学在2025年6月发布了一份里程碑式的研究报告。该研究首次大规模、系统性地审计了AI Agent在工作场景中的自动化与增强潜力。研究团队基于美国劳工部ONET职业数据库,通过创新的*音频增强访谈,收集了来自104个职业、1500名一线员工的真实偏好,并结合了52位顶尖AI专家的技术可行性评估,最终构建了一个名为 WORKBank 的庞大知识库。

这份报告为我们提供了一个全新的、数据驱动的视角,去审视AI Agent时代的真实机会与挑战。

一个数据驱动的决策框架:该框架通过双重视角——“员工需求”与“技术能力”,为AI产品的规划与研发提供了系统性的分析工具,帮助识别高价值机会点。

用户洞察:并非拒绝AI,而是拒绝“无效工作”

在探讨技术方案之前,理解终端用户的真实想法是第一步。这份研究最核心的贡献之一,便是澄清了一个普遍的误解:员工并不盲目排斥AI。

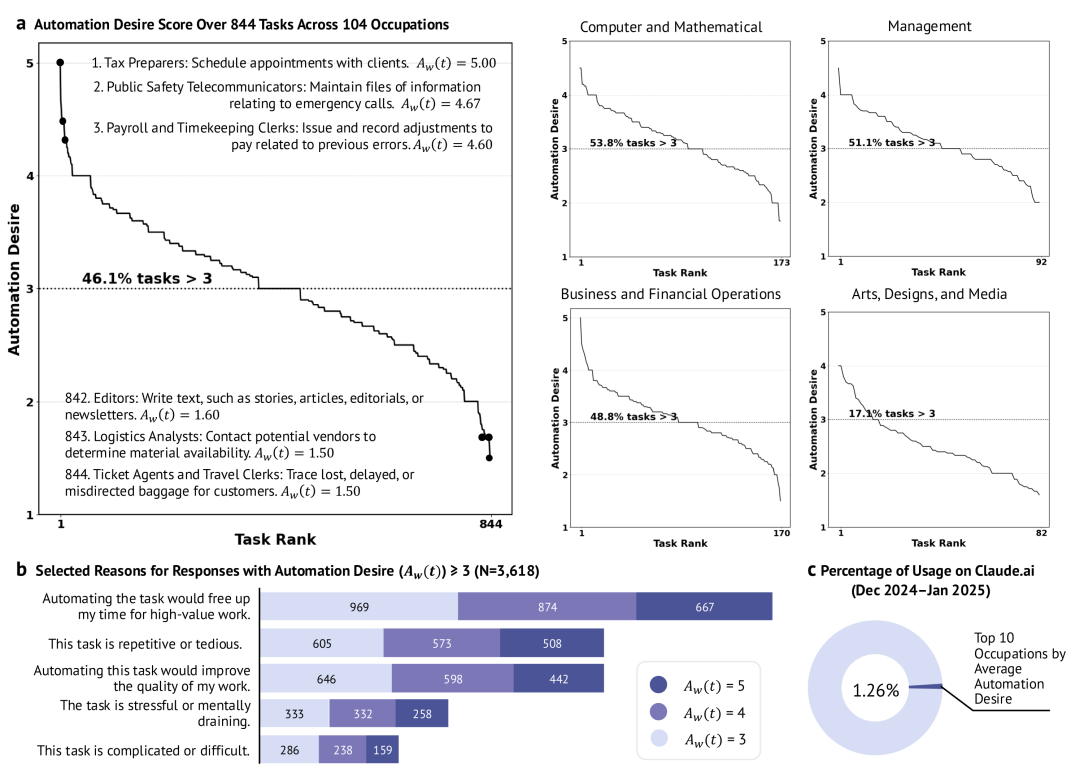

研究数据显示,在被评估的844项职业任务中,46.1%的任务,员工明确表达了积极的自动化意愿。这种意愿背后,并非是想“躺平”,而是一种对工作价值的重新聚焦。

-

• 首要动机是价值提升:在希望自动化的员工中,高达69.38%的人选择了“将我的时间解放出来,从事更高价值的工作”。这表明,用户渴望将认知资源从重复性劳动中剥离,投入到更需要创造力、战略思考和复杂决策的核心环节。 -

• 抵触源于心理与情感因素:员工的抵触情绪主要集中在那些他们享受其中、或能带来职业安全感的任务。音频分析揭示了三大主要担忧:对AI准确性和可靠性的不信任 (45.0%)、对工作被取代的恐惧 (23.0%),以及认为AI缺乏人情味和创造力 (16.3%)。 -

• 巨大的市场缺口:研究还发现一个惊人的事实,自动化意愿排名前10的职业(如税务助理、文书等),在当前主流AI工具(如Claude.ai)中的实际使用量占比仅为1.26%。这说明大量强烈的、未被满足的需求,尚未被现有产品覆盖,是明确的市场蓝海。

未被满足的巨大需求:(b)图揭示了员工渴望自动化繁琐任务以投身更高价值工作的强烈愿望。(c)图则用数据证明,这些高需求职业在现有AI工具中的使用率极低,暴露了巨大的市场空白。

市场机会:AI投资热潮中的“供需错配”

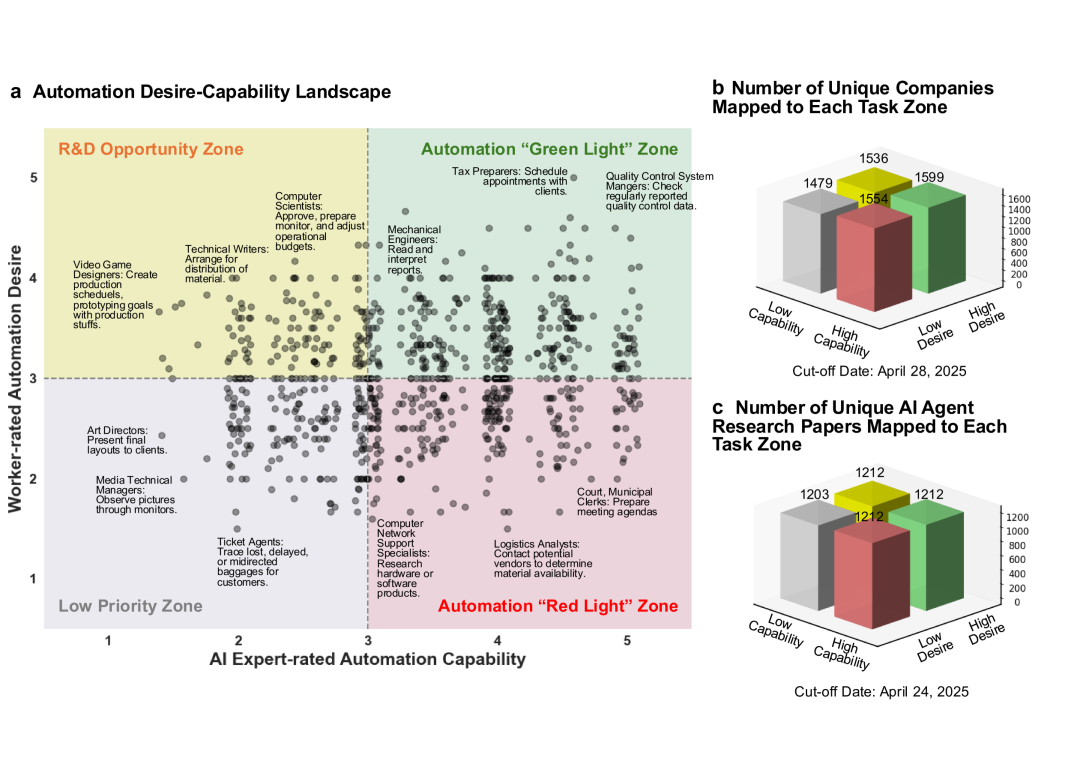

将用户意愿(需求端)与技术能力(供给端)交叉分析,研究团队构建了一个极具洞察力的“意愿-能力”四象限模型。这个模型不仅揭示了AI应用的黄金赛道,也暴露了当前市场中一个深刻的错配现象。

AI产品战略地图:(a)图清晰划分出四大战略区域。(b)图揭示了当前AI投资(以YC为例)与市场真实需求的错位,大量资本流向了低意愿区。(c)图显示AI研究方向(arXiv论文)相对更具前瞻性,集中于高需求、高难度的“机会区”。

这四个象限为产品战略规划提供了清晰的地图:

-

• 自动化“绿灯区” (高意愿, 高能力):这是产品-市场契合度(PMF)最高的区域,代表着可立即部署、能迅速创造价值的成熟机会。 -

• 研发“机会区” (高意愿, 低能力):这里是技术驱动型创新的前沿阵地,用户需求明确,但现有技术无法满足。这是AI工程师和研究者们最具挑战也最有价值的战场。 -

• 自动化“红灯区” (低意愿, 高能力):技术上可行,但用户抵触。这代表着潜在的产品陷阱,强行推广可能会因在社会或伦理层面不受欢迎而失败。 -

• “低优先级区” (低意愿, 低能力):应明确规避的领域。

研究中最出人意料的发现是,当将顶级孵化器Y Combinator的AI公司项目映射到该模型时,高达41%的映射落在了“红灯区”和“低优先级区”。

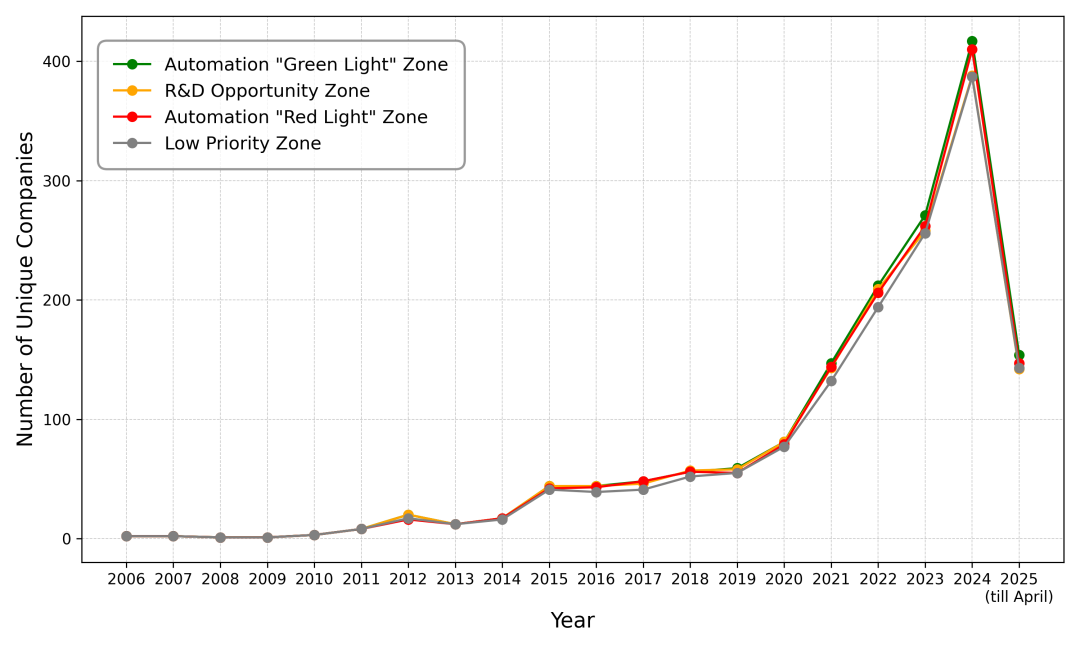

一个持续存在的错位

这并非短期现象。通过分析历年数据,研究发现这种投资错位是持续性的。

持续的投资错位: 此图显示了2006年至2025年,映射到四个区域的YC新增公司数量。尽管AI创业公司数量呈指数级增长,但各区域的增长趋势几乎平行,并未出现向“绿灯区”或“机会区”的战略性集中。

这个数据揭示了AI行业一个严峻的现实:大量的资本与智力资源,可能正投入到需求未经充分验证的领域。对于产品经理和创业者而言,识别并聚焦于“绿灯区”和“机会区”,是避免资源浪费、找到真正蓝海市场的关键。

系统设计:从“自动化”到“人机增强”的范式转移

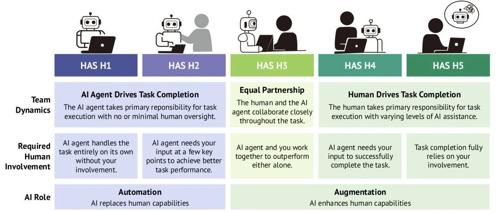

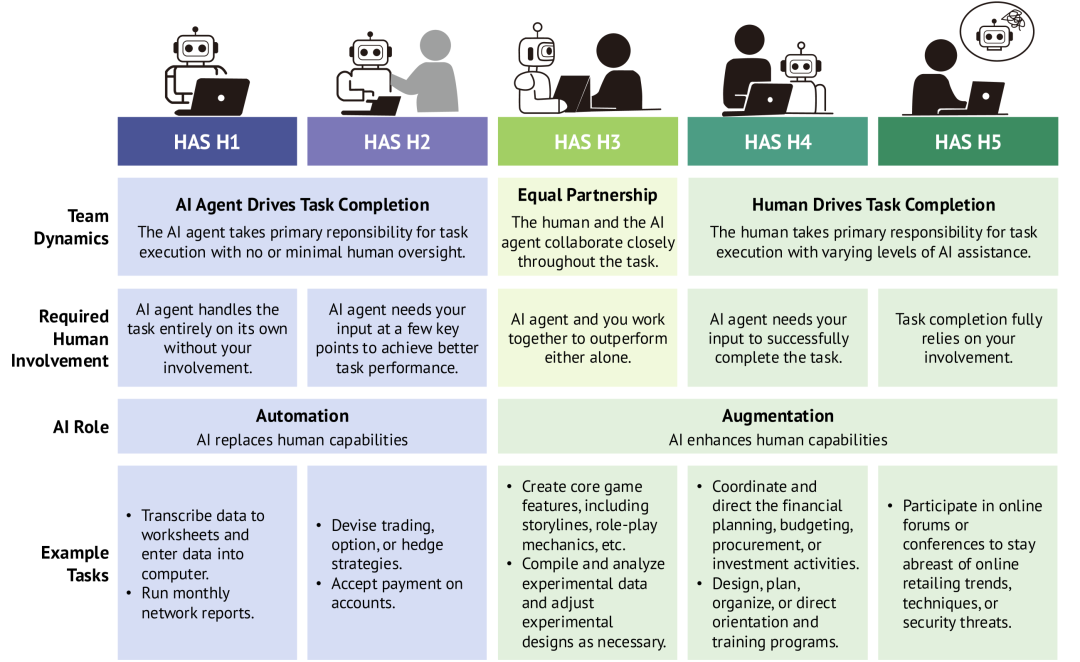

未来的AI Agent应该如何设计?研究提出了一个超越“自动化或不自动化”二元论的、更精细的设计标尺——人类能动性量表 (Human Agency Scale, HAS)。

HAS将人机关系定义为从H1(AI完全自主)到H5(人类参与至关重要)的五个等级。这个量表的核心价值在于,它为“人机增强(Augmentation)”这一复杂概念提供了可操作的定义。

人机协作的设计语言:HAS量表为评估和设计不同程度的人机交互提供了统一框架,H3的“平等伙伴关系”是其中的关键模式。

协作是主流,但摩擦已现

研究发现,H3——“平等的伙伴关系”,是知识工作者最普遍的期待。在被分析的104个职业中,有47个(占比45.2%)的员工,其最期望的人机关系模式是H3。

然而,研究也揭示了用户期望与技术现实之间的潜在摩擦:在所有任务中,仅有 26.9% 的任务上员工和专家的期望完全匹配。而在 47.5% 的任务中,员工期望的控制权(人类参与度)要高于AI专家认为技术上所必需的水平。这种期望的差异,在特定职业中尤为突出。

两极分化:从程序员到数学家

HAS量表清晰地勾勒出AI应用的两极:

-

• H1(高度自动化):AI专家认为“计算机程序员”和“校对员”的许多任务已接近H1水平,这些任务通常具有明确的规则和可验证的结果。 -

• H5(人类核心):员工和专家都认为,需要高度“人际沟通”和“领域专业知识”的任务是人类不可或缺的。在员工看来,“编辑”是典型的H5职业;而在专家眼中,“数学家”和“航空工程师”的部分工作属于此列。

“平等伙伴”是最大共识:(b)图清晰地展示了大量专业职业的期望HAS等级都集中在H3,证明了对“协作”而非“完全自动化”的广泛偏好。

未来趋势:技能价值的重构与核心竞争力的转移

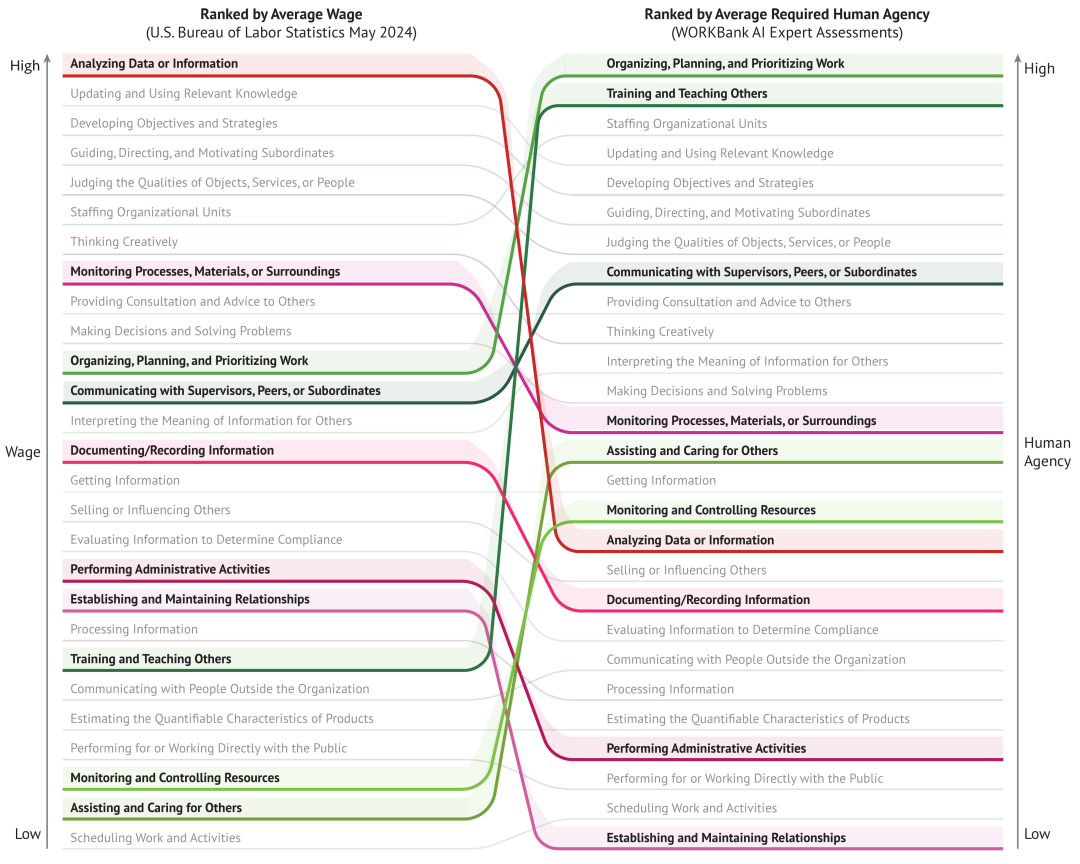

AI Agent的普及,最终将引向一个更深层次的变革:对人类技能经济价值的彻底重构。

通过将O*NET数据库中的任务与技能进行映射,并结合薪酬数据与HAS评级,研究描绘了一幅清晰的技能价值变迁图景。

一张揭示未来竞争力的地图:左侧按当前工资排名,右侧按AI时代所需人类参与度(未来价值)排名。绿色线条代表价值飙升的技能,红色线条则代表价值缩水的技能。

-

• 价值下降的技能:可标准化的信息处理。

传统上高薪的技能,如“分析数据或信息”和“更新并使用相关知识”,在未来“需要人类参与度”的榜单上排名大幅下滑。因为这些任务的本质是处理结构化或半结构化的信息,正是当前AI Agent最擅长的领域。 -

• 价值上升的技能:非标准化的综合能力。

价值急剧飙升的,几乎都是那些难以被量化和自动化的“软”技能。例如: -

• “组织、规划和优化工作” -

• “指导、领导和激励下属” -

• “建立和维护人际关系” -

• 对人才需求的新趋势:高人类能动性任务不仅需要人际交往能力,还需要决策、判断和创造力。这预示着未来的人才需求将倾向于具备更广泛技能组合的通才,而非单一技能的专家。

深度数据与补充发现

本节提供报告中更详细的数据图表,供深度分析参考。

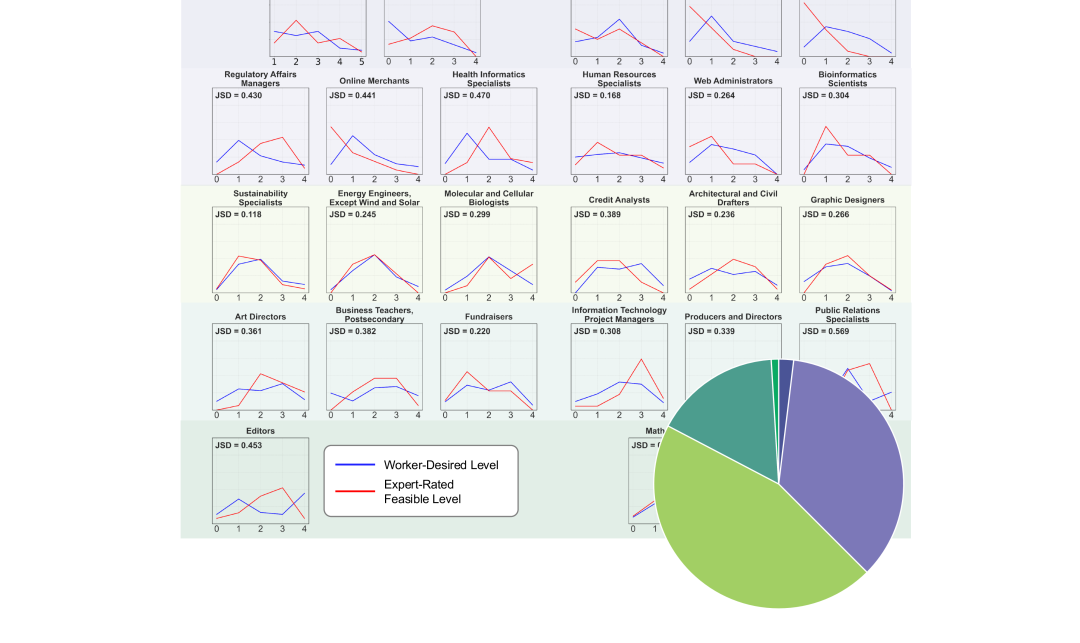

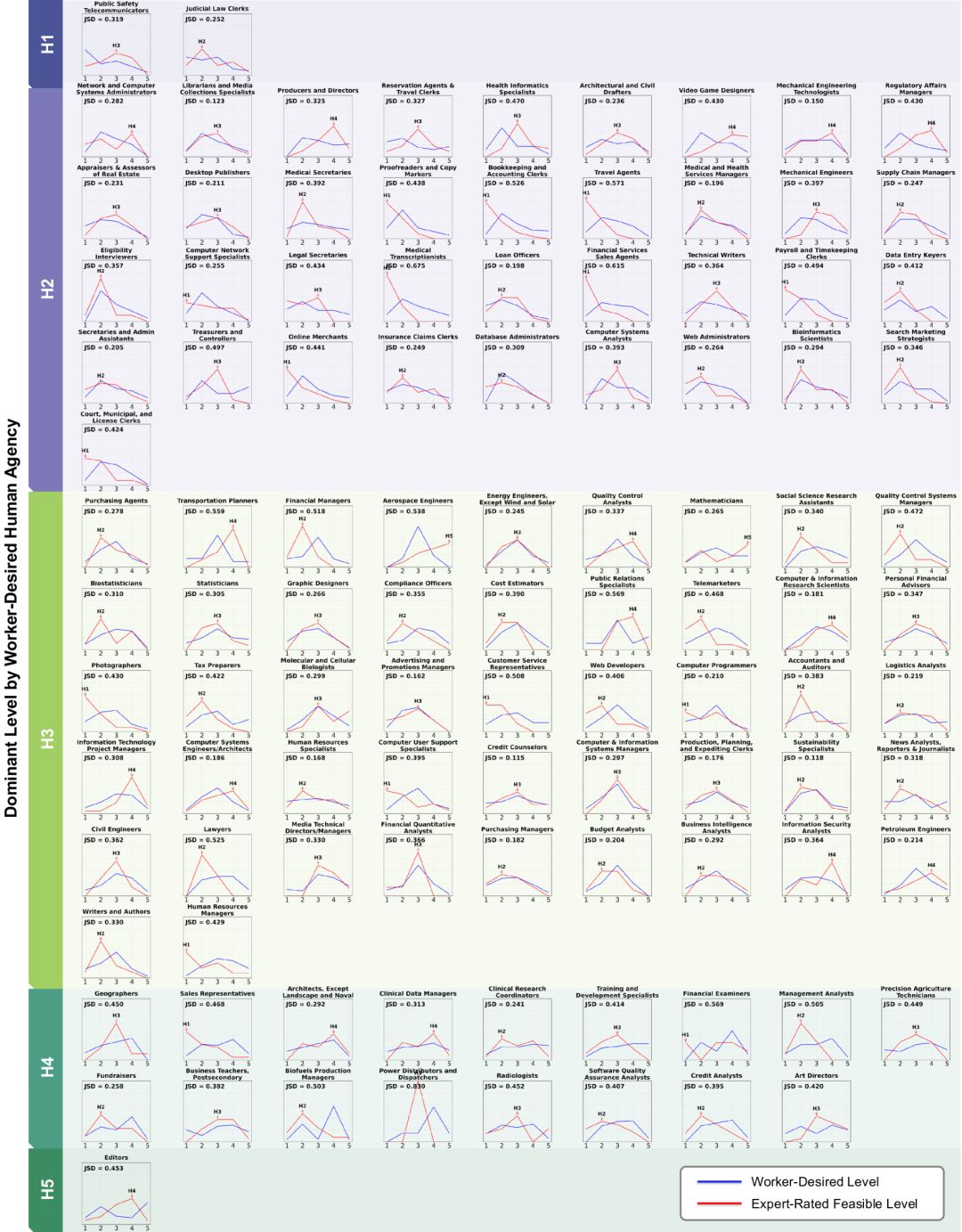

一、全景视图:104个职业的完整HAS等级分布

下图是本研究最重要的成果之一,它直观地展示了104个职业中,员工的期望(蓝色)与AI专家的评估(橙色)在人机协作模式上的分布情况。JSD (Jensen-Shannon Divergence) 分数越高,代表该职业中员工与专家之间的看法差异越大,是潜在的采纳“摩擦区”。

从这张全景图可以观察到几个关键模式:

-

1. 倒U型分布是主流:许多职业,如“可持续发展专家”和“能源工程师”,都呈现出中间高(H3)、两边低的倒U型曲线,再次印证了“平等伙伴关系”是最大公约数。 -

2. 期望差异显著:如“电力调度员”和“律师”等职业,专家认为技术上可以实现高度自动化(橙色条集中在H1/H2),但员工强烈希望保留高控制权(蓝色条集中在H3),JSD分数因此很高。 -

3. 两极分化明显:“计算机程序员”由专家评定为高度可自动化(H1主导),而“编辑”、“数学家”等则被双方或单方认为是需要人类深度参与的(H5主导)。

二、员工的声音:哪些任务最该/最不该被自动化?

Top 20 员工最渴望被自动化的任务

这张清单是用户痛点的直接体现,也是高价值自动化产品的机会所在。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Bottom 20 员工最不希望被自动化的任务

这张清单同样重要,它揭示了员工的“护城河”,是产品设计需要避开或谨慎处理的“红灯区”。这些任务通常涉及高风险决策、创造性工作和核心人际互动。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

注:“ Bottom 20 Tasks”内容的节选示意。

三、深度洞察:员工与专家的期望差异

Top 10 员工-专家期望差异最大的职业

这份清单指出了AI部署中最可能遇到阻力的领域,是产品推广和用户教育需要重点关注的“摩擦区”。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

四、技能映射全解:O*NET任务到技能的转换

该研究的核心洞察之一来自于将具体的O*NET任务映射到更广泛的技能类别(Generalized Work Activities, GWA)。这种方法使得分析“哪些基础能力在AI时代更具价值”成为可能。以下是报告中分析的27项核心非物理技能,按AI时代所需人类能动性从高到低排序:

-

1. 组织、规划和优化工作 (Organizing, Planning, and Prioritizing Work) -

2. 培训和教导他人 (Training and Teaching Others) -

3. 为组织单位配备人员 (Staffing Organizational Units) -

4. 更新和使用相关知识 (Updating and Using Relevant Knowledge) -

5. 制定目标和战略 (Developing Objectives and Strategies) -

6. 建立和维护人际关系 (Establishing and Maintaining Interpersonal Relationships)

驾驭AI,而非被其定义

斯坦福的这份深度报告,为我们拨开了围绕AI的重重迷雾,指明了未来工作的清晰方向。它是一份截至2025年初的珍贵快照,尽管技术仍在飞速发展,但其揭示的底层供需法则和人性需求具有长期指导意义。

-

• 对于产品开发,成功的关键在于以用户为中心,从“红灯区”转向“绿灯区”和“机会区”,解决真实而迫切的工作痛点。 -

• 对于系统设计,核心范式正从追求完全自动化,转向构建灵活、可控的人机增强系统,让技术真正成为人类能力的延伸。 -

• 对于个人发展,未来的“护城河”不再是单一的知识深度,而是驾驭复杂性、与人协作、并利用AI放大自身独特价值的综合能力。

AI Agent的浪潮已至,它带来的不是一个终结性的答案,而是一个全新的开始。我们的位置,将不被AI决定,而被我们与AI的关系所定义。

(文:子非AI)