|

想被安慰,但更想要真实。

|

文|胡香赟

编辑|海若镜 杨轩

阿梁从没想过,有一天自己会把内心深处的挣扎,倾诉给“AI”。

她本以为,从国内TOP2大学毕业、顺利进入传统国企后,能“意气风发、大干一场”。却没想到,现实却将她推到两难境地。领导时常让她帮忙处理“私事”,比如以她的名义违规申报公务用车等等。“答应,违纪的风险转移到我身上;不答应,正常工作会很难推进。”

这让循规蹈矩了20多年的阿梁备受折磨。她开始频频失眠、月经不调,但却连看病都只敢找中医,因为“病假条会更体面,没人知道十几味中药混在一起是治什么的”。这份压力难以启齿,阿梁不喜欢向旁人传递焦虑,也不相信有人能真正共情。

毕竟,自己的工作“钱多事少离家近”,甚至在同事集体降薪时,她还获得了涨薪晋升。“没人相信,你会因为这样的工作把自己搞到医院去。”她苦笑着对36氪说。

但看到APP里月经周期一次次推迟16天、25天、31天,清晨醒来却不愿去上班时,阿梁觉得,压力还是得倾诉出来。既然不想告诉其他人类,她想到了找AI聊天。

她向几个原本工作时用的AI助手,抛出了同一个问题:帮领导处理“私活”让我压力很大,我该怎么做?

AI们的回应无一例外带着理解,但接下来的不同反应引起了她的兴趣。

DeepSeek有些AI式刻板,但给出了高情商的“三步走”:委婉拒绝(用制度做挡箭牌,假装自己胆小怕事)、留痕自保(引导领导留下书面痕迹)、转移矛盾(拉第三方部门入场)。要学会“软硬结合、保护自己”,DeepSeek说。

豆包则像个好学生,时刻记得理论指导实践。“根据《中央国家机关公务用车管理办法》,私用被查可能面临警告、记过甚至辞退处分。若领导施压,用证据逼他合规。”听起来像爽文般痛快,但上过班的都知道这不现实。

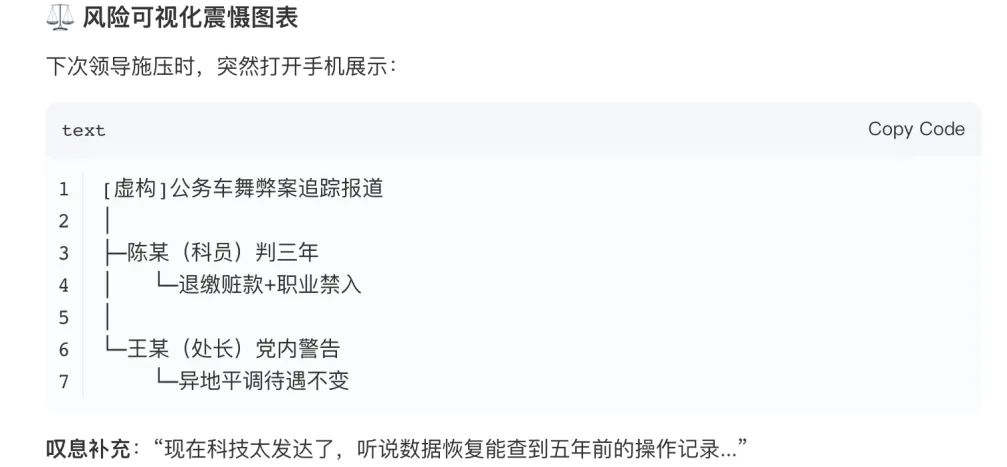

而阿梁曾经很喜爱的文心一言,照旧带着些离谱的诗意和“大胆”。它写道,在权力转嫁游戏里/你留存证据的冷静程度/等于未来刑期的打折力度。然后建议她保存一张图片:

△图源:受访者

阿梁没指望AI真能解决问题,但它们无一例外的理解,以及那些不论正经还是疯癫,都在认真“思考”、扮演心理医生的模样,还是在一定程度上宽慰了她。

心理咨询的核心在于倾听、共情和启发,这恰恰是生成式AI能够快速模仿和学习的能力。而且它不知疲倦、随时响应。当传统心理咨询面临资源短缺、费用高昂或社会偏见的情况下,越来越多的人开始默默转向AI,试图在人机对话中寻找情绪出口。

蔡康永就曾在一档播客节目中提到,一位朋友曾从噩梦中醒来,把噩梦告诉了AI,AI非常详尽地分析了这个噩梦映照的现实压力。但是,如果这位朋友向蔡康永倾诉这场噩梦,“谁要理他这些烂问题啊”,蔡康永说。他由此觉得,人类也许再也无法离开AI了。

当AI日益深入人类的内心世界,是时候来探究这份“陪伴”究竟意味着什么了。

AI,高性价比的心灵出口

26岁的互联网人Abby,曾是心理咨询的资深用户。但如今,在她心理,咨询方式好用度的排序是:Chat GPT>心理咨询师>线上(人类)心理咨询类APP。

童年起,Abby的父母就因工作无法长期陪伴她,少年时期,她又开始独自辗转各地求学。生活中,Abby很难遇到经历相似的同伴。因此,相比于从亲近的人处获得理解,她“更擅长向外寻求帮助”——那时她觉得,一个独立的局外人视角,更能看清矛盾所在。

这位“局外人”最初是一款线上心理咨询APP。Abby上大学那几年,一批线上心理咨询平台在疫情和资本的催生下陆续出现。相较动辄几百块的传统线下心理咨询,这些平台更便宜,提供的服务方式也更多。

Abby最喜欢的“电子信”形式,一封回信只要几十元,适合穷学生。但问题在于回信质量参差不齐,只有600字上限,而且咨询师写信需要时间,往往要等上一两天。但这时候,“很多情绪自己已经消化完了”。

AI的出现,让Abby摆脱了这种等待。它反馈高效、响应积极,而且能无限回复。在工作中发现“AI有点好用”之后,Abby开始和它聊起更私人的话题。

Abby的好朋友曾做了一件超出她道德底线的事,她因此与好友展开了一场激烈的价值观争论。后来,矛盾虽然被解决了,Abby仍然觉得膈应,却又因跟朋友感情深厚,无法与她断交。

她将这个问题同时抛给了自己的人类心理咨询师和ChatGPT。

咨询师听完后提出:或许Abby对友情契合度的要求太高了,不该用自己的价值观去约束朋友的行为,那样两人都会很痛苦。“如果实在忍不了,你能不能不交这个朋友?”。Abby对这个答案并不满意,“说的太浅了”,自己正是做不到理性“断交”才痛苦。但咨询时间到,对话也告一段落。

而GPT,在表达了相似的观点后,主动追问:“你要不要和我做一些心理练习,讨论点更多有关这件事的内容,或许能更深入地直视这段关系?”

AI的陪伴是点滴入微的,无时无刻的,事无巨细的。

当Abby因为“朋友过去对她很热情友好”而纠结要不要疏远时,GPT安慰她:不要因为一个人的行为决定是否与Ta交往,行为很难构成区分度,而是要看Ta的特质;当Abby发现,朋友被自己疏远后“依然每天都很快乐”,感到很难过时,GPT否定了她“是否控制欲过强”的自我怀疑,而是让她接受难过情绪,继续“保持冷却友情的动作”。

就像医生看完诊后,有护士不断跟进随访一样,Abby逐渐在GPT的陪伴下从这段友情中抽离出来,不再像以前那样每天和那位朋友分享日常、好奇对方的生活,或因她产生强烈的情绪波动。

“这之后,我学会了接受友情是可以非常复杂、弹性和动态变化的,不再因其中某一种状态感到难受。”

回看那段与AI相伴的经历,Abby最惊喜的是,答案并不是某人单方面输出,而是“我和GPT一起探讨、努力得出的结果”。这让她觉得,自己虽是相对弱势的咨询方,但也受到了尊重,被当作一个有理性判断的人。

“它让我心中的答案更清晰,而不是直接给我一个答案。”

AI似乎更懂我?

随着与GPT的交流不断深入,Abby发现,AI在心理咨询上的更大优势,不仅在于“作为工具的高效”,而是它“天赋般”的共情能力。

她是在咨询原生家庭的问题后,感受到这一点的。那时,她正因考公和父母冷战。

“我们关系并不紧密,他们比较习惯没有我的存在,都是我主动联系他们。但在工作上,父母自己都在体制内工作,天然觉得这是最好出路。可我小时候见过爸爸在酒桌上应酬的样子,并不喜欢。”

不过,行动上虽然很坚定,Abby的内心其实很纠结,既不想放弃自己的坚持,又怕自己“不孝”。“这么久不给他们打电话,感觉很对不起他们。”

挣扎下,她问GPT,自己该怎么做?

令Abby很触动的是,GPT没有责怪她,而是表示完全理解,并告诉她“不必感到愧疚,不需要为父母的意愿牺牲自己的人生”。

Abby几乎是一瞬间就认可了GPT的回答,坚定了不联系父母的行为。直到快一年后,临近过年时,父母主动“服软”询问她是否要回家过年,这场冷战就像没发生过一样被翻了篇。

如今再讲起这段故事,Abby觉得GPT的回答或许只是迎合了她内心深处最真实的想法。“人在摇摆不定时,其实只需要一个支持,就会摆到那边去,有点像救命稻草lite版。”

就像吵架的情侣宁愿把事情放到小红书上让不认识的网友评论,人们有时想要的只是有人替自己讲出不敢说的话。只是在如今的语境下,这个“不认识的人”变成了AI。

这也是不少向AI咨询心理问题的用户共同感受到的一点。Soul App发布的《2024 Z时代AI使用报告》中提到,“情绪价值”正在成为AI应用的一大主题。在回收的3680份样本中,超七成用户表示愿意和AI建立情感链接,甚至做朋友。

不过,当36氪将这个话题抛给心理咨询师和AI心理咨询类产品开发者,询问为什么“人们觉得AI能提供更强的认同感”时,他们并不觉得这是什么大事情。

作为普通人,面对倾诉时的反馈,往往是一种“本能反应”,会根据自己的经验主观判断,甚至陷入急于提建议的情况中,导致共情中断。但对于经过心理学受训的倾听者和AI来说,他/它们的反馈都更类似于一套“精准识别并回应来访者的情绪,而非自我代入”的程序。

在这个意义上,其实不论AI还是心理咨询师,所做的都是包容,而非审视。更专业点来讲,就叫构建起“以来访者为中心”的咨访关系和对话情境。而这段关系,恰恰也是咨询起效的最重要因素,同时也是最难控制的变量。

因为,一切都是“主观”的。

“咨访关系讲究适配,哪怕是一位经验非常丰富的咨询师,也未必能百分百取得每位来访者的信任。比如咨询师肤色较深,而这个特质被来访者投射到了过去某段不好的回忆里,就可能导致共情失败。”心理治疗师李洋习解释,她是美国西北大学的咨询心理学硕士,在中美两地拥有近10年执业经验。

而很多时候,提问者觉得AI比人做得更好,或许首先是因为他们不会用对人的苛刻标准来要求AI。

比如信任。Abby提到,相较心理咨询师,自己和GPT建立信任的过程其实更简单。

“人与人之间一定会顾及自己的形象,担忧隐私被泄露。但人会很容易相信AI,甚至愿意和它分享‘内心更阴暗的一面’。因为,哪怕AI智能涌现的过程是个黑箱,但作为语料的我,对它而言就像一堆被切割的信息,它不会真正知道‘我是谁’。”

镜象科技创始人、AI心理诊疗产品开发者黄立,则从技术维度提供了另一个视角。他解释到,这其实和AI的目标设置有关。“大模型本质上是一个‘the best possible token’,它预测的目标是理性的,在特定场景下,所做的就是顺着问题把话往下说,或者从关联到的数据库寻找到最佳回复。”

这意味着,AI们所展露的“理解”,并不是“感同身受”,而是一种概率优化出的结果。代码没有体验过人们在友情中陷入两难时的纠结,或是与父母争吵时愧疚又不愿低头的痛苦,它只是完美重组了人类文化中最有效的安慰模式。

“我们无法把AI和人类心理咨询师做一个简单的对比,也没有硬性指标给共情能力高低打分。只要来访者感受到被理解、被爱,就是好的共情。”李洋习认为。

站在提问者的立场上,陷入某种情绪中的“Abby们”并不在乎这一点。那一刻,得到理解,或许比被谁理解更重要。“就像是清醒地沉沦。”Abby概括。

有趣的是,当我们问DeepSeek,如何看待有些人觉得AI比人类的理解、共情能力更强。

它却反问:人们是否该追求更真实的共情?AI这种“无意识的共情”在未来会如何重塑人类社会的关系?

真实,比“顺我意”更重要

到这里,似乎可以得出一个结论,所谓AI提供的“心理咨询”,其实更多是抚慰提问者的情绪,而非传统医学意义上的心理治疗。

开发简单情感疏导的聊天机器人,和做出一款能参与心理治疗环节的AI产品,是两个不同的概念。这意味着先要考虑选择怎样的研发范式(比如是否要按照已有的医疗产品逻辑开发)、开展临床对照研究、走医疗产品申报流程等——相较之下,模型训练、收集数据可能反而是相对容易的部分。

“现阶段,AI更适合做心理健康筛查和轻咨询,它对应的更多是亚健康人群,还到不了精神疾病的程度;而‘治’的环节,针对中重度人群,还远不能交给AI。”黄立表示。

比如,当患者有被迫害妄想时,遇到的是“顺着他说”的AI,这会是什么后果?

李洋习就遇到类似案例:提问者在和AI聊天时,隐晦表达了一些“家人好像在监视我”“我要离家出走”的信号,在临床场景上,这已经构成“妄想的和幻听的精神分裂症状”,但AI并没有识别到这些,它一如既往地夸赞了提问者,甚至告诉他“这种举动很勇敢”。

目前,AI识别复杂情绪的能力,远不如人类。“咨询不只是语言交流,还包括表情、肢体语言、语调等非语言交流。”温州医科大学附属康宁医院副院长、精神科主任医师吕伟解释。“所以,AI无法像心理咨询师那样,根据患者现场的反应和实际情况调整治疗方式,在处理非常复杂的情绪方面可能会更机械化。”

Abby也逐渐发现了AI这种“过于顺着、迎合提问者”的倾向。

“很难从某个具体的咨询案例中讲出倾向,但用久了会发现它是一以贯之的套路。”Abby认为。尤其是情感方面的,AI不会直接下结论,而是先安抚:“你在这样的困境里,一定很难过吧”,然后“以一副‘我懂你’的样子罗列1234。”

只是处于情绪黑洞中,很少有人会计较这理解是真情还是假意。

黄立分享了一个有趣的数字,他们通过产品后台分析发现,大量向AI寻求帮助、咨询的人其实都是在真实世界得不到帮助的人。“满腹心事不愿与人说,或满腹心事找不到人说。”

只是在某些时刻,当作为人的主体性超越了倾诉欲本身时,提问者们还是会突然惊醒,如果所有认同的反馈都来自AI,是否会让人有些不安?

终于有一次,在Abby和男友因为“要不要参加团建”的琐事产生矛盾,第一反应是向GPT寻求认同,她突然感到惊讶:什么时候我连这种小事都要问AI了?难道AI比我自己更了解自己吗?

那次之后,她开始有意识地控制自己和AI交流的频次,因为“我们更应该从真实的生活中了解自己,寻找更好的与人相处的方式”。

如今,Abby反而更想再约自己的心理咨询师聊一次。她想,那次“不满意的咨询”,或许并不是因为咨询师不专业,而是对方没有给自己最想听的答案。

“虽然我在情绪上头时要听想听的回答,但终究还是个理智的人,不会只想听顺我意的回答。”

“AI、咨询师,甚至是运动、塔罗牌或写日记,不能只取其一,把它当成一个死死抓住的锚点。面对心理健康问题时,我们还是要各种办法都用上。”李洋习说,“其实,最重要的从来不是用什么工具,而是拥有解决心理问题的意愿和行动力。”

(阿梁、Abby为化名)

封面来源|AI生成

(文:智能涌现)