新智元报道

新智元报道

【新智元导读】你以为你在掌控AI,其实是AI在驯化你!最新研究警告:ChatGPT正改变英语的表达方式,悄然植入自己的偏好。是时候重新审视,我们到底在表达自我,还是AI的「复读机」?

AI驯服人类第一步:教人重新说英语?

最近,越来越多的媒体发现:说话的方式,越来越像ChatGPT了!

这不是模仿,而是「入侵」。

潜移默化之中,人类被AI「同化」:

AI不仅入侵了你的笔端,

还悄悄占领了你的大脑。

最终,从你口中倾泻而出!

最新的arxiv预印给出了惊人的结论:ChatGPT可能正在悄悄改变我们的用词习惯。

无论你觉得它方便,还是感到不安,ChatGPT都已悄然成为写作、搜索甚至日常对话的常驻嘉宾,一点点重塑我们的语言和思维方式。

此同时,网络上掀起了热议:

是否能通过「破折号」这类细节,一眼识破AI写的内容?

答案或许正在改变。

然而,这项新研究却给了出人意料的答案:「AI痕迹」正在变得越来越难以识别——因为人类的语言风格,正在越来越像ChatGPT。

研究人员发现,自ChatGPT推出以来,短短18个月,人们在日常交流中使用的所谓「GPT词汇」(GPT words)飙升。

这是来自德国马普人类发展研究所(Max Planck Institute for Human Development,MPIB)的最新的研究。

论文链接:https://arxiv.org/abs/2409.01754

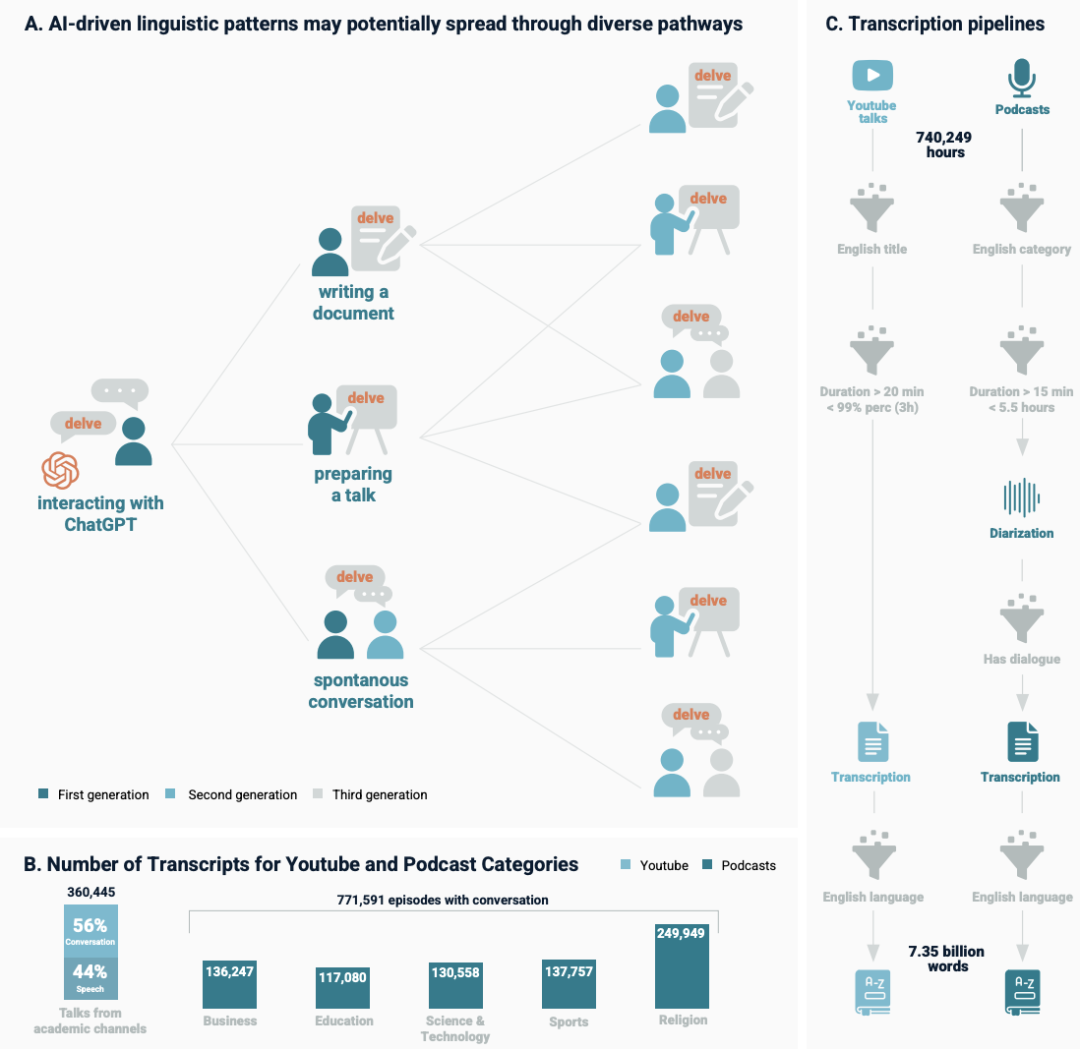

已有研究指出ChatGPT会影响人类的书面表达方式,但这一次,研究者想知道,AI的迅速普及是否也正在悄悄改变我们的「说话方式」。

为了这项研究,数百万页的电子邮件、文章、学术论文和新闻报道上传到ChatGPT,进行润色。

然后,研究人员分析AI更偏好的词汇,比如「delve」「realm」「meticulous」等。他们称这些为 GPT词汇。

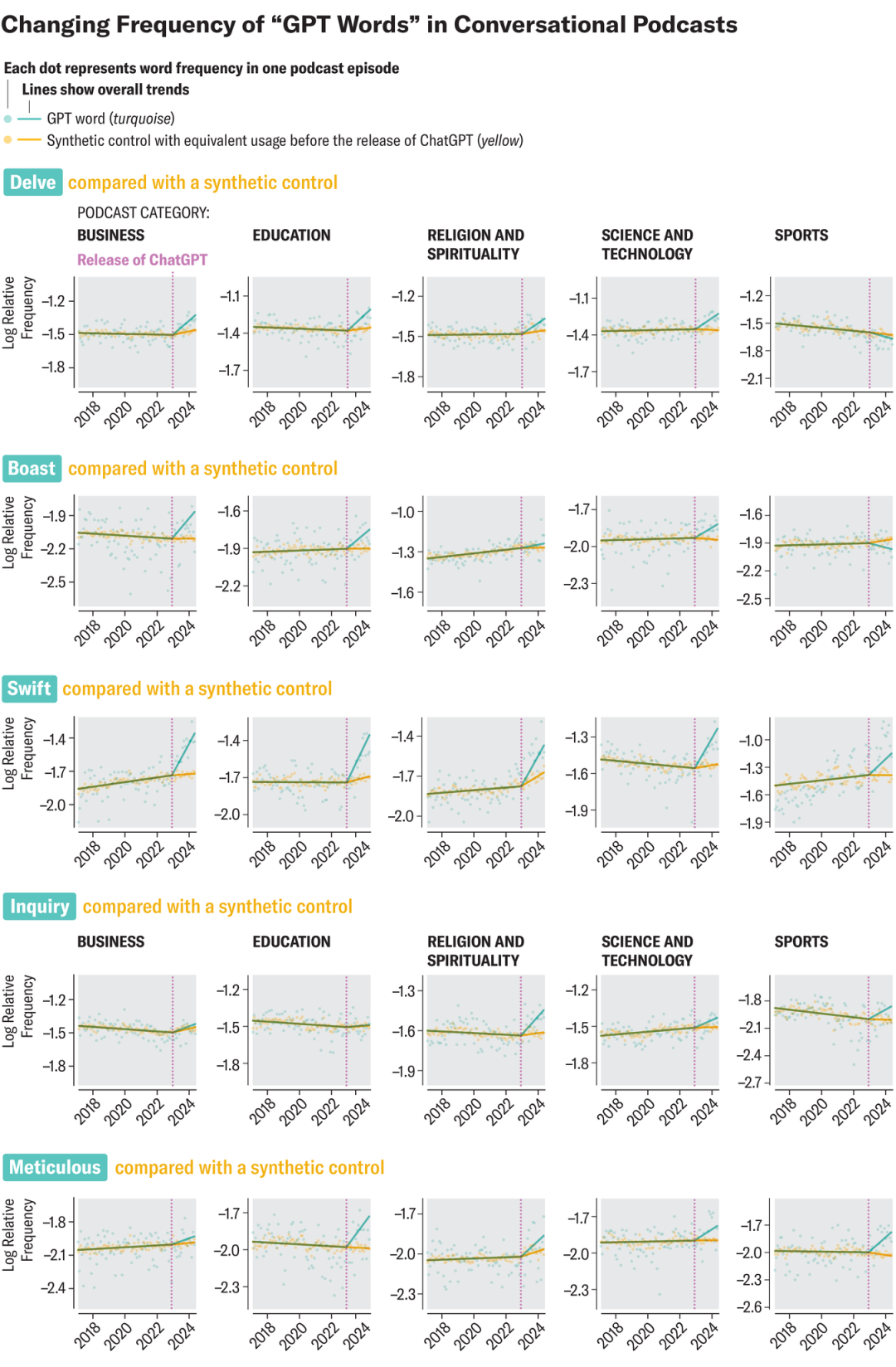

随后,在超过36万个YouTube视频、77万个播客片段中,他们追踪这些词汇的使用频率变化,发现了惊人的上升曲线!

图2:量化ChatGPT的词汇偏好及其对人类交流的影响

(A)学术YouTube报告中「delve」一词使用量的时间趋势图,显示ChatGPT发布后该词使用量显著增加(与合成对照组相比p=0.010)

(B)ChatGPT词汇偏好测量方法:通过对比人工撰写文本与ChatGPT修改版本的词频分布,计算得出的对数比值(即GPT分数)可量化特定词汇被ChatGPT偏好的程度

(C)由GPT分数测得的ChatGPT特征性词汇(GPT词汇集),不同版本ChatGPT对「delve」的强烈偏好具有一致性

(D)通过供体词汇的凸组合构建具有相似发布前模式的合成对照组,用于推断因果影响

这项最新的研究却告诉我们一个有趣的事实:这些「AI口音」可能越来越难以发现——因为人类的说话方式,正在逐渐变得像ChatGPT。

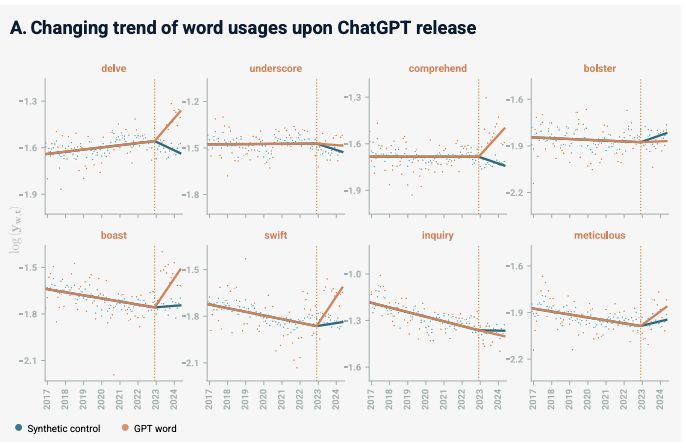

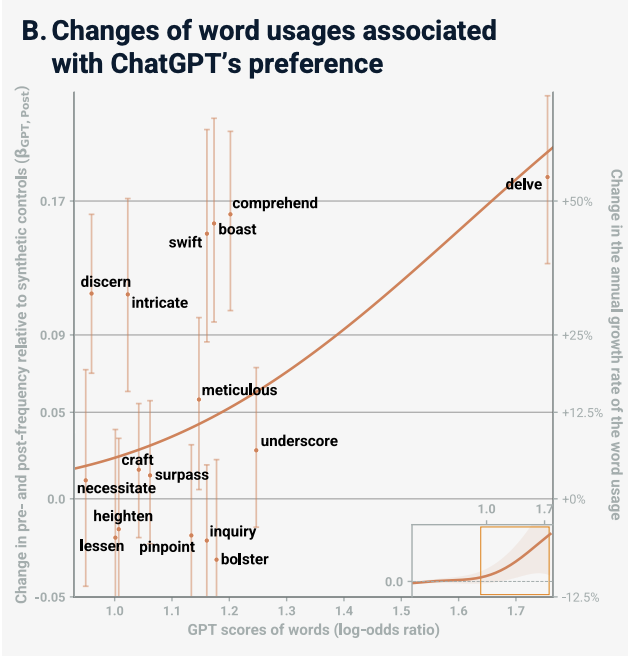

即便排除同义词和脚本化内容的影响,研究发现在英语口语中,GPT词汇确实的使用率显著攀升。

这项研究发人深省,但也有一些值得注意的限制。

首先,研究人员分析的数据来自特定的GPT模型:GPT-4、GPT-3.5-turbo、GPT-4-turbo和GPT-4o。这使得研究局限于这些特定版本的ChatGPT。

在未来几个月和几年中,OpenAI无疑会推出新的模型,而这些新版本可能会展现出新的语言使用形式和词汇偏好。

因此,这项研究可能很快过时。

此外,目前还不清楚ChatGPT是否确实对更随意的口语表达有影响,特别是考虑到研究人员从学术来源中获取了大量数据。

而且,语言和词汇的使用会随着时间因多种因素而不断演变;虽然ChatGPT可能在某种程度上对我们使用的词汇变化有所贡献,但重要的是要指出社会和文化中许多其他来源也促成了语言的变化。

共同作者Levin Brinkmann对媒体解释过:「AI技术存储的语言模式,正在反哺人类思维。人类天生会相互模仿,但主要针对那些知识渊博或德高望重的人。我们更倾向于复制他们的语言行为。」

Levin Brinkmann:马克斯·普朗克人类发展研究所研究员,专注于研究机器与人类社会日益深化的融合进程。他采用复杂系统理论、机器学习与实验社会科学方法,探究人机混合系统的演化规律。他获得计算社会科学博士学位,以及哥廷根大学物理学硕士学位

换言之,人与AI之间正在形成一种文化反馈循环:我们使用书面文本训练AI,AI将统计重构后的文本回传给我们,而我们捕捉到这些模式后,便开始无意识地模仿它们。

研究指出,越来越多人将AI视为文化权威,这使得「最初基于人类数据训练的机器,在形成自身文化特征后,可量化地重塑人类文化」。

Brinkmann强调:

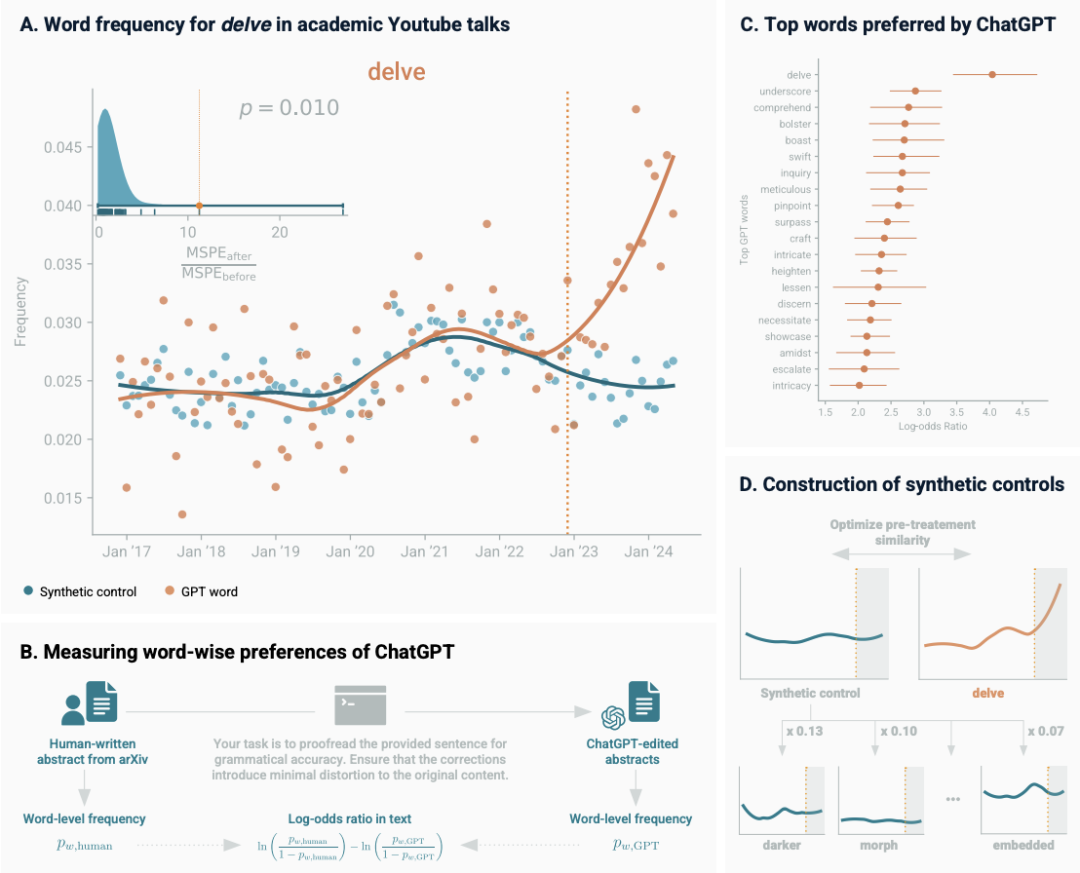

「delve」只是冰山一角,其他高频GPT词汇还包括:

「underscore」(强调)、「comprehend」(理解)、「bolster」(支持)、「boast」(拥有)、「swift」(迅速)、「inquiry」(调查)、「groundbreak」(开创性)……

图3(a):高频GPT词汇出现频次与合成对照组的线性回归分析。圆点表示月度聚合频次,趋势线标注以虚线标记的转折时点。如「comprehend」(理解)、「boast」(拥有)、「swift」(迅速)等词汇与「delve」类似,均呈现显著增长

图3(b):词汇的GPT分数(x轴)与其使用趋势变化幅度(y轴)的关联性。柱状图表示后验分布的95%高密度区间,插图中阴影区域为高斯过程回归的95%置信区间。聚焦前20个GPT词汇(插图最右侧),可观测到一组年增长率约25%-50%的词汇

尽管这项研究主要聚焦在词汇层面,但许多研究人员已经注意到,AI的影响正逐步渗透到语气当中——

比如说话变得更长、更有条理,同时情绪表达也被削弱。

康奈尔大学的研究发现,在聊天中使用智能回复会让人们更有合作意识,也能增进彼此的亲密感,因为使用者倾向于选择更正面、更有情感的语言。

然而,一旦人们察觉对方可能在用AI,反而会觉得对方不够诚恳,从而态度变得更强硬。关键并不是对方真的用了AI,而是那种「怀疑」的感觉。

论文链接:https://www.nature.com/articles/s41598-023-30938-9

正如该研究合著者、康奈尔大学信息科学副教授Malte Jung所说,我们是根据语言特征来判断他人,而真正影响我们印象的,是那些语言本身的性质。

Malte Jung的研究旨在探讨群体和团队中的人际互动动态,以及这些动态如何受到机器的影响

康奈尔理工学院信息科学教授Mor Naaman指出,这种「AI既改善沟通又引发猜疑」的矛盾现象,折射出更深层的信任危机。

Mor Naaman是康奈尔大学科技校区、雅各布斯技术与康奈尔研究所及康奈尔安·鲍尔斯计算与信息科学学院的教务长事务副院长,同时也是Don and Mibs Follett信息科学教授。他专注于技术、媒体等交叉领域的课题。他在斯坦福大学InfoLab获得了计算机科学博士学位。此外,他还曾效力于篮球队,作为职业篮球运动员参赛

他提出在AI沟通中,人性丧失的三重信号:

第1层信号:人性。那些笨拙、结巴的语气,才是「我真的在说话」。

第2层信号:用心。不是复制粘贴,而是花时间打下每一个字。

第3层信号:能力。真正的个性,是用真实语言展现幽默、情绪与深度。

你说的话里,藏着你是谁;一旦AI代言,我们也许就不再是「自己」。

Naaman认为,AI中介沟通的未来在于重建并强化这些信号,因为AI不仅改变语言,更重塑思维。

在约会软件上,当AI能替你展现幽默时,个人资料中的「幽默」还有何意义?

他最担忧的是从语言到思维的主体性丧失:「我们不再表达真实想法,而是表达AI帮我们组织的内容…我们会越来越被其说服。」

他警告,若失去这些信号,人类将只信任面对面交流——甚至不信任视频通话。

当AI悄然定义何为「得体」语言时,信任危机更趋复杂。

加州大学伯克利分校研究发现,AI偏好「标准英语」:

当用户尝试用新加坡英语、黑人英语等表达时, AI的反馈常常失真、夸张,甚至令人不适。

这不仅是语言问题,更关乎文化的尊重。

论文链接:https://arxiv.org/abs/2406.08726

一位说新加坡英语的网友评论道:「回复里夸张的新加坡式英语让人尴尬。」

研究表明AI不仅偏爱标准美式英语,还会通过压制其他方言来贬低使用者。

这种机制不仅固化对族群的错误认知,更扭曲了「正确」英语的标准。

因此这不仅关乎保护语言多样性,更关乎守护那些真正建立信任的不完美特质。

当周围人都开始说「正确」英语时,我们将失去那些结巴表达、地方俚语和非常规短语——这些正是脆弱性、真实性和人格的信号灯。

我们正处在分岔路口,矛盾重重:

学术界抵制「delve」等用词、人们刻意避免AI腔等反弹现象,显示人类可能自我调节对抗同质化;

AI系统本身或将更具表现力和个性化,从而缓解当前的「AI腔」问题;

而最深层的风险并非语言趋同,而是对人类思维与表达自主权的丧失。

AI正在入侵我们的潜意识。它正在暗中改写我们的语言基因,操纵着人类最本能的交流密码!这场悄无声息的精神殖民会将人类带向何方?

细思极恐的是,我们甚至还没意识到自己正在被改造。语言学家发出紧急警告:必须立即监控AI对人类社会全方位的文化渗透,否则后果不堪设想!

(文:新智元)