Meta

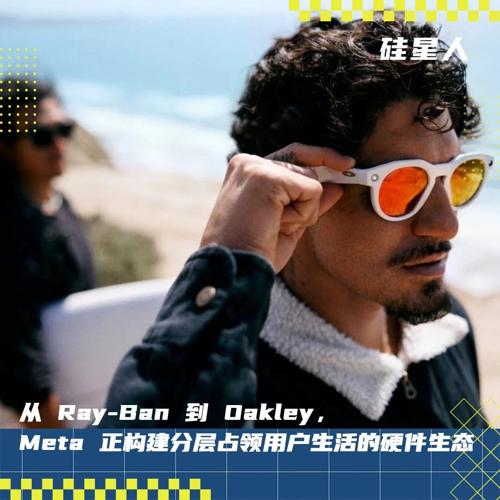

Meta 联手运动老炮 Oakley,AI 眼镜杀入专业赛道

Meta 与运动品牌Oakley合作推出AI智能眼镜Oakley Meta HSTN,具备长续航、防水防汗和高清摄像头等优势。它保留了Meta的核心能力:AI助手功能。该产品在专业运动领域得到认可,并有可能成为户外博主的全新装备。

扎克伯格盯上了OpenAI前首席科学家Ilya的公司!

Meta正招揽包括Safe Superintelligence CEO Daniel Gross和GitHub前CEO Nat Friedman等人工智能人才加入,争夺战愈发激烈。

开价10亿,小扎挖角Ilya左右手!前GitHub CEO或加盟Meta AI梦之队

Meta挖角GitHub前CEO Nat Friedman和SSI联创Daniel Gross,计划斥资10亿美元收购其AI风投基金。Friedman将领导Meta AI部门,Gross负责相关战略规划。

Meta智能眼镜军团扩编,Oakley和Prada加入战局

Meta计划与EssilorLuxottica推出Oakley和Prada品牌的AI智能眼镜。Oakley版本定价360美元,高于Ray-Ban同类产品。此合作标志着Meta首次将硬件推向顶级时尚品牌,与Prada的合作背景是其眼镜授权协议。

单GPU搞定高清长视频生成,效率×10!引入Mamba机制突破DiT瓶颈 普林斯顿&Meta

普林斯顿大学和Meta联合推出的新框架LinGen,以线性复杂度的MATE模块替代传统自注意力,使单张GPU在分钟级长度下生成高质量视频成为可能。