今天是2025年3月13日,星期四,北京,天气晴。

昨天,我们回顾了《Agent框架标准化趋势及OpenManus-RL增强Agent规划能力训练框架》,https://mp.weixin.qq.com/s/q04ClmvCcc73962WIKEwpA,今天来回顾下老刘说NLP20250312技术进展早报】,社区每日例行活动,昨日0312进展,围绕老刘说NLP社区第40讲分享,R1 GRPO用于语音情感识别全模态,数学多模态,chatbi开源框架,Gemma3开源,Unsloth Agent工具调用训练,多模态长文本总结进展等话题,供各位参考。

抓住根本问题,做根因,专题化,体系化,会有更多深度思考。大家一起加油。

一、老刘说NLP技术社区第40讲回顾

昨日,老刘说NLP技术社区–Ktransformers讲堂《KTransformers 开发团队详解异构推理,手把手教学部署》顺利结束,回放链接见社区群,这是社区自成立以来的第40次线上分享,历时涵盖知识图谱、大模型、文档智能、多模态、Agent、RAG、Deepseek等多个主题。

本次分享分3个section。

Section1进行KTransformers技术原理拆解,由KVCache.ai团队负责人、清华大学助理教授章明星老师讲解,GPU+CPU异构计算:异构设计思路来源、offload策略、CUDAGraph优化、底层高性能算子的实现,开源社区中的跑通案例、未来的开源计划。

Section2讲解KTransformers官方手把手教学,由趋境科技技术负责人陈祥麟老师讲解,内容包括环境准备与硬件配置、安装与部署步骤;

Section3包括Q&A环节,KTransformers开发团队在线答疑。

二、关于R1思路用于全/多模及长文本等7个最新技术进展

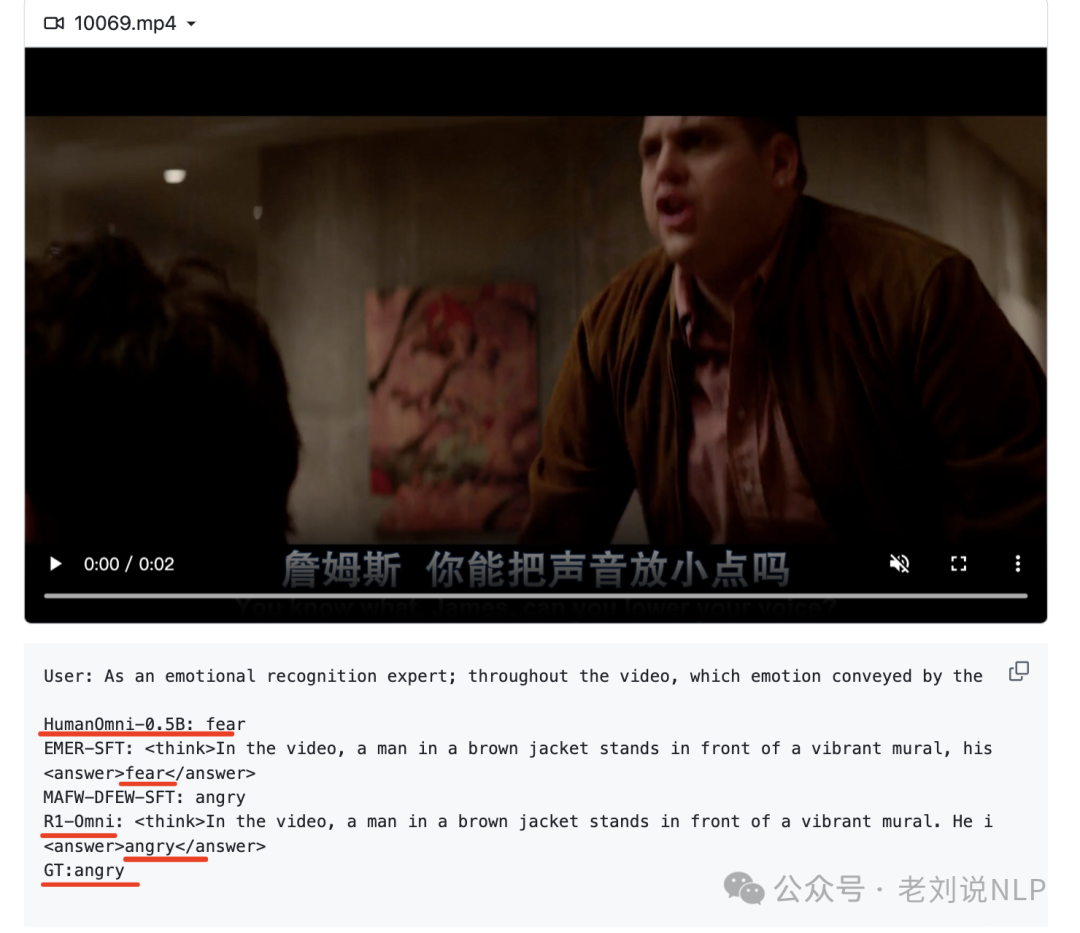

1、R1用于全模态进展R1-Omni

R1-V和Visual-RFT等研究展示了RLVR在几何推理和视觉计数等任务中的应用效果。然而,之前的工作主要集中在图像-文本模态上,尚未探索RLVR在视频多模态模型中的应用。

《R1-Omni: Explainable Omni-Multimodal Emotion Recognition with Reinforcement Learning》,https://arxiv.org/pdf/2503.05379,https://github.com/HumanMLLM/R1-Omni,https://www.modelscope.cn/models/iic/R1-Omni-0.5B,应用强化学习与可验证奖励(RLVR)来优化全模态模型,以提高其在情感识别任务中的推理能力、情感识别准确性和泛化能力。

R1-Omni模型通过在EMER数据集和手动标注的数据集上进行冷启动,初始化HumanOmni-0.5B模型,然后使用RLVR进行进一步优化,训练过程包括策略模型处理多模态输入数据(视频帧和音频流),生成候选响应,并使用可验证奖励函数进行评估。

其中涉及到RLVR和GRPO,可以顺便看下两者,RLVR使用了GRPO。

RLVR是一种训练范式,通过直接使用验证函数来评估输出,从而优化模型。其核心思想是通过一个可验证的奖励函数R(q,o)来评估模型的输出,该函数根据输出是否匹配真实值来分配二进制分数。优化目标为最大化期望奖励。

组相对策略优化(GRPO) 是一种强化学习方法,通过直接比较生成的响应组来评估候选策略的质量,而不需要额外的批评模型。其核心思想是通过计算响应的均值和标准差来标准化奖励,从而确定每个响应的相对质量,奖励函数分为准确性奖励Racc和格式奖励Rformat

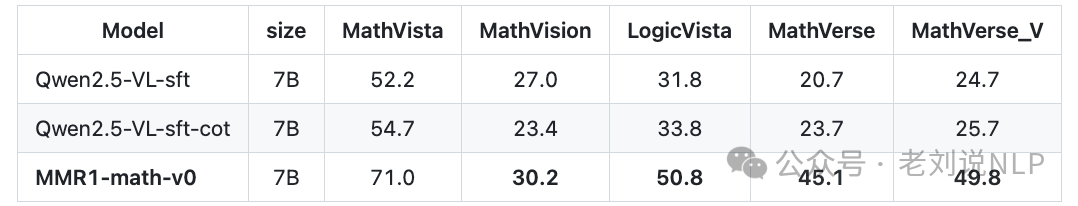

2、R1用于多模态进展MMR1-math-v0

基于EasyR1训练的MMR1-math-v0模型进行数学多模态推理,https://github.com/LengSicong/MMR1,模型权重在https://huggingface.co/MMR1/MMR1-Math-v0-7B,数据集在https://huggingface.co/datasets/MMR1/MMR1-Math-RL-Data-v0,

其中,使用纯GRPO-RL方案?(技术细节未公开,我们可以跟进后续报告),将模型与两个基于SFT的变体进行比较来进行消融实验。包括直接答案监督(Qwen2.5-VL-sft)和思维脸链监督(Qwen2.5-VL-sft-cot)在6k数据集上对Qwen2.5-VL-7B进行微调。

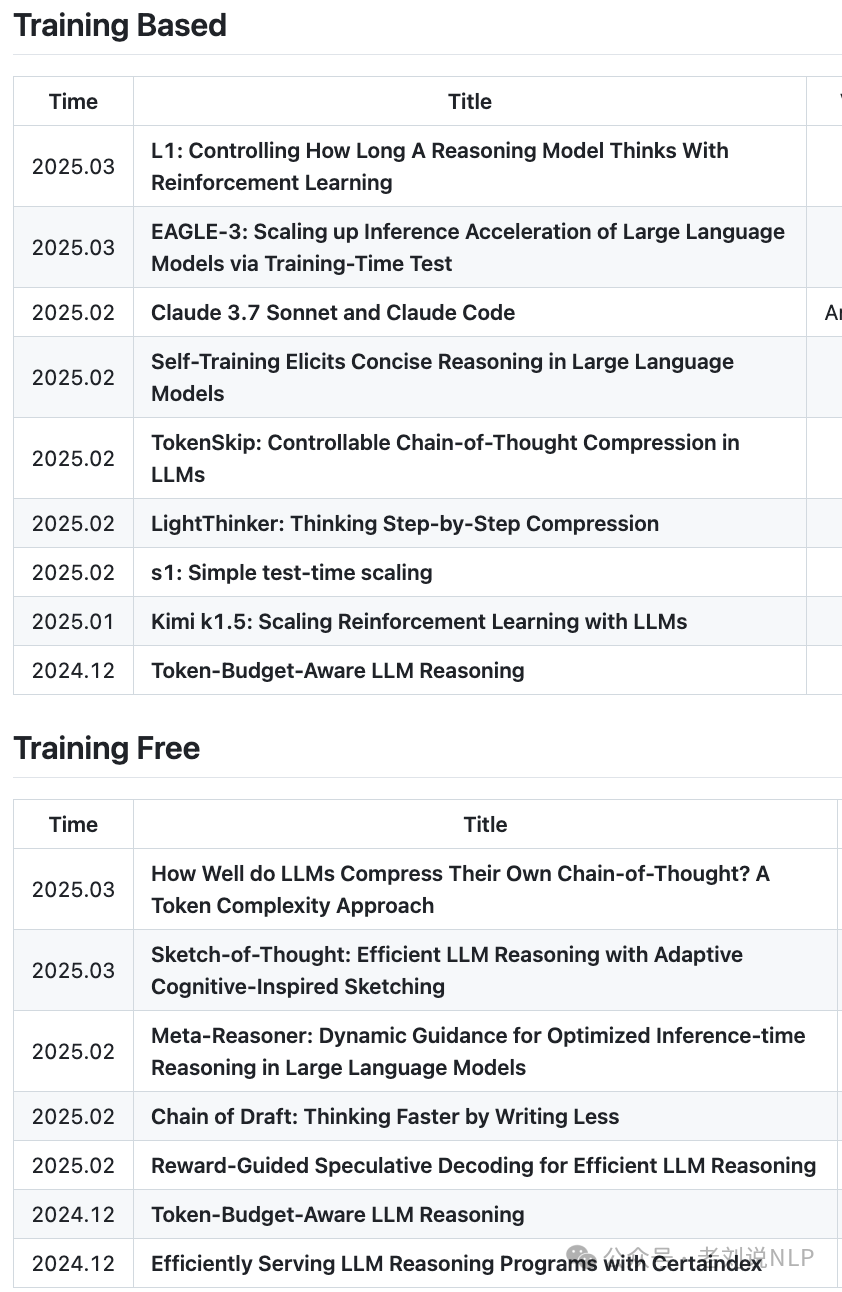

3、大模型推理长度问题技术方案

Awesome-Long2short-on-LRMs,大推理模型的long2short长文本压缩,加速模型推理效率,包括最近的L1,S1,prompt压缩等,地址在: https://github.com/Hongcheng-Gao/Awesome-Long2short-on-LRMs

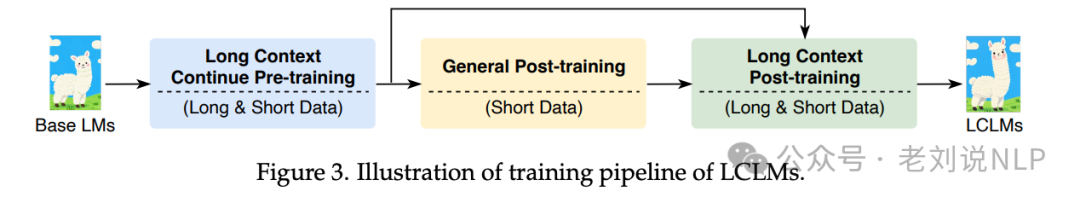

4、关于长文本进展技术总结

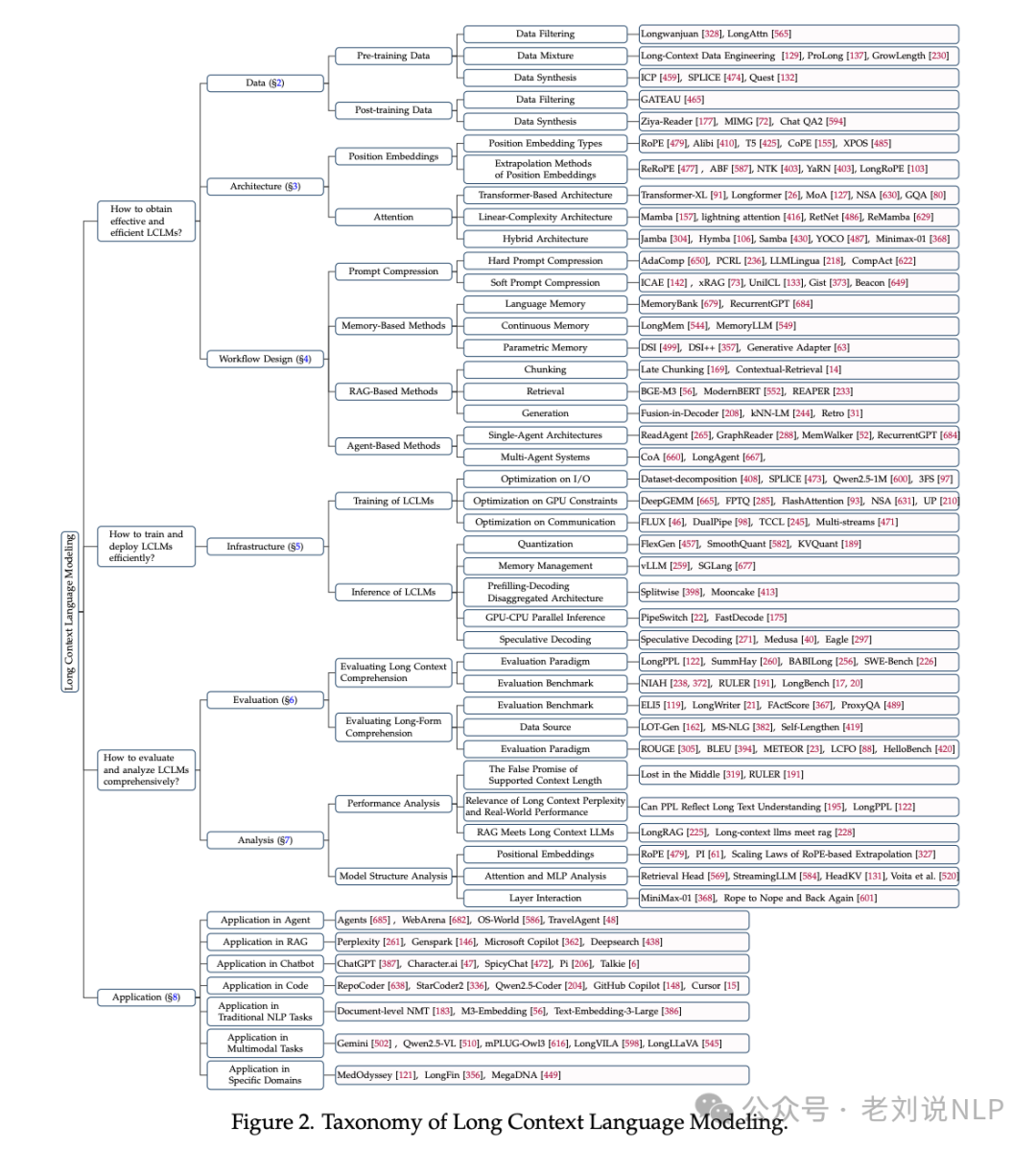

A-Comprehensive-Survey-For-Long-Context-Language-Modeling长上下文大建模总结,

地址在:https://github.com/LCLM-Horizon/A-Comprehensive-Survey-For-Long-Context-Language-Modeling,有对应的论文:https://github.com/LCLM-Horizon/A-Comprehensive-Survey-For-Long-Context-Language-Modeling/blob/main/assets/lclm-survey.pdf

其中有讲场景技术范式,做了较为详细的论述,这个可以借鉴。

5、开源进展Google开源模型

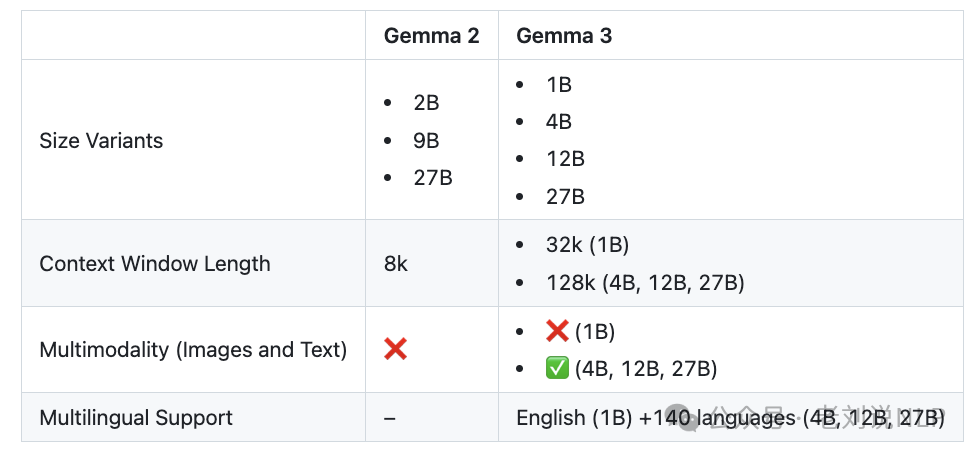

Gemma3相对于Gemma2有三个核心增强功能,更长的上下文长度,多模态,多语言能力,https://github.com/huggingface/blog/blob/main/gemma3.md。

包括1B,4B,12B,27B几个版本,其中,多模态的4B、12B和27B参数模型可以处理图像和文本,1B版本只能处理文本。

对于1B版本,输入上下文窗口长度已从Gemma2的8k增加到32k,对于其他所有版本,则增加到128k。与其他VLM(视觉语言模型)一样,Gemma3会根据用户输入生成文本,这些文本可能由文本组成,也可能由图像组成,示例用途包括问答、分析图像内容、总结文档等

相关模型权重地址,UnslothGGUF量化版本在https://huggingface.co/collections/unsloth/gemma-3-67d12b7e8816ec6efa7e4e5b,MLX在https://huggingface.co/collections/mlx-community/gemma-3-67d14a10480a436ad478b0f9

6、关于大模型训练框架Unsloth

Unsloth框架GRPO部分更新(https://github.com/dCaples/AutoDidact/),支持函数调用和代理反馈循环,基于https://unsloth.ai/blog/r1-reasoning。

形象化链接,走下面这个例子:

模型目标是根据文档生成自己的问题,然后使用搜索工具在语料库中寻找答案,最后再用其他大的模型作为评判标准来评估自己的回答是否正确,最后通过强化学习(RL)来提高能力。

训练过程可以重点:generate_data.py、search_module.py、embeddings.py、rl_helpers.py几个文件,有实现细节。

7、关于chatbi的一个开源项目

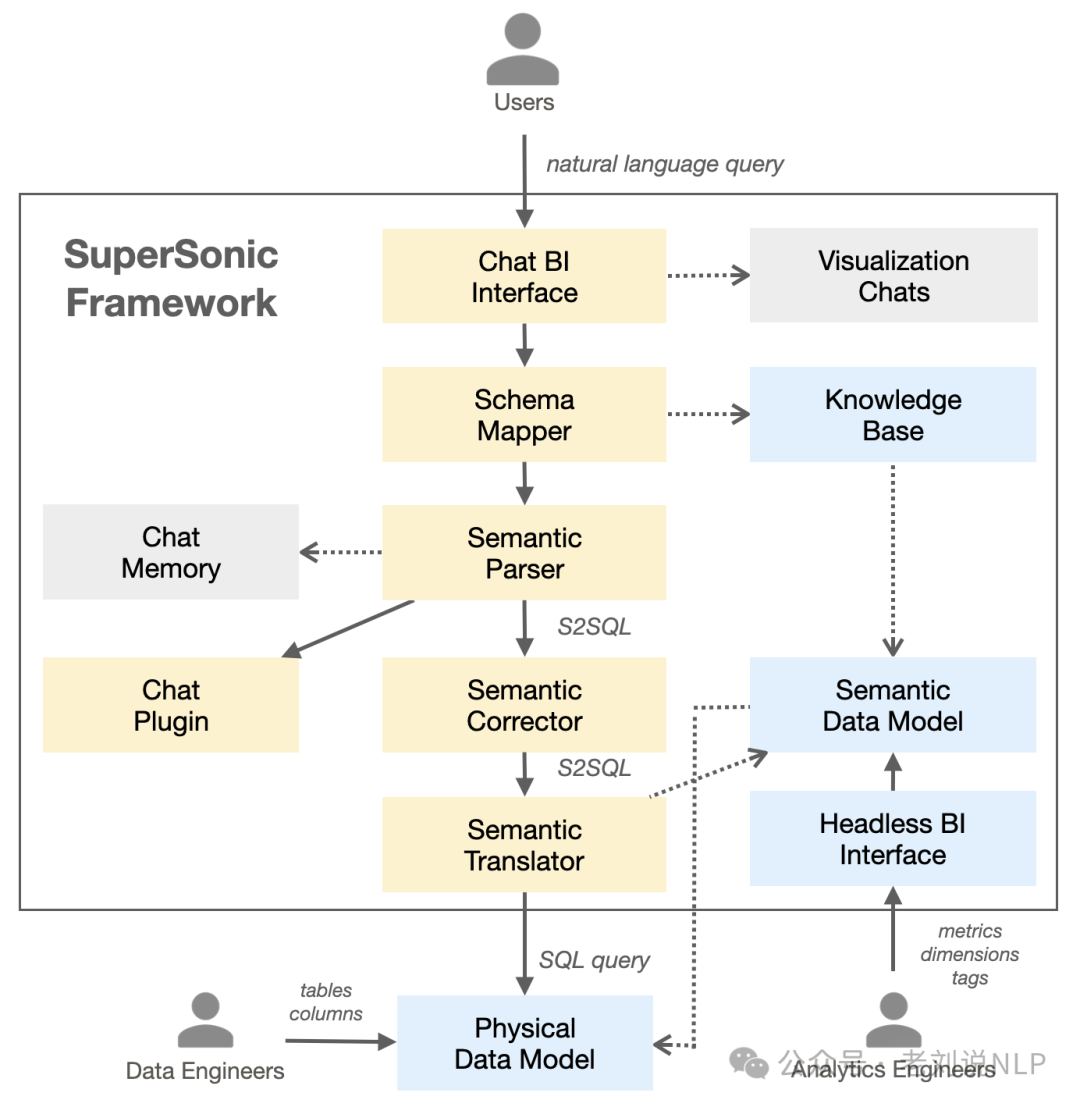

关于chatbi,可以看项目https://github.com/tencentmusic/supersonic,设计NL2SQL以及图表可视化,bug很多,说明难度很大,但技术路线可参考,如下:

1)知识库Knowledge Base定期从语义模型中提取模式信息,并建立字典和索引以促进模式映射。

2)架构映射器Schema Mapper识别用户查询中对架构元素(指标/维度/实体/值)的引用。它将查询文本与知识库进行匹配。

3)语义解析器Semantic Parser 理解用户查询并生成语义查询语句。它由基于规则的解析器和基于 LLM 的解析器组合而成,每个解析器都处理特定的场景。

4)语义校正器Semantic Corrector检查语义查询语句的有效性,并在必要时进行校正。它由基于规则的校正器和基于 LLM 的校正器组合而成,每个校正器处理特定的场景。

5)语义翻译器Semantic Translator将语义查询语句转换为可针对物理数据模型执行的 SQL 语句。

6)聊天插件Chat Plugin使用第三方工具扩展功能。给定一个包含描述和示例问题的已配置插件列表,将利用 LLM 选择最合适的插件。

7)聊天记忆Chat Memory封装了一系列可以调用的历史查询轨迹,以方便进行少量提示。

总结

本文主要回顾了昨日在大模型多个方面的进展,跟进技术实现逻辑,会有更多收获。

参考文献

1、https://mp.weixin.qq.com/s/q04ClmvCcc73962WIKEwpA

2、https://arxiv.org/pdf/2503.05379

3、https://github.com/tencentmusic/supersonic

4、https://github.com/dCaples/AutoDidact/

5、https://github.com/huggingface/blog/blob/main/gemma3.md

(文:老刘说NLP)