大家好,我是木易,一个持续关注AI领域的互联网技术产品经理,国内Top2本科,美国Top10 CS研究生,MBA。我坚信AI是普通人变强的“外挂”,所以创建了“AI信息Gap”这个公众号,专注于分享AI全维度知识,包括但不限于AI科普,AI工具测评,AI效率提升,AI行业洞察。关注我,AI之路不迷路,2025我们继续出发。

AI正在引发一场看不见的学术信任危机。

今天被一条标题为“浙江大学一女生用AI学术造假被麻省理工退学”的新闻刷屏了。

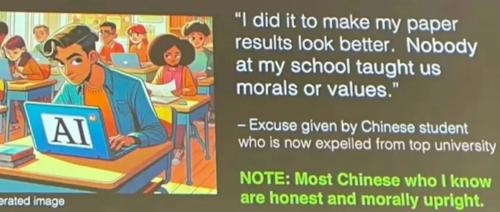

事情的起因是这样的:去年12月(2024年12月),麻省理工学院(MIT)媒体实验室教授 Rosalind Picard 在第38届NeurIPS会议上提到了一则“因为使用ChatGPT进行学术造假而被开除学籍”的事件,并且强调是一名“中国学生”。

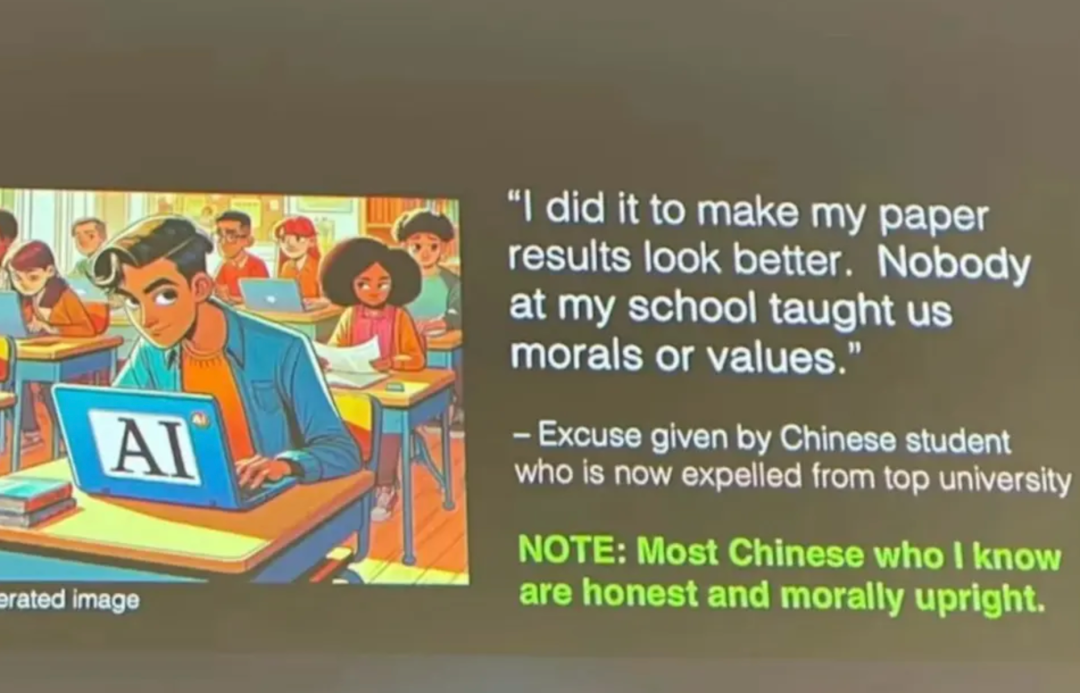

此事一出,迅速在网上发酵。有网友找到了Picard教授提到的这名“中国学生”——来自浙江大学的严同学。而随着事件的声音越来越大,严同学本人也在社交媒体发了小短文回应此事,说明了整件事的原委。事情发生在2023年(备注:ChatGPT爆火的第一年),严同学在一门课的作业里用ChatGPT润色、修改了用户访谈内容,导致结果的呈现与原始数据不符。说人话就是:用ChatGPT篡改了论文里用于佐证论点的数据。最终严同学导致论文停发,并被MIT开除。

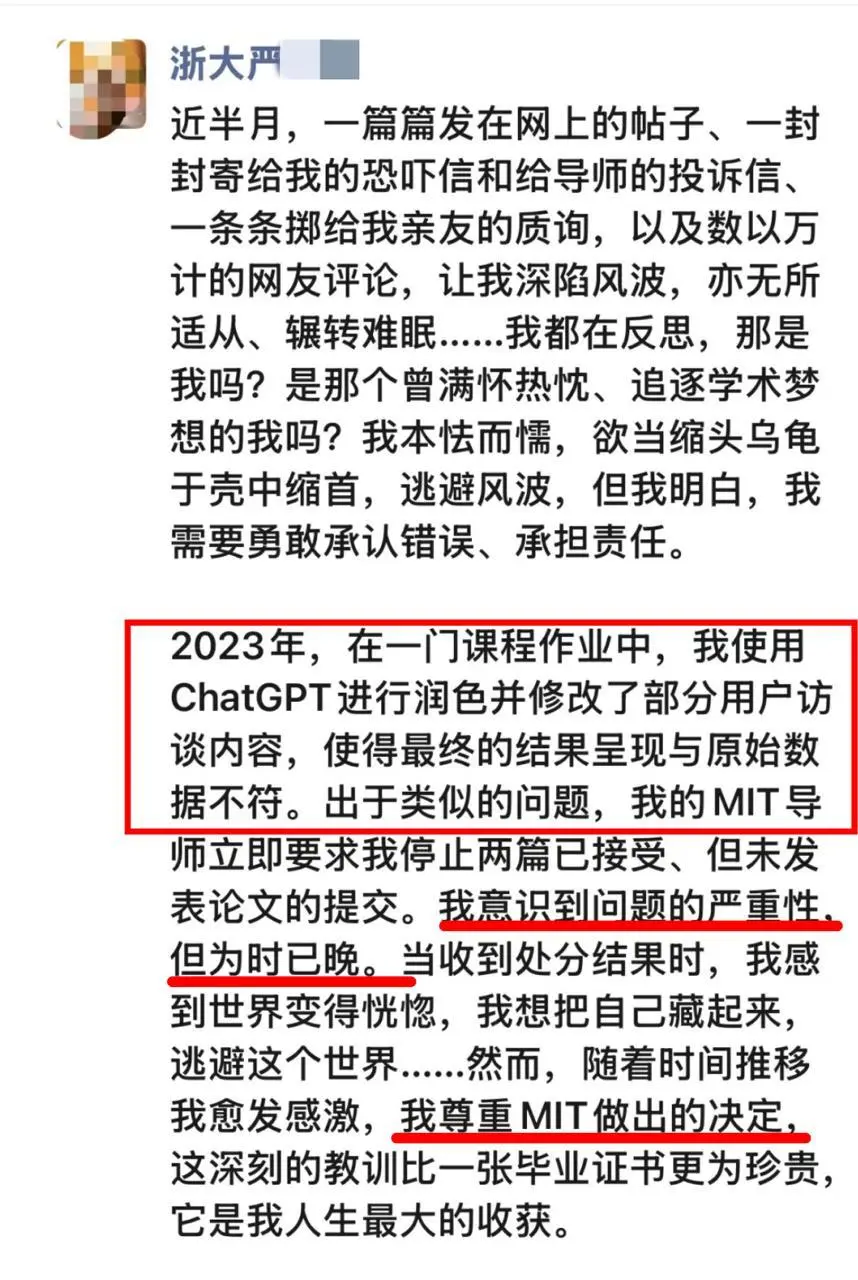

其实将整个事件推上了舆论风口浪尖的原因有两点:一是这位来自浙大的严同学有着极其优秀的背景。她曾是浙江大学“竺可桢奖学金”的获得者,竺奖是浙大最高荣誉之一,每年只有12名本科生和12名研究生评选后获得。

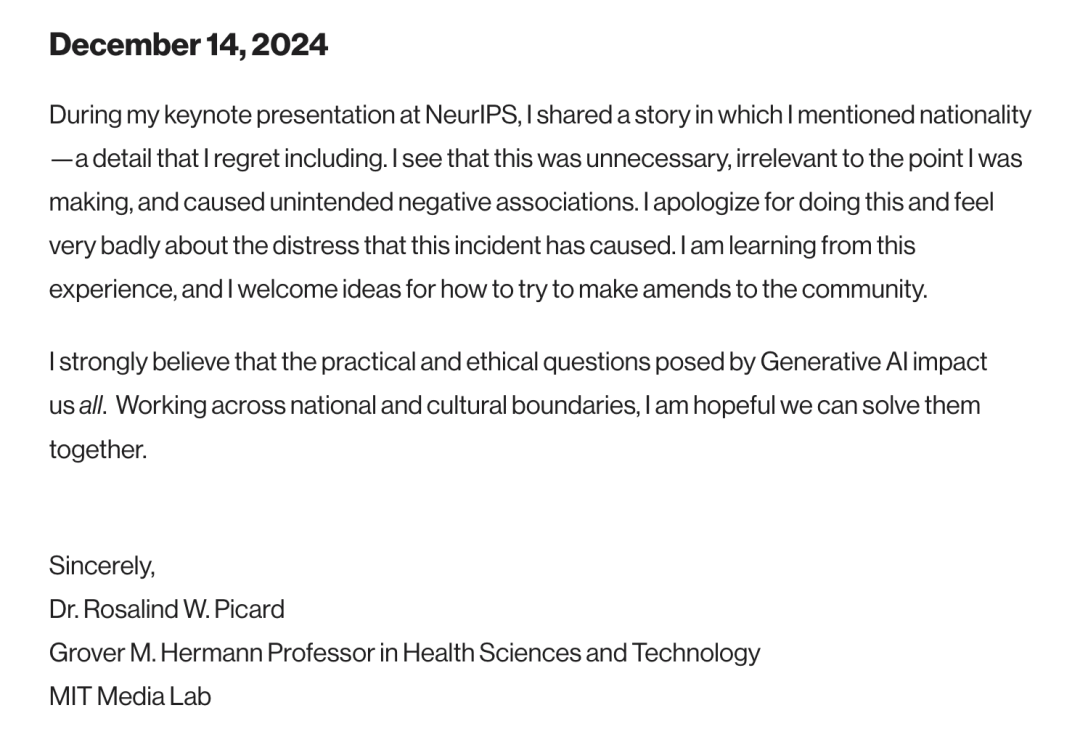

二是在NeurIPS会上,Picard教授提及此事时特别强调了“中国学生”这个身份。要知道,这位教授可以就事论事,但完全没有必要在这种大会上明确指出被开除的学生是哪个国家的。事后多位学者指出Picard教授的表述涉嫌种族歧视。Picard教授本人随后也发表了正式的道歉声明,表示提及学生国籍是不必要且不相关的。

During my keynote presentation at NeurIPS, I shared a story in which I mentioned nationality—a detail that I regret including.

Picard教授表示:我很后悔把“国籍”这个细节写进了PPT里。

I see that this was unnecessary, irrelevant to the point I was making, and caused unintended negative associations.

承认这是不必要、不相关的。

I apologize for doing this and feel very badly about the distress that this incident has caused.

正式道歉。

“学术造假”行为不管在哪里,都是绝对不被接受的,无关背景。尤其是像严同学这种,是对论文的支持数据进行造假,是踩在了学术信任的红线上。因为,数据是学术研究的基石。数据直接决定了研究结论的可靠性和有效性。如果数据本身就是伪造的,那么基于这些假数据得出的结论将毫无价值可言。更不用说,后来的研究者如果再引用这篇论文,得出其他不可靠的研究成果,这样会形成一连串的恶性循环。

这一事件毫无疑问为AI时代的“学术诚信”敲响了警钟。

无独有偶。复旦大学在2024年11月底发布了《复旦大学关于在本科毕业论文(设计)中使用AI工具的规定(试行)》,其中明确提出了“六个禁止”,对AI工具的使用范围和边界进行了严格规范。

“六个禁止”中,前2条是“数据真实性”这条红线的保护:禁止在研究设计和数据分析等关键环节使用AI工具,以及禁止生成或改动原创性数据和实验结果。联想到浙大的严同学“利用ChatGPT篡改访谈数据”这个事件,就不难理解为什么她会被MIT直接退学处理了。

其余禁止的事项还包括:禁止直接生成论文正文或其他组成部分,也就是论文本身只能自己组织语言自己写出来,不能让AI直接生成。很合理,如果AI直接生成论文了,人类的思想也就没有意义了。禁止进行语言润色和翻译。这一点主要是处于对学生语言能力培养的考虑。禁止答辩委员或评审专家使用AI工具评审。这一点也很有意义,写论文的不能用AI工具,评审专家也不能用AI工具来评价。最后是禁止在涉密内容中使用AI工具。虽然是最后一条,也是极其重要的一条。敏感信息在点击发送按钮的那一瞬间,就决定了它大概率已经被泄露了。

结语

AI有风险,使用需谨慎啊。

(文:AI信息Gap)