跳至内容

作者|子川

来源|AI先锋官

太炸裂了,就在刚刚,DeepSeek前脚发布它们最新模型DeepSeek-R1,kimi紧随其后,发布了k系列最新的多模态思考模型k1.5。

而且这两位还达成了共识,同一个主题:对标o1,不输o1。

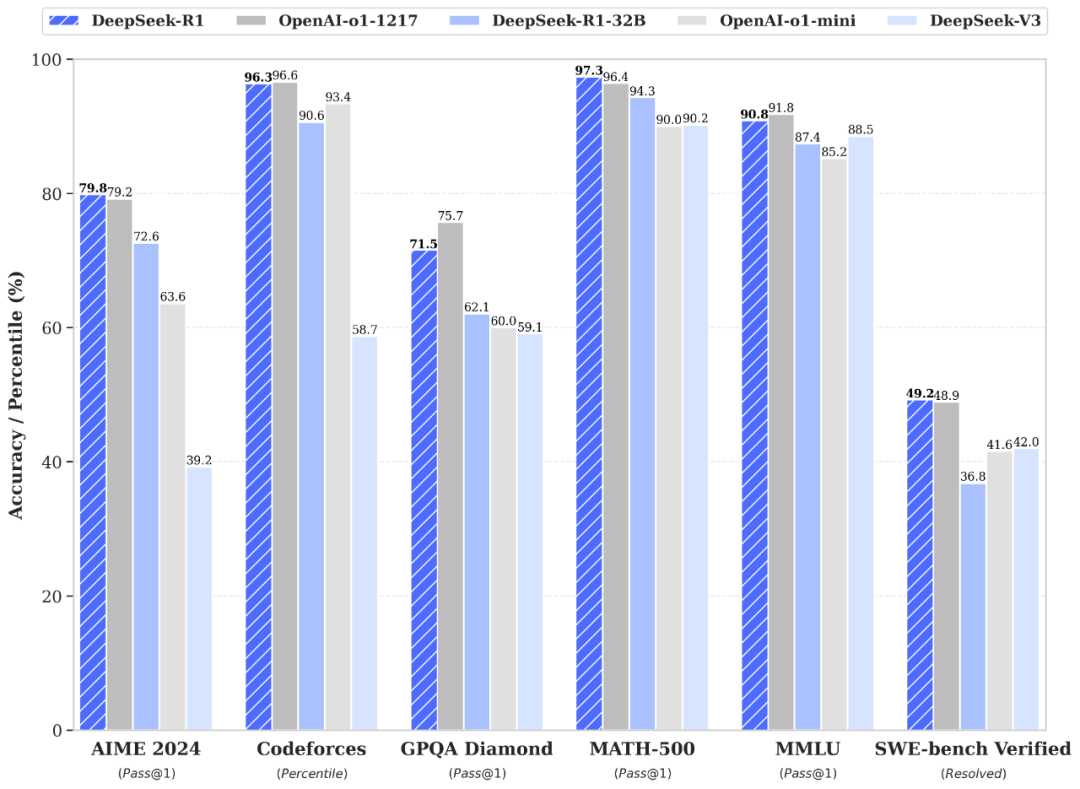

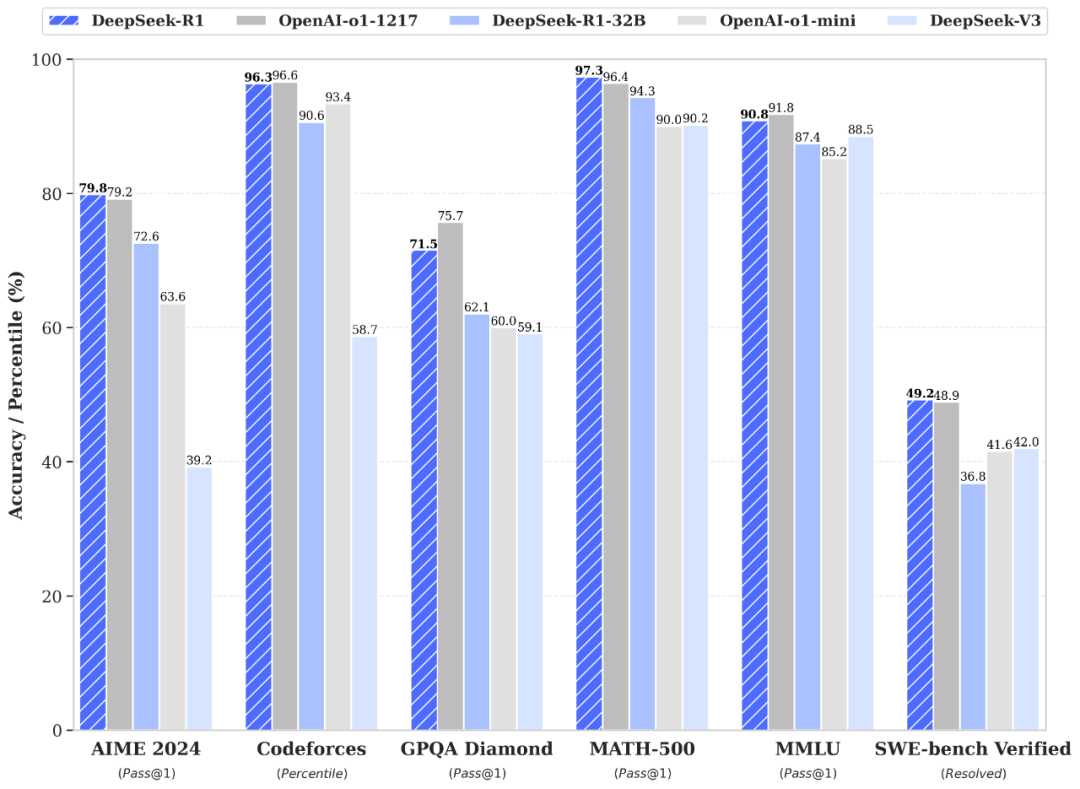

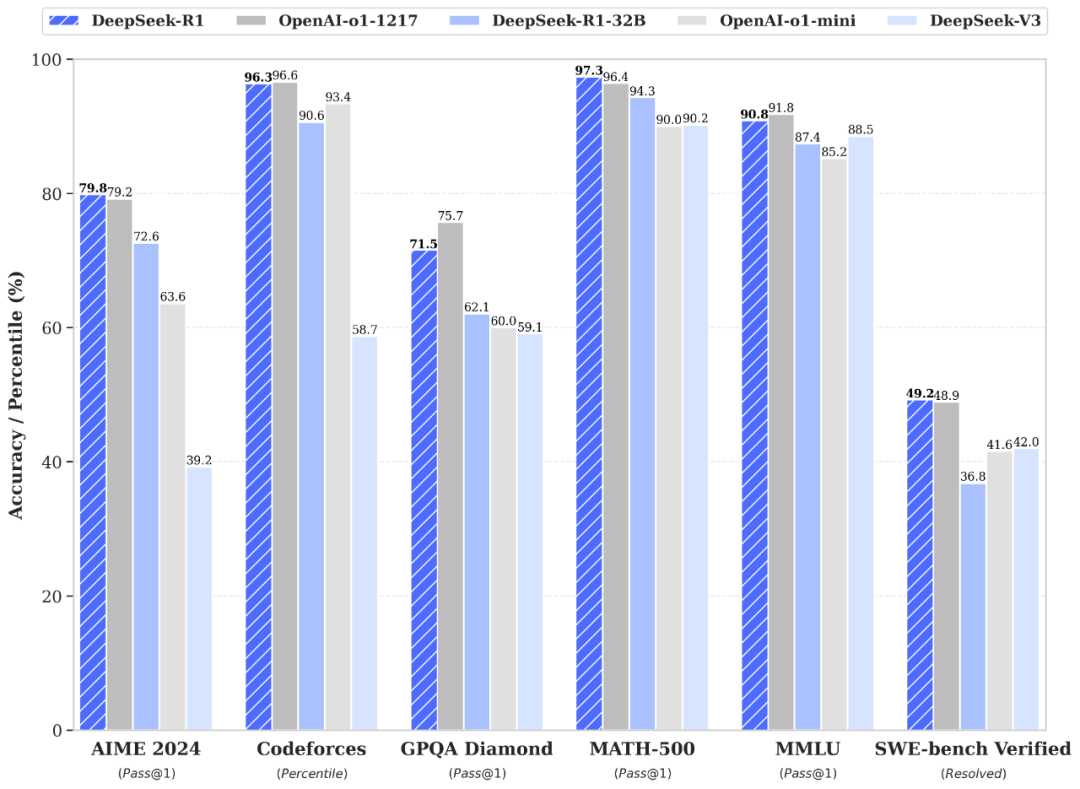

废话不多说,率先来看一下DeepSeek-R1的成绩单!

说实话,从官方放出的基准测试的成绩,已经完全看不出DeepSeek-R1和正式版o1的差距。

代表它们的柱状图在数学、代码、自然语言推理等任务上的表现几乎持平……

除此之外,Deepseek再一次上演了什么才是“Open AI“。

此次不仅将 DeepSeek-R1 训练技术全部公开,还开源 DeepSeek-R1-Zero 和 DeepSeek-R1 两个 660B 模型。

论文链接:

https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

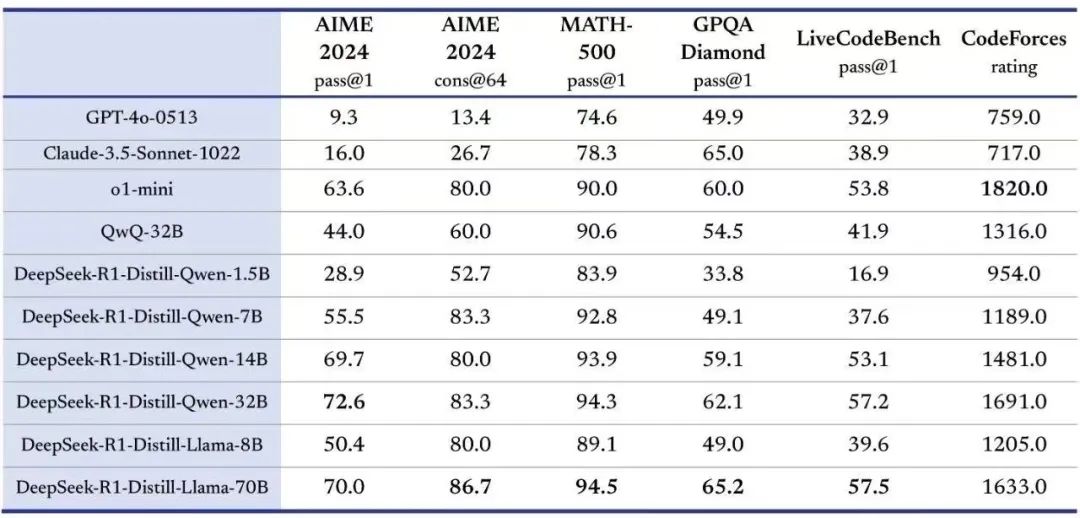

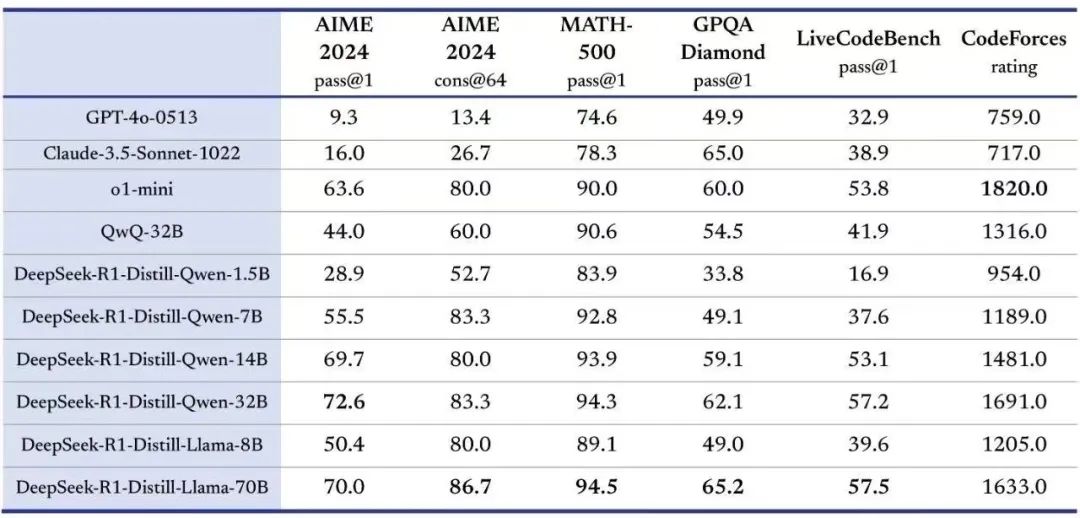

与此同时,还通过 DeepSeek-R1 的输出,蒸馏了 6 个小模型开源给社区,其中 32B 和 70B 模型在多项能力上比肩OpenAI o1-mini。

严重怀疑,DeepSeek是真把开源社区当家了,这和当街撒币有什么区别,而且撒的都是金币。

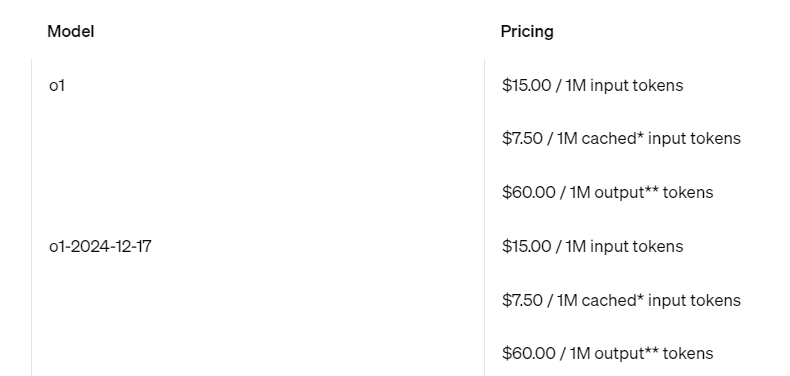

接下来,就是大家最期待的环节了:此次DeepSeek-R1 API的定价!

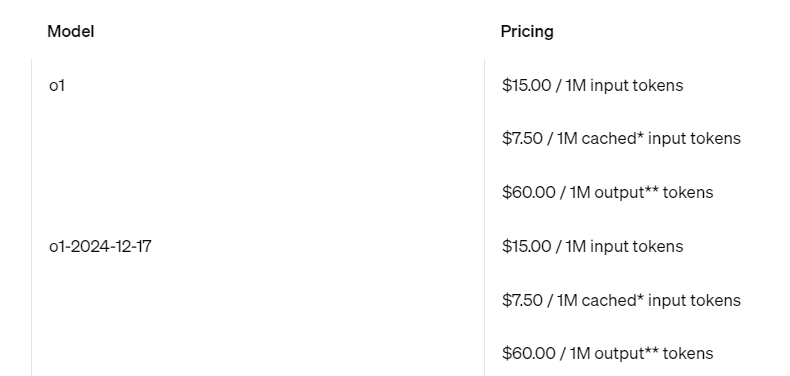

每百万输入 tokens 1 元(缓存命中)/ 4 元(缓存未命中),每百万输出 tokens 16 元。

每百万输入 tokens 15美金,每百万输出 tokens 60美刀……

看到这价格,小编只想说一句:OpenAI,你丫的心好黑!

DeepSeek这笔操作,相当于o1开源了,API也能用了而且还超便宜,对于国内的开发者而言,简直是大好事。

目前DeepSeek-R1已正式上线DeepSeek官网了,登录DeepSeek官网或官方App,打开“深度思考”模式,就可以直接使用了。

Kimi 发布多模态思考模型k1.5,首次公开训练报告

今天的另一个主角,就是kimi刚刚发布的k1.5 多模态思考模型。

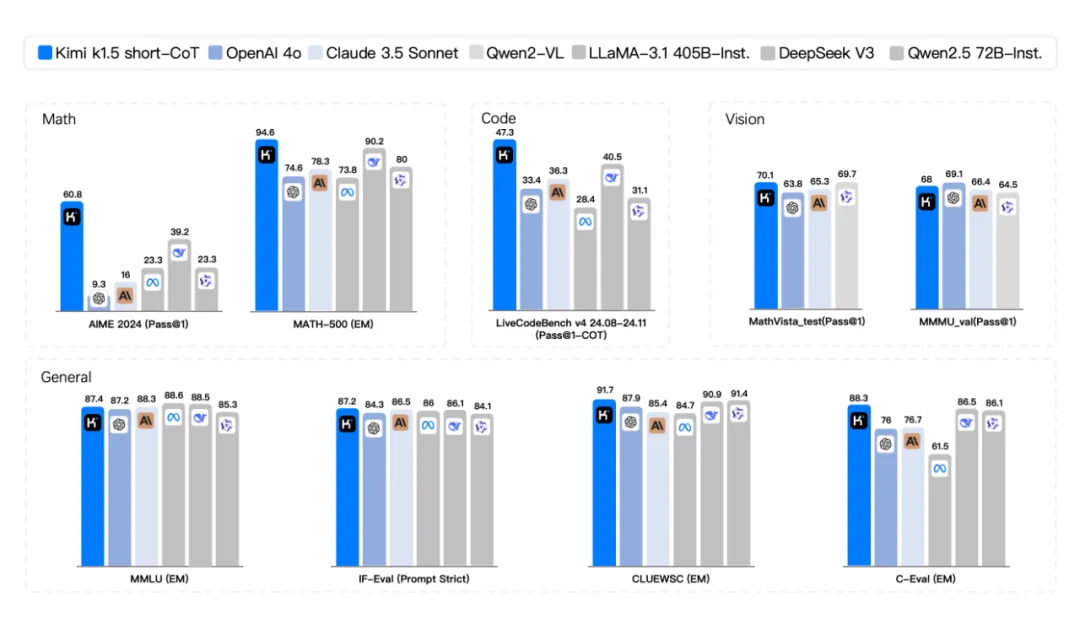

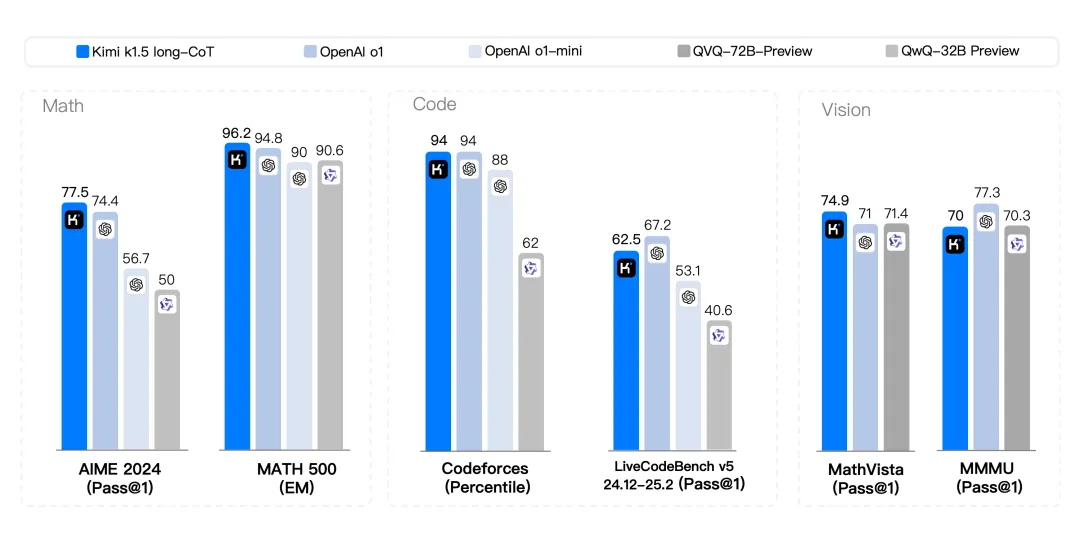

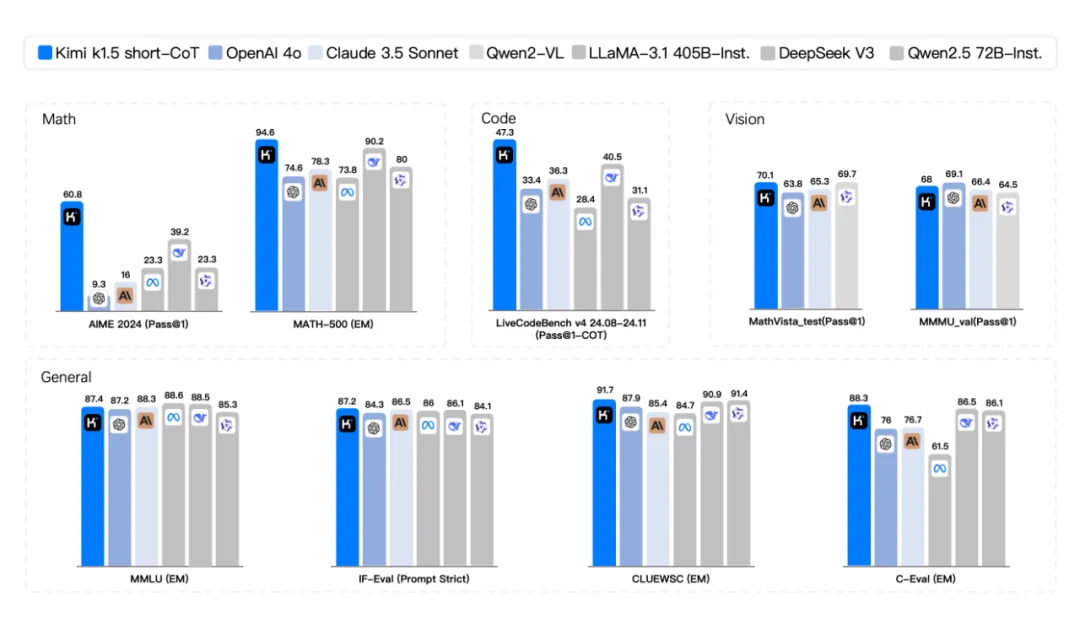

同样,先到秀肌肉环节,给大家看一下k1.5 的成绩单。

在 short-CoT 模式下,Kimi k1.5 在数学、代码、视觉多模态和通用能力上,领先GPT-4o、Claude 3.5 Sonnet以及DeepSeek V3。

很多朋友并不知道short-CoT 模式是什么,给大家简单科普一下short-CoT 。

Short-CoT 是“Zero-shot Chain-of-Thought”的简称,即零样例思维链。它是一种在大语言模型中使用的提示技术,无需提供任何示例,仅通过自然语言指令引导模型进行逐步推理,从而得出答案。

例如,在解决数学问题时,模型会先展示出详细的推理步骤,再给出最终答案,而不是直接给出结果。

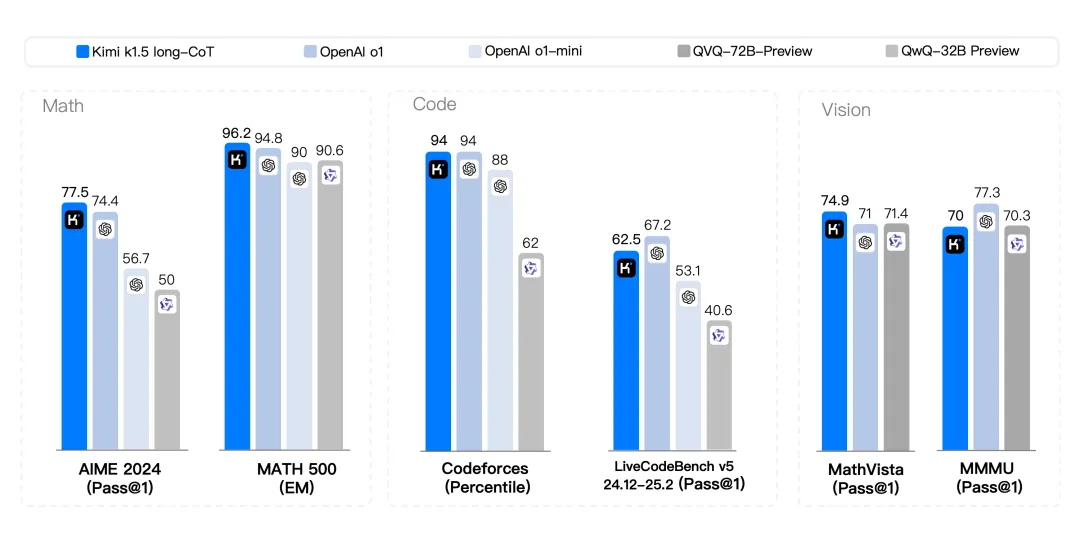

同时在 long-CoT 模式下,Kimi k1.5 的数学、代码、多模态推理能力,堪比 OpenAI o1 正式版的水平。

思维链(CoT)就像是给AI出题时,让它不仅要给出答案,还要把思考的过程写出来,就像学生做数学题要写出解题步骤一样。这样可以帮助AI更好地理解和解决问题。

而Long-CoT就是在思维链的基础上,让AI写出更长、更详细的思考过程。比如原本只需要写三步思考过程,现在可能要写五步、十步甚至更多,这样能让AI处理更复杂的问题,就像解决一个更难的数学题需要更多的步骤一样。

据悉,这是OpenAI 之外的公司首次实现 o1 正式版的多模态推理性能。

同时,Kimi也首次公开了K1.5模型的训练报告。

github 链接:

https://github.com/MoonshotAI/kimi-k1.5

目前,K1.5多模态思考模型的预览版已逐渐进入灰度测试阶段,大家可以去查看自己的kimi是否被灰度到。

从它们发布的技术报告我们不难看出,DeepSeek R1和Kimi K1.5都是基于增强学习(Reinforcement Learning, RL)技术训练的大语言模型(LLM)。

通过奖励机制,这些模型能够在缺乏大量标注数据的情况下自主进行探索与改进。

两者均强调对长文本上下文的处理能力,以提升模型在复杂推理任务中的表现。

DeepSeek R1通过纯粹的RL训练方法,展现了自我验证和反思的能力,使其在推理任务中表现出色。

而Kimi K1.5在RL训练中采用多种采样策略(如课程采样和优先采样),使得模型在应对不同难度的问题时更加高效。

不过,相较于DeepSeek R1,Kimi K1.5有一个天然的优势,那就是支持多模态。

随着DeepSeek和Kimi相继发布了各自的最新的模型,同时对标o1,不输o1!

DeepSeek的全力开源与Kimi的首次发布训练报告,无疑是对开源精神的积极响应。

这让我们不禁思考,技术的开放性与共享性或许已经成为推动行业进步的关键所在。

DeepSeek在去年2024年底爆火出圈,尤其是其C端App的快速推出,吸引大量用户关注和使用,令其人气急速攀升。

相关阅读:DeepSeek推出手机App,实测体验就一个字“快”

其产品体验与气质与当红炸子鸡Kimi极为相似,甚至在某些方面更具优势。这无疑给后劲似乎不足的Kimi带来了不小的压力。

(文:AI先锋官)