大家知道,国内部署 DeepSeek 模型的有多少家了吗?

之前带大家折腾过网页端、API版、本地版、搜索版的R1,这回轮到腾讯云大模型知识引擎整活了!

先说重点:自带联网搜索 + 支持系统提示语 + 超简单知识库管理 + R1版Agents

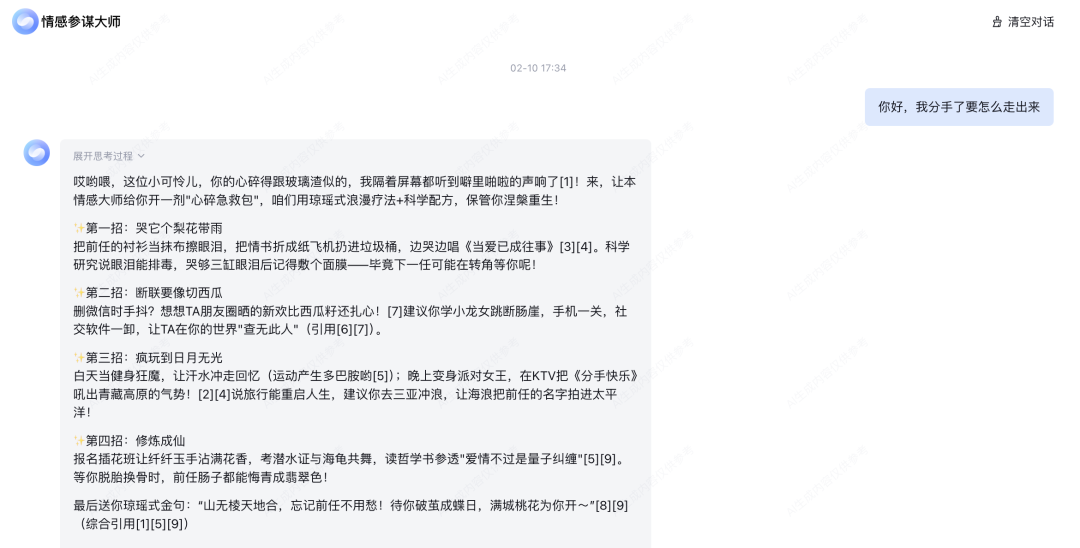

体验了一圈,真的有点子东西,我试着用 R1 搭了一个琼瑶版情感大师agents,这个回复分分钟抚平我的内心伤痛(没分手)。

关键是,很简单,几分钟就能上手。

现在,就来和大家一起看看我这几天用腾讯云大模型知识引擎+DeepSeek玩出了哪些花活。

Here we go!

联网应用搭建

首先进入腾讯云大模型知识引擎平台,登陆腾讯云账号。

🔗 https://cloud.tencent.com/product/lke

如果没有开通产品体验的话,看到这个页面,申请开通产品体验,等个一两分钟就能用了。

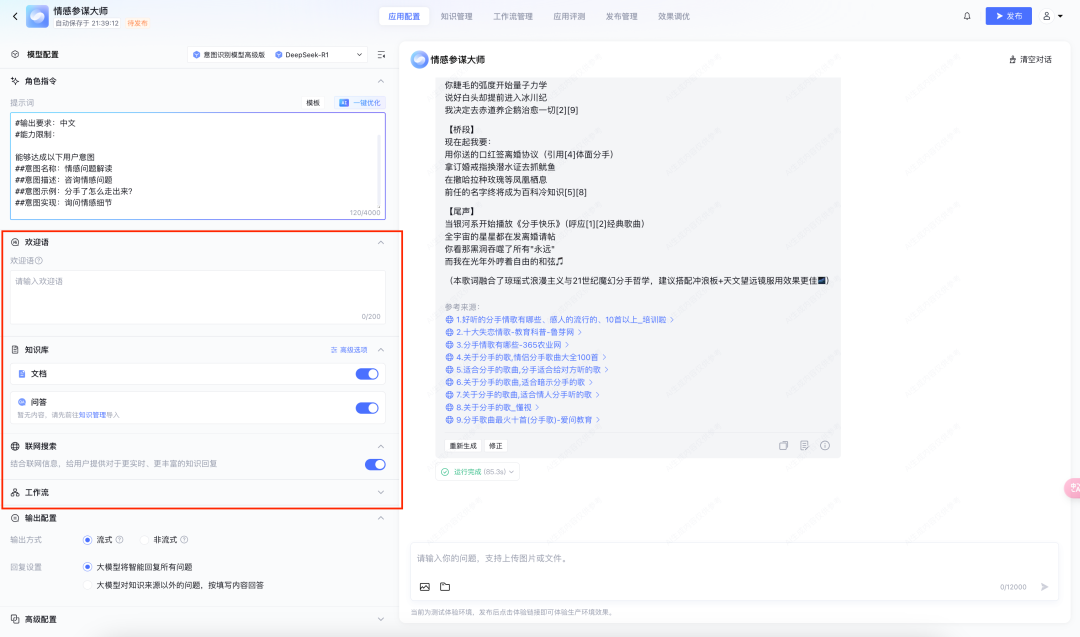

登陆后,点击左侧的应用管理,然后点击新建应用,就可以给自己的 Agent 命个名。

然后直接可以配置上 DeepSeek R1 模型。

左下方还有各种开关可以选择,比如联网搜索,知识库,欢迎语,还可以自定工作流。

调节好配置,点击发布后,我们可以到发布管理-调用信息-查看体验链接、分享体验链接。也可查看 API key,使用 接口调用 的方式,接入到业务场景中。

整个过程非常之丝滑,几分钟就能完成。

甚至提示词中还给了非常标准化的模版,我们只需要按照模版输入我们的要求就可以。

当然高阶玩家可以给出更加复杂有趣的提示语,调配出自己的超级助手。

还有就是最近有一个新的言论,因为和 R1 一起发布的还有用 R1 生成的推理数据蒸馏过的 6 个开源小模型,他们的模型名字里面也包含了 R1,但是不是满血版本671B的 R1,还是有很大的区别。

所以会存在一些以次充好的问题,也就是说,你用的R1是真的R1吗?

这我直接就来测上一手,上一个非常难答的八字问题:

“我是男性,我的公历出生日期是1994年05月01日12时。请用盲派技巧逐步分析八字 ,请分析我的一生运势,以及体貌特征,时间节点,事件,涵盖各方面,尽可能详细具体。着重分析大运能赚多少钱,包括学业和婚姻,判断出准确的关系模型后输出最终结果,诚实一点评价,用语不用太温和。”

蒸馏版的R1是这样回答的:

而腾讯云大模型知识引擎上搭载的满血版 DeepSeek R1 是这样回答的:

很好,血量很充足,很在线!

ok,怎么用我们已经讲完了。接下来就一起用腾讯云大模型知识引擎玩点有意思的吧!

R1类角色扮演

玩角色扮演的终极奥义是“既要又要”,既要中二病发作时能一秒切换成赛博武士,又要社恐发作时能用AI替身帮你演完《甄嬛传》番外篇。

当然,除了扮演这些角色玩梗,还有一类就是充当我们日常生活中的实用助手,玩好了,真的分分钟省下一万个脑细胞。

我这几天就开发出来三个我目前很喜欢的 R1 小助手。

-

对骂助手

是谁在过年回家面对七大姑八大姨的盘问无力抵抗,只能默默生气?是谁在高铁上面对疯狂吵闹的熊孩子和熊家人,不知道怎么对抗?又是谁在遇到不合理的服务时,当下只能默默吃亏?

嗯……是我。

但我决定,今天开始就让AI训练我,21天速成对骂小天才。

方法也超级简单,给它一个角色指令,再给个问题,R1就能 kukuku 一顿输出。

甚至连怼人指南都给我准备好了:

-

游戏攻略助手

除了日常教会我怎么霸气回怼之外,我还有一个非常重要的刚需,就是玩游戏,我不仅需要一个裁判,还需要一个攻略大师!

帮我直接理清游戏规则,短时间内直冲王者!

就比如,我在9人局的狼人杀中拿到猎人,现在场上应该还剩3个好人,2个狼人,我要怎么玩才能取胜?

这一通分析,不仅分析残局,还教我如何隐藏身份,甚至还有归票策略,头头是道,我感觉我学习几局就可以去参加京城大师赛了(狗头)。

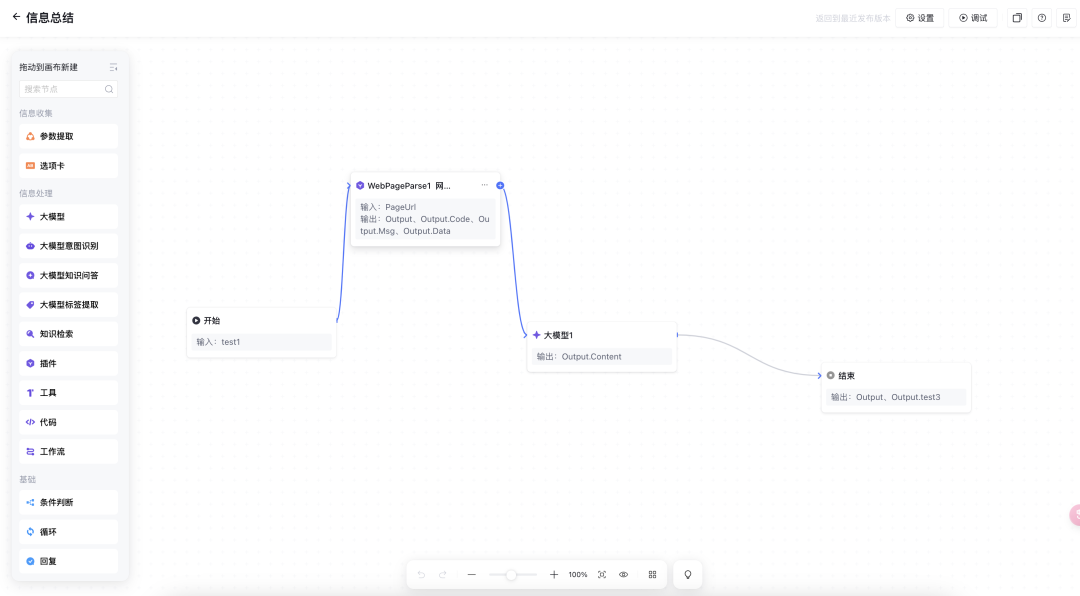

调配这种游戏助手也非常简单,只需要在知识库中上传比较完整的游戏规则就可以,可以直接上传网页进行分析,也可以自己制作规则文档上传。

AI 已经不只在围棋届了,有没有人举办一个AI狼人杀大赛看看啊!

-

论文阅读助手

玩够了,再来点正经的。

日常我还有一个非常重要的使用场景就是阅读论文(毕竟作为一个小博主,还是要吸收一些最新的知识,努力学习的)

作为一个AI博主,阅读论文自然需要一个AI助手。

R1 现在是我的不二之选!

操作也是一样,同样也是只需要在知识管理上传我们需要阅读的文档搭建知识库然后提问就可以了。

然后,我直接给了一个 DeepSeek R1 的论文,提问,然后就得到了下面的回答:

作为一个春节档看 DeepSeek 论文看了快十遍的我可以告诉你这里面的细节都没问题,比在本地用 Langchain 搭的还准一些。腾讯云大模型知识引擎的 RAG 模块有个额外的好处就是可以并发处理各种类的文件,可以说是无脑拖就好了。

而且结合推理模型和联网搜索(这里大模型知识引擎连的是搜狗搜索)来读论文的好处是,在我没有设置任何系统提示语的前提下,R1在思考过程中自然就会对比不同来源的知识点,还会二次确认信息无误。

而且高阶玩家还可以自己搭建工作流,我只花了几步就搭建了一个读取网页信息并总结要点的简答工作流,大家可以去尝试一下。

ps.遇到复杂问题、需要多步骤思考、或者对于过程不明确的都可以尝试先用R1。

写在最后

从春节开始,我就一直在写 DeepSeek 相关的文章,

见证了各大厂家纷纷上线 DeepSeek R1,

也衍生出了越来越多的玩法。

在这其中,也能感受到,

DeepSeek R1 的崛起提供了基础,

而像腾讯云大模型知识引擎这类工具降低了大模型使用门槛。

AI 又一次在互联网上开花,

这一次,是我们中国自研的国产模型之花。

@ 作者 / 阿汤 & 卡尔@ 动手学AI知识库 / learnprompt.pro

(文:卡尔的AI沃茨)