🍹 Insight Daily 🪺

Aitrainee | 公众号:AI进修生

Hi,这里是Aitrainee,欢迎阅读本期新文章。

都这么久了,DeepSeek 官网服务还崩着呢。。。

大家反应最多的就是:第 1 轮能回答,第 2 轮就是这个:

所以今天分享一款我一直在用的R1满血版平台 —— 问小白。

这里是它留给我的印象:

全免费、界面和官网一样简洁、快、快的飞起、提问后 2 秒出第一个 token、671B满血版、非常稳定。

:

:

。

。问小白提问后 2 秒出第一个 token,其他的 r1 满血版需要 4 秒,基本快 2 倍的样子:

其实国外也一直有许多平台在宣扬他们托管的Deepseek有多么多么快的。

挖一挖问小白公司,发现他们是国内率先采用自研MOE模型架构、对Deepseek的MOE模型非常熟悉。

他们有自研MOE大模型优势,能做到双核驱动,效果1+1>2。

另外,秘塔、纳米AI搜索接入R1后,网页端是必走搜索引擎(纳米手机端可以关掉搜索)。

实际上我们可能需要像问小白这样可以选择是否联网:

有些场景我们只需要和模型单独对话。

还有它的界面及操作和官方很接近:

简洁好用,体验流畅是一些网友对它的评价。

还有感觉自从Deepseek火了之后,大家发现新的R1托管平台都是自己藏着偷偷用 :

:

好了,这个东西我知道了,你删文吧。

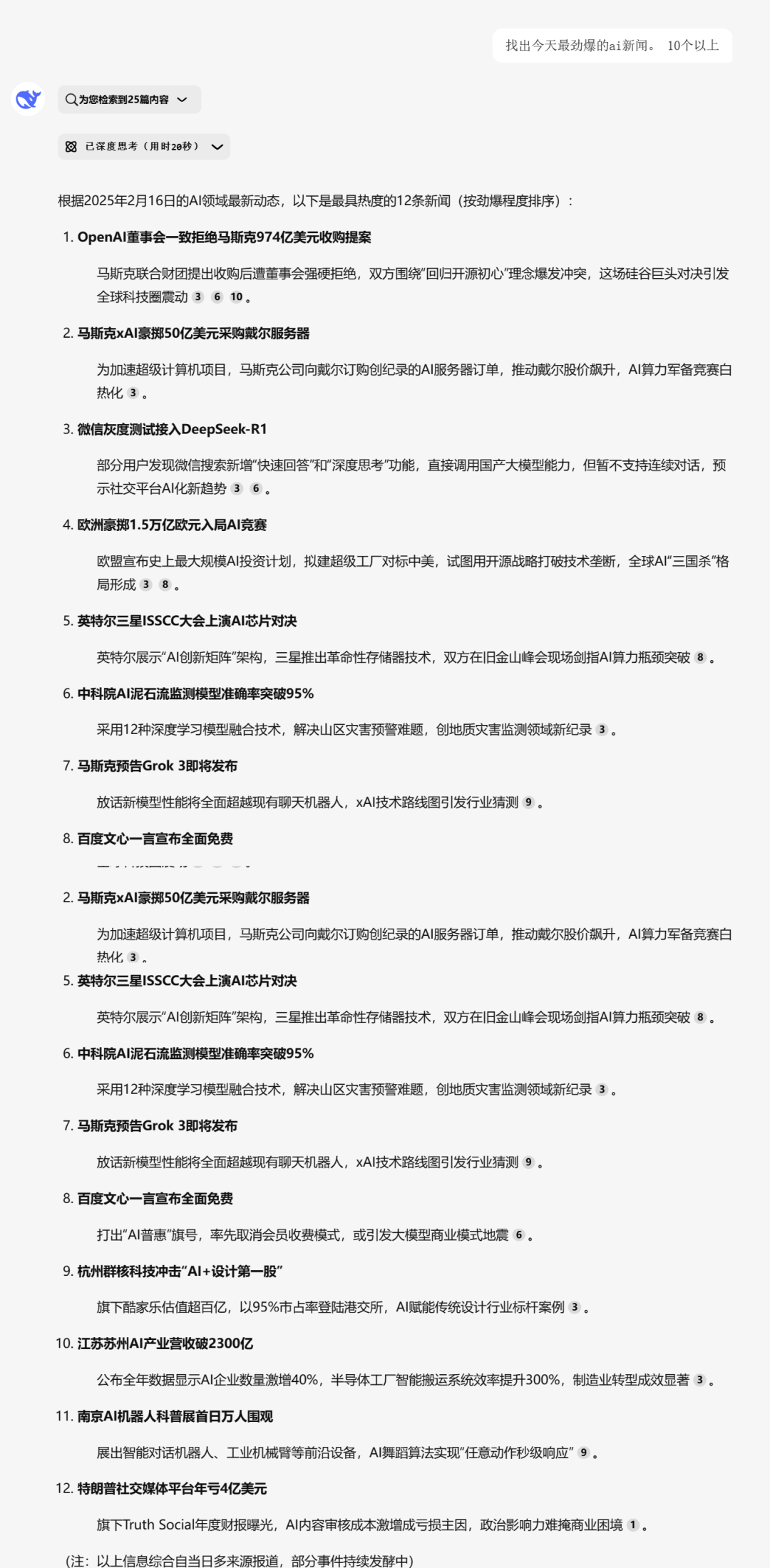

其中Grok3预发布、微信灰度测试R1都是当天的重要新闻,所以还不错。

当然我就是喜欢这种推理模型很快的平台,方便各种辅助性思考和创作。

手机端的话还有智能体、Deepseek教程等等。并且支持语音。图片分析、文档上传啥的都可以。

手机端的话还有智能体、Deepseek教程等等。并且支持语音。图片分析、文档上传啥的都可以。

点这里👇关注我,记得标星哦~

(文:AI进修生)