本文来自今天头条的第3个Case,所有内容由智谱清言「沉思」生成,全文共8000字。

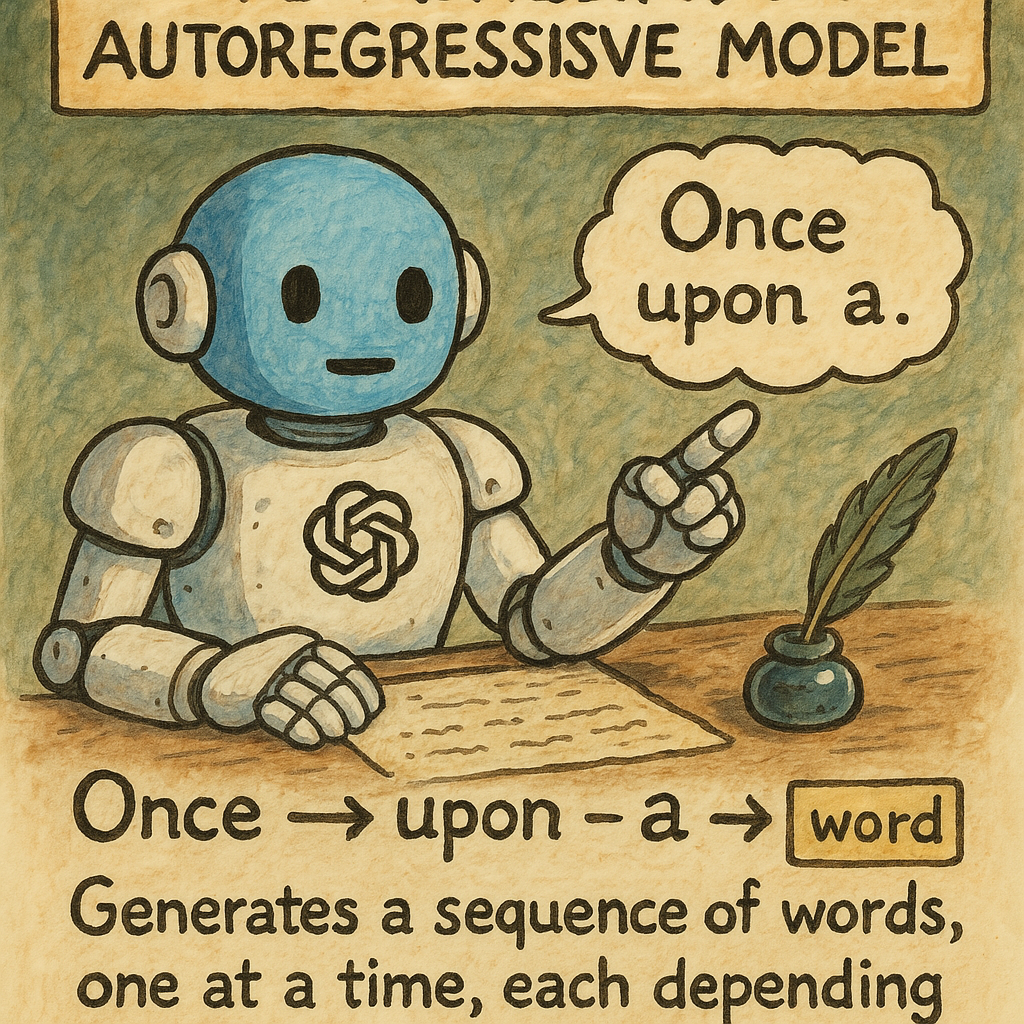

图由GPT-4o生成,提示词:生成一张解释OpenAI自回归模型的图片,吉卜力风格。

摘要

本研究报告深入探讨了OpenAI自回归模型(AR)的技术原理、实现方法及其在生成式AI领域的应用。报告从自回归模型的基本概念出发,详细分析了OpenAI自回归模型的技术特点,拆解了OpenAI自回归模型的技术实现,并剖析了其在ChatGPT-4o中的应用。同时,报告还对自回归模型与扩散模型进行了对比分析,探讨了自回归技术面临的挑战与未来发展方向。通过系统性地研究OpenAI的自回归模型技术,本报告旨在为理解生成式AI的核心技术提供全面的视角。

1. 概述

自回归模型是生成式AI中的核心技术之一,它通过预测序列中的下一个元素来生成内容。OpenAI作为AI领域的引领者,其自回归模型技术在自然语言处理和多模态生成领域取得了显著成就。本报告将深入研究OpenAI自回归模型的技术细节,探讨其在ChatGPT-4o中的应用,并与扩散模型进行对比分析,最后评估自回归技术的挑战与未来展望。

2. 自回归模型介绍

自回归模型的基本原理

自回归模型是一种预测变量基于其之前观测值的机器学习技术,它使用时间序列中先前时间步长的一个或多个值来创建回归模型。这是一种简单但功能强大的时间序列分析工具[0]。在机器学习中,自回归模型被广泛应用于序列预测任务,例如预测股票价格、天气变化等。

在生成式AI领域,自回归模型被用于生成文本、图像等多模态内容。基本思想是:给定前面的元素,模型会预测下一个元素。例如,在文本生成中,给定前面的词,模型会预测下一个词;在图像生成中,给定前面的像素或图像块,模型会预测下一个像素或图像块。

自回归模型的数学表示

自回归模型可以用以下公式表示:

p(x_1, x_2, …, x_T) = ∏_{t=1}^T p(x_t | x_1, x_2, …, x_{t-1})

其中,p(x_1, x_2, …, x_T)是整个序列的联合概率分布,p(x_t | x_1, x_2, …, x_{t-1})是给定前t-1个元素的条件下,第t个元素的条件概率。

这种模型被称为自回归模型,因为它们是对自己执行回归。在生成过程中,模型从第一个元素开始,逐步预测下一个元素,直到生成完整的序列[4]。

自回归模型的优势与局限性

优势

-

1.简单直观:AR模型的魅力在于其简洁明了的预测逻辑:仅依据时间序列以往的观测值来预测未来趋势,概念直观,易于理解和实施[2]。

-

2.适应性强:自回归模型能够适应各种类型的数据,从文本到图像再到音频,只要数据能够被表示为序列形式。

-

3.训练效率高:自回归模型的训练过程相对简单,可以使用标准的深度学习训练方法,如随机梯度下降。

-

4.生成质量好:在许多任务中,自回归模型能够生成高质量的内容,尤其是在文本生成领域。

局限性

-

1.计算复杂度高:自回归模型的训练和推理过程需要大量的计算资源,尤其是对于大规模模型。

-

2.生成速度慢:由于生成过程是序列化的,自回归模型的生成速度相对较慢。

-

3.难以处理全局依赖关系:自回归模型从左到右的建模方式限制了模型在处理需要全局依赖关系的任务中的表现。

-

4.模式崩溃:在某些情况下,自回归模型可能会生成重复的模式或陷入循环。

3. OpenAI自回归模型技术拆解

OpenAI自回归模型的发展历程

OpenAI的自回归模型经历了从GPT-1到GPT-4o的不断发展,每一代模型都在规模、性能和应用范围上取得了显著突破。

GPT-1:自注意力机制的引入

GPT-1模型采用了基于自注意力(Self-Attention)机制的Transformer模型,模型架构只包括解码器(Decoder)部分。在预训练过程中,使用了掩码自注意力(Masked Self-attention),使模型只能看到前面的词,而看不到后面的词[72]。

GPT-2:模型规模的扩大

GPT-2进一步扩大了模型规模,并改进了训练方法。OpenAI在训练过程中引入了模型并行和张量并行(Tensor Parallelism),这是一种模型并行的变体,它将模型分割成多块,以实现层内模型并行,从而达到与单个GPU基准线76%效率相当的水平[73]。

GPT-3:大规模预训练与少样本学习

GPT-3是一个参数量为1750亿的自回归语言模型,它通过训练一个大规模的自回归语言模型并测试它的上下文学习能力来验证其假设。GPT-3在二十多个NLP数据集以及几个设计用来测试快速适应能力的任务中表现出色[20]。

GPT-4:多模态能力的引入

GPT-4是一个大规模的多模态模型,它可以接受图像和文本输入并产生文本输出。GPT-4在各种基准测试中表现出色,包括需要推理和记忆的任务[25]。

GPT-4o:全模态模型

GPT-4o(”o”代表”omni”)旨在处理文本、音频和视频输入的组合,并能生成文本、音频和图像格式的输出[64]。GPT-4o的图像生成功能是一个自回归模型,通过多次通过来逐像素地生成图像,而不是像扩散模型那样执行去噪步骤[6]。

OpenAI自回归模型的架构特点

OpenAI的自回归模型基于Transformer架构,由多个自注意力头和前馈神经网络层组成。这些模型在大量文本数据上进行预训练,以预测序列中的下一个词。对于图像生成,这些模型将图像表示为离散的标记,并逐步生成这些标记。

Transformer架构

Transformer架构由多个编码器(Encoder)和解码器(Decoder)层组成。在自回归模型中,通常只使用解码器部分,因为模型需要根据前面的元素预测后面的元素。每个解码器层包含多头自注意力(Multi-head Self-attention)和前馈神经网络(Position-wise Feed-Forward Networks)。

自注意力机制

自注意力机制使模型能够关注输入序列的不同位置,从而捕捉长距离依赖关系。在文本生成中,这使模型能够理解上下文信息;在图像生成中,这使模型能够捕捉图像中的空间关系。

模型参数规模

OpenAI的自回归模型具有非常大的参数规模。GPT-3有1750亿个参数,而GPT-4o的参数规模据报道约为200B[28]。大规模参数使模型能够学习复杂的模式和表示。

OpenAI自回归模型的训练方法

OpenAI的自回归模型使用了大规模预训练和微调(Fine-tuning)的两阶段训练方法。

大规模预训练

在预训练阶段,模型在大规模的文本数据集上训练,以预测序列中的下一个词。对于图像生成,模型在大规模的图像-文本对数据集上训练,以预测图像的下一个部分。

微调与强化学习

在微调阶段,模型在特定任务的数据集上进行训练,以适应特定的应用场景。OpenAI还使用了强化学习与人类反馈(Reinforcement Learning from Human Feedback,RLHF)来训练模型,使其生成更符合人类偏好的内容。

模型并行与数据并行

为了训练大规模模型,OpenAI使用了模型并行和数据并行技术。模型并行将模型分割成多个部分,分布在不同的GPU上;数据并行将训练数据分割成多个批次,分布在不同的GPU上。这两种技术结合使用,可以显著提高训练效率。

4. 自回归模型技术在ChatGPT-4o中的应用

ChatGPT-4o概述

ChatGPT-4o是OpenAI的对话模型,结合了GPT-4o语言模型和图像生成功能。GPT-4o的图像生成功能是一个自回归模型,通过多次通过来逐像素地生成图像,而不是像扩散模型那样执行去噪步骤[6]。

自回归模型在文本生成中的应用

在文本生成中,GPT-4o使用自回归模型来生成连贯且上下文相关的文本。模型从一个初始的词或短语开始,逐步预测下一个词,直到生成完整的文本序列。这种方法使模型能够生成流畅、连贯的文本,适应各种语言风格和语境。

自回归模型在图像生成中的应用

在图像生成中,GPT-4o使用自回归模型来生成遵循给定文本提示的图像。与传统的图像生成模型(如DALL·E,使用扩散模型)不同,GPT-4o的图像生成功能是一个自回归模型,逐像素或逐块生成图像[36]。

具体来说,GPT-4o将图像离散化为token,再一块一块按顺序生成图像[39]。模型通过联合训练文本、图像和声音数据,实现跨模态的深度关联[44]。

自回归模型在多模态对话中的应用

在多模态对话中,GPT-4o能够处理文本、音频和视频输入,并生成相应的文本、音频或图像输出。这种多模态能力使模型能够更自然地与人类交互,适应不同的沟通方式和需求。

自回归模型在图像编辑中的应用

GPT-4o的图像生成功能擅长准确渲染文本,精确遵循提示词,并利用GPT-4o固有的知识库和聊天上下文——包括转换上传的图像或将其用作视觉灵感[35]。这意味着用户可以通过简单的文本指令来编辑和修改图像,而不需要专业的图像编辑工具或技能。

自回归模型在实时音频生成中的应用

GPT-4o实时音频补全旨在从音频或文本提示生成音频,因此非常适合生成音频书籍、音频内容和其他需要音频生成的用例[62]。这种实时音频生成能力使模型能够更自然地与人类交互,适应不同的沟通方式和需求。

5. 自回归模型vs扩散模型

两种模型的基本原理

自回归模型

自回归模型是一种生成模型,它通过预测序列中的下一个元素来生成内容。在文本生成中,模型通过预测下一个词来生成文本;在图像生成中,模型通过预测下一个像素或图像块来生成图像。这种模型被称为自回归模型,因为它们是对自己执行回归。

扩散模型

扩散模型是一类生成模型,其通过迭代去噪过程将高斯噪声转换为已知数据分布的样本,生成的图片具有较好的多样性和写实性[45]。扩散过程逐步向原始图像添加高斯噪声,是一个固定的过程,而反向过程则逐步去噪,从噪声样本中恢复原始图像。

两种模型的数学表示

1)自回归模型的数学表示

自回归模型可以用以下公式表示:

p(x_1, x_2, …, x_T) = ∏_{t=1}^T p(x_t | x_1, x_2, …, x_{t-1})

其中,p(x_1, x_2, …, x_T)是整个序列的联合概率分布,p(x_t | x_1, x_2, …, x_{t-1})是给定前t-1个元素的条件下,第t个元素的条件概率。

2)扩散模型的数学表示

扩散模型可以用以下公式表示:

p_0(x_0) = p(x_0)(数据分布)

q(x_t | x_{t-1}) = N(x_t; sqrt{1 – β_t} x_{t-1}, β_t I)(前向过程)

p(x_{t-1} | x_t) ≈ N(x_{t-1}; (x_t – β_t σ_t^2 ε(x_t, t)) / sqrt{1 – β_t}, σ_t^2 I)(反向过程)

其中,x_0是原始数据,x_1到x_T是添加不同水平噪声后的样本,β_t是噪声系数,ε是学习的噪声预测网络。

两种模型的优缺点对比

自回归模型的优势

-

简单直观:AR模型的魅力在于其简洁明了的预测逻辑:仅依据时间序列以往的观测值来预测未来趋势,概念直观,易于理解和实施[2]。

-

适应性强:自回归模型能够适应各种类型的数据,从文本到图像再到音频,只要数据能够被表示为序列形式。

-

训练效率高:自回归模型的训练过程相对简单,可以使用标准的深度学习训练方法,如随机梯度下降。

-

生成质量好:在许多任务中,自回归模型能够生成高质量的内容,尤其是在文本生成领域。

自回归模型的劣势

-

计算复杂度高:自回归模型的训练和推理过程需要大量的计算资源,尤其是对于大规模模型。

-

生成速度慢:由于生成过程是序列化的,自回归模型的生成速度相对较慢。

-

难以处理全局依赖关系:自回归模型从左到右的建模方式限制了模型在处理需要全局依赖关系的任务中的表现。

-

模式崩溃:在某些情况下,自回归模型可能会生成重复的模式或陷入循环。

扩散模型的优势

-

生成质量高:扩散模型可以生成非常逼真的图像,尤其是在细节和写实性方面。

-

多样性好:扩散模型可以生成多样化的样本,避免模式崩溃问题。

-

并行化生成:扩散模型的生成过程可以部分并行化,提高生成速度。

-

灵活性高:扩散模型可以处理各种类型的生成任务,从图像生成到音频生成再到视频生成。

扩散模型的劣势

-

训练复杂:扩散模型的训练过程相对复杂,需要学习噪声预测网络。

-

采样速度慢:扩散模型的生成过程需要多次迭代去噪,采样速度相对较慢。

-

计算资源需求高:扩散模型的训练和推理过程需要大量的计算资源。

-

难以处理序列数据:扩散模型在处理文本等序列数据时可能不如自回归模型有效。

两种模型在不同任务中的表现

文本生成

在文本生成任务中,自回归模型是主流选择,因为文本是天然的序列数据,自回归模型可以很好地捕捉文本中的上下文关系和长距离依赖。OpenAI的GPT系列模型在文本生成任务中表现出色,能够生成流畅、连贯的文本,适应各种语言风格和语境。

扩散模型在文本生成任务中的应用相对较少,主要是因为文本是序列数据,而扩散模型更适合处理图像等非序列数据。然而,最近的研究表明,扩散模型也可以用于文本生成,通过将文本表示为向量空间中的点,然后通过扩散过程生成新的文本向量。

图像生成

在图像生成任务中,扩散模型是主流选择,因为图像中的像素之间存在复杂的依赖关系,而扩散模型可以通过逐步去噪来捕捉这些依赖关系。OpenAI的DALL·E模型就是一个基于扩散模型的图像生成模型,能够生成高质量、多样化的图像。

自回归模型在图像生成任务中的应用相对较新,OpenAI的GPT-4o是一个例外,它使用自回归模型进行图像生成。GPT-4o将图像离散化为token,再一块一块按顺序生成图像[39]。这种方法的优势是生成过程更加直观,可以更好地控制生成结果,遵循用户的指令。

多模态生成

在多模态生成任务中,自回归模型和扩散模型都可以发挥作用。自回归模型可以处理文本、音频和视频等多种模态,通过将它们表示为序列数据来生成内容。GPT-4o就是一个例子,它能够处理文本、音频和视频输入,并生成相应的文本、音频或图像输出。

扩散模型在多模态生成任务中的应用也在不断探索,通过将不同模态的数据表示为向量空间中的点,然后通过扩散过程生成新的多模态向量。这种方法的优势是能够捕捉不同模态之间的复杂关系,生成更加自然、真实的多模态内容。

两种模型的技术挑战

自回归模型的技术挑战

-

计算复杂度:自回归模型的训练和推理过程需要大量的计算资源,尤其是对于大规模模型。

-

序列处理:处理像图像这样的非序列数据需要将它们转换为序列,这可能不直观且低效。

-

生成速度:自回归生成是序列化的,这可能比其他方法如扩散模型更慢。

-

多样性:自回归模型可能不如扩散模型多样化,因为它们在每个步骤都依赖于前一个生成。

扩散模型的技术挑战

-

训练复杂性:扩散模型的训练过程相对复杂,需要学习噪声预测网络。

-

采样速度:扩散模型的生成过程需要多次迭代去噪,采样速度相对较慢。

-

计算资源需求:扩散模型的训练和推理过程需要大量的计算资源。

-

难以处理序列数据:扩散模型在处理文本等序列数据时可能不如自回归模型有效。

两种模型的未来发展趋势

自回归模型的未来发展趋势

-

更高效的训练方法:开发更高效的训练方法,减少计算资源需求。

-

更好的数据表示:探索更好的数据表示技术,以提高生成质量。

-

结合其他模型的优势:结合自回归模型与其他模型(如扩散模型、流模型)的优势,开发更强大的生成模型。

-

扩展应用领域:探索自回归模型在新领域中的应用,如蛋白质设计、药物发现等。

扩散模型的未来发展趋势

-

更高效的采样方法:开发更高效的采样方法,提高生成速度。

-

更灵活的模型结构:开发更灵活的模型结构,适应不同类型的生成任务。

-

结合其他模型的优势:结合扩散模型与其他模型(如自回归模型、流模型)的优势,开发更强大的生成模型。

-

扩展应用领域:探索扩散模型在新领域中的应用,如分子生成、3D建模等。

6. 自回归技术的挑战与展望

当前自回归技术面临的挑战

计算复杂度

自回归模型的训练和推理过程需要大量的计算资源,尤其是对于大规模模型。随着模型规模的不断扩大,计算复杂度也在不断提高,这给模型的训练和部署带来了巨大挑战。OpenAI的GPT-4o拥有约200B的参数规模[28],这需要大量的计算资源来训练和推理。

序列处理

处理像图像这样的非序列数据需要将它们转换为序列,这可能不直观且低效。在图像生成中,自回归模型需要将图像离散化为token,再一块一块按顺序生成图像[39]。这种转换过程可能会丢失一些空间信息,影响生成质量。

生成速度

自回归生成是序列化的,这可能比其他方法如扩散模型更慢。在实时应用中,生成速度是一个重要的考虑因素。虽然自回归模型的生成过程相对简单,但由于是序列化的,整体生成时间仍然较长。

多样性

自回归模型可能不如扩散模型多样化,因为它们在每个步骤都依赖于前一个生成。这意味着自回归模型可能会生成重复的模式或陷入循环,尤其是在处理复杂的生成任务时。

模式崩溃

在某些情况下,自回归模型可能会生成重复的模式或陷入循环。这被称为模式崩溃问题,是自回归模型的一个常见挑战。模式崩溃会导致生成内容的多样性和质量下降,影响模型的实用性。

自回归技术的未来展望

更高效的训练方法

为了应对计算复杂度的挑战,研究人员正在开发更高效的训练方法,如模型并行、数据并行和混合精度训练。OpenAI在训练GPT-3时使用了模型并行和张量并行技术,使训练效率提高了76%[73]。未来,随着分布式训练技术的不断发展,训练效率将进一步提高。

更好的数据表示

为了应对序列处理的挑战,研究人员正在探索更好的数据表示技术,如图像的分块表示、多尺度表示等。在图像生成中,GPT-4o将图像离散化为token,再一块一块按顺序生成图像[39]。未来,随着表示学习技术的发展,数据表示将更加高效,生成质量将进一步提高。

结合其他模型的优势

为了应对生成速度和多样性的挑战,研究人员正在探索结合自回归模型与其他模型(如扩散模型、流模型)的优势,开发更强大的生成模型。例如,一些研究提出了自回归与扩散模型的结合方法,如DART(Denoising Autoregressive Transformer)[47]。未来,这种混合模型可能会成为生成式AI的主流选择。

扩展应用领域

随着自回归技术的不断发展,其应用领域也在不断扩大。除了文本生成和图像生成,自回归模型还被应用于蛋白质设计、药物发现、分子生成等领域。例如,在蛋白质设计中,自回归模型可以预测蛋白质的三维结构;在药物发现中,自回归模型可以生成新的药物分子。未来,自回归技术将在更多领域发挥重要作用。

可解释性与可控性

为了提高自回归模型的可解释性和可控性,研究人员正在探索各种技术,如注意力可视化、中间特征分析等。在ChatGPT-4o中,图像生成功能能够精确遵循提示词,精确遵循用户指令[35]。未来,随着可解释性技术的发展,自回归模型将更加透明和可控,用户可以更好地理解和控制生成过程。

7. 总结

本研究报告深入探讨了OpenAI自回归模型的技术原理、实现方法及其在生成式AI领域的应用。通过系统性地研究OpenAI的自回归模型技术,我们对生成式AI的核心技术有了更深入的了解。

自回归模型是一种简单而强大的生成模型,通过预测序列中的下一个元素来生成内容。OpenAI的自回归模型技术经历了从GPT-1到GPT-4o的不断发展,每一代模型都在规模、性能和应用范围上取得了显著突破。GPT-4o作为一个全能型多模态模型,能够处理文本、音频和视频输入,并生成相应的文本、音频或图像输出,展示了自回归模型的强大能力。

在ChatGPT-4o中,自回归模型被用于文本生成、图像生成和多模态对话,展示了其在各种任务中的灵活性和有效性。与扩散模型相比,自回归模型具有简单直观、适应性强、训练效率高等优势,但也面临计算复杂度高、生成速度慢、难以处理全局依赖关系等挑战。

未来,自回归技术将继续发展,通过更高效的训练方法、更好的数据表示、结合其他模型的优势等手段,克服当前的挑战,拓展应用领域。同时,随着可解释性与可控性技术的发展,自回归模型将更加透明和可控,为生成式AI的应用带来更广阔的空间。

随着这些技术的不断发展,自回归模型在人工智能的各个领域将继续发挥重要作用,推动生成式AI技术的不断进步。

参考文献

[0] 什么是自回归模型 – IBM

https://www.ibm.com/cn-zh/think/topics/autoregressive-model

[2] 自回归模型的优缺点及改进方向原创 – CSDN博客

https://blog.csdn.net/DeepAIedu/article/details/138710833

[4] 8.1. 序列模型— 动手学深度学习2.0.0 documentation

https://zh.d2l.ai/chapter_recurrent-neural-networks/sequence.html

[6] GPT-4o图像生成的秘密,OpenAI 没说,网友已经拼出真相?

https://finance.sina.com.cn/tech/roll/2025-03-29/doc-inerhvut0518717.shtml

[20] GPT-3论文解读 – 知乎专栏

https://zhuanlan.zhihu.com/p/613693427

[25] [2303.08774] GPT-4 Technical Report – arXiv

https://arxiv.org/abs/2303.08774

[28] 微软论文意外”走光”,OpenAI参数全泄密,GPT-4o仅200B,o1 300B

https://m.36kr.com/p/3105061493640705

[35] GPT-4o原生图像生成上线,P图、生图也就一句话的事! – 知乎专栏

https://zhuanlan.zhihu.com/p/32838823943

[36] GPT-4o图像生成的秘密,OpenAI 没说,网友已经拼出真相? | 机器之心

https://www.jiqizhixin.com/articles/2025-03-29-4

[39] ChatGPT-4o 更新:原生图像生成技术详解:自回归路线的逆袭 – 博客园

https://www.cnblogs.com/LexLuc/p/18798718

[44] OpenAI推出4o图像生成技术:多模态模型的实用化突破 – 知乎专栏

https://zhuanlan.zhihu.com/p/32761788489

[45] 文本生成图像工作简述4–扩散模型、自回归模型、生成对抗网络的….

https://blog.csdn.net/air__Heaven/article/details/128835719

[47] 自回归+扩散模型的图像生成模型 – 知乎专栏

https://zhuanlan.zhihu.com/p/3442569070

[62] Azure OpenAI 服务模型 – Learn Microsoft

https://learn.microsoft.com/zh-cn/azure/ai-services/openai/concepts/models

[64] GPT-4o简介| AI工具中文文档库

http://www.aidoczh.com/docs/openai_cookbook/examples/gpt4o/introduction_to_gpt4o

[72] GPT 系列模型技术演化之路 – 简单之美

http://shiyanjun.cn/archives/2749.html

[73] 细节对比:GPT系列模型的变化 – 知乎专栏

https://zhuanlan.zhihu.com/p/651154615.

(文:沃垠AI)