跳至内容

文| 黄莉玲

4月15日,抖音在北京举办“安全与信任中心开放日”活动,相关业务负责人就抖音算法原理、平台治理体系以及社会关切的问题,展开了详细介绍。

在信息爆炸时代,推荐算法成为人类与巨量信息相处的主流解决方案。开放日上,抖音算法工程师刘畅讲解了算法原理和抖音算法的特点。

据他介绍,抖音基于用户行为的推荐方法包含多种技术模型,如协同过滤、双塔召回、Wide&Deep模型等。算法可以在完全“不理解内容”的情况下,找到兴趣相似的用户,把其他人感兴趣的内容推荐给该用户。

目前,抖音算法已几乎不依赖对内容和用户打标签,而是通过神经网络计算,预估用户行为,计算用户观看这条内容获得的价值总和,把排名靠前的内容推给用户。

刘畅提到,为引导算法打破“信息茧房”,抖音算法在多目标建模体系下,设置了专门的探索维度。

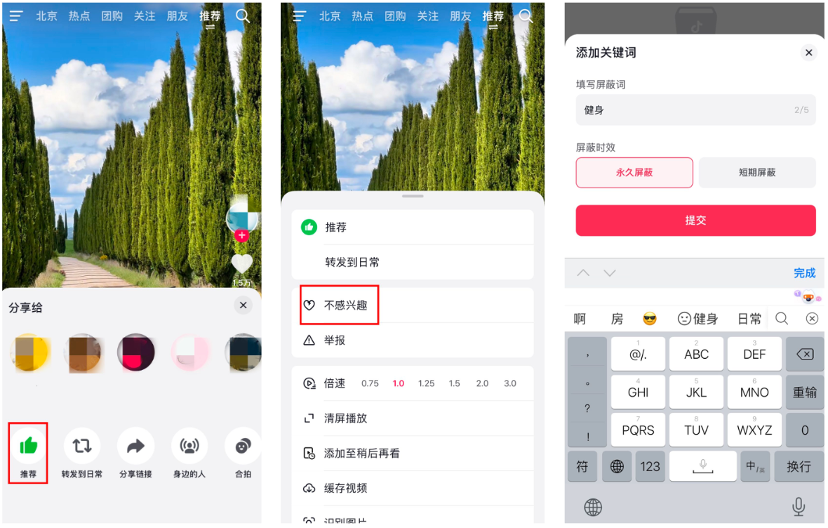

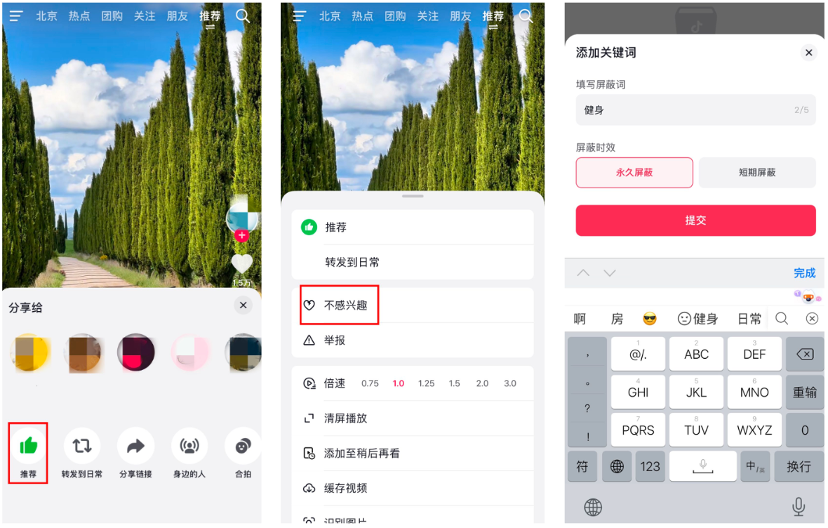

一是对用户在平台上已经表现出的兴趣,尽可能推荐更多样的内容,通过多样性打散、多兴趣召回、扶持小众(长尾)兴趣等方法控制相似内容出现的频次。二是帮助用户探索更多新兴趣,采用随机推荐、基于用户社交关系拓展兴趣、搜索推荐联动、“不感兴趣”不再展现等多种方式,让用户的主动行为影响推荐系统,使推荐更加个性化和多样化。

不过,算法能学习和预估用户行为,但因其无法理解内容语义,对内容的理解存在不足,可能导致违法违规、不良内容被推荐传播。因此,算法在真实使用场景中,必须由平台治理对其进行约束和规范。

对此,抖音生态运营经理陈丹丹表示,抖音的内容治理体系是“人工参与+机器学习”相结合的模式,并组建了专门的平台治理团队为算法设置“护栏”。

据悉,抖音平台治理体系包括异常感知、标准定义、机器识别、人工研判、风险处置等过程。治理流程秉持两大准则:首先是所有在平台发布的内容都会经过评估,流量越高的内容评估次数越多,标准也越严格。其次,抖音内容审核采用“人工+机器”相互配合的模式,“机器”负责“宽度”评估所有投稿,“人工”负责“深度”,确保专业、敏感或疑难等问题尽可能精准研判。

创作者将内容上传至抖音后,首先进入机器识别环节。如果内容被识别出含有高危特征,将被直接拦截;若未命中高危特征但模型判断有问题,则会送至人工审核;若问题概率较低,则获得基础流量进入下一环节。视频被举报、评论区出现集中质疑、流量激增等情况出现,均可能触发“人工+机器”审核。一旦内容在任一环节被处置,系统会立即停止进一步推荐和分发。

值得注意的是,针对社会普遍关心的、对用户造成较多困扰的焦点问题,抖音成立了数个专项治理团队,针对诈骗、网暴、虚假摆拍、未成年人保护、网络水军、AIGC技术滥用等一系列重大专项风险进行治理。例如,在不实信息治理方面,抖音于近日上线了辟谣卡,遏制不实信息的传播。

南都记者了解到,未来抖音将推进各项举措,让算法更透明、治理更完善、服务更到位,并以安全与信任中心为依托,持续增加算法和治理透明度,回应社会关切的议题,主动公示违规案例治理情况,接受公众监督。

(文:AI前哨站)