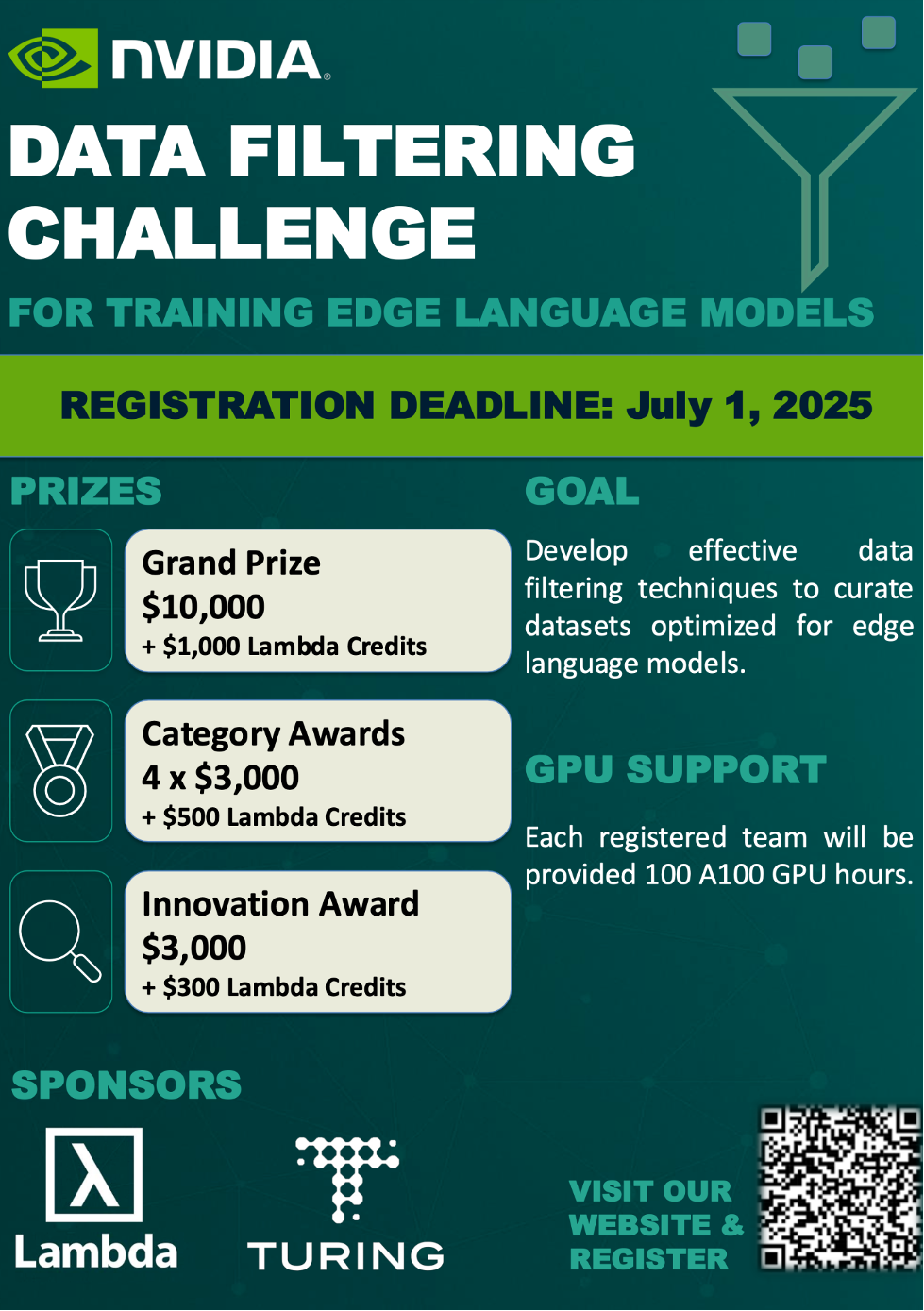

在大模型时代,数据质量决定了一切。但在资源受限的边缘设备上,高效的语言模型(Edge LMs)更是依赖于高质量的数据。如何在海量数据中筛选出最优子集,让小模型也能大放异彩?近日芯片巨头英伟达联合 Lambda Labs 以及 Turing.AI 举办「数据过滤挑战赛」(Data Filtering Challenge for Training Edge Language Models)直面这一问题。

亮点一:免费 GPU 算力,助你火力全开!

所有参赛者都可免费获得至少 100 小时的 A100 GPU 算力(换算价值约 $200),无需自备硬件,直接开炼! 只需专注于算法创新,NVIDIA 和Lambda 提供强力支持!

亮点二:丰厚奖金池,最高奖励 $10,000!

本次比赛共设立 $22,000+ 奖金,冠军团队可独揽 $10,000 现金奖励,并有机会获得额外的算力资源!此外,四大关键任务(角色扮演、函数调用、机器人任务规划、RAG)各有 $3,000 专项奖励,创新性最佳方案还能赢得 $3,000 创新奖!

亮点三:挑战数据过滤极限,定义下一代 Edge LMs!

参赛者需要设计数据过滤技术,优化数据集,并提升 DoRA 适配的 Edge LMs 在关键任务上的表现,包括:

角色扮演(Roleplay):交互式数字人、虚拟助手

函数调用(Function Calling):智能手机、IoT 设备

机器人任务规划(Robotics & Task Planning):自动化任务执行

检索增强生成(RAG):高效信息检索与知识整合

本次挑战提供 400M 规模的预训练 Transformer 模型,参赛者需要利用自研的过滤技术对数据进行优化,训练出更强大的 Edge LMs。最终排名将根据优化后模型的性能提升(Simprove – Sbase) 进行评定。

亮点四:技术影响力 + 行业曝光,直接对接 NVIDIA 研究团队!

优胜团队不仅能收获丰厚奖金,还将受邀与英伟达研究员合作,共同撰写技术报告,获得业界关注!此外,所有获奖数据集将开源共享,推动 Edge LMs 领域的发展。

关键时间线:

4月15日

发布 ELMB 评测基准、模型、起始代码、训练数据

5月15日

比赛正式开启,GPU 计算资源开放

9月1日

提交截止时间:9月1日

边缘智能,数据为王!

如何让小模型发挥大作用?

这是你的机会!

立即报名,赢取现金大奖,免费使用 A100 训练你的 Edge LM !

点击链接,开启你的数据过滤挑战之旅!

http://sites.google.com/view/datafilteringchallenge

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

(文:PaperWeekly)