欢迎回到 AI 科技大本营 2025 AI 前瞻周。万众瞩目的 OpenAI CEO 终于在这几天有了新动作。话不多说,我们直入正文。

整理丨Eric Harrington

出品丨AI 科技大本营(ID:rgznai100)

新年伊始不到一周,OpenAI 掌门人山姆·奥特曼(Sam Altman)就以他经典的“谜语式”社交媒体发言引发热议:“我一直想用六个单词写个故事:near the singularity; unclear which side. (临近奇点;不清楚是哪边)”

在评论区,奥特曼自己作出了两种具体的解读:

-

模拟宇宙假说:我们临近奇点,却无法判断自己是在奇点的哪一边(没准现在其实已经过了奇点,但还不自知)。

-

AI 发展的关键时刻:在人工智能发展的过程中,我们可能很难判断某个具体的时刻就是那个关键的转折点。

乍一看,是奥特曼又开始炒作了,所以知名深度学习反对论学者、OpenAI 头号黑子加里·马库斯也编了一个“反六字故事”来嘲讽奥特曼:“far from singularity; hype never dies. (远离奇点;炒作永不消逝)”

押韵了奥特曼的原文,评论区一下子就热闹了起来。

然而,这条“六字故事”发布不到 24 小时,奥特曼就发表了最新博客《反思录》(Reflections)来解释自己为什么认为“我们正处于奇点附近”。

他先是在文中回顾 ChatGPT 两周年历程:“我们一直知道,在某个时刻我们会达到一个临界点,AI 革命就此被引发。但我们不知道那一刻会是什么。出乎我们的意料,这个临界点其实就是 ChatGPT。这些年是我迄今为止最有收获、最有趣、最好、最疲惫、压力最大的年份。”

奥特曼在文中对接下来的方向一锤定音,他的原话是:“We are now confident we know how to build AGI as we have traditionally understood it.” (我们现在已经确信知道如何构建 AGI 了。)并且:“In 2025, we may see the first AI agents ‘join the workforce’ and materially change the output of companies.”(2025 年,我们可能会看到第一批 AI 智能体加入劳动力队伍,并实质性地改变公司的产出。)

然后在同一个时间段内,彭博社也发布了他们对奥特曼的最新独家专访。对话中,他不仅再次确认了 2025 这个时间点的重要性,还表示 AGI 可能会在本届总统任期内得到发展,也就是这四年内。

采访中奥特曼也回应了马斯克这段时间(或者是一直以来)和他充满火药味的关系:“我认为埃隆会继续起诉我们,撤销诉讼,提起新的诉讼,如此循环。他倒是还没有向我发起八角笼挑战,但事实证明,他也没有那么认真地对待扎克伯格。总之,我真心认为他不会滥用新获得的权力对付商业竞争对手,但结果也可能会证明我错了。”

他还给马斯克进行了一下「辟谣」:“在导致他离职的那场风波之前,我和埃隆之间没有发生过什么大争吵。在那之前,很多人都说他会如何斥责别人、如何发脾气,但至少我自己从未经历过这样的事情。”

对 OpenAI 的创立,奥特曼在彭博社采访和博客中给出了两种截然不同的陈述。博客中,他以正式的语气写道:“创立 OpenAI,是因为我们相信 AGI 是可能的,而且它可能是人类历史上最具影响力的技术。我们想弄清楚如何构建它并使其广泛受益;我们很高兴能尝试在历史上留下自己的印记。我们的抱负非常高,我们也相信这项工作可能会以同样非凡的方式造福社会。”

在采访中,奥特曼进行了更为真实、更具细节的叙述。“每个人都想要一个干净整洁的故事,而在某个特定时刻,某件事情就这样发生了。保守估计,那一年(2015 年)我们至少有 20 次 ‘创始人晚餐’,之后其中一次被写入史册,每个人都在谈论那一次。”

“但对我个人来说,最重要的一次会面是在 Mountain View 的 Counter 餐厅,只有我和 Ilya(OpenAI 联合创始人 Ilya Sutskever)两个人。”

如今的读者都知道,人称“ChatGPT 之父”的 Ilya 后来在 2023 年底的“政变”中曾参与解除奥特曼的 CEO 职务,随后又对这个决定表示后悔,最终在 2024 年 5 月离开了公司。

但在还原历史现场时,奥特曼的记忆中只有那个意气风发的年轻天才:“我一直对 AI 很感兴趣,早在本科时就学习过这个。2012 年,当 Ilya 和其他人做出 AlexNet 后,我一直在关注项目进展。我心想,天哪,深度学习看起来是真的,而且它似乎是可扩展的。这是一件大事。该有人做点什么了。”

在 2014 年,谈论 AGI 还是一件相当前卫的事。“人们都不敢和我说话,因为我一开始就在说自己想设立一个 AGI 项目。这是一种,就像可以毁掉你职业生涯的事情。”

“所以我在一次会议上 ‘跟踪’ Ilya,”他笑着说,“在走廊里拦住了他,我们聊了聊。我向他诉说了我的想法,并约定见面吃晚餐。在我们的第一次晚餐上,他阐述了我们如何构建 AGI 的战略。”

“我们相信深度学习,我们相信一种特定的技术方法来实现它,以及一种将研究和工程结合在一起的方式——令我难以置信的是,这个方法效果如此之好。”

对于初期的 OpenAI,奥特曼其实并非全职工作(他当时还是“硅谷加速器”Y Combinator 的总裁)。“我当时有一份工作,所以一开始我做得很少,然后随着时间的推移,我越来越爱上了它。到 2018 年,我已经完全沉迷于 OpenAI。”

在最新的博客中,奥特曼坦言那是 OpenAI 历史上最有趣的时期:“能够亲身参与到我认为将成为历史上最伟大的科学发现时期之一,相对于它对世界的影响而言,这是一次千载难逢的经历。如果你非常幸运的话。如果你极其幸运的话。”

2019 年,奥特曼正式接任 OpenAI CEO。“我试图同时接管 OpenAI 和 Y Combinator,这真的很难。但我就是被这个想法迷住了,我们真的要构建 AGI 了。有趣的是,最初我猜测我们会在 2025 年做到这一点,但这个预测其实没有任何依据,我只是在 2015 年的时候预测了十年后会实现 AGI。”

在采访中,奥特曼首次披露了 ChatGPT 发布前的内部争议。“公司其他人都在说,‘为什么你要让我们现在就发布这个?这个决定太糟糕了。它还没准备好。’”

“但我知道它会做得很好。”

事实上,最初的 ChatGPT 连名字都没确定。“OpenAI 是一个风格很安静的研究实验室,我们当时将它暂时命名为 ‘Chat With GPT-3.5’——我们在研究方面做得很好,但在起名字方面就不行了。我们一直在观察人们使用 API Playground 功能的体验,并发现开发者真的很喜欢与模型对话。我们认为围绕这种体验建立一个演示将向人们展示关于未来的重要东西,并帮助我们使我们的模型变得更好、更安全。”

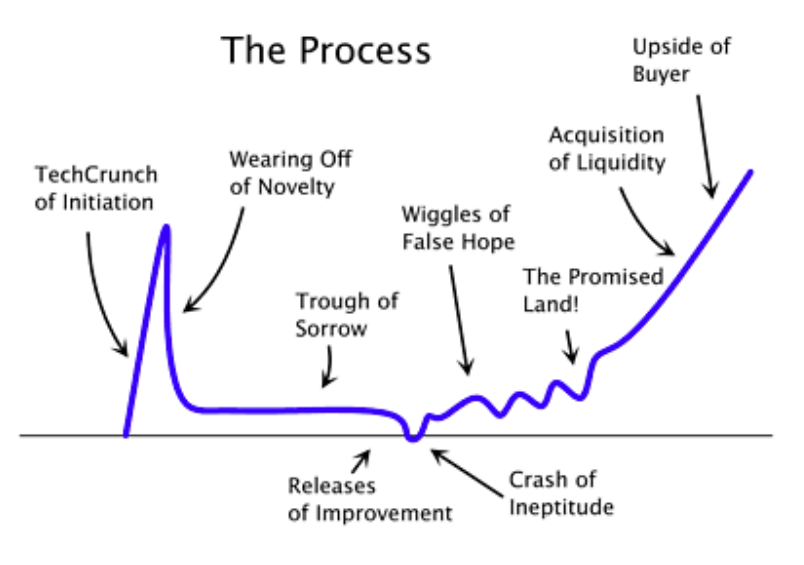

“Y Combinator 有一张著名的图表,保罗·格雷厄姆(Paul Graham,Y Combinator 创始人,人称硅谷教父)经常画,”奥特曼说,“图中先是潜力的波动,然后是新鲜感的消退,紧接着会有一个长期的低谷,然后才是真正的产品市场匹配(PMF, Product Market Fit),最终起飞。”

“在发布的前几天,当 ChatGPT 运行时,白天的使用量会增加,晚上会减少。团队说 ‘哈哈哈,它在下降。’ 但在 YC,我学到了一件事,如果每次出现新的低谷都高于之前的峰值,那就说明正在发生非常不同的事情。在前五天就是这样,我想我们手上有一些我们还不了解的东西。”

在博客中,奥特曼同样用“曲线”来诠释 ChatGPT 产生的影响:“ChatGPT 的推出开启了一条前所未有的增长曲线——在我们公司、行业乃至全世界。我们终于看到了我们一直希望从人工智能中得到的巨大好处,而且我们可以看到很快还会有更多的好处。”

“这引发了一场疯狂的争夺,”奥特曼在采访中继续说道,“我们必须获得大量的算力——当时我们没有——因为我们推出时没有商业模式或商业模式的想法。我记得那年 12 月的一次会议,我说 ‘我会考虑任何关于我们如何为此付费的想法,但我们不能继续下去。’ 当时的所有想法都不够好,所以我们最终决定试一试订阅制,之后的事情之后再说。”

“一年多前的一个星期五,那天最不顺心的事就是我在视频电话中被突然解雇,然后我们挂断电话后,董事会就发布了一篇关于此事的博客文章。当时我在拉斯维加斯的一间酒店房间里。那种感觉几乎无法用语言描述,就像一场梦境破灭了。”

在彭博社采访中,奥特曼首次完整复盘了 2023 年 11 月 17 日那个改变 OpenAI 命运的下午。“我不认为我是一个高情商的人,但即使对我来说,这也超出了我能察觉到的紧张程度的界限。我们一直在讨论安全与能力之间的平衡,董事会的角色以及如何平衡这些东西。所以我知道,公司内部存在着紧张的关系。”

从那个中午开始,OpenAI 陷入了一场前所未有的危机。”很多烦人的事情在那个第一个周末发生。我对那段时间的记忆——我可能会记错细节——他们在周五中午开除了我。周五晚上,其他很多人辞职了。到周五深夜,我想的是,要不就从头开始一个新的 AGI 项目吧——当天晚些时候,一些高管拉住了我说,‘我们认为这个问题可能会解决。冷静点,等等。’ “

“周六早上,两位董事会成员打电话来,想谈谈让我回来的事。我一开始很生气,说不。后来我发现自己真的很在乎这里。所以我给出了条件——只有在整个董事会辞职的情况下,我才会回去。”

在博客中,奥特曼以一种更深思熟虑的口吻回顾了这一事件:“在我看来,这是一次善意的人(包括我自己)所犯下的重大治理失败。回过头来看,我当然希望我能做得不同,我愿意相信今天的我比一年前是一个更好、更深思熟虑的领导者。”

“这也让我学到了一个重要的教训:一个具有多元观点和丰富经验的董事会对于管理复杂挑战的重要性。良好的治理需要大量的信任和信誉。” 他特别感谢了两位关键人物的帮助:“Ron Conway(天使投资人,外号“互联网教父”)和 Brian Chesky(Airbnb 首席执行官)的付出远远超出了责任的要求,我甚至不知道如何描述。如果没有他们的帮助,我相当确信 OpenAI 会分崩离析。他们连续几天昼夜不停地工作,直到事情解决。”

“在整个过程中,他们保持冷静,有清晰的战略思维和出色的建议。他们阻止我犯下几个错误,而他们自己没有犯任何错误。他们为所需的一切利用了他们庞大的人脉网络,能够驾驭许多复杂的情况。我相信他们还做了很多我不知道的事情。但我最记得的,是他们的关心、同情和支持。”

宫斗之后,OpenAI 内部的工作方式已经彻底不同。当被记者问到具体的工作流程时,奥特曼说:“让我先打开我的日历……我们在周一进行三小时的管理层会议,然后,昨天和今天,六次与工程师一对一会谈。这次采访后,我要去研究会议。明天是一个有几个大型合作伙伴会议和很多计算会议的日子。有五个关于建立计算能力的会议。我有三个产品头脑风暴会议,之后还有一个与一个主要硬件合作伙伴的重要晚餐。”

记者追问:“你会花很多时间进行内部和外部沟通吗?”

“内部交流要多得多,”奥特曼回答说,“我不是一个喜欢写鼓舞人心的电子邮件的人,但会有很多一对一、小组会议,然后在 Slack 上有很多交流。我是个重度 Slack 用户。你可以在细节中获得很多数据。我的意思是,没有什么比与小型研究团队开会更好的深度了。但在广度上,你真的可以通过这种方式获得很多。”

在经历了 2023 年底的危机之后,OpenAI 展现出了惊人的复原力。“我们都重新回到工作中去,而且是以一种更有凝聚力和积极性的方式,”奥特曼在博客中写道,“我为我们的专注感到非常自豪。我们做了一些迄今为止最好的研究。”

具体数据很能说明问题。“(ChatGPT)从每周大约 1 亿活跃用户增长到超过 3 亿。最重要的是,我们继续向世界推出人们似乎真正喜欢并能解决实际问题的技术。”

OpenAI 的研究部门也被搬到了离公司总部几英里外的另一栋大楼。当被问及是否有什么象征意义时,奥特曼回答说:“那只是物流、空间规划的问题。我们最终会同时搬进一个大园区。研究部门仍然会有自己的区域。保护研究的核心对我们的工作来说真的很关键。”

“保护它不受什么影响?”

“一家硅谷公司的正常发展方式是这样的:从一个产品公司起步,把它做得非常好。你建立起巨大的规模。随着规模扩大,收入增长自然会以百分比的形式放缓。在某个时候,首席执行官会有个想法,他或她要建立一个研究实验室,来提出一堆新想法并推动进一步增长。这在历史上成功过几次。著名的例子有贝尔实验室和施乐 PARC。但通常情况下不会成功——通常你会得到一个非常好的产品公司和一个非常糟糕的研究实验室。我们的情况正好相反——我们非常幸运,但这很容易淹没研究的魔力,所以我不打算让这种情况发生。”

在彭博社采访中,奥特曼透露了一个更重要的技术突破:“你知道 ARC-AGI 挑战吗?五年前,这个组织设立了一个奖项作为通往 AGI 的北极星。他们想要制定一个他们认为会非常困难的基准。我们的最新模型(o3)通过了这个基准。”

“五年来,这个基准一直没有被解决。他们说如果你能在这个基准上得到 85% 的分数,我们就认为这是 ‘通过’ 了。而我们的系统——完全开箱即用,没有任何微调,就能得到 87.5% 的成绩。我们有一系列被赋予希望的研究以及更好的模型即将推出。”

在芯片供应和计算能力方面,奥特曼也展现出充分的信心:“我们一直在努力解决整个供应链问题,所有的合作伙伴。我们有人为我们建造数据中心和制造芯片。我们有自己的芯片项目。我们与英伟达有着非常棒的合作关系。”

能源供应是实现 AGI 的另一个关键挑战。但奥特曼在采访中表示:“核聚变即将成功。很快就会有净增益核聚变的演示。然后就必须建立一个不会坏的系统、必须扩大规模、必须弄清楚如何建立工厂——建造很多工厂——关于这一点必须获得监管批准。总的来说,这将需要几年时间。但我预计 Helion(奥特曼投资的清洁能源初创公司)很快就会向你展示,核聚变是可行的。”

提及监管,在经历了“政变”风波后,OpenAI 对监管和安全的态度发生了显著变化。据彭博社报道,公司现在有多个安全委员会。

“有一点令人困惑的是——我们内部也对此很困惑——我们有许多不同的安全机构,”奥特曼在采访中解释道,“我们有一个仅限内部的安全咨询组(SAG),进行技术研究并提出意见;一个安全和安全委员会(SSC),它是董事会的一部分;还有与微软的部署安全委员会(DSB);我们正在试图弄清楚如何精简这三个安全机构。”

对于风险评估,奥特曼提出了一个三层框架:“我仍然保持着大致相同的短期、中期和长期风险评估。我仍然预计,在网络安全和生物方面,我们会看到严重的,或者可能严重的短期问题,需要缓解。长期来看,当你考虑一个真正拥有令人难以置信的能力的系统时,会有一些可能很难准确想象和建模的风险。”

但与此同时,他在采访中表达了一个坚定的信念:“我可以同时认为这些风险是真实的,也相信适当处理它们的唯一方法是推出产品并学习。”

在最新的博客中,他进一步阐述了这个理念:“我们为我们在研究和部署方面的记录感到自豪,并致力于继续推进我们在安全和利益共享方面的思考。我们继续相信,让 AI 系统安全的最好方法是通过迭代和渐进的方式将其释放到世界上,让社会有时间适应和共同进化,从经验中学习,并继续使技术更安全。”

“我们相信在安全和对齐研究方面成为世界领导者的重要性,并以真实世界应用的反馈来指导这项研究。我们现在确信知道如何构建 AGI。我们相信在 2025 年,我们可能会看到第一个 AI 智能体加入劳动力队伍,并实质性地改变公司的产出。我们持续相信将优秀的、迭代的工具放在人们手中,会带来优秀的、广泛分布的结果。”

“我们正开始将目标转向真正意义上的超级智能。我们喜欢我们目前的产品,但我们是为了光明的未来而来。有了超级智能,我们可以做任何其他事情。超级智能工具可以大大加速科学发现和创新,远远超出我们自己的能力。”

“这听起来像天方夜谭,这些话也确实有点疯狂。但我们并不介意——毕竟我们已经习惯了这种感觉。我坚信在未来几年里,大家终将看到我们所见到的未来。在确保安全的同时最大化普惠人类,这就是我们的使命。正因如此,OpenAI 注定不能是一家普通的公司。”

图灵奖得主杨立昆:统治欲望源于生存需求,而非智能水平,AI 不会有这种想法 | AI 2025

硅谷神预言家库兹韦尔:科技每年将为人类增加一年寿命,2032 年之后实现“倒流” | AI 2025

谷歌前 CEO 施密特:AI 将在今年获得“永久记忆”,2028 美国会耗尽能源储备 | AI 2025

IBM 八大专家预测:现代编程语言是给人类设计的,AI 需要类似汇编的原生语言 | AI 2025

Agent 炒作一年仍未落地,99% 不懂 AI 的人和剩下 1 % 产生了鸿沟 | AI 2025

(文:AI科技大本营)