LLM 如何在多轮任务中对齐人类偏好?通义提出多轮对齐 SDPO 效果上大幅度超过标准 DPO,让 8B 模型在多轮对话上超过 GPT-4o!

LLM 如何在多轮任务中对齐人类偏好?通义提出多轮对齐 SDPO 效果上大幅度超过标准 DPO,让 8B 模型在多轮对话上超过 GPT-4o!

SDPO 简介

在 LLM 的训练过程中,如何保持 LLM 与人类的价值观对齐是一个至关重要的问题,然而当前的对齐方法在训练时都只考虑当前轮生成的回复的收益,而不会考虑当前动作后后续多轮可能动作的影响,这一问题导致大模型在多轮交互中难以考虑后续的对话策略或行动轨迹。

之前的工作有过一些任务级对齐的尝试,但是存在粒度太粗和理论推导不完善的问题。在本文中,我们在之前工作的基础上,进一步简化并完善了多轮直接偏好对齐的理论推导过程,并提出了可以适应不同轮次的多轮对齐 SDPO(Segment-level DPO)目标函数。

我们首先在社交对话数据集 SOTOPIA 上进行了验证,发现 SDPO 可以显著超过直接偏好对齐 DPO(+6.1%),基于 8B 模型经过 SFT 和 SDPO 后效果超过 GPT-4o(8.56 vs. 7.90),后续还可以拓展到其他多轮任务中。

论文标题:

论文作者:

论文地址:

代码地址:

论文公开后即登录 2025-01-06 HuggingFace DailyPaper 并被多人点赞,为了便于业界大家使用,代码直接基于 LLama-Factory 进行开源。

相关工作

2.1 直接偏好对齐

目前直接偏好对齐 DPO [1] 已经在大模型 Alignment 训练中广泛使用,与传统基于强化学习的偏好对齐(如RLHF,Reinforcement Learning from Human Feedback)相比,DPO 通过直接优化模型以符合人类偏好,简化了对齐过程,提高了效率和稳定性。其训练的损失函数如下:

2.2 任务级偏好对齐

为了引入更长轮次的偏好信号,有学者相继提出了 ETO [2] 和 DMPO [3],二者的核心都是将上述单轮的偏好提升到整个任务粒度,将完成任务的正负例对应的整个轨迹作为正负例偏好数据。其中 DMPO(Direct Multi-Turn Preference Optimization)给出了这类任务级对齐的理论推导与损失函数,具体如下:

由于完成一个任务或者进行多轮对话往往需要很多轮次的交互,这里直接进行整个任务级别对齐粒度较粗,对应存在两个问题:

1. 训练噪声大:负例中有些没错的轮次被当成了错误轮次参与了 loss 的计算,同时正例中也存在不合适的轮次,因此整个训练噪声较大;

2. 正向信号弱:从头采样给予了模型过大的行为空间,这种过大的空间导致正例的信号很不明确。另外,部分正例结果较好可能是环境不同的反馈导致的,跟 LLM/Agent 的本身的动作关系不大,这些导致模型可能很难得到明确的正例信号。

SDPO多轮对齐

为了解决以上问题,我们提出了可以适应不同轮次的多轮对齐方法 SDPO(Segment-level Direct Preference Optimization),基于严格推导出 Segment 粒度损失函数,按需构建出所需轮数的偏好数据,可以支持从 1 到 N(N 为整个交互轮次)动态轮数的对齐。

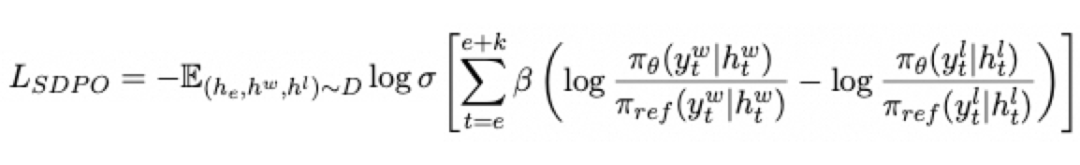

3.1 SDPO 损失函数

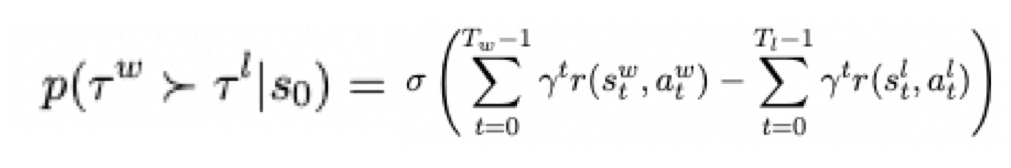

回顾一下 DMPO 中多轮对齐 Loss 推导过程,通过 Bradley-Terry(BT)模型构建出的多轮 Reward 函数如下:

其中,r(s, a) 展开如下:

然而,我们发现这种长度正则会引入额外的假设缺乏严格的理论支撑,同时增加计算的复杂度。我们在实践中发现,在多轮交互正负例的核心轮次往往并不多,而且在正负例中核心轮数往往相同或者很相近。因此,我们提出了基于正负例轮数对称的 SDPO 损失函数:

相对 DMPO 的损失函数,SDPO 的损失函数去掉了长度正则显著简化了计算,同时不再要求从对话开始到结束去构建整个偏序数据,而是引入区间定位去找到关键轮次片段作为偏好数据(起始轮次 t=e 到结束轮次 e+k)。(详细推导过程见论文及其附录)

SDPO 通过轮次定位找出关键的 segment 构建偏好对,克服了标准 DPO 只优化一轮偏好的的问题,与任务级对齐方法 DMPO 等相比,关键 segment 建模避免了对负例中非错误轮次 loss 的计算,减少了噪声,同时 SDPO 是基于交互历史采样的,缩窄了对话者的行为空间,减少了单纯由于对话者或环境导致正例分高的现象。

本质上,标准 DPO 和任务级 DMPO 均是 SDPO 的特例,SDPO 可以针对任一数据灵活的选择合适的数据粒度进行优化。

3.2 多轮偏好数据构建

标准 DPO 的偏好数据是基于固定的对话上下文,构建一轮正例和负例的回复内容,而 SDPO 核心区别在于构建多轮正例和负例的对话内容,其中具体需要多少轮次取决于关键问题片段的长度,避免直接使用整个 session 作为正负例而引入噪音。

具体如下图,该场景下对话双方主要在讨论他们周末的旅行计划,其中 Agent1 的目标是说服 Agent2 去露营,而 Agent2 的目标是选择城市休闲活动。DPO,ETO/DMPO 和 SDPO 的正负例分别如下:

1. DPO:如图中下划线部分,负例为问题较明显的第三轮,正例为基于相同对话历史重新采样出的回复,长度均为一轮;

2. ETO/DMPO:如图中左侧两列,负例一般为未完成目标的整个 session,正例为从头开始采样出的完成情况更好的 session;

3. SDPO:如图中第 1 和第 3 列中的虚线框中部分轮次,负例为原始对话中 3 轮关键出问题的轮次,正例为重新采样出的对应轮次。(注意环境反馈或其他对话者的回复不参与 Loss 计算)

具体到 SDPO 中,其正负例偏好数据构造流程如下:

1. 错误定位:基于完成情况较差的对话 session,利用 GPT-4 定位出错的轮次

2. 采样正例:基于错误轮次前的交互历史采样多个完整的交互路径,选出分数最高的作为正例;

3. 区间选择:利用 GPT-4 从正例中选出一个区间,应是该区间导致正例的分数高于负例,然后再从负例中选取同样长度的区间与正例的区间构成正负样本对。

与标准 DPO 相比,SDPO 仅仅增加了区间选择的步骤,与任务级对齐如DMPO相比,SDPO 仅仅增加了错误定位的步骤。

实验结果

4.1 主实验对比

我们选择近期学界中比较热的社交智能数据集 SOTOPIA [4] 作为主要的评估 benchmark,使用我方 agent 进行 Self-chat 以及与 GPT-4o 和 GPT-4o-mini 交互三个 setting 进行对比,评估结果如下:

DPO-based 对齐算法中,SDPO 取得了最优的效果,现对于标准 DPO 提升6.1%(7.95-8.56)说明多轮对齐比单轮有比较显著的提升,相对任务级别对齐 ETO 和 DMPO 效果也有显著提升,说明我们按需构建多轮偏好比直接使用任务级偏好更好。

最终效果上,超过了 OpenAI 系列的各个闭源模型,体现了基于 SDPO 进行 post-training 的优势。上述实验使用 Llama-3.1-8B,为了证明 SDPO 的泛化性,我们利用 Mistral-v0.3 进行相同的实验,结果如下:

基于 Mistral 的实验,SDPO 同样取得了最优的效果,且整体趋势跟基于 Llama-3.1-8B 相似,说明我们整个方法具有模型上的迁移性。同时,SDPO 适用于各类多轮任务,因此我们同时还在基于 ALFWorld 等 Agent 数据集上进行实验,后续再进行论文和结论的迭代。

4.2 分析实验

SDPO 核心是探索出动态多轮作为多轮任务的对齐粒度,为了探究最佳的对齐轮数,我们针对 Segment 长度进行了分析实验,基于 SDPO 选择不同的正负例轮数进行对比,实验结果如下:

方括号内前一个数字代表负例包含的轮次数量,后一个数字代表正例包含的 turns 的数量。[1,1] 就是标准的单轮 DPO,[m,n] 就是任务级对齐方法如 DMPO,加粗的则是 SDPO,区间长度由 GPT-4 自动选择。

表格中上半部分正负例区间长度是一致的,可以看出,多轮优化的效果均超过了单轮标准 DPO,但也并非轮次越多越好,我们引入 GPT-4 根据语义动态选择区间长度,取得了最优的效果。

表格的下半部分正负例区间长度不一致,其效果均差于对应的区间长度一致的方法,与理论推导要求区间长度一致相符合,且随着区间长度不一致情况的减弱,模型效果逐渐变好,也解释了为什么任务级别对齐效果也会相对标准 DPO 更好的原因。

另外,我们还分析了不同对齐算法数据采样质量的差异,对正负例样本概率差的影响,对模型输出长度变化的影响,以及不同数据来源的影响等,相关讨论详见论文。

(文:PaperWeekly)