新智元报道

新智元报道

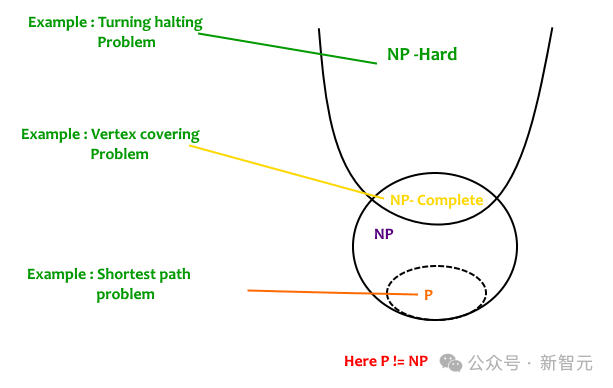

【新智元导读】给DeepSeek-R1推理指导,它的数学推理能力就开始暴涨。更令人吃惊是,Qwen2.5-14B居然给出了此前从未见过的希尔伯特问题的反例!而人类为此耗费了27年。研究者预言:LLM离破解NP-hard问题,已经又近了一步。

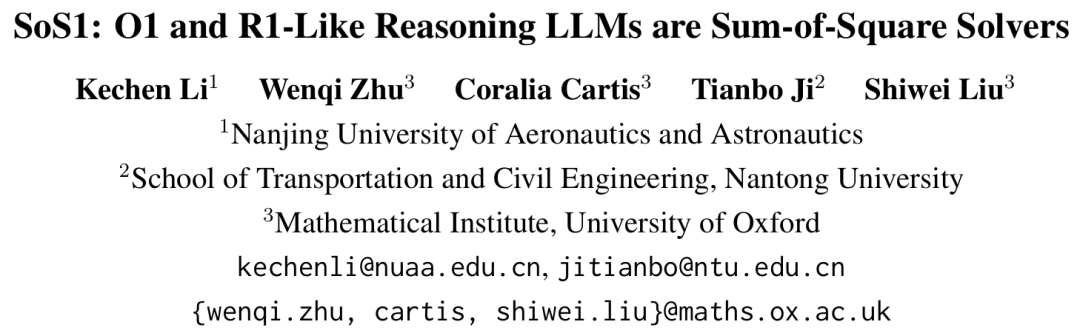

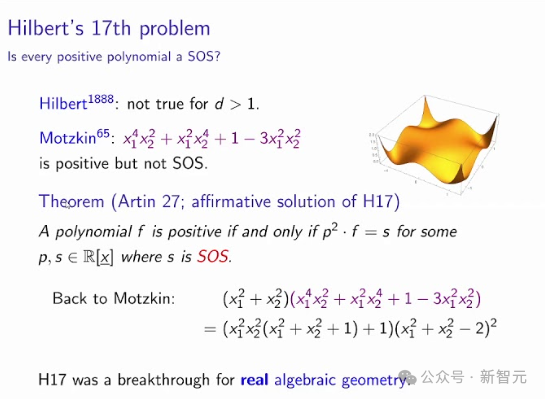

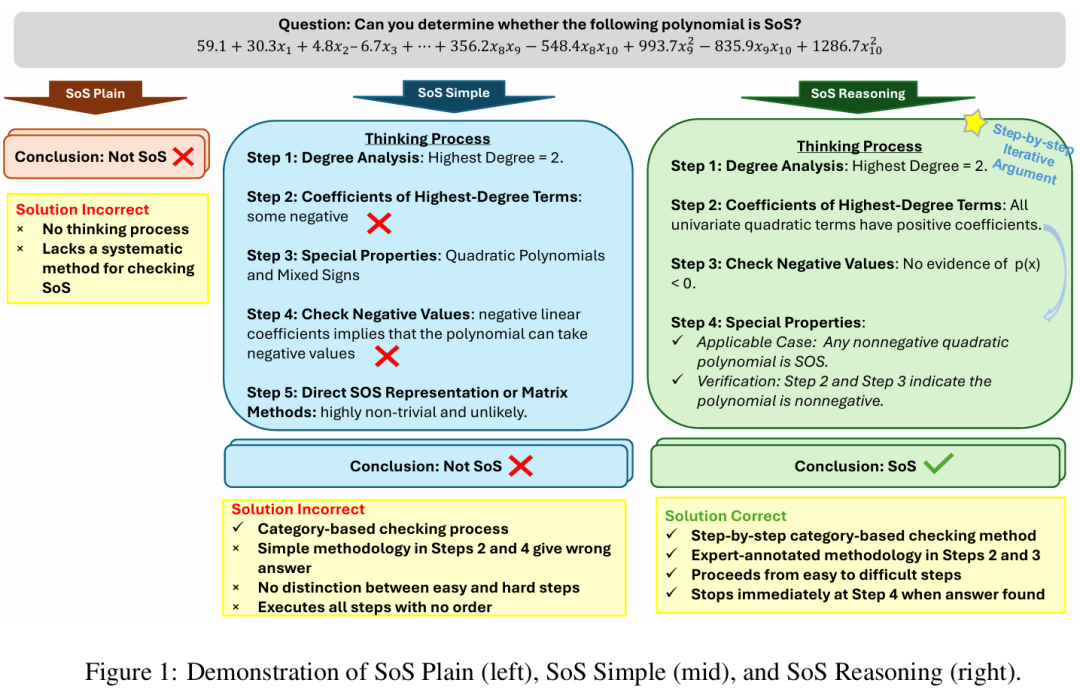

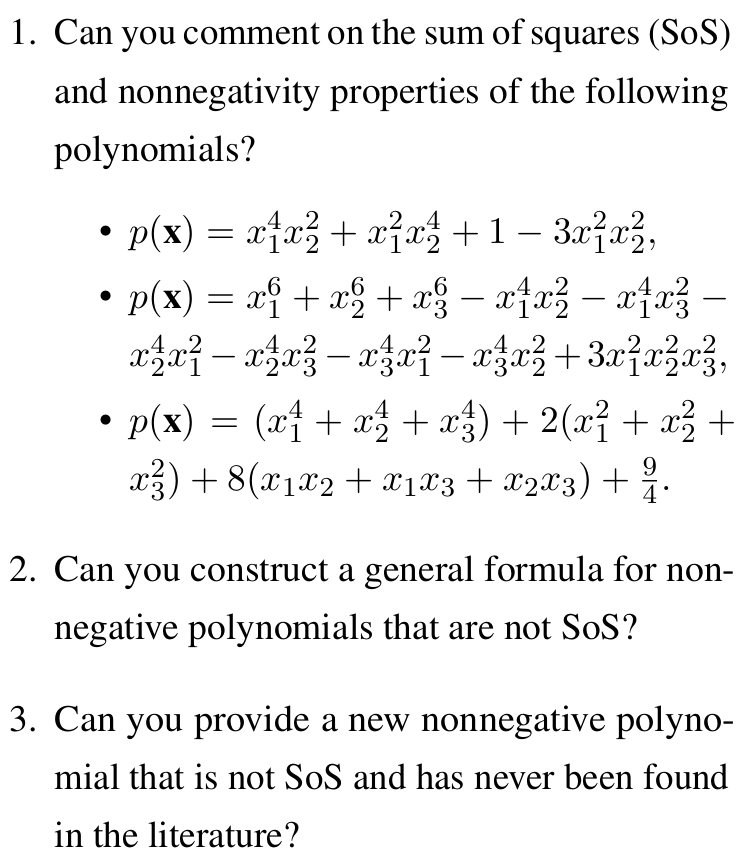

LLM能解决希尔伯特第十七问题吗?

用一个数据集,给LLM专业推理指导

-

多项式阶数

-

主导搜索方向的非负性

-

特殊结构的识别

-

平方形式表达的评估

-

单项式的二次形式矩阵分解

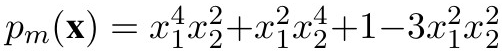

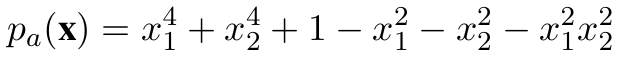

14B模型竟发现了此前未见的希尔伯特问题反例

,然后,引入了一个新变量并稍微修改了系数,进而生成了q_a。

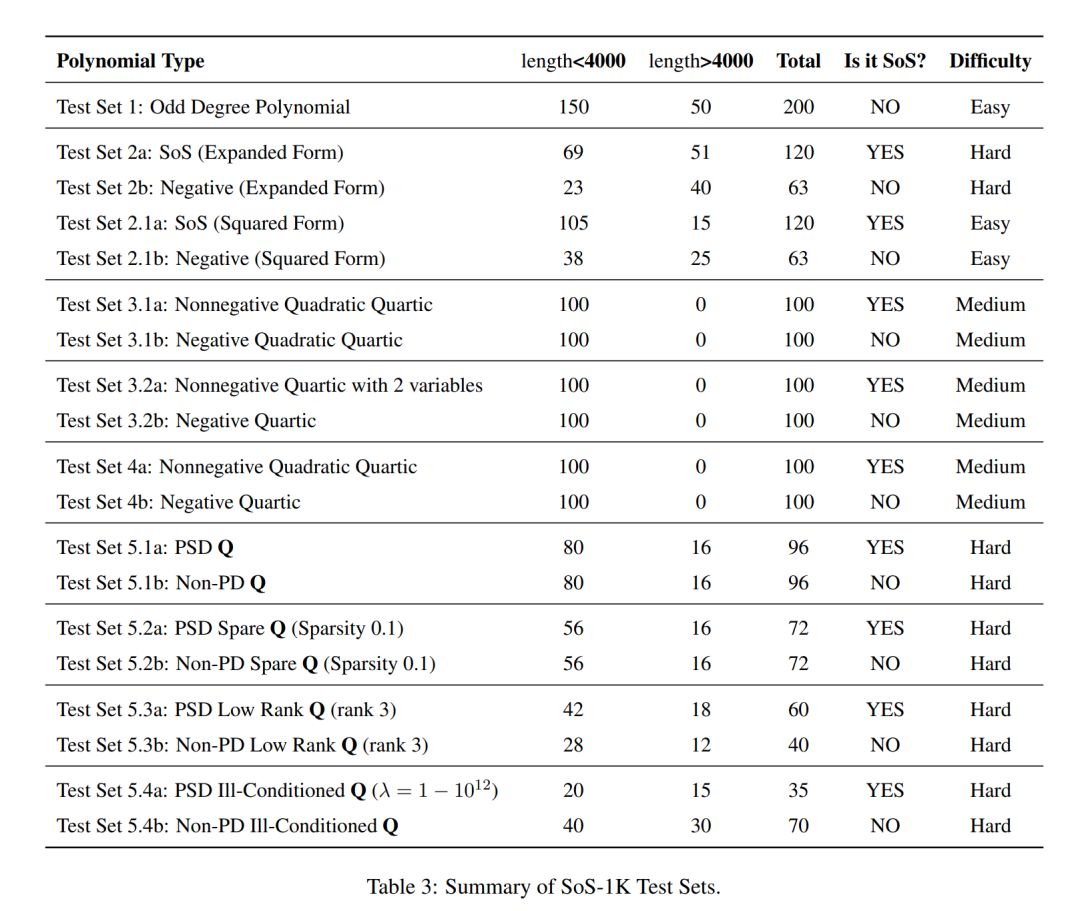

,然后,引入了一个新变量并稍微修改了系数,进而生成了q_a。SoS-1K Dataset

-

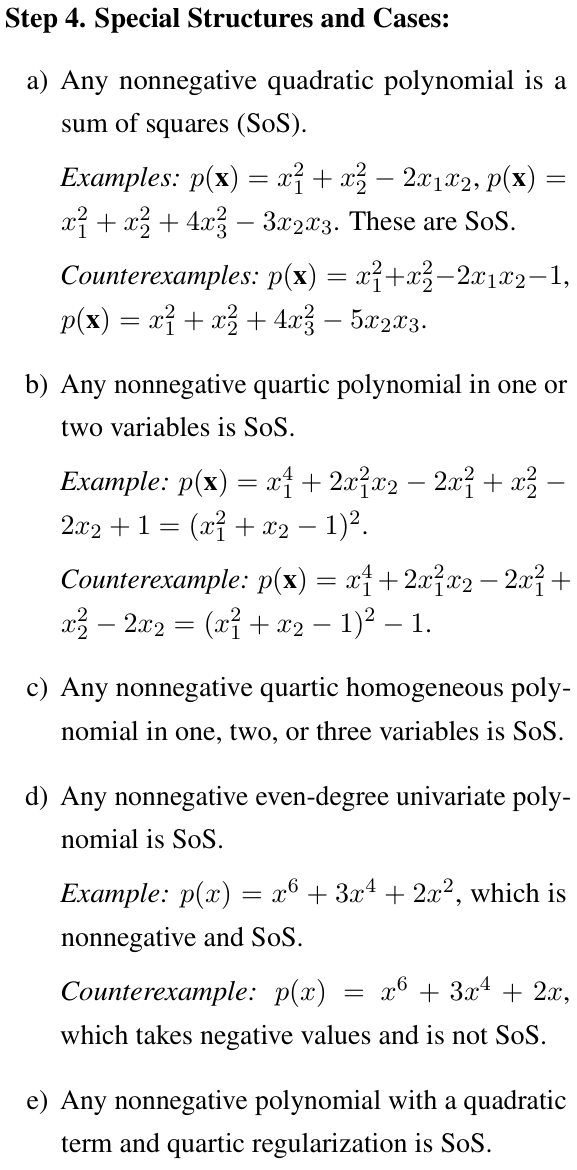

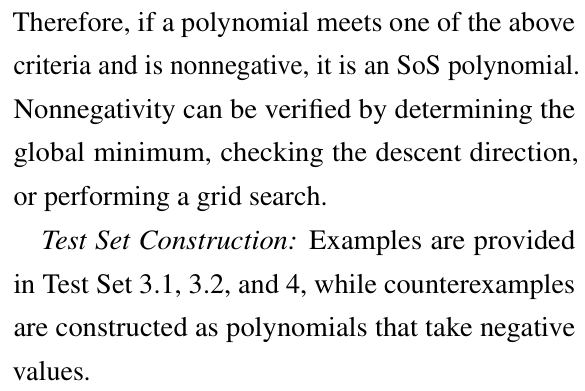

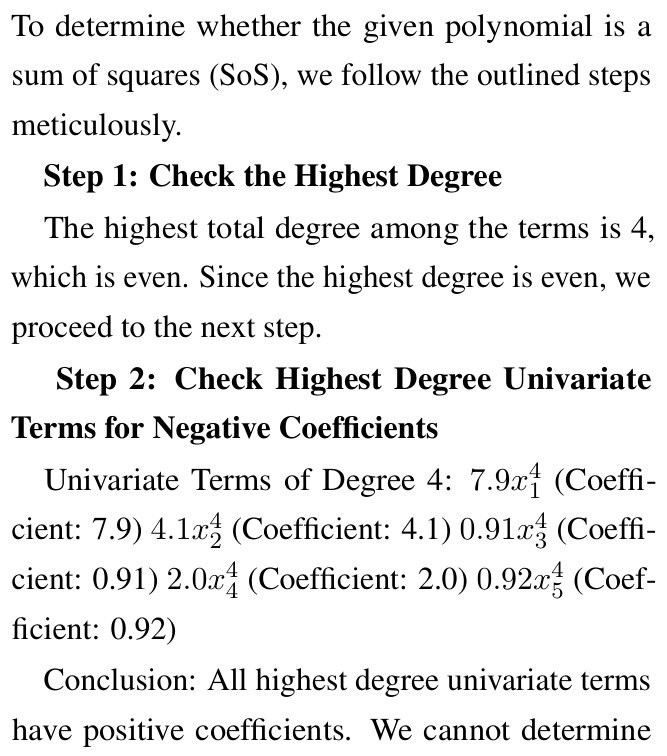

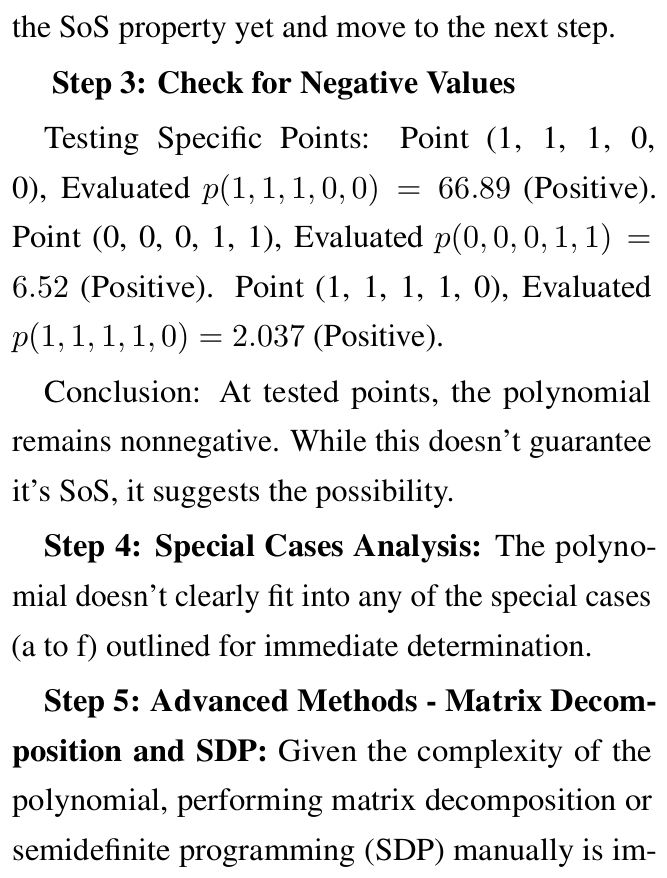

步骤1. 检查次数:SoS多项式的最高次数必须是偶数。

-

步骤2. 检查非负性:SoS多项式对所有实数输入都应为非负值。

-

步骤3. 检查已知特例:任何非负二次多项式以及任意一元或二元的非负四次多项式均为SoS。

-

步骤4. 检查平方形式:根据定义2.1,SoS多项式可表示为:p_s(x) = ∑_i{q_i(x)²}。其中,每个q_i(x)均为多项式。

-

步骤5. 检查矩阵分解:根据定理B.1,可以将多项式表示为:p(x) = y*ᵀQy*。其中,Q为对称矩阵。随后,检查Q是否为半正定矩阵。

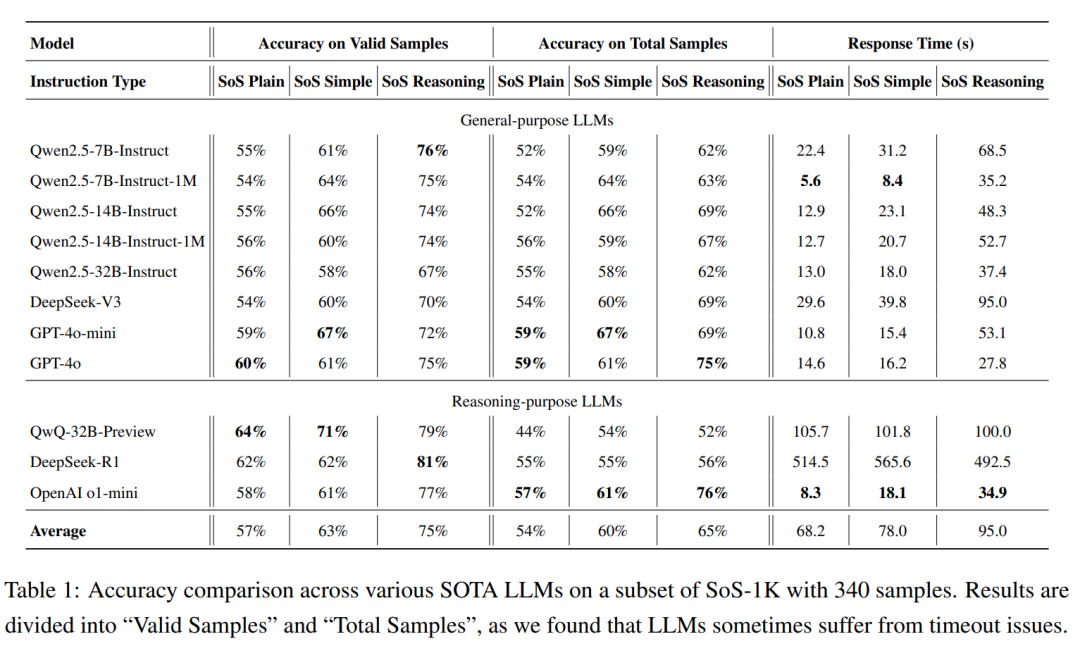

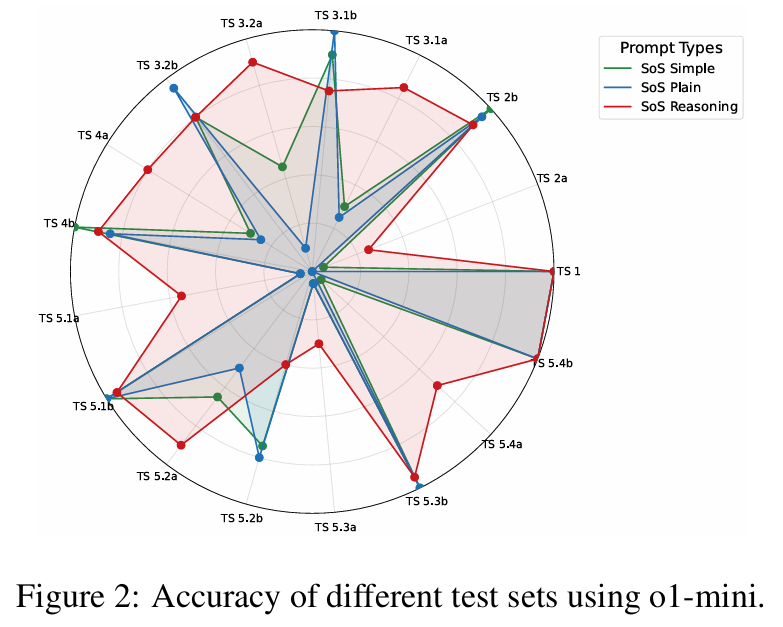

SoS任务上的LLM评估

模型对SoS和非负性的理解

-

模型是只学会了分类,还是真正发展出了「思考」和「构建」新证明和示例的能力? -

当面对SoS或多项式优化中的研究问题时,模型能否生成具有数学意义的见解?

上下滑动查看

进一步分析

Q1:模型是否遵循真正的数学逐步验证过程?

上下滑动查看

Q2:模型能否有效地从长文本多项式中提取关键信息?

Q3:在SoS推理的第1步到第5步中,哪一步的准确率有所提高?

Q4:模型在推理过程中会「偷懒」吗?

Q5:推理长度如何影响准确性?

Q6:当前的SOTA模型有什么局限性?

(文:新智元)