最近,全球 AI 和机器学习顶会 ICLR 2025 公布了论文录取结果:由蚂蚁数科与清华大学联合团队提出的全新的具身协同框架 BodyGen 成功入选 Spotlight(聚光灯 / 特别关注)论文。

本文研究探索了一个有趣但引人深思的问题:机器人能否像生物一样自主进化?团队通过实验给出了肯定答案:结合强化学习与深度神经网络技术,BodyGen 能在极短时间内自动演化出适应当前环境的最优机器人形态及控制策略,为具身智能的加速进化提供了全新的思路。

目前这一框架的代码已开源至 GitHub 仓库:https://github.com/GenesisOrigin/BodyGen。

据了解,本届大会共收到 11672 篇论文,被选中做 Spotlight(聚光灯 / 特别关注)或者 Oral Presentation (口头报告) 的比例约为 5.1%。

以下是论文作者团队对该论文的解读:

自然界生物通过数百万年的进化,获得了适应环境的完美身体结构与环境交互能力。然而,机器人的设计不但需要极其庞大的人类专家知识,且针对特定环境需要进行大量的实验、设计和迭代。

受自然界生物学启发,科学家提出形态控制协同设计(Co-Design)技术:让机器人模仿生物进化过程,在优化控制策略(大脑)的同时演化自身形态(形体结构、关节参数)从而适应复杂环境。

然而,这一领域长期面临两大难题:一是形体搜索空间巨大,在有限时间内下难以穷举所有可能的机器人形态;二是机器人形态与控制策略深度耦合,评估每一个候选形态设计需要大量计算资源。

来自清华大学与蚂蚁数科的研究团队提出 BodyGen 框架,利用强化学习实现了端到端的高效的形态 – 控制协同设计。

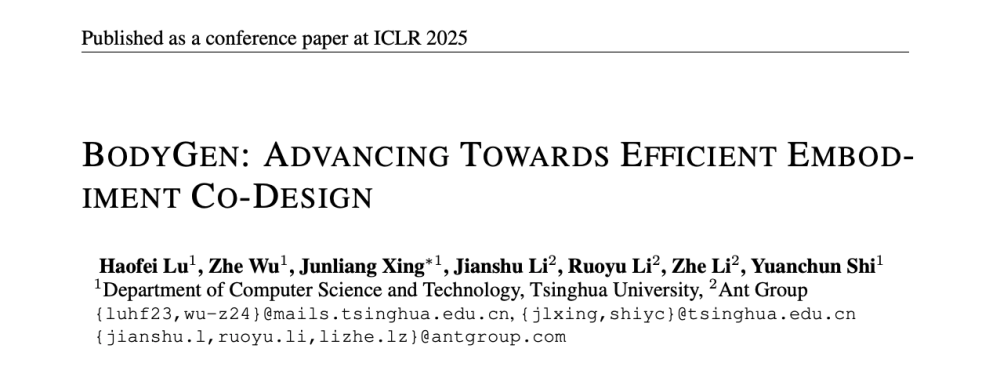

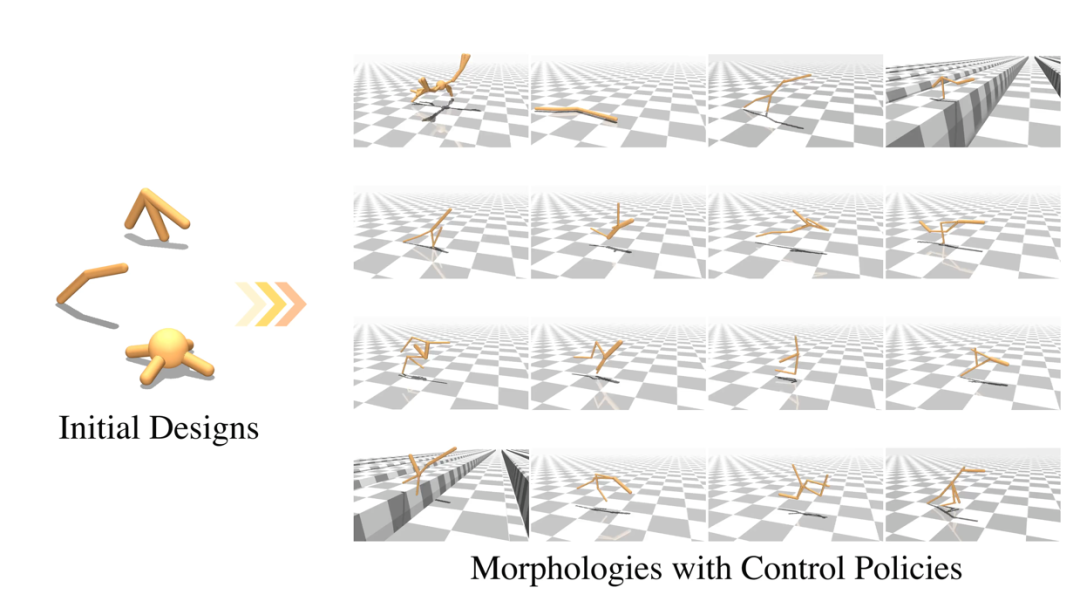

在这项工作中,将形体设计过程划分为两个连续阶段:形态设计阶段、环境交互阶段。

在演化阶段:研究引入 Transformer(GPT-Style)自回归地构建机器人的形体结构并优化参数;在环境交互阶段,同样使用 Transformer(Bert-Style)对机器人的每一个关节信息进行集中处理并发送到对应关节马达,与环境交互并获得反馈。在几轮的迭代后,BodyGen 可以快速生成当前环境的最佳机器人形态和相应的控制策略。

BodyGen 是一个生物启发式的训练框架,它使用深度强化学习进行端到端的形态 – 控制协同设计。

BodyGen 包含三项核心技术点:

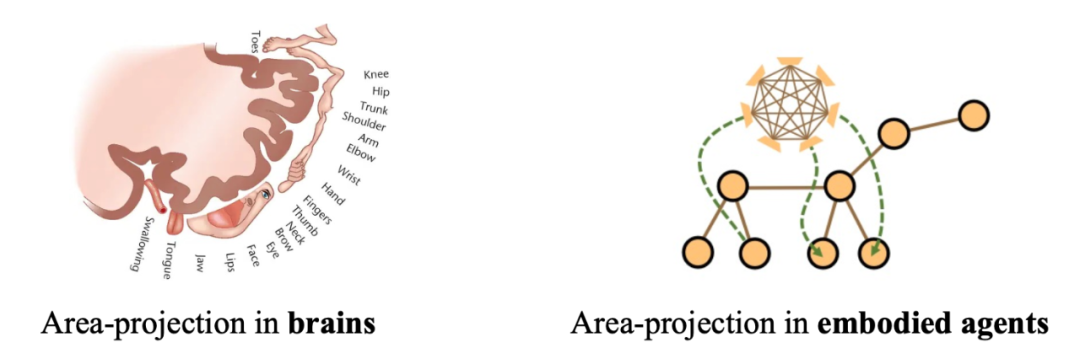

(1)轻量级的形体结构位置编码器 TopoPE;

TopoPE 就像机器人的”身体感知”系统,通过给机器人每个部位贴上”智能标签”。无论机器人的形状如何变化,这些标签都能帮助 AI 理解”这是腿”、”这是手臂”等。这样,即使机器人的形态发生变化,AI 也能快速适应并控制新的身体结构。

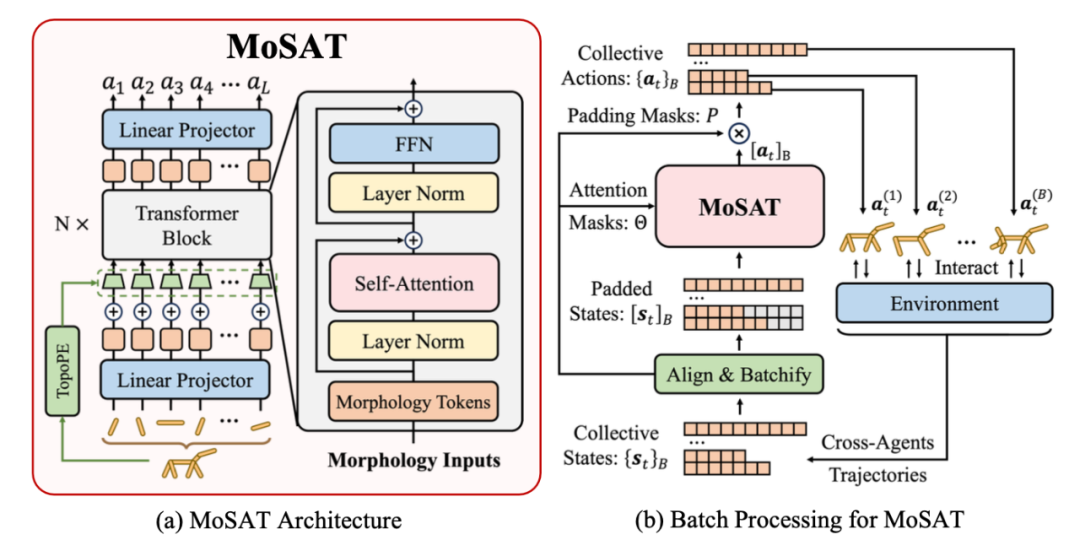

(2)基于 Transformer 的集中式的神经中枢处理网络 MoSAT;

MoSAT 就像机器人的”大脑中枢”,它的工作方式很像人脑,

-

信息收集:首先收集机器人各个部位的信息(位置、速度等)

-

中央处理:所有信息在”大脑”(Transformer 网络)中进行交流和处理

-

指令发送:处理后的信息转化为具体动作指令,告诉机器人如何移动

(3)时序信用分配机制下的协同设计。

-

BodyGen 让 AI 同时负责两件事:设计机器人的身体和控制机器人的动作。

-

设计动作:AI 可以给机器人”长出”新的肢体,”剪掉”不需要的部分,或保持现有结构

-

控制动作:AI 学习如何控制机器人的每个关节来完成任务(如行走、跳跃)

设计一个好的机器人形态可能要等很久才知道效果好不好(比如设计了长腿,要等机器人学会走路才知道这设计是否合理)。BodyGen 通过特殊的”奖励分配机制”,让 AI 能够合理评估自己的设计决策,不会因为短期效果不明显就放弃可能很好的设计。

第一:TopoPE 形体结构位置编码器

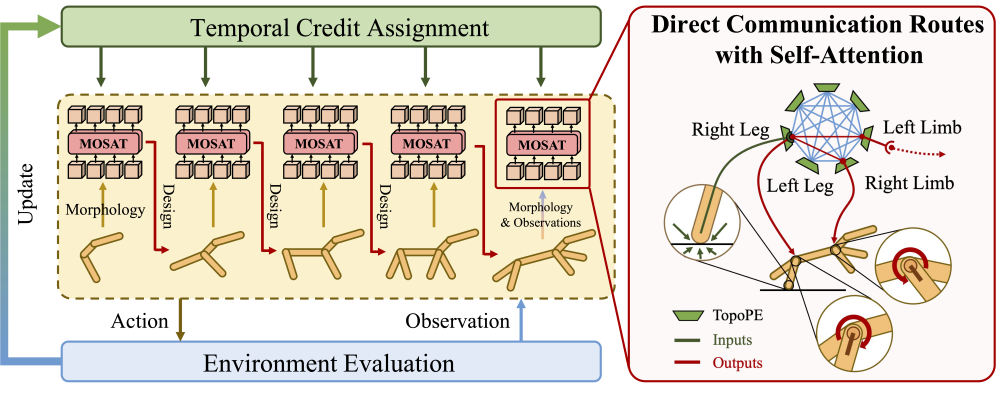

在人脑中,来自身体不同区域的信号会被传输到特定的神经区域进行处理,这隐含了消息来源的位置信息。对于机器人,我们同样需要高效的形体信息表征。

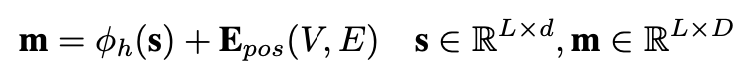

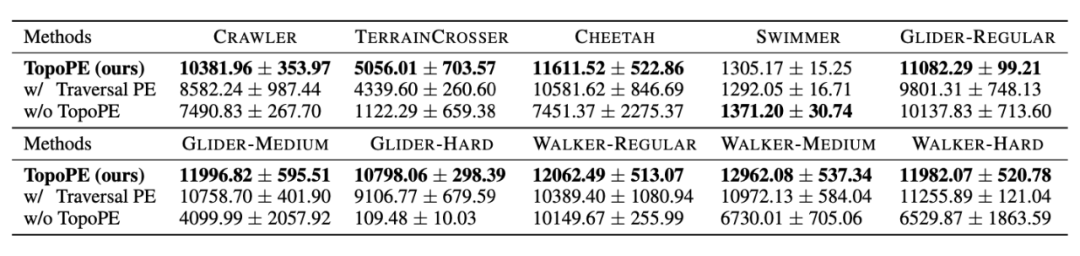

在 BodyGen 中,拓扑感知位置编码(TopoPE)通过哈希映射,将机器人肢体到根肢体的路径映射为唯一的嵌入(Embedding),有效解决了形体演化过程中的索引偏移问题,从而促进了协同设计过程中相似形态机器人的知识对齐和共享。

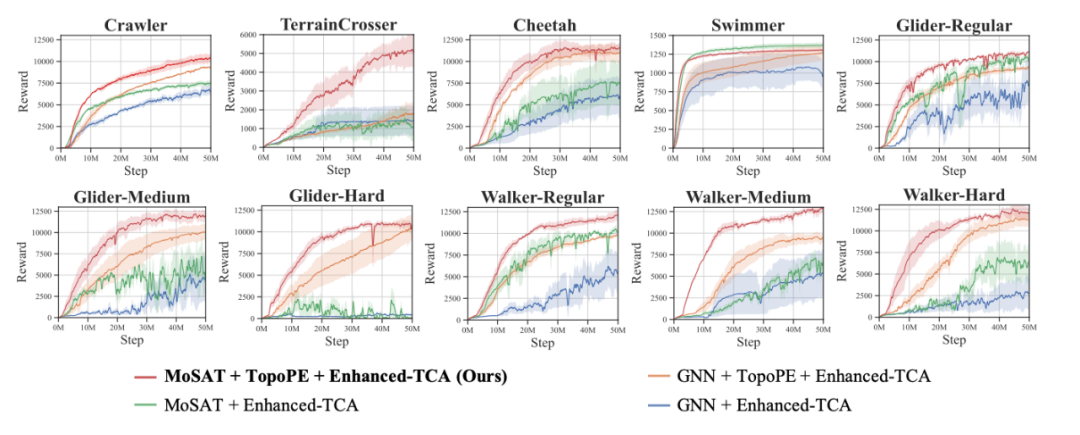

第二:MoSAT 集中式的神经中枢网络

为了通用表征形体空间中的各种各样的机器人,作者使用标准序列模型 Transformer 处理拓扑结构可变的机器人形体。机器人的每一个关节信息都会经过“编码”-“集中处理“-“解码”三个阶段,最终生成动作信号:

-

信息编码:来自不同肢体的信息首先会携带其拓扑位置信息首先通过编码层进行信号编码

-

集中处理:这些编码后的信息借助 Transformer 网络进行点对点的信息通讯,实现集中式的信息交互和处理

-

信息解码:最终,这些信息经过解码网络解码,从而获得机器人的动作信号

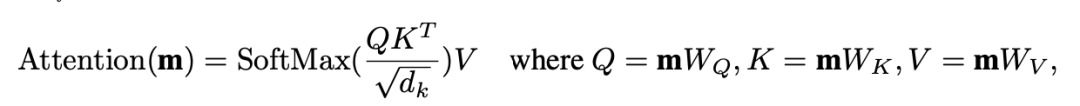

第三:时序信用分配机制下的协同设计

在 BodyGen 的定义中,智能体具有两类基本动作:形态设计动作和形体控制动作。形态设计动作包含三类基本元动作:

-

肢体生长:机器人的形体向下生长出一个额外的肢体

-

肢体退化:机器人的形体删除一个指定的肢体

-

肢体维持:机器人的形体维持某一个肢体不变

同时形体控制动作包含机器人与环境交互每一个关节马达的输出力矩。

本研究使用近端策略优化算法(PPO)进行端到端的协同设计训练优化。相较于形体控制动作,形态设计动作无法获得及时的环境反馈。作者提出改进的广义优势估计(GAE),层次化地对环境奖励进行动态分配,从而使智能体在形态设计和控制阶段获得平衡的优势估计,从而提升训练性能。

研究者选取了 3 种基础的机器人拓扑结构(线性、双腿、四腿),在不同的仿真环境中,环境奖励信号仅为运动敏捷性(指定方向的运动速度)。给定初始结构设计,借助 BodyGen 进行形态 – 控制协同优化。

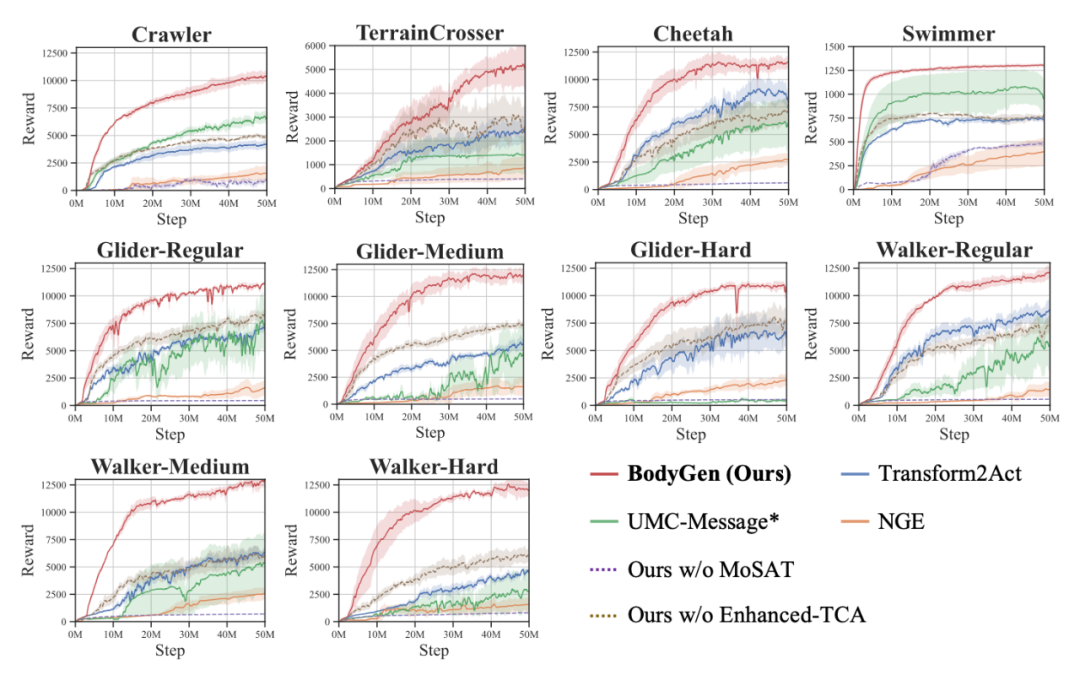

作者在 10 个不同类型的环境进行了综合测评,实验表明,BodyGen 相对于最先进的基线实现了 60.03% 的平均性能提升,在 10 个不同任务种类的环境下(如爬行、地形穿越、游泳等),BodyGen 生成的机器人形态相比于现有最优方法(如 Transform2Act、NGE 等)在环境适应性评分获得了 60.03% 的涨幅。

研究对序列模型、时序信用分配算法进行了充分的对比消融,对文章提出的 MoSAT 架构和时序信用分配算法的进行了详细和充分的实验验证。

作者同样对形体结构位置编码进行了消融实验,证实 TopoPE 在形态表征上的有效性。

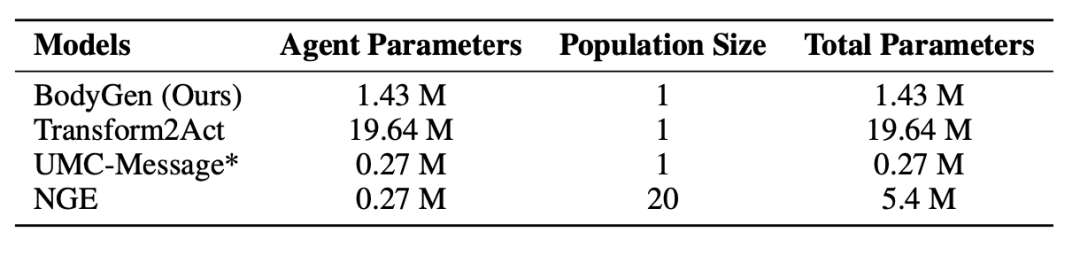

BodyGen 的平均参数量为 1.43M,相较于其他基线算法更加轻量级。BodyGen 的紧凑设计使其在保持生成能力的同时,显著降低了计算成本和存储需求,提升了训练的稳定性与效率。这种高效的模型架构不仅减少了训练时的资源消耗,还提升了推理阶段的响应速度,使其更适用于资源受限的环境,甚至可在一台笔记本上借助 CPU 进行高效推理。

相关代码已开源至 GitHub 仓库:https://github.com/GenesisOrigin/BodyGen,欢迎尝试。

BodyGen 作为一个通用形体 – 控制协同设计算法,展现出了一定的应用潜力,包括但不限于:

-

环境适应性机器人设计:针对特定环境需求,快速生成最优形态与控制策略,显著缩短机器人设计周期,提升开发效率;

-

仿生机器人研究:通过模拟生物运动机理,设计仿生足、鳍、翼等结构,为探索生物运动原理提供可计算平台;

-

虚拟人物动作生成:基于物理引擎的高效动作优化,为游戏、动画制作及虚拟角色行为生成提供技术支持。

团队计划通过物理模拟迁移技术推动 BodyGen 在实际场景中的应用。随着计算能力的提升,这一框架有望成为实现通用具身智能的重要路径,使机器人能够通过感知 – 行动闭环持续优化形态与行为策略,逐步实现自我设计与自动进化。

作者简介

昊飞,清华大学人机交互实验室在读硕士

吴哲,清华大学人机交互实验室博士研究生

合作者

李建树,蚂蚁数科高级算法专家以及团队其他成员

通讯作者

兴军亮,研究员长期致力于感知与博弈决策的理论与应用研究,在多智能体系统、强化学习及智能决策等领域取得了一系列重要成果

智能编码工具层出不穷,究竟怎么选、如何用?3 月 5 日 -28 日,InfoQ 极客传媒将发起「智能编码系列」直播,邀请阿里、百度、腾讯、字节、商汤、思码逸等企业一起在线 Coding,与所有开发者直观感受和评测数款国内外在线编码工具在企业真实生产场景中的表现。欢迎扫码或点击按钮一键预约直播、查看回放

今日荐文

(文:AI前线)