大模型一直以来是一个黑盒,今天Anthropic扒开了这个黑盒,分享了Claude是如何思考的:

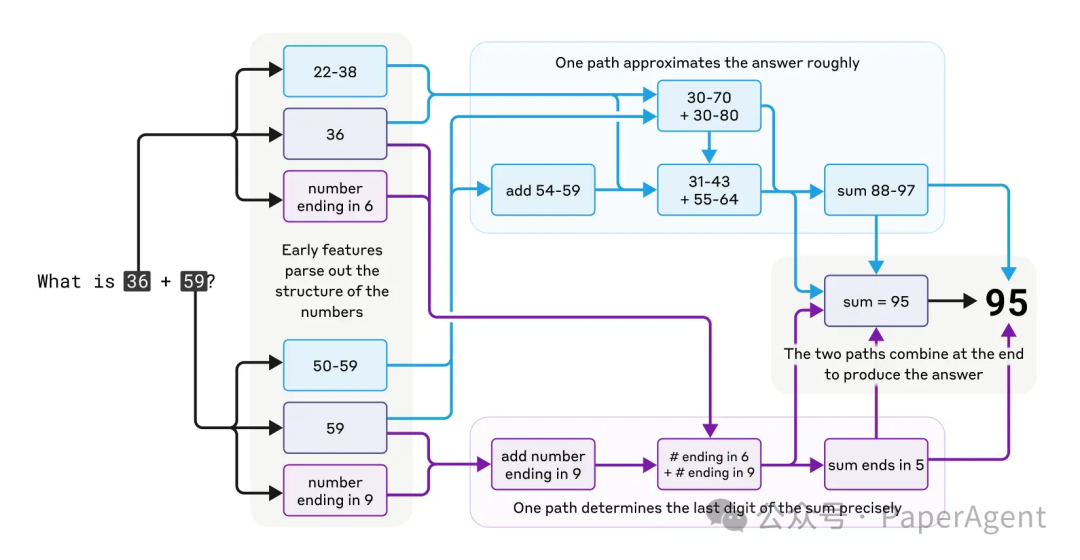

Claude 进行心算时,采用多条并行计算路径:一条计算粗略近似值,另一条精确确定最后一位数字,两者结合得到最终答案。尽管它能正确计算,但它似乎并不“知道”自己是如何做到的,这反映了它在训练中发展出的内部策略与人类理解之间的差异。

二、Claude多步推理

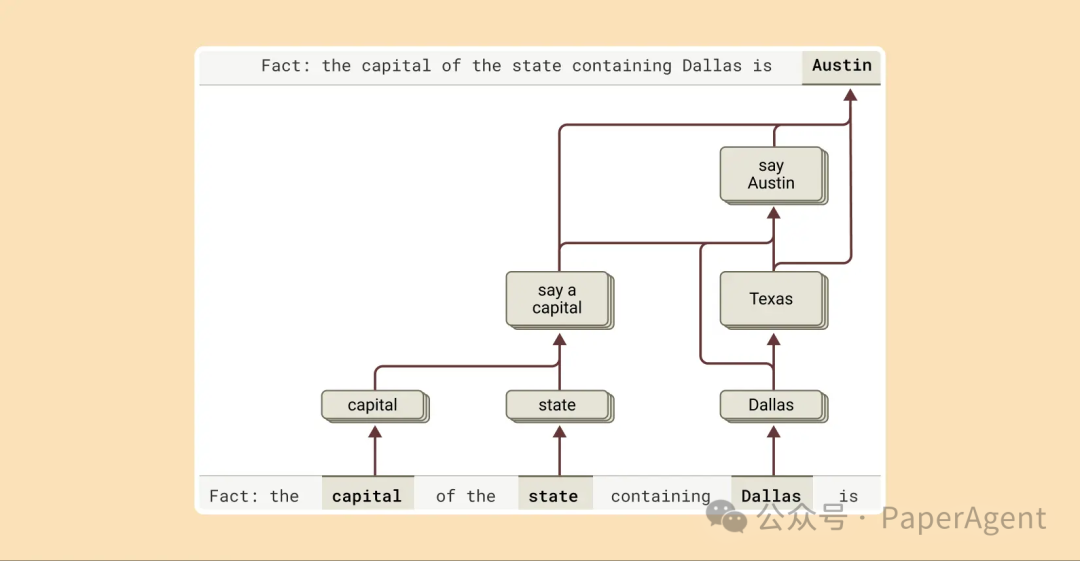

语言模型回答复杂问题时,一种简单方式是通过记忆答案。例如,对于问题“达拉斯所在州的首府是什么?”模型可能直接输出“奥斯汀”,而没有理解达拉斯、德克萨斯州和奥斯汀之间的关系,只是在训练中记住了这个问题和答案。

Claude 在处理需要多步推理的问题时,会进行更复杂的思维过程。以达拉斯问题为例,Claude 会先激活代表“达拉斯位于德克萨斯州”的概念,再连接到“德克萨斯州的首府是奥斯汀”的概念,通过结合独立的事实来得出答案,而不是简单地记忆和输出。

此外,可以通过干预中间步骤来改变模型的输出。例如,将“德克萨斯州”概念替换为“加利福尼亚州”概念后,模型的输出从“奥斯汀”变为“萨克拉门托”,这表明模型是利用中间步骤来确定答案的。

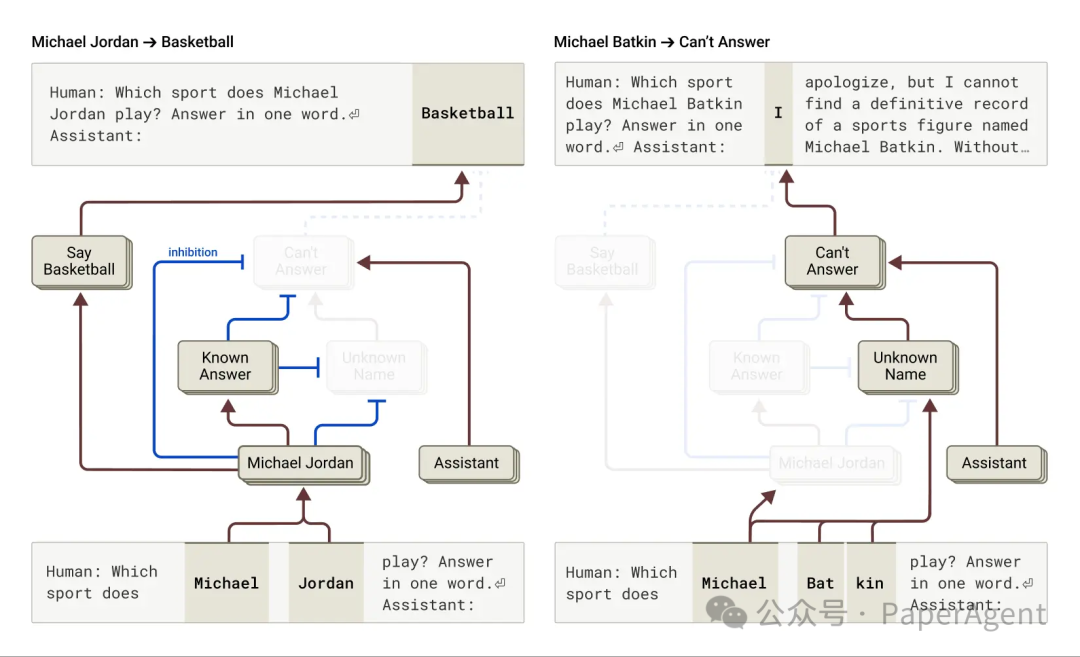

语言模型有时会“幻觉”,即编造信息。这是因为模型训练中总是被要求猜测下一个词,这可能导致它们在不确定时仍给出答案。为了防止幻觉,像 Claude 这样的模型被训练成默认拒绝回答问题,除非它确信自己知道答案。

在 Claude 中,有一个默认开启的“拒绝回答”电路,当模型遇到已知实体(如“迈克尔·乔丹”)时,一个“已知实体”特征会被激活,抑制默认的拒绝电路,从而允许模型回答问题。但如果遇到未知实体(如“迈克尔·巴特金”),模型会拒绝回答。

左边:Claude回答了一个关于已知实体(篮球运动员迈克尔·乔丹)的问题,其中“已知答案”概念抑制了它的默认拒绝行为。右边:Claude拒绝回答一个关于一个未知人物(迈克尔·巴特金)的问题。

通过干预模型,激活“已知答案”特征或抑制“未知名称”特征,可以使模型产生幻觉,例如声称迈克尔·巴特金会下棋。这种幻觉有时也会自然发生,当模型识别出一个名字但对其一无所知时,“已知实体”特征可能错误地激活,抑制默认的“不知道”特征,导致模型编造出看似合理但不真实的回答。

四、多语言能力

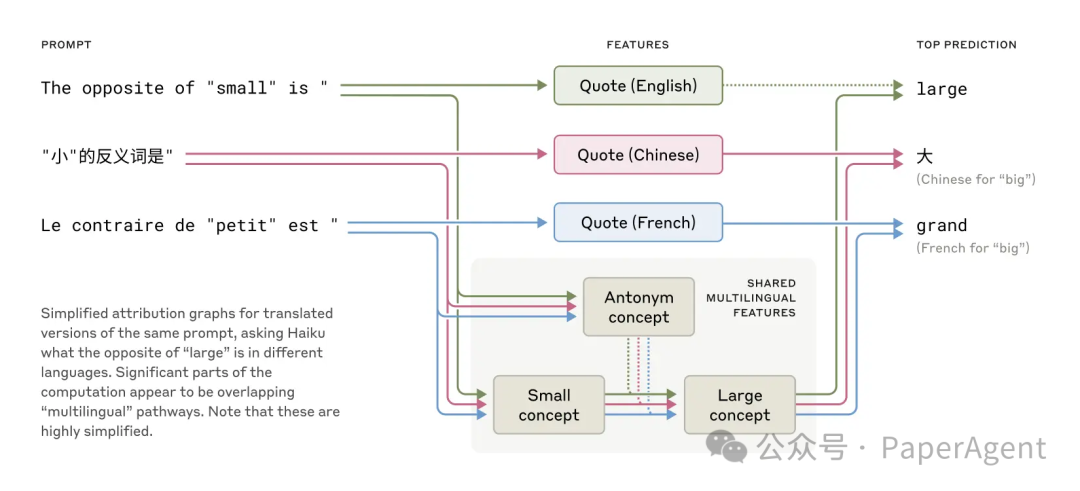

Claude 是如何实现多语言能力的?它能够流利地说几十种语言,包括英语、法语、中文和他加禄语。Claude 的多语言能力并非通过独立的“法语版”或“中文版”模块实现,而是存在一个跨语言的核心机制。

不同语言(如英语、法语和中文)之间存在共享的特征,表明存在一种概念上的普遍性。例如,当要求 Claude 用不同语言回答“小”的反义词时,模型激活了与“小”和“反义”相关的相同核心特征,并触发了“大”的概念,然后将其翻译成问题的语言。随着模型规模的增大,这种跨语言共享的特征比例也在增加。

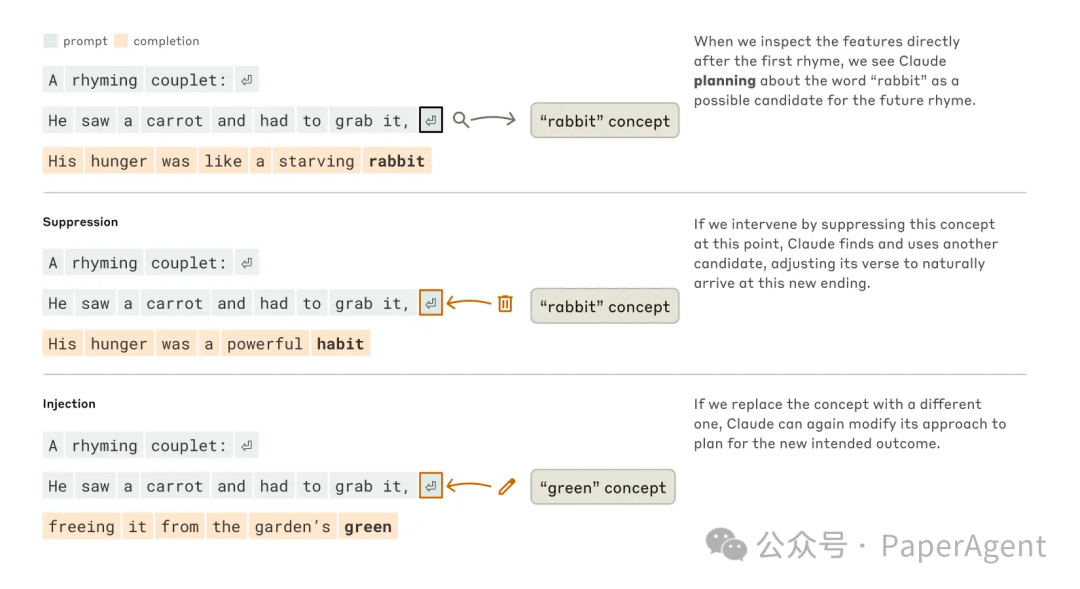

Claude 在创作押韵诗歌时会提前规划。例如,在写“他看到一根胡萝卜,忍不住要去抓,他的饥饿就像一只饥饿的兔子”时,模型需要同时满足押韵(与“grab it”押韵)和语义合理(为什么要去抓胡萝卜)两个约束条件。研究人员原本猜测 Claude 是逐词写作,直到行尾才选择押韵词。然而, Claude 会提前思考可能押韵的词汇,并围绕这些词汇构建诗句。

Claude 的“规划机制”具有适应性:当研究人员干预其内部状态(例如抑制“兔子”概念或注入“绿色”概念)时,Claude 会灵活调整诗句的结尾,例如改为“habit”或“green”,展现出规划能力和适应性。

(文:PaperAgent)