“ 意图识别不准确只是智能体应用过程中的一个问题,在实际操作中还会有其它更多的问题存在;因此,我们不能太信任技术本身,而是需要完善的解决方案去规避技术风险。”

最近在研究大模型智能体也就是Agent的过程中,遇到了一个很严重的问题,直接影响到Agent的质量和效果;那就是意图识别不准确,也可以说是Agent的幻觉问题。

其产生的原因就在于大模型有时无法准确识别出用户意图,无法准确调用相应的函数。

意图识别不准确

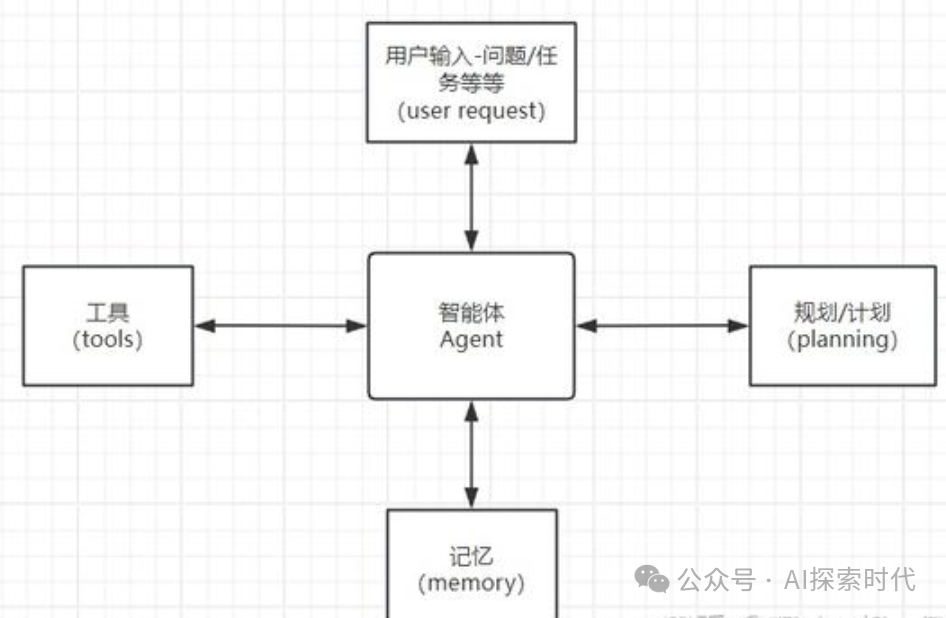

现在大模型技术在应用方面,主要有两大方向;其一就是大模型的创作能力,简单来说就是内容生成方面,如生成图片,文字,视频,也包括RAG等。另一方向就是智能体,其目的是使大模型能够像人类一样,通过思考加使用外部工具的方式,能够自动化处理一些问题。

比如说,让大模型遇到不懂的问题,可以自己上网搜索;需要使用一些第三方工具,比如说调用高德的地图接口或者调用美团的下单接口去自主规划旅行路线并订购门票,酒店等。

这就是大模型的主要应用方向——智能体。

以上是关于大模型智能体的功能介绍,下面我们从技术实现的角度来研究智能体。

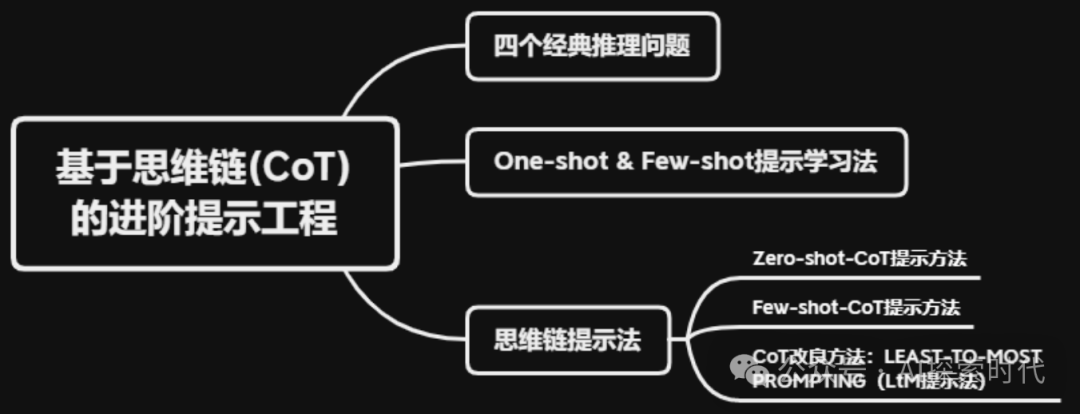

从技术的角度来说,实现智能体首先大模型需要具备“思考”的能力,也就是能够自主规划和拆解目标,把需求变成可行性的步骤;而这就是思维链技术。

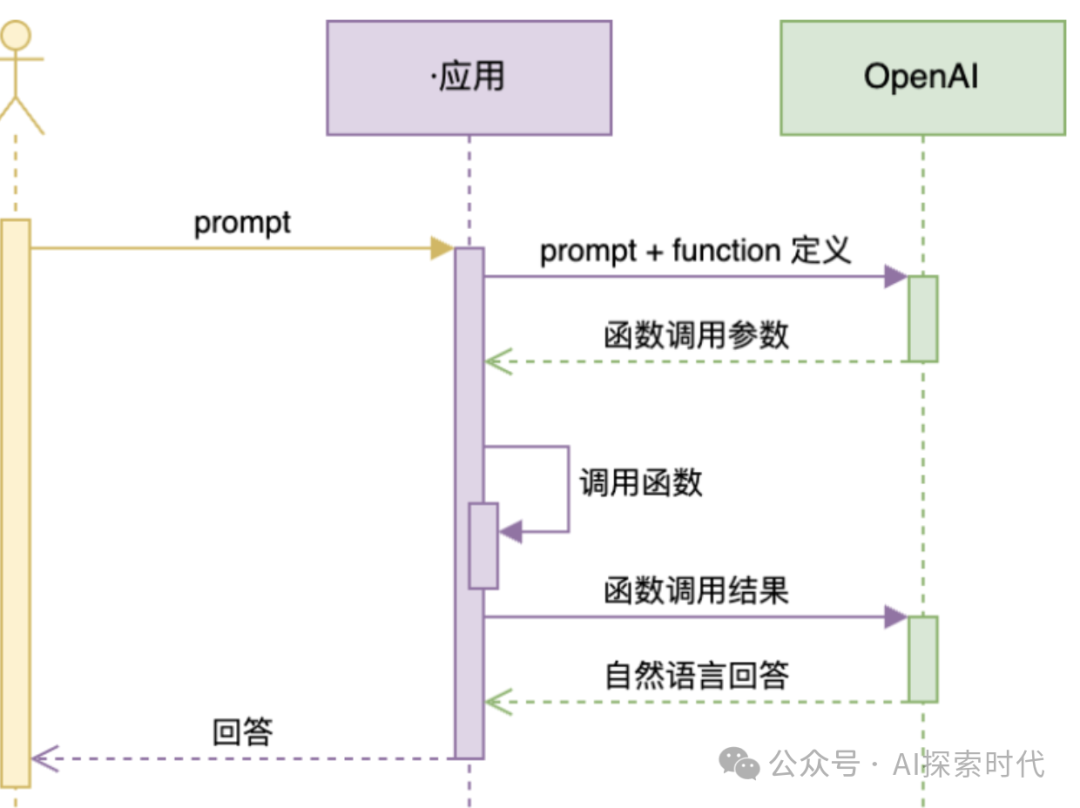

而要想实现智能体不仅仅需要大模型具备“思考”的能力,同时还需要大模型能够使用外部工具,简单来说就是第三方接口。而这个在技术上怎么实现呢?

关于大模型调用外部工具接口的技术,就叫做function call 也就是函数调用;是通过给大模型提供一个函数列表,这个函数列表中描述了每个函数的功能,参数等;比如需要看地图就调用地图接口,需要看天气就调用天气接口等等。

虽然说函数调用从技术上来看挺简单,但等到真正操作起来却是很复杂的一件事;比如说作者目前就遇到了一个很严重的问题,就是意图识别不明确问题。

简单来说,你想实现一个Agent智能体,然后根据功能定义了一堆函数列表;然后告诉大模型根据用户输入的问题,去自主判断调用那个函数。

也就是说,你要查天气就去调用天气接口,你要查地址就去调用地图接口;而不是在查天气的时候调用地址接口或者在查地址的时候调用天气接口,这就是意图识别。

如果说你的智能体涉及的功能比较少,需要调用的接口也比较少;可能还不会出现这个问题,但如果当你智能体的功能比较复杂时,需要调用多个不同的接口;这时大模型可能就会偶尔抽风,出现不知道或者调用错误的接口。

当然,这种现象并不仅仅只是大模型的问题,我们人类同样也有可能出现这种问题。

举例来说,有一辆三轮车和一辆小货车,然后我说要拉东西你去把车开过来一下;这时你应该开三轮车还是小货车?

作为一个需求来说,如果东西比较多,可能三轮车就无法满足你的需求;而如果东西比较少,三轮车和货车都可以满足你的需求;当然,在实际操作的过程中,还需要考虑东西的体积,质量,路程等等。

但对大模型来说,三轮车和小货车都是拉货的,这时它可能就会识别出错,在应该使用小货车的时候,它开了一辆三轮车过来。

而这就是智能体函数调用中可能会经常出现的问题;但应该怎么解决这个问题呢?

说实话这种问题目前还没有一个完美的解决方案,即使放到我们人类身上偶尔也会因为沟通或理解的问题导致出错,在大模型上这种错误概率更是会被无限放大。

而我们只能尽可能的去避免这种问题的出现,而具体的解决办法大概有以下几种:

使用准确清晰的描述

那个函数到底的干啥的,有什么具体的功能,最好使用最细致的描述,使歧义尽可能的降低

使用多轮对话

通过多次交流,使得能够更准确的理解需求;而这也是我们平常沟通过程中经常用的的方法。

使用分类模型

说白了意图识别问题,本质上就是一个分类问题;你的描述越模糊分类越困难,因此可以使用专业的分类模型,来让大模型确定自己的需求。

使用规则引擎

帮助大模型设计一套规则引擎,简单来说就是当大模型出现模糊判断的时候,应该怎么进行兜底;比如说增加人工判断或者重新选择的机会等。或者使用某种规则,不管意图什么样,只要满足规则需求就去执行。

总之,大模型智能体在具体实践和技术研究中存在较大的事实差距;我们在使用的过程中需要根据具体的场景和问题,去优化和完善我们的解决方案;而不是全部依赖于技术本身。

(文:AI探索时代)