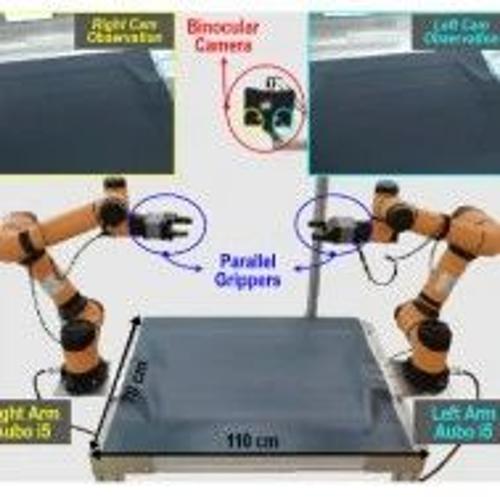

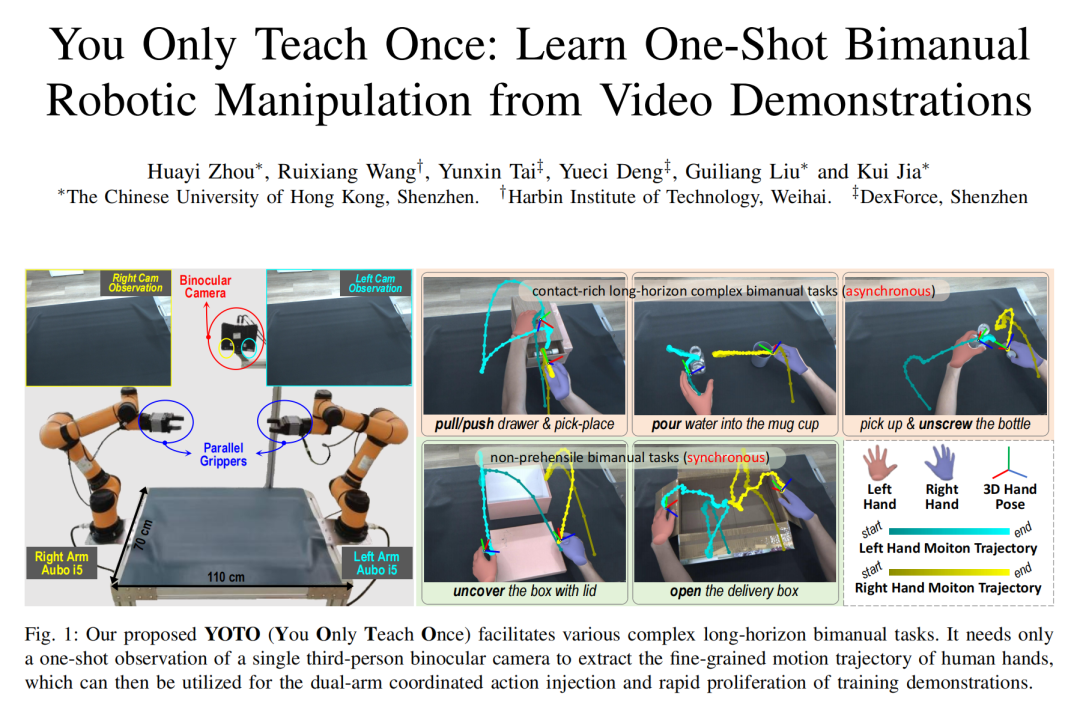

跨维智能日前公布了其在具身智能领域的前沿突破,即“一次示教即会”(You Only Teach Once,YOTO),机器人只需通过单台跨维智能双目纯视觉空间与具身智能传感器的一次观察,就能提取人类手部的精细运动轨迹,之后通过Sim2Real以合成数据在虚拟空间中进行高效的数据增殖与扩展,最后经过智能的双臂扩散策略(DexBiDP),即可确保双臂机器人高效准确的执行相似的泛化任务。

YOTO是行业内基于3D VLA,并且无需机器人硬件或遥操设备,就能快速形成双臂协同、多技能、长程复杂任务泛化能力的工作。相较于传统需至少数千次标注的机器人训练模式,YOTO将学习效率提升三个数量级,开创“所见即所得“的具身智能新范式。

以做一碗坚果酸奶为例,机器人如何完成相似的长程任务

▍单次演示,无限可能

如何让机器人学习人类操作,拥有决策能力,来应对复杂多变的情况,而不是只是机械化的执行预编程操作,是具身智能的本质要求。传统的机器人学习方法往往需要大量的人工标注和复杂的动作定义,耗时耗力。而YOTO通过单次人类视频演示学习双臂操作,极大地提高了学习效率。这种高效的学习方式,使得机器人能够快速掌握人类的复杂操作模式,为具身智能系统在实际应用中的快速部署和适应提供了可能。

YOTO框架的核心在于其高效的学习能力。它能够从单次人类视频演示中提取双臂操作模式,并将其精准地应用于机器人的动作规划,进而完成各项任务,这一过程涉及多个关键技术模块:

▍毫米级手部运动提取

YOTO搭载纯视觉仿人双目视觉传感器,通过多模态特征融合算法,实时捕捉21个手部关节点位姿、接触状态与6D运动轨迹,左右手3D网格模型等。创新性引入立体匹配反投影技术,将2D图像序列升维至毫米级精度的三维运动流。在“坚果酸奶制作“任务中,机器人可精准复刻人类手腕17°倾角与0.3秒抓握时序,动作误差控制在±1.5mm。

▍基于Sim2Real的高效数据扩展

丰富的训练数据是提高模型泛化能力和鲁棒性的关键,也是掣肘具身智能发展应用的最迫切问题,跨维DexVerse™具身智能引擎,作为业内首款商业化落地的高通用性数据生成引擎,以Sim2Real方式,解决了现有技术无法合成形式多样的高质量三维仿真数据资产问题,弥补了以往因为难以人为介入控制所导致生成数据误差的缺陷,其具备低成本获取海量丰富数字资产的能力,为持续低成本生成数据打造了坚实的数据资产基础。

在“制作酸奶”这个任务中,DexVerse™ 具身智能引擎可对操作对象的周围环境,如瓶子、桌面纹理、环境光线等各种参数进行不同配置,进一步泛化其操作任务。

• 物理级环境建模:支持材质摩擦系数(μ)、光照反射率(ρ)等200+物理参数动态调整

• 几何语义增殖:基于开放词汇分割(OVS)技术,实现物体位姿6D扰动与类别替换的自动化扩展

• 零成本数据工厂:单次示教可衍生300+高质量训练轨迹,较传统遥操作效率提升58倍

▍双臂扩散策略(DexBiDP)

|

|

|

|

|

|

双臂协调控制一直是具身智能领域的难题,YOTO的双臂扩散策略(DexBiDP)有效地解决了这一难题。DexBiDP基于扩散模型进行动作预测,通过简化观察输入,仅关注操作对象的点云数据,减少了模型的计算复杂度和训练时间。同时,BiDP 预测关键姿势而非连续动作,降低了扩散空间的维度,提高了模型的训练效率和稳定性。此外,DexBiDP 通过对双臂动作进行协调控制,确保双臂在执行任务时能够高效地协同工作。

▍重塑双臂协同作业的新未来

相比于人形机器人完成“走路、跑步、跳跃”等炫技动作,跨维智能始终坚信,双臂协同作业在现阶段更能体现具身智能的实际落地价值。

在工业生产线上,机器人需要执行各种复杂的操作任务,例如装配、打螺丝等,YOTO框架能够使机器人快速学习和适应新的操作模式,提高生产效率和质量。通过单次演示,机器人可以掌握复杂的装配技巧,减少人工干预,实现自动化生产。

家庭服务机器人需要具备灵活的操作能力,以完成各种家务任务。YOTO框架使得机器人能够通过观察人类的演示,快速学习如何操作家用电器、整理物品等任务。这种高效的学习能力,将使家庭服务机器人更加智能化和实用化。

在康养领域,机器人在理疗及辅助康复训练具有重要的应用价值。YOTO 框架能够使机器人精准地模仿理疗师的操作。同时,在康复训练中,机器人可以根据患者的实际情况,灵活调整训练动作,提供个性化的康复方案。

YOTO框架通过单次人类视频演示学习双臂机器人操作,为具身智能的发展开辟了新的道路。其高效的学习方式、创新的数据扩展技术和智能的双臂协调控制策略,不仅提高了机器人对复杂任务的适应能力和执行效率,还为具身智能系统在实际应用中的推广和普及奠定了基础。

我们有理由相信,随着相关技术的不断发展和完善,YOTO框架将在更多领域发挥重要作用,引领具身智能迈向更加智能化、自主化的未来。

(文:机器人大讲堂)