“ RAG技术未来并不会被淘汰,只不过会随着技术的迭代而不断升级。”

关于RAG技术有很多不同的观点,有人认为RAG技术是大模型的阶段性解决方案,最终会被淘汰;但也有人认为RAG技术仍不能被替代,其作用依然无可代替;而还有观点认为RAG技术会随着大模型技术的迭代进行升级,更多的是会形成协同发展。

而从企业的角度来说,由于RAG技术未来的不确定性,因此有些人对RAG还存在各种各样的顾虑问题。

所以,我们今天就来讨论一下关于RAG在未来的发展形势。

RAG的未来会是什么样?

关于RAG技术会不会被淘汰的问题,作者认为应该不会被淘汰;但肯定会随着大模型技术的发展不断地迭代和演进。

下面我们就来详细梳理一下为什么RAG技术不会被淘汰。

首先,关于RAG技术被淘汰的原因无非就是说大模型的能力越来越强,参数越来越大,泛化能力越来越强,所以以后不再需要RAG这种外部增强工具。

但我们来思考一个问题,虽然大模型的能力会越来越强大,但其能力总是有限的,大模型总不可能真正成为一个无所不能的“神”,至少在可见的未来这种情况几乎不可能实现。

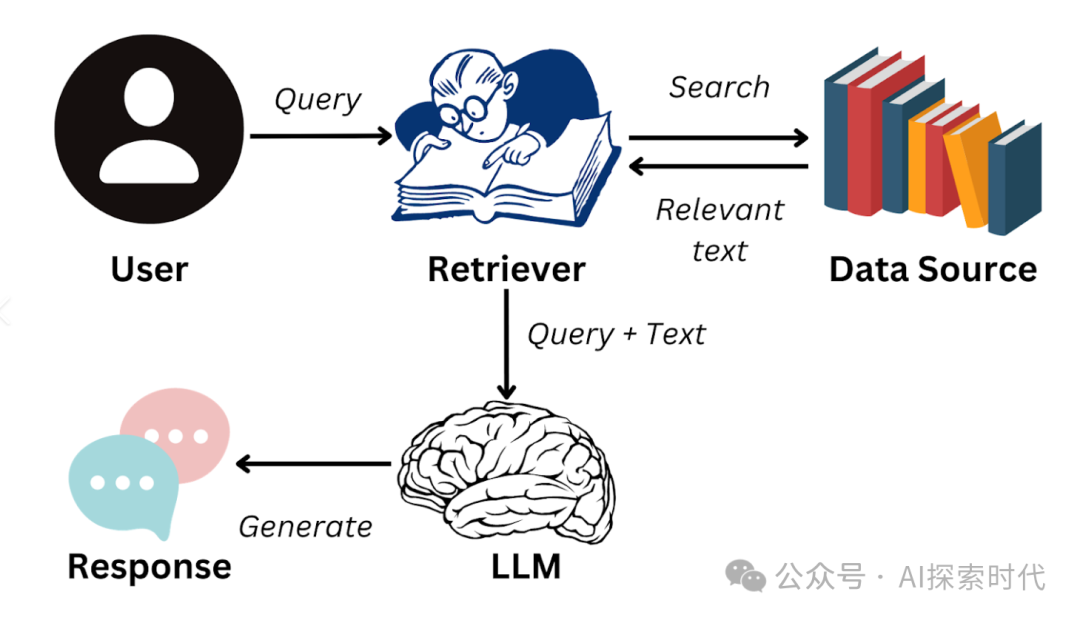

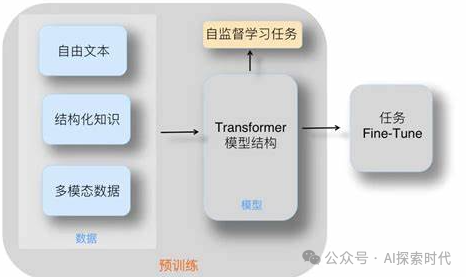

其次,目前模型主要采用的还是预训练的方式,虽然也有反馈学习等方式的出现;但大模型并没有真正学会自主学习,对实时数据依然无法进行处理,而这正是RAG发挥作用的地方。

再有,马克思所推崇的第一性原理,一切以物理规律为基础;大模型的能力增强,但其体积和存储空间也会不断增大;但我们知道物理存储是有极限的,不可能所有都行都能存储下来。

再者说,即使不考虑物理存储的问题,大模型完全依靠自身能力去存储所有数据;但这个成本怎么办?

对很多企业来说,训练和微调一次模型的成本是不可接受的;哪怕可以接受,有更便宜和方便的RAG技术,为什么不去选择RAG而是选择训练或微调?

训练和微调模型的成本不仅仅只包括资金成本,同时还包括技术成本和时间以及迭代成本。

比如说,训练或微调一个金融领域的模型,就只能应用于金融领域;但如果有需求需要处理法律领域的问题该怎么办?

这时又需要重新训练一个新的法律模型,虽然说微调和训练能让模型在特定领域上表现更好,但其缺点同样不可忽视。

而使用RAG技术就没有这方面的顾虑,只需要训练一个NLP任务的模型;然后处理金融领域就加载金融领域的数据,处理法律领域的问题,就加载法律领域的数据。

所以RAG具备模型训练所不具备的优势:

-

成本低

-

实时性好

-

领域适配灵活

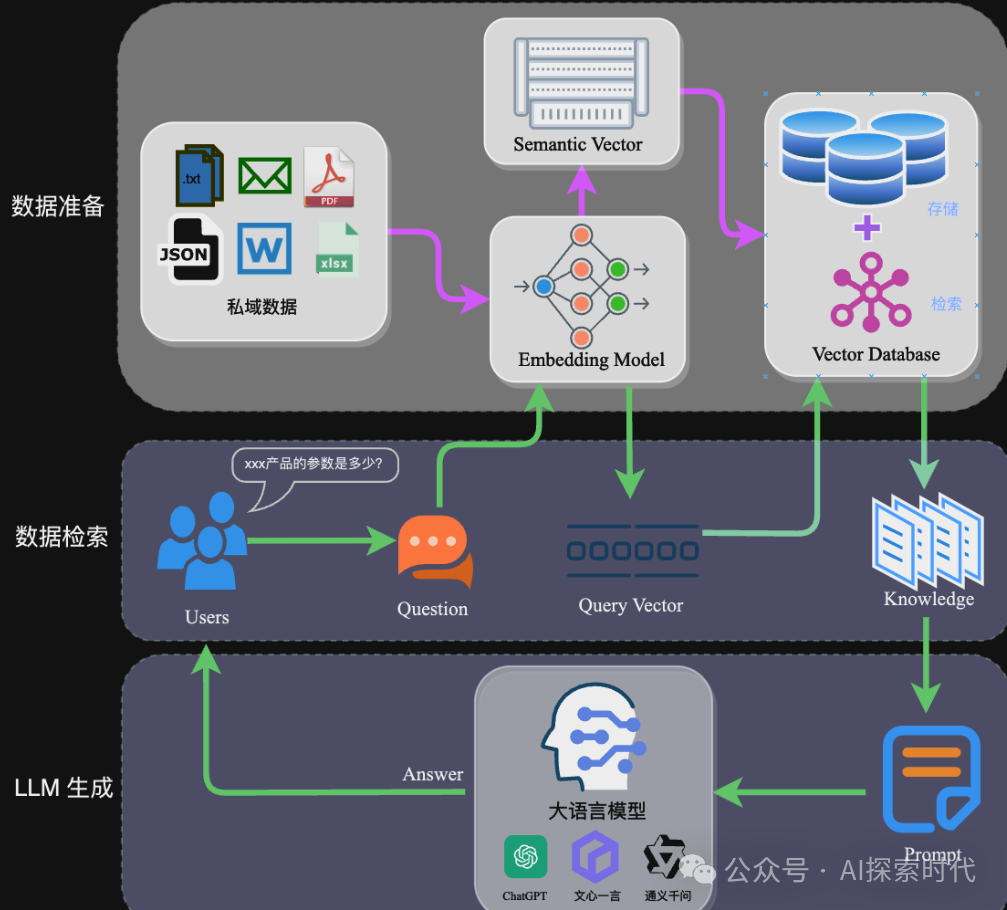

而且从目前的RAG技术发展来看,RAG技术也经过了几次版本的迭代;从刚开始的纯文本检索的RAG技术,到现在的相似度检索,图结构存储,认知增强和分布式RAG等。

更多的还可以把RAG技术与其它领域的技术相结合,比如说智能体,通过智能体来实现RAG的自主检索的功能。

RAG不会消失,而是会进化为智能系统的核心基础设施。其价值不在于取代大模型,而在于构建可持续进化的认知体系。拒绝RAG的企业,将在AI落地深水区失去关键竞争力。

(文:AI探索时代)