不在 OpenAI 的 Andrej Karpathy,始终是传说。

近日,Karpathy 受邀在 YC AI 创业学校活动发表演讲,一经发布,全球网友就like开始学习。

这是一场看似松散、其实处处埋点的演讲。

Karpathy 精心准备了 PPT,对整个演讲内容进行了编排:这像是一次编程语言进化史的讲解,从软件 1.0 的时代开始讲起,到以「喂数据」为核心的。到了 3.0 则是「对模型说咒语」。

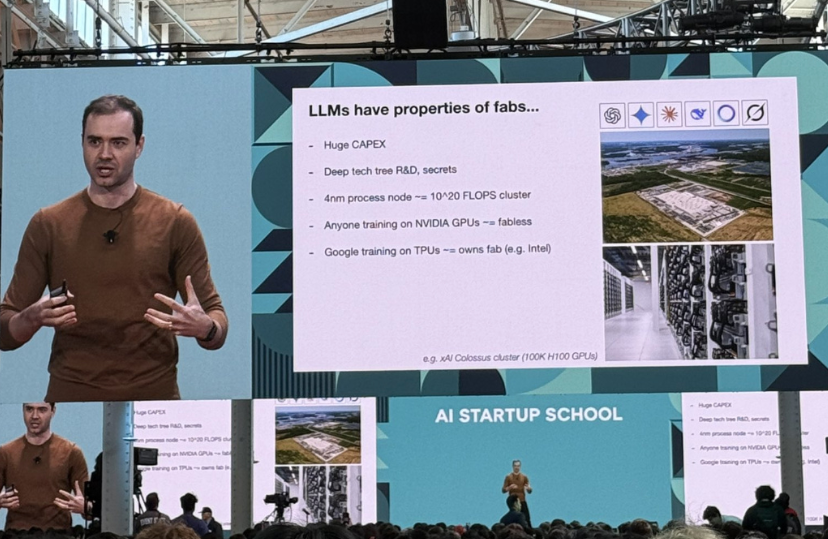

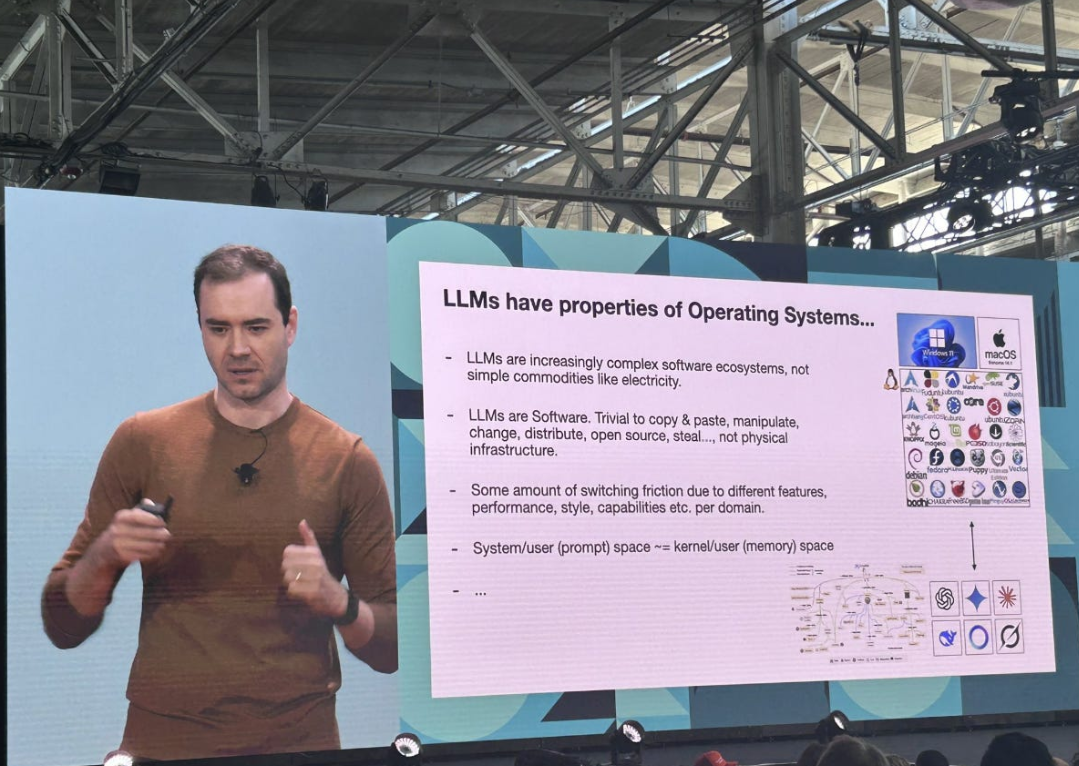

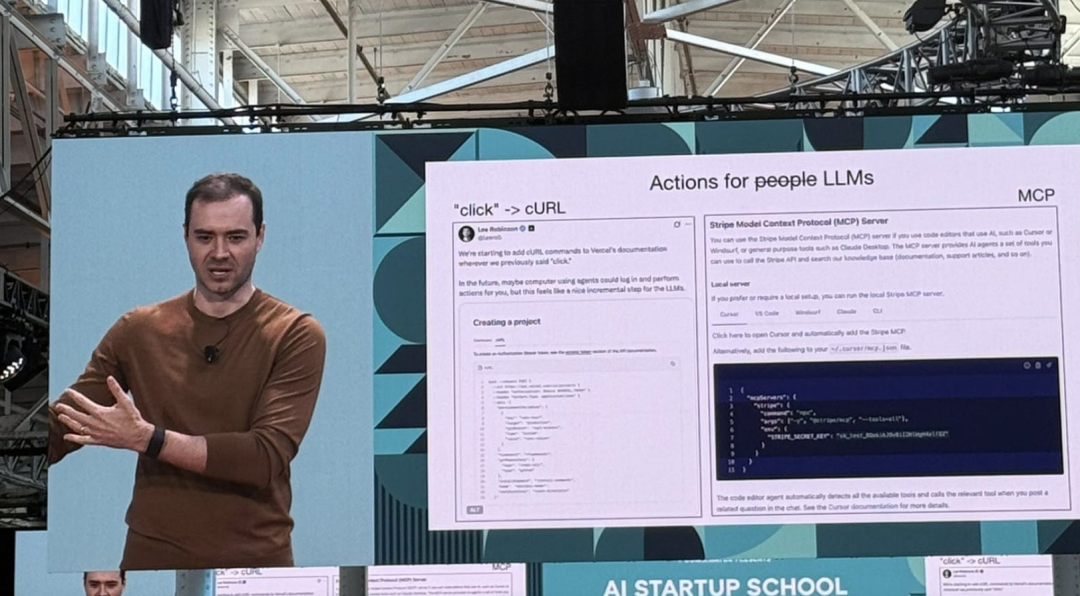

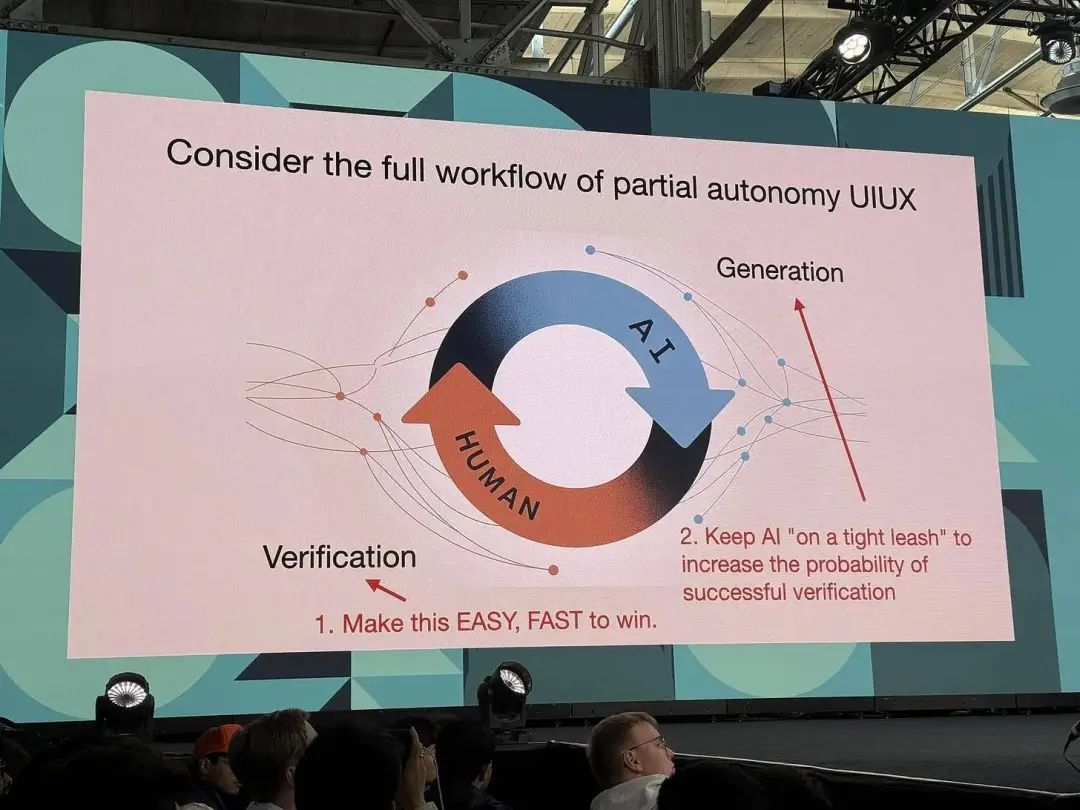

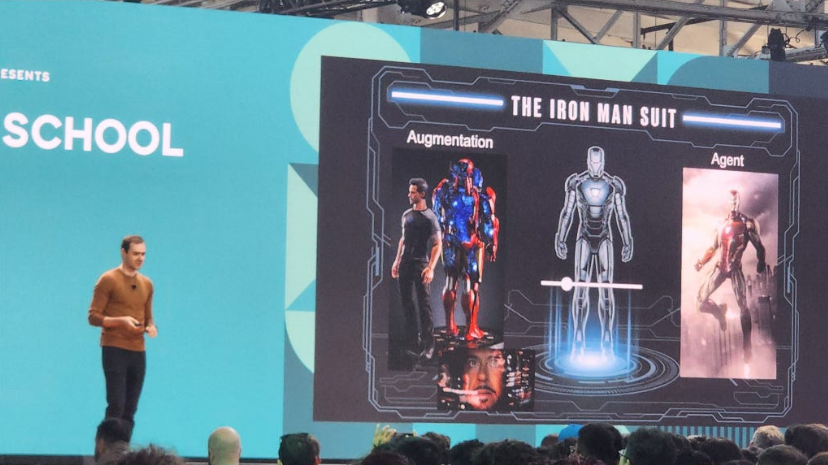

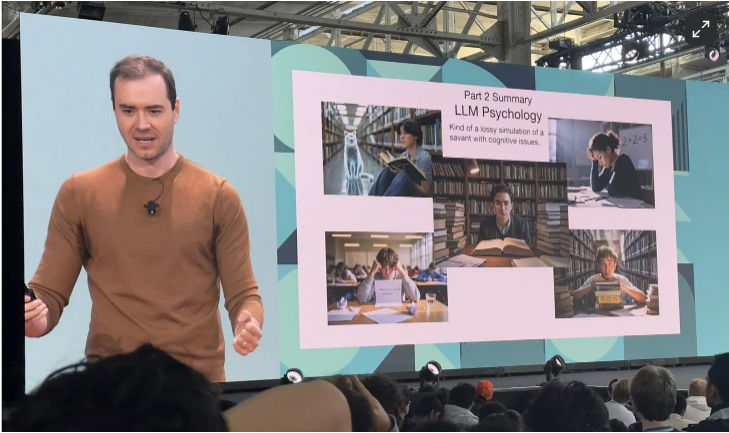

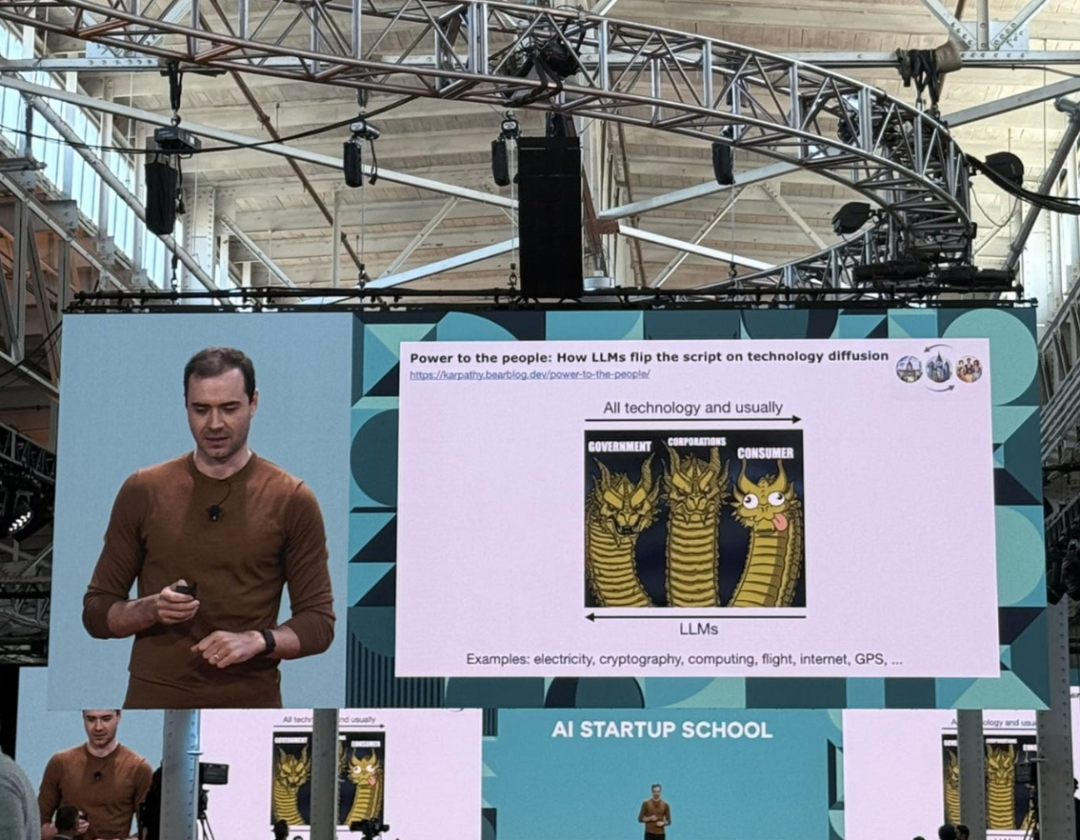

他再一次强调了「LLM 是新操作系统」,并进一步延伸到了 AI 与人类相似的心理特征,最终得出结论:AI 应该增强人类,而非替代人类。

这是他对 LLM 时代的理解,也是一个研究者和 builder 的技术世界观。它不再是激情澎湃的预测,而是一个自我梳理后交出的分享:语言正在变成控制系统,而我们,而每个人都拥有语言接口的一部分。

因为演讲内容过于丰富,我们将它浓缩成了一套「金句卡片」:一句话锚点 + 一段解释,希望你能像翻读卡片一样,直击中心,也许哪一句就能成为你下一个创造的起点。

后台回复 KP ,获取完整版演讲 PPT

(文:APPSO)