困惑度

低Token高精度!字节复旦推出自适应推理框架CAR

复旦大学余海洋与字节的研究人员提出CAR自适应推理框架,根据模型困惑度动态选择短回答或长文本推理,在多模态视觉问答和关键信息提取任务中实现最佳平衡。

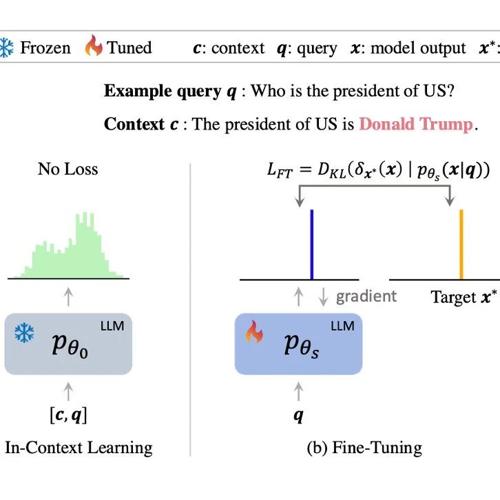

ICLR25|突破传统微调的知识编辑新范式!北京通用人工智能研究院、中科大、北大提出In Context Editing!

大、北大提出

In Context Editing

,这是一种突破传统微调,从自诱导分布中学习知识的

1-bit大模型还能再突破!新一代BitNet架构启用4位激活值

BitNet系列原班人马推出新一代架构BitNet a4.8,采用两阶段权重衰减和学习率调度。实验对比显示其在语言模型困惑度和任务准确性方面与LLaMA相当,并且平均精度几乎没有损失。